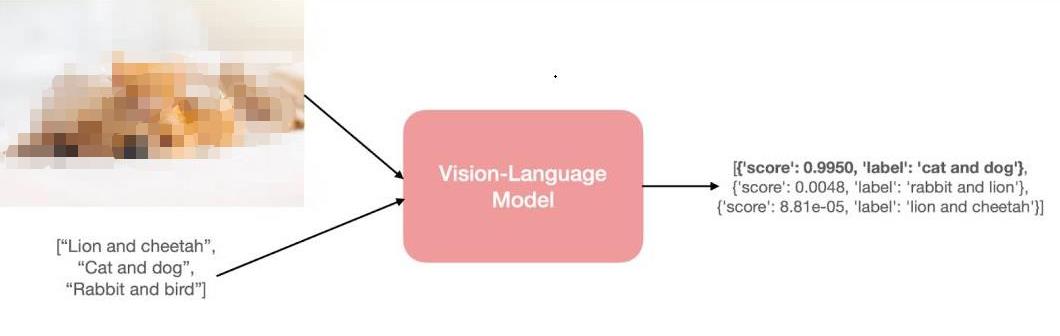

視覺語言模型(Visual Language Model, VLM)是一種結合視覺(圖像/視頻)和語言(文本)處理能力的多模態人工智能模型,能夠理解并生成與視覺內容相關的自然語言。以下是關于VLM的詳細解析:

1. 核心組成與工作原理

- 視覺編碼器:提取圖像特征,常用CNN(如ResNet)或視覺Transformer(ViT)。

- 語言模型:處理文本輸入/輸出,如GPT、BERT等,部分模型支持生成式任務。

- 多模態融合:通過跨模態注意力機制、投影層(如CLIP將圖像文本映射到同一空間)或適配器(Adapter)連接兩種模態,實現信息交互。

訓練數據:依賴大規模圖像-文本對(如LAION、COCO),通過對比學習、生成式目標(如看圖說話)或指令微調進行訓練。

2. 典型應用場景

- 圖像描述生成:為圖片生成自然語言描述(如Alt文本)。

- 視覺問答(VQA):回答與圖像內容相關的問題(如“圖中人的穿著顏色?”)。

- 多模態對話:結合圖像和文本進行交互(如GPT-4V、Gemini的對話功能)。

- 輔助工具:幫助視障人士理解周圍環境(如微軟Seeing AI)。

- 內容審核:識別違規圖像并生成審核理由。

- 教育/醫療:解釋醫學影像、輔助圖表理解或解題。

3. 關鍵挑戰

- 模態對齊:精確匹配圖像區域與文本描述(如區分“貓在沙發上”與“狗在椅子上”)。

- 計算資源:訓練需大量GPU算力,推理成本高。

- 數據偏差:訓練數據中的偏見可能導致模型輸出不公或錯誤(如性別/種族刻板印象)。

- 可解釋性:模型決策過程不透明,難以追蹤錯誤根源。

4. 未來發展方向

- 高效架構:減少參數量的輕量化設計(如LoRA微調)、蒸餾技術。

- 多模態擴展:支持視頻、3D、音頻等多模態輸入。

- 少樣本學習:提升模型在低資源場景下的適應能力(如Prompt Engineering)。

- 倫理與安全:開發去偏見機制,確保生成內容符合倫理規范。

- 具身智能:結合機器人技術,實現基于視覺-語言指令的物理交互。

5. 代表模型

- CLIP(OpenAI):通過對比學習對齊圖像與文本。

- Flamingo(DeepMind):支持多圖多輪對話。

- BLIP-2:利用Q-Former高效連接視覺與語言模型。

- LLaVA/MiniGPT-4:開源社區推動的輕量化VLM。

總結

VLM正在推動人機交互的邊界,從基礎研究到實際應用(如智能助手、自動駕駛)均有廣闊前景。隨著技術的演進,如何在性能、效率與倫理間取得平衡,將是其發展的關鍵課題。

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

發布評論請先 登錄

相關推薦

熱點推薦

【HZ-T536開發板免費體驗】3 - Cangjie Magic調用視覺語言大模型(VLM)真香,是不是可以沒有YOLO和OCR了?

和管理 Agent 的專用語言。它允許開發人員通過結構化的系統提示詞、工具和各類協作策略來增強 Agent 的功能。

今天我們就嘗試在開發板上利用質譜AI的視覺語言模型(

發表于 08-01 22:15

機器人基于開源的多模態語言視覺大模型

ByteDance Research 基于開源的多模態語言視覺大模型 OpenFlamingo 開發了開源、易用的 RoboFlamingo 機器人操作模型,只用單機就可以訓練。

發表于 01-19 11:43

?1071次閱讀

字節發布機器人領域首個開源視覺-語言操作大模型,激發開源VLMs更大潛能

對此,ByteDance Research 基于開源的多模態語言視覺大模型 OpenFlamingo 開發了開源、易用的 RoboFlamingo 機器人操作模型,只用單機就可以訓練。

基于視覺語言模型的導航框架VLMnav

本文提出了一種將視覺語言模型(VLM)轉換為端到端導航策略的具體框架。不依賴于感知、規劃和控制之間的分離,而是使用VLM在一步中直接選擇動作

利用VLM和MLLMs實現SLAM語義增強

語義同步定位與建圖(SLAM)系統在對鄰近的語義相似物體進行建圖時面臨困境,特別是在復雜的室內環境中。本文提出了一種面向對象SLAM的語義增強(SEO-SLAM)的新型SLAM系統,借助視覺語言模型

NaVILA:加州大學與英偉達聯合發布新型視覺語言模型

(VLM)是一種具備多模態生成能力的先進AI模型。它能夠智能地處理文本、圖像以及視頻等多種提示,并通過復雜的推理過程,實現對這些信息的準確理解和應用。NaVILA正是基于這一原理,通過將大型語言

小米汽車接入VLM視覺語言大模型,OTA更新帶來多項升級

小米汽車近日宣布,其SU7車型的1.4.5版OTA(空中升級)已經開始推送。此次更新帶來了多項新增功能和體驗優化,旨在進一步提升用戶的駕駛體驗。 其中最引人注目的是,小米汽車正式接入了VLM視覺語言

拒絕“人工智障”!VLM讓RDK X5機器狗真正聽懂“遛彎”和“避障

項目思路現有跨形態機器人控制需為不同硬件單獨設計策略,開發成本高且泛化性差。本課題嘗試使用語言指令統一接口,用戶用自然語言指揮不同形態機器人完成同一任務,通過分層強化學習框架,高層視覺語言

什么是VLM?為什么它對自動駕駛很重要?

VLM,即視覺語言模型,簡單理解下,其就是把“看見的東西”和“說出來的話”放在同一個腦子里理解的模型。我們平時把相機拍到的畫面交給

基于NVIDIA GPU加速端點使用千問3.5 VLM開發原生多模態智能體

阿里巴巴推出了全新開源 千問3.5 系列,專為構建原生多模態智能體而設計。該系列的首個模型是一款總參數為 397B、具備推理能力的原生視覺語言模型 (

?VLM(視覺語言模型)?詳細解析

?VLM(視覺語言模型)?詳細解析

評論