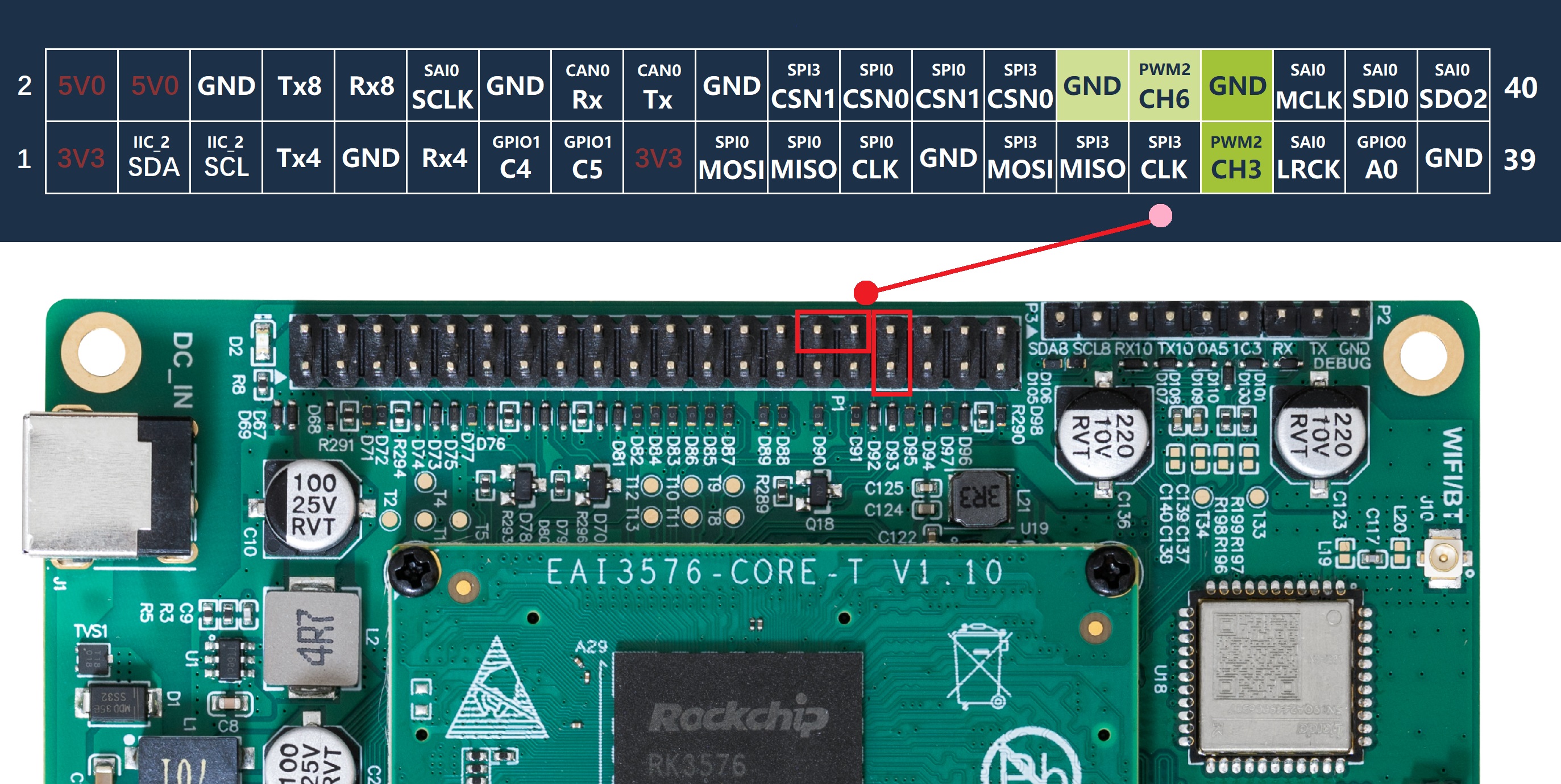

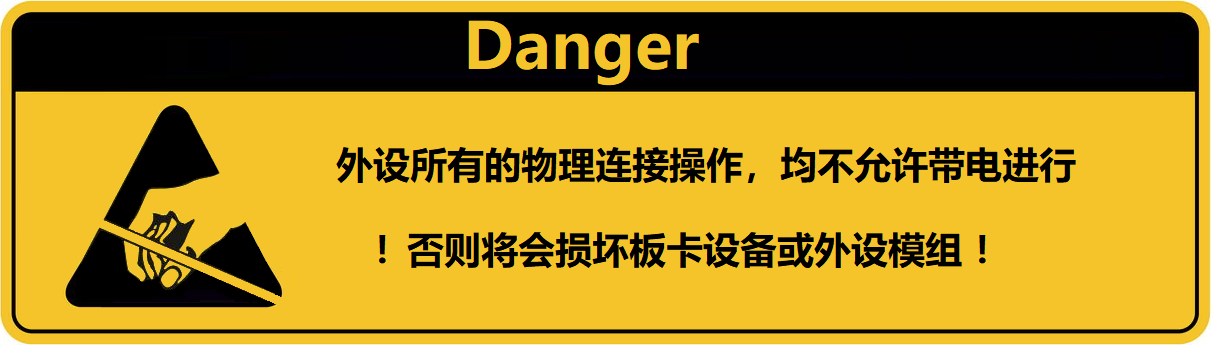

核心結論:部署流程分為5大核心步驟,依次為基礎環境安裝、模型下載、模型格式轉換、部署程序編譯、開發板運行測試,1.5b模型適配4+32G開發板,7b模型需8+64G版,內存不足則需配置swap分區。 本次實驗是基于合眾恒躍HZ-RK3576-MINIEVM ,基于瑞芯微 RK3576/RK3576J 處理器的工業評估板,采用四核 A72 + 四核 A53 架構,主頻 2.2GHz。2 路 Ethernet、2 路 USB3.0、2 路 USB2.0 等通信接口。同時引出 1 路 MIPI LCD、1 路 HDMI OUT、2 路 MIPI CAMERA、1 路 MICIN、1 路 H/P OUT 等音視頻多媒體接口,支持多屏異顯。1 路 debug 接口、1 路 OTG 接口用來調試和燒錄。1 路 2x20P 排針兼容樹莓派、1 路 2x17P 排針用于擴展 IO。 各位如需跟著一起部署操練,附上開發板購買鏈接,直接掃二維碼即可:  ?

?

1. 安裝基礎環境

1.1 新建并激活 conda 環境

1.打開Ubuntu終端,執行命令:conda create -n RKLLM-Toolkit python=3.8

2.激活環境:conda activate RKLLM-Toolkit

1.2 配置 RKLLM 轉換環境

1.在家目錄新建文件夾:mkdir -p software/rkllm

2.解壓rknn-llm-release-v1.1.4壓縮包至該目錄

3.進入工具包路徑:cd rkllm-toolkit/packages

4.安裝工具:pip3 install rkllm_toolkit-1.1.4-cp38-cp38-linux_x86_64.whl

2. 下載 deepseek 模型

2.1 安裝下載工具

在激活的conda環境中執行:pip3 install huggingface-cli -i https://mirrors.huaweicloud.com/repository/pypi/simple

2.2 下載模型

1.新建模型存儲目錄:mkdir -p rkllm/rknn-llm-release-v1.1.4/rkllm-toolkit/examples/huggingface/

2.配置下載加速:export HF_ENDPOINT=https://hf-mirror.com

3.進入目標目錄:cd rkllm/rknn-llm-release-v1.1.4/rkllm-toolkit/examples/huggingface/

4.新建并進入模型子目錄:mkdir deepseek-r1-1.5b && cd deepseek-r1-1.5b

5.執行下載命令:huggingface-cli download deepseek-ai/DeepSeek-R1-Distill-Qwen-1.5B --local-dir . --local-dir-use-symlinks False(官網直接下載可更快)

3. 轉換模型為 RKLLM 格式

3.1 準備轉換腳本

將data_quant.json、export_deepseek_1.5b_rkllm.py、export_deepseek_7b_rkllm.py三個文件,拷貝至rkllm-toolkit/examples目錄

3.2 轉換 1.5b 版本

1.確保激活conda環境:conda activate RKLLM-Toolkit

2.執行轉換:python3 export_deepseek_1.5b_rkllm.py

3.成功標識:出現INFO: Model has been saved to ./deepseek-1.5b-w8a8-rk3576.rkllm!

3.3 轉換 7b 及以上版本

1.執行轉換腳本:python3 export_deepseek_7b_rkllm.py

2.設備要求:PC需保證虛擬機內存充足

3.內存不足解決方案:創建10G交換分區

?dd if=/dev/zero of=/userdata/swapfile bs=1M count=10240

?chmod 0600 /userdata/swapfile

?mkswap /userdata/swapfile

?swapon /userdata/swapfile

4. 編譯部署程序

4.1 編譯與文件傳輸

1.解壓部署例程壓縮包(xsc_deepseek.zip),可以放到板子直接編譯,路徑已修改好

2.拷貝模型文件:將轉換后的.rkllm文件,拷貝至解壓后的rkllm_model目錄

3.編譯程序:進入解壓目錄,執行./build-linux.sh

4.通過adb工具傳輸文件到開發板

?傳輸依賴庫:

adb push lib/libgomp/libgomp.so /usr/lib/libgomp.so.1

adb push lib/librkllm_api/librkllmrt.so /usr/lib

?傳輸可執行文件和模型:adb push install/xscdeepseek_rkllm_demo/ /data

5. 開發板運行測試

5.1 前期準備

1.燒錄系統鏡像到rk3576開發板

2.配置swap分區(僅8+64G版本運行7b模型時需執行)

?創建10G swap文件:dd if=/dev/zero of=/userdata/swapfile bs=1M count=10240(執行較慢)

?設置權限:chmod 0600 /userdata/swapfile

?創建文件系統:mkswap /userdata/swapfile

?開啟分區:swapon /userdata/swapfile

?查看狀態:free -mh

5.2 運行測試(通用步驟)

1.登錄開發板:通過ssh連接(建議網線連接,減少冗余打印)

2.運行1.5b模型:

?cd /xsc_deepseek_rkllm_demo

?./xsc_deepseek_demo rkllm_model/deepseek-1.5b-w8a8-rk3576.rkllm 5000 5000

1.運行7b模型:

?cd /xsc_deepseek_rkllm_demo

?./xsc_deepseek_demo rkllm_model/deepseek-7b-w8a8-rk3576.rkllm 5000 5000

5.3 版本限制說明

?4+32G開發板:僅支持1.5b模型

?8+64G開發板:支持1.5b和7b模型,運行7b需配置swap分區

5.4實測截圖(2GB內存如何運行大模型?)

審核編輯 黃宇

-

開發板

+關注

關注

26文章

6161瀏覽量

114185 -

DeepSeek

+關注

關注

2文章

826瀏覽量

2861

發布評論請先 登錄

工業級全能選手!合眾恒躍 RK3576 開發板深度解析:多核架構 + 全接口覆蓋,適配多行業場景

基于米爾瑞芯微RK3576開發板的Qwen2-VL-3B模型NPU多模態部署評測

【幸狐Omni3576邊緣計算套件試用體驗】CPU部署DeekSeek-R1模型(1B和7B)

如何基于Android 14在i.MX95 EVK上運行Deepseek-R1-1.5B和性能

【幸狐Omni3576邊緣計算套件試用體驗】DeepSeek 部署及測試

ATK-DLRK3588開發板deepseek-r1-1.5b/7b部署指南

BQ3588/BQ3576系列開發板成功部署 DeepSeek-R1開發板

基于合眾恒躍rk3576?開發板deepseek-r1-1.5b/7b 部署指南

基于合眾恒躍rk3576?開發板deepseek-r1-1.5b/7b 部署指南

評論