日前,為了使 deepin 和 UOS AI 更加開放,我們正式開放了 UOS AI 的模型接入接口。這意味著,所有符合 OpenAI 接口格式的大模型,都可以無縫接入 UOS AI。大家可以根據自身需求,自由接入心儀的大模型,讓 UOS AI 成為更具個性化的智能伙伴。

在上一篇文章中,我們為大家詳細介紹了 UOS AI 如何離線或在線接入 DeepSeek-R1 模型。今天我們將進一步深入,為大家詳細講解如何借助 Ollama 在本地部署并運行 DeepSeek-R1 模型。

* 感謝社區用戶「Feelup」提供的教程,本次本地部署在 deepin 25 Preview 環境中通過Ollama 完成。

1

Ollama 部署

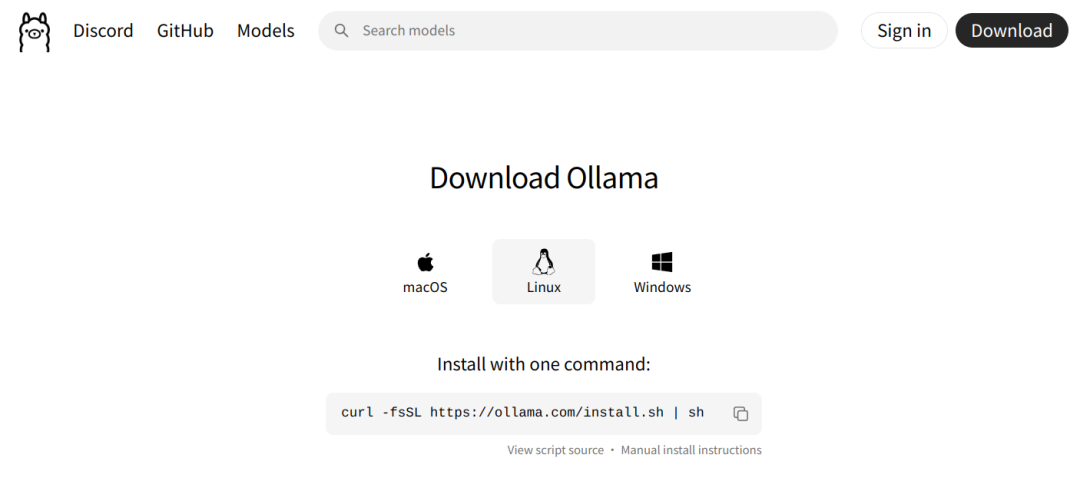

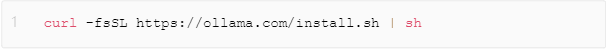

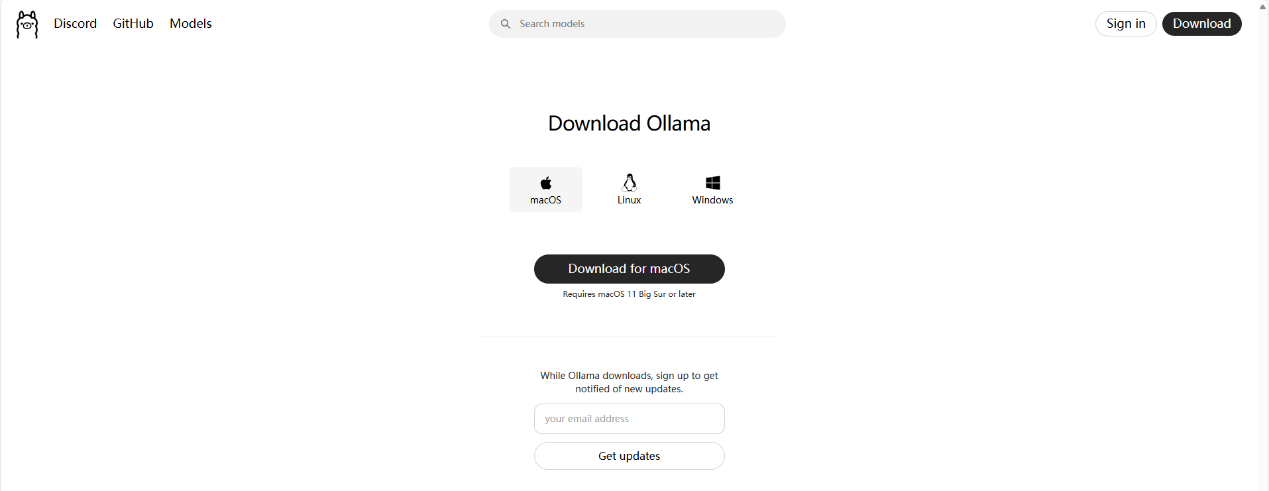

進入 Ollama 網站并復制 Linux 下需要使用的命令,并粘貼到終端中執行。

Ollama下載完成后,通過以下命令可查看當前 Ollama 版本

ollama --version

2

Ollama 服務配置

說明1:若您只希望簡單使用,可跳過此處服務配置。 說明2:此處 Ollama 服務配置主要調整了 Ollama 下載模型文件的保存位置和服務訪問限制調整。

sudo vim /etc/systemd/system/ollama.service默認的配置文件內容

[Unit] Description=Ollama Service After=network-online.target [Service] ExecStart=/usr/local/bin/ollama serve User=ollama Group=ollama Restart=always RestartSec=3 Environment="PATH=/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/usr/games:/usr/local/games:/snap/bin" [Install] WantedBy=default.target

非 deepin 25 服務修改參考

該 Ollama 服務配置適用于 Ubuntu、RedHat、deepin 23 等大多數 Linux 系統

[Unit] Description=Ollama Service After=network-online.target [Service] ExecStart=/usr/local/bin/ollama serve User=nano #此處為當前的用戶名(可選:如果調整了模型的下載保存位置的話,可解決權限問題) Group=nano #此處為當前的用戶名(可選:如果調整了模型的下載保存位置的話,可解決權限問題) Restart=always RestartSec=3 Environment="PATH=/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/usr/games:/usr/local/games:/snap/bin" Environment="OLLAMA_MODELS=/media/nano/Date/Ollama_Models" #可選:設置模型的下載位置 Environment="OLLAMA_HOST=0.0.0.0:11434" #可選:設置可訪問ollama服務的地址與端口(此處表示任意IP地址都可以從端口11434訪問此ollama服務) [Install] WantedBy=default.target

deepin 25 服務修改參考

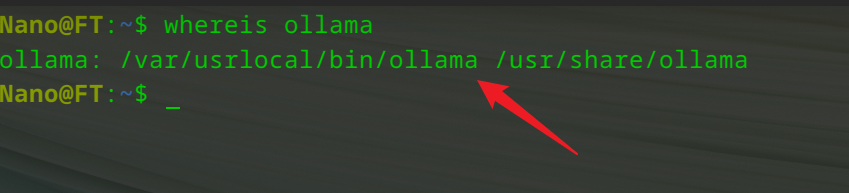

由于 deepin 25 采用了不可變系統設計,Ollama 安裝完成后,程序的執行文件位置出現了一些變化。

在進行 Ollama 服務配置時也需要做相應的修改(否則可能會出現服務運行異常)

[Unit] Description=Ollama Service After=network-online.target [Service] ExecStart=/var/usrlocal/bin/ollama serve #此處調整了ollama程序的位置 User=nano #此處為當前的用戶名(可選:如果調整了模型的下載保存位置的話,可解決權限問題) Group=nano #此處為當前的用戶名(可選:如果調整了模型的下載保存位置的話,可解決權限問題) Restart=always RestartSec=3 Environment="PATH=/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/usr/games:/usr/local/games:/snap/bin" Environment="OLLAMA_MODELS=/media/nano/Date/Ollama_Models" #可選:設置模型的下載位置 Environment="OLLAMA_HOST=0.0.0.0:11434" #可選:設置可訪問ollama服務的地址與端口(此處表示任意IP地址都可以從端口11434訪問此ollama服務) [Install] WantedBy=default.target

3

Ollama服務啟動

更新服務配置:

sudo systemctl daemon-reload重啟 Ollama 服務:

sudo systemctl restart ollama.service查看 Ollama 服務運行狀態:

systemctl status ollama.service

4

DeepSeek-R1模型下載

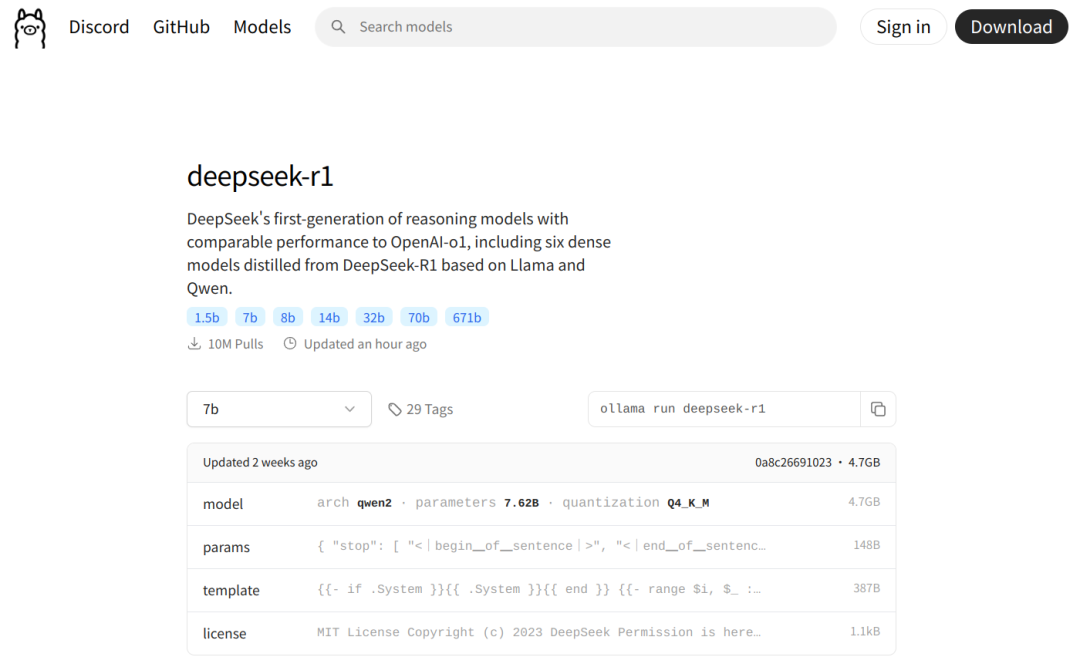

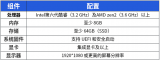

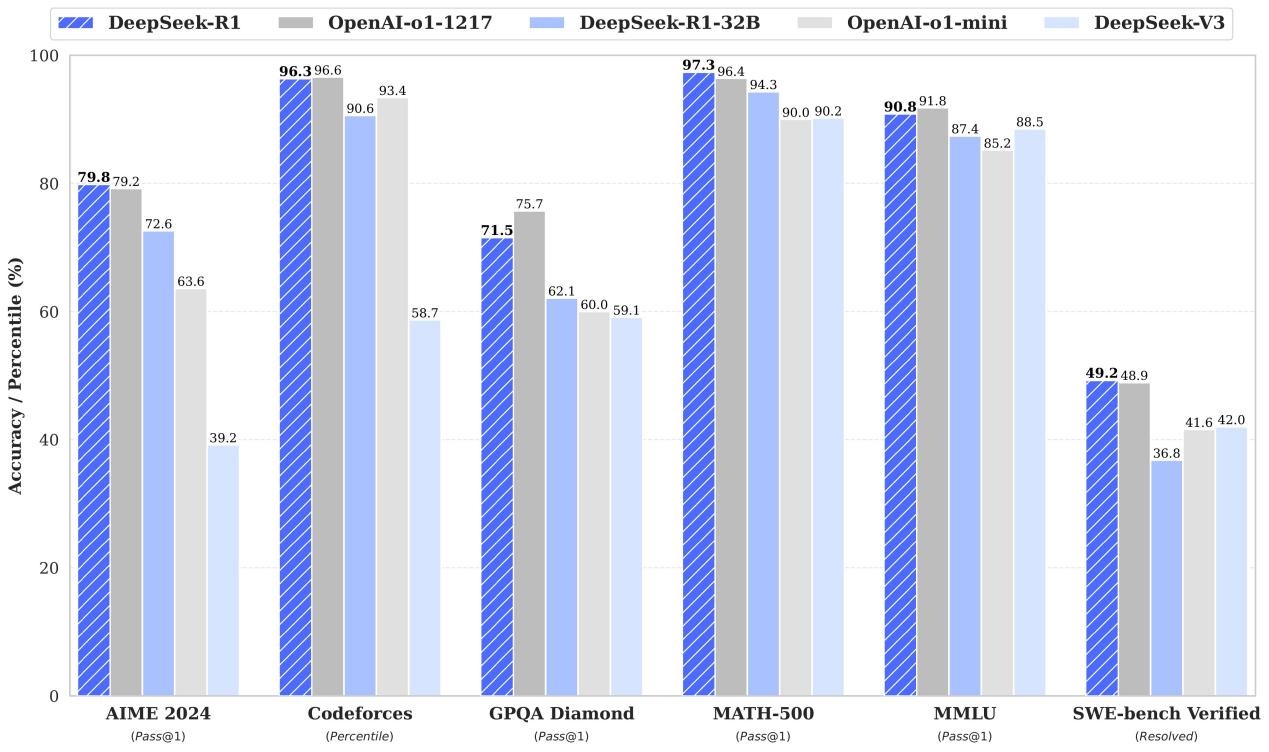

在 Ollama 站內檢索您所需要下載的模型名稱關鍵字,根據個人電腦配置選擇合適大小的參數模型,點擊復制模型下載命令,并將命令粘貼到終端中進行下載即可。

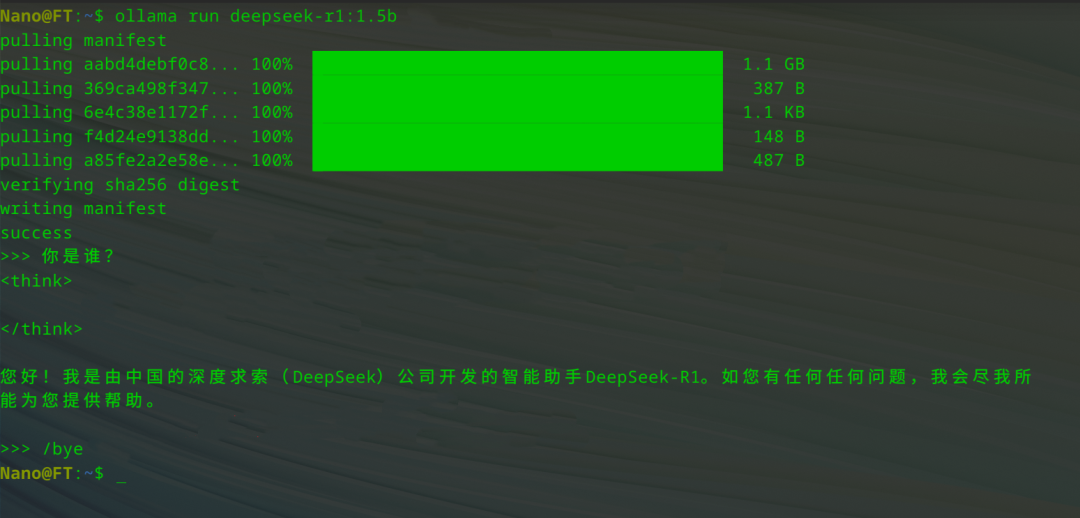

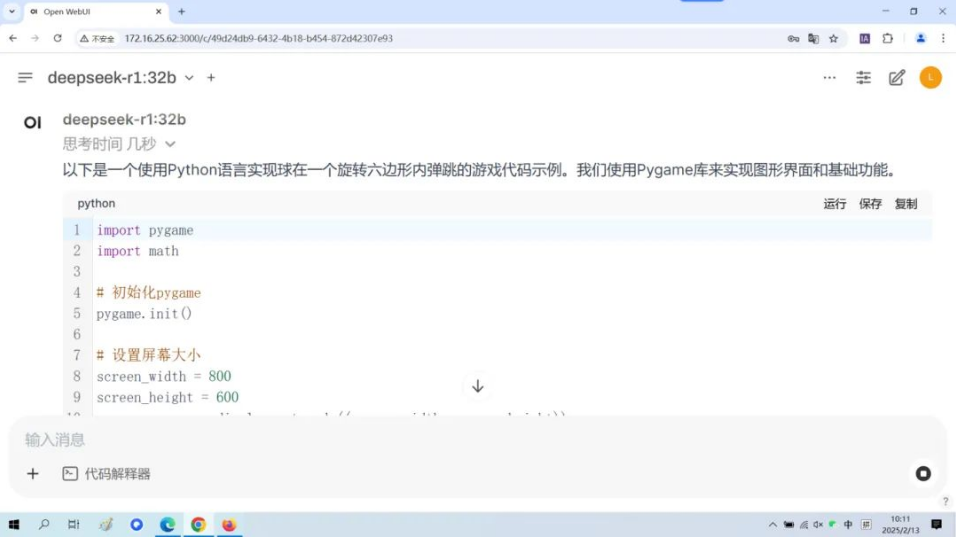

本例選擇下載 1.5b 參數量大小的模型,模型下載完成后將自動運行,此時可以使用如下命令在「終端」中與它進行對話:

ollama run deepseek-r1:1.5b下面是一個簡單的運行示例

5

在 UOS AI 中添加 DeepSeek-R1

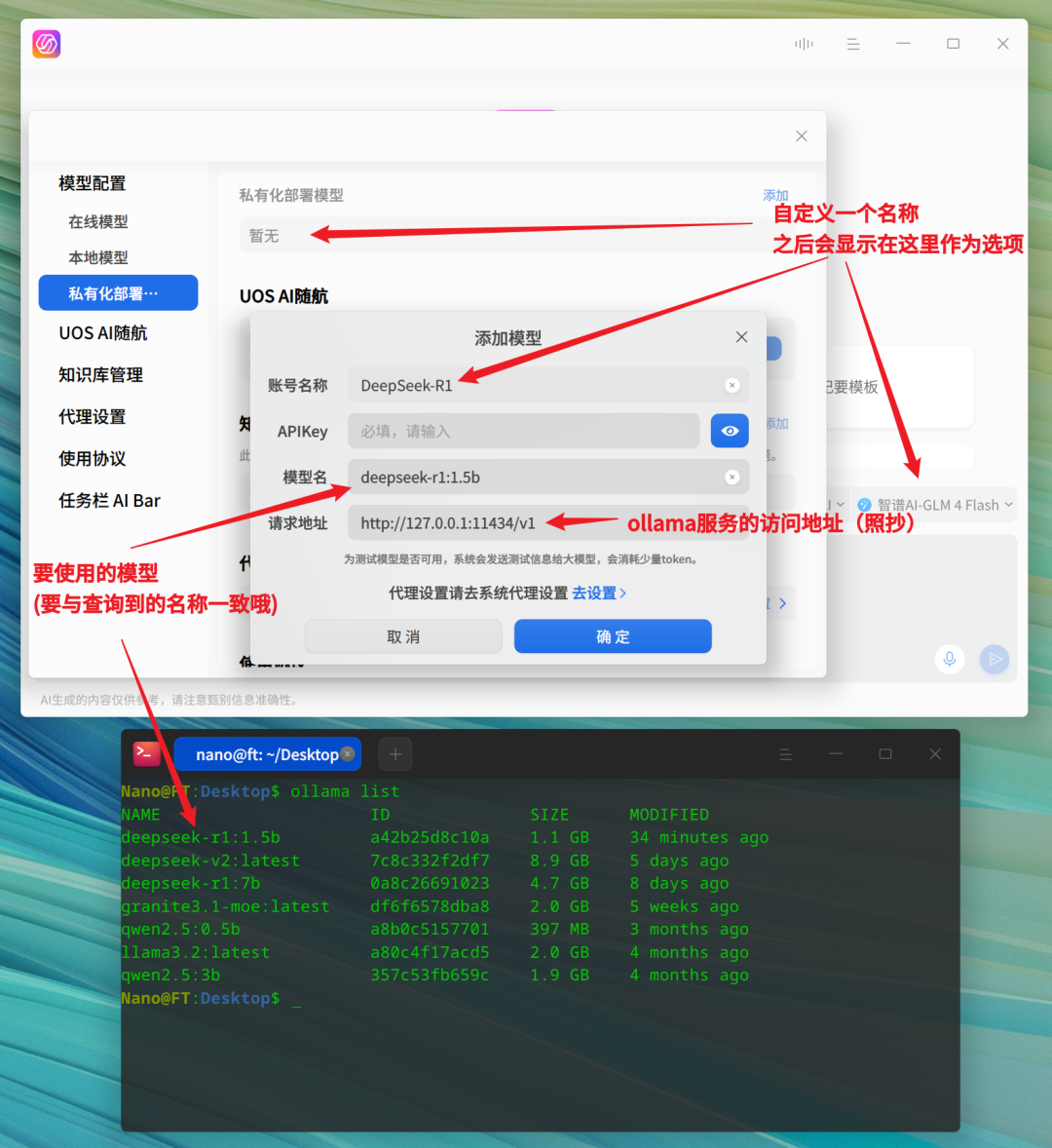

打開 UOS AI 的「設置」選項,在「模型配置」中選擇「私有化部署模型-添加」,進入 UOS AI 的模型添加界面。

完成添加窗口中的內容填寫,并點擊確定即可,本例中使用到的信息參考如下:

賬號名稱:DeepSeek-R1 模型名:deepseek-r1:1.5b 請求地址:http://127.0.0.1:11434/v1

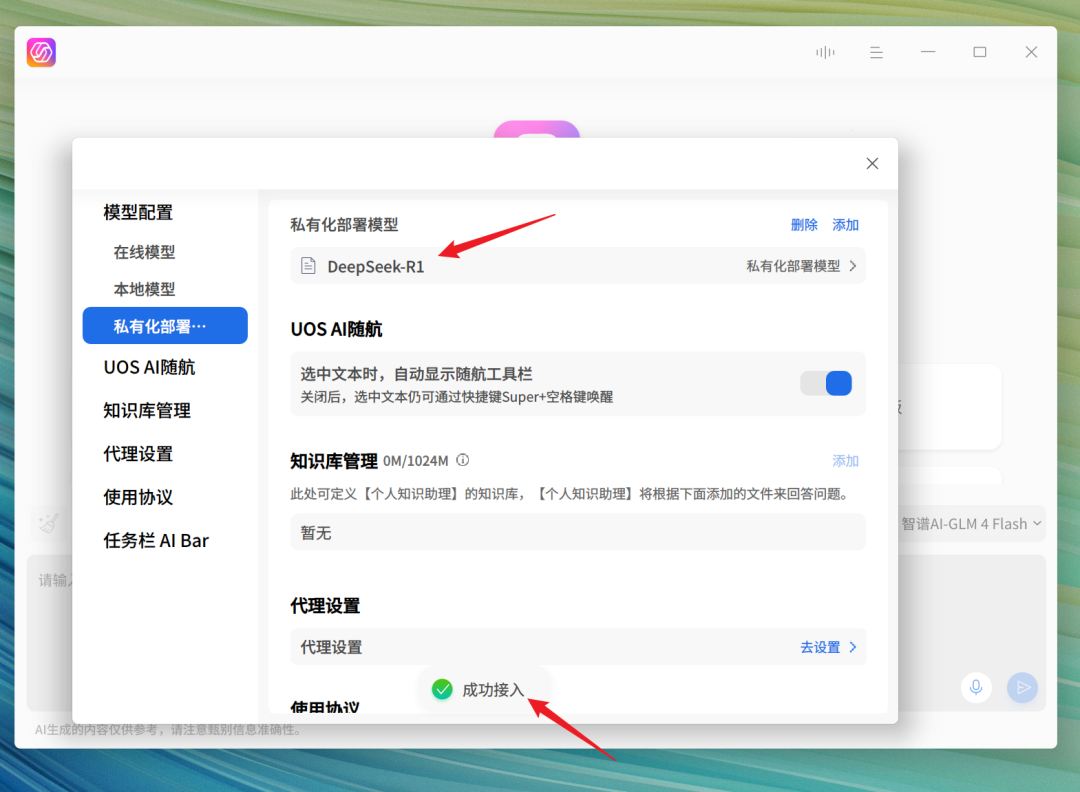

填寫完畢并提交確定后,程序會驗證對應的大模型是否可用,驗證成功后,DeepSeek-R1 便被添加至本地模型。

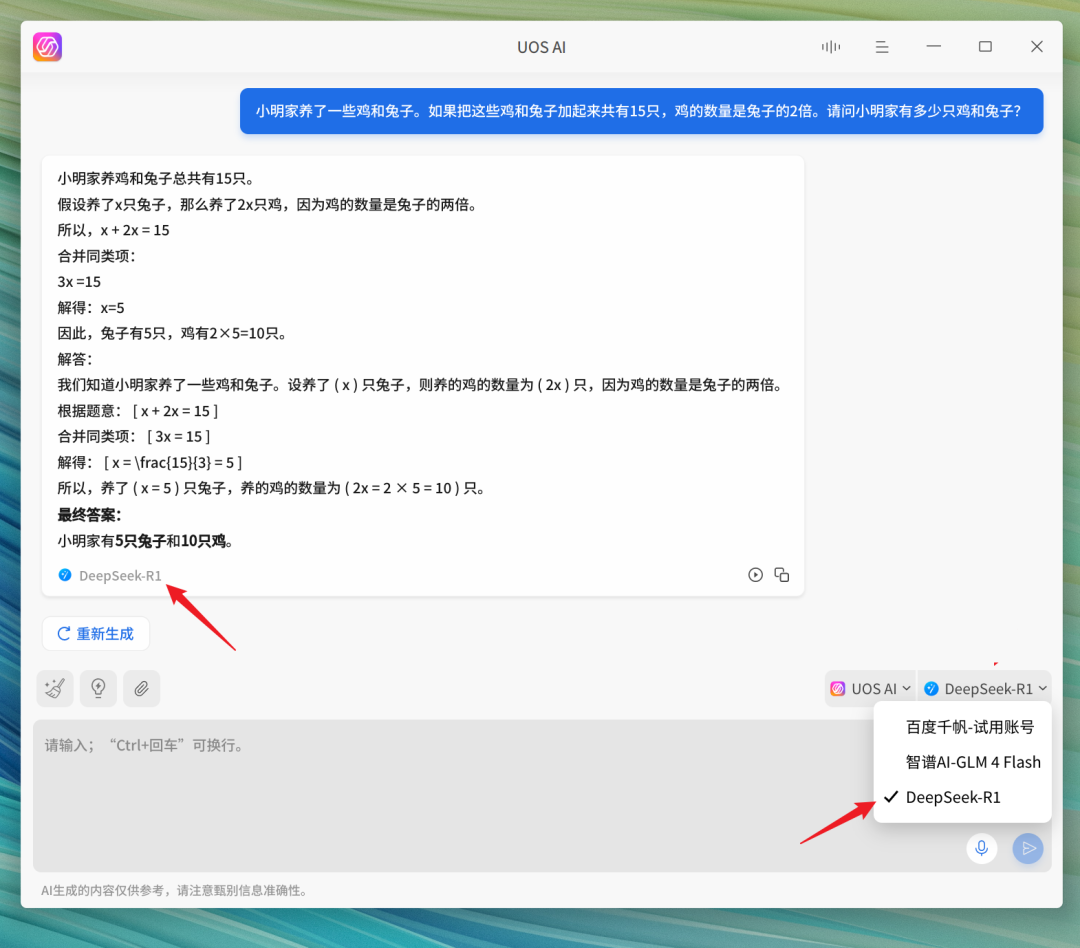

隨后即可在 UOS AI 中選擇 DeepSeek-R1 模型進行使用。

注:以上本地部署流程不僅僅適用于 DeepSeek-R1 模型,同樣也適用于其它模型的本地部署。

附錄:

[1]deepin UOS AI 離線、在線接入 DeepSeek-R1 教程 [2] deepin UOS AI 如何配置自定義模型

-

AI

+關注

關注

91文章

39755瀏覽量

301352 -

UOS系統

+關注

關注

0文章

11瀏覽量

2445 -

DeepSeek

+關注

關注

2文章

835瀏覽量

3255

原文標題:deepin 25 + DeepSeek-R1 + Ollama 本地搭建全流程

文章出處:【微信號:linux_deepin,微信公眾號:深度操作系統】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

本地部署openWebUI + ollama+DeepSeek 打造智能知識庫并實現遠程訪問

速看!EASY-EAI教你離線部署Deepseek R1大模型

【VisionFive 2單板計算機試用體驗】3、開源大語言模型部署

【幸狐Omni3576邊緣計算套件試用體驗】CPU部署DeekSeek-R1模型(1B和7B)

DeepSeek R1模型本地部署與產品接入實操

SL1680 SoC本地運行DeepSeek R1 1.5B大模型

博實結完成DeepSeek大模型本地化部署

如何在RakSmart服務器上用Linux系統部署DeepSeek

如何使用OpenVINO運行DeepSeek-R1蒸餾模型

在英特爾哪吒開發套件上部署DeepSeek-R1的實現方式

在MAC mini4上安裝Ollama、Chatbox及模型交互指南

deepin 25+DeepSeek-R1+Ollama本地搭建全流程

deepin 25+DeepSeek-R1+Ollama本地搭建全流程

評論