近日,隨著深度求索(DeepSeek)大模型的發(fā)布在行業(yè)內(nèi)掀起熱議,研華科技正式推出了基于昇騰Atlas平臺的邊緣AI Box MIC-ATL3S,并同步發(fā)布了與Deepseek R1模型的部署流程。這一舉措標(biāo)志著研華在AI邊緣計算領(lǐng)域邁出了重要一步。

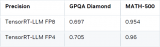

研華邊緣AI Box MIC-ATL3S依托昇騰芯片的強大異構(gòu)計算能力,結(jié)合研華在邊緣計算領(lǐng)域的高可靠特點,為用戶提供了高效、穩(wěn)定的AI解決方案。該平臺支持Deepseek R1等大模型的邊緣端部署,通過模型輕量化、算子適配等先進(jìn)技術(shù),有效降低了模型在邊緣端的運行門檻,提升了AI應(yīng)用的實時性和準(zhǔn)確性。

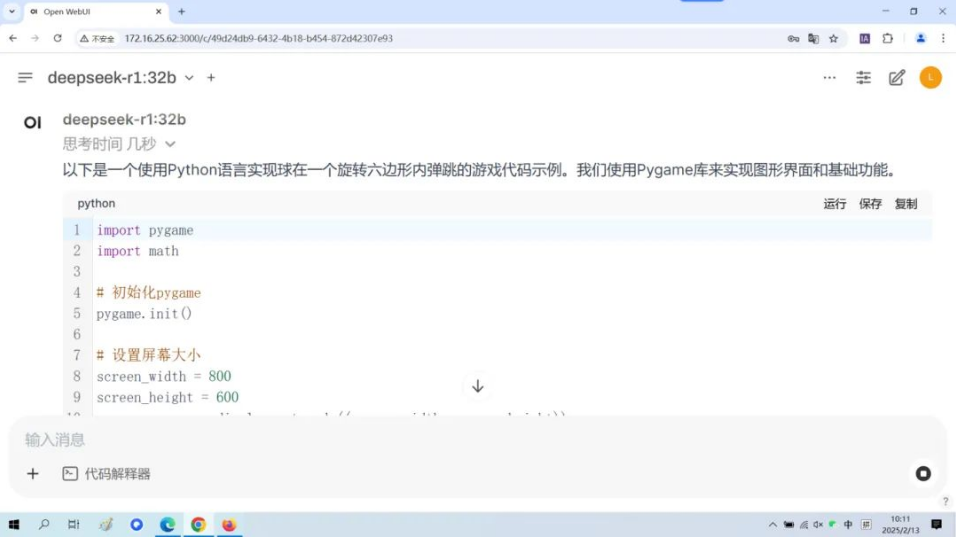

此次發(fā)布的Deepseek R1模型部署流程,為用戶提供了從模型準(zhǔn)備到邊緣端部署的全流程指導(dǎo),大大簡化了部署過程,降低了技術(shù)門檻。用戶只需按照流程操作,即可輕松實現(xiàn)Deepseek R1模型在研華邊緣AI Box上的高效運行。

未來,研華將繼續(xù)深耕AI邊緣計算領(lǐng)域,不斷探索和創(chuàng)新,為用戶提供更加優(yōu)質(zhì)、高效的AI解決方案,推動AI技術(shù)的廣泛應(yīng)用和發(fā)展。

-

模型

+關(guān)注

關(guān)注

1文章

3805瀏覽量

52232 -

研華

+關(guān)注

關(guān)注

0文章

458瀏覽量

40536 -

昇騰

+關(guān)注

關(guān)注

1文章

186瀏覽量

7530 -

DeepSeek

+關(guān)注

關(guān)注

2文章

837瀏覽量

3373

發(fā)布評論請先 登錄

【硬核發(fā)布】昇騰310B算力盒上新賦能2026集創(chuàng)賽華強x昇騰賽道玩轉(zhuǎn)新創(chuàng)意!

華為發(fā)布全新昇騰950PR,Atlas 350單卡算力接近3倍于H20

華為昇騰深度適配智譜AI全新開源模型GLM-5

香橙派昇騰系列開發(fā)板如何部署OpenClaw

國產(chǎn)AI芯片真能扛住“算力內(nèi)卷”?海思昇騰的這波操作藏了多少細(xì)節(jié)?

DeepSeek模型如何在云服務(wù)器上部署?

如何在NVIDIA Blackwell GPU上優(yōu)化DeepSeek R1吞吐量

【「DeepSeek 核心技術(shù)揭秘」閱讀體驗】書籍介紹+第一章讀后心得

DeepSeek開源新版R1 媲美OpenAI o3

【幸狐Omni3576邊緣計算套件試用體驗】CPU部署DeekSeek-R1模型(1B和7B)

DeepSeek R1模型本地部署與產(chǎn)品接入實操

SL1680 SoC本地運行DeepSeek R1 1.5B大模型

科大訊飛深度解析DeepSeek-V3/R1推理系統(tǒng)成本

研華發(fā)布昇騰AI Box及Deepseek R1模型部署流程

研華發(fā)布昇騰AI Box及Deepseek R1模型部署流程

評論