背景

AI大模型技術的持續(xù)進步正在推動千行百業(yè)智能化升級。近日,Meta、Microsoft相繼發(fā)布具有里程碑意義的Llama 3系列和Phi-3系列模型,其中Llama 3包括8B、70B兩種規(guī)格,Phi-3包括mini(3.8B)、small(7B)、medium(14B)三種規(guī)格。為了進一步給開發(fā)者提供更多嘗鮮,愛芯元智的NPU工具鏈團隊迅速響應,已基于AX650N平臺完成 Llama 3 8B和Phi-3-mini模型適配。

Llama 3

上周五,Meta發(fā)布了Meta Llama 3系列語言模型(LLM),具體包括一個8B模型和一個70B模型在測試基準中,Llama 3模型的表現相當出色,在實用性和安全性評估中,與那些市面上流行的閉源模型不相上下。

在架構層面,Llama 3選擇了標準的僅解碼(decoder-only)式Transformer架構,采用包含128K token詞匯表的分詞器。Llama 3使用了超過15T的公開數據進行訓練,其中5%為非英文數據,涵蓋30多種語言,訓練數據量是前代Llama 2的七倍。

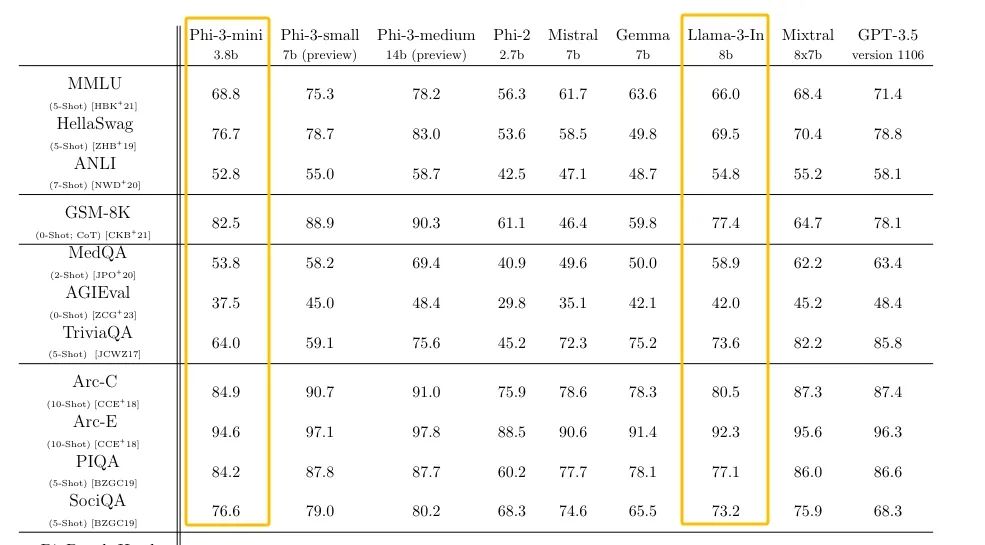

根據Meta的測試結果,Llama 3 8B模型在MMLU、GPQA、HumanEval等多項性能基準上均超過了Gemma 7B和Mistral 7B Instruct,70B模型則超越了名聲在外的閉源模型Claude 3的中間版本Sonnet,和谷歌的Gemini Pro 1.5相比三勝兩負。

實際上板結果

目前AX650N已經完成了Llama 3 8B Int8版本的適配,若采用Int4量化,每秒token數還能再翻一倍,能滿足正常的人機交流。

Phi-3

Llama 3剛發(fā)布沒多久,競爭對手就來了,而且是可以在手機上運行的小體量模型。

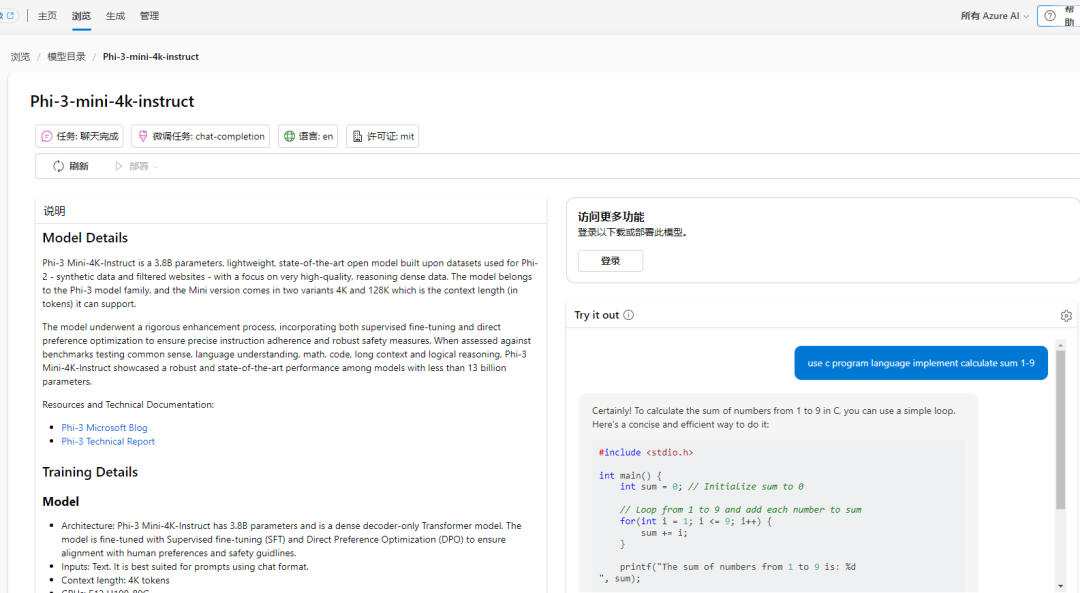

本周二,微軟發(fā)布了自研小尺寸模型Phi-3。盡管Phi-3-mini被優(yōu)化至可部署在手機上,但它的性能可以與Mixtral 8x7B和GPT-3.5等模型相媲美。微軟表示,該創(chuàng)新主要在于用了質量更好的訓練數據集。

實際上板結果

目前AX650N已經完成了Phi-3-mini Int8版本的適配,已能滿足正常的人機交流。

其他成果

AX650N能第一時間完成Llama 3和Phi-3的適配,源于今年以來相關團隊悄悄完成了現有NPU工具鏈針對大語言模型的支持和調優(yōu)。目前除了Llama 3之外,已經完成了Llama 2、TinyLlama、Phi-2、Qwen1.5、ChatGLM3等國內外主流的開源大語言模型適配。

審核編輯:劉清

-

NPU

+關注

關注

2文章

373瀏覽量

21101 -

愛芯元智

+關注

關注

1文章

128瀏覽量

5514 -

LLM

+關注

關注

1文章

346瀏覽量

1332 -

AI大模型

+關注

關注

0文章

398瀏覽量

999

原文標題:愛芯通元NPU完成Llama 3和Phi-3大模型適配,推動AI大模型技術應用普及

文章出處:【微信號:愛芯元智AXERA,微信公眾號:愛芯元智AXERA】歡迎添加關注!文章轉載請注明出處。

發(fā)布評論請先 登錄

愛芯元智邊緣AI芯片AX8850完成CosyVoice2大模型適配

【CIE全國RISC-V創(chuàng)新應用大賽】基于 K1 AI CPU 的大模型部署落地

愛芯元智邊緣AI芯片AX8850完成Qwen3-VL多模態(tài)大模型適配

愛芯元智亮相2025全球AI芯片峰會

基于米爾瑞芯微RK3576開發(fā)板的Qwen2-VL-3B模型NPU多模態(tài)部署評測

硬件與應用同頻共振,英特爾Day 0適配騰訊開源混元大模型

愛芯通元NPU完成Llama 3和Phi-3大模型適配,推動AI大模型技術普及

愛芯通元NPU完成Llama 3和Phi-3大模型適配,推動AI大模型技術普及

評論