0 TL;DR

已適配 Qwen3-VL-2B/4B/8B 到 AX8850 開發板和 M.2 算力卡,可在本地完成圖片內容理解和視頻概要生成,可配合“樹莓派5”使用;

預編譯示例已開源(GitHub & HuggingFace),附帶簡易 Gradio 演示界面,方便示例快速測試;

嘗試提供兼容 OpenAI API 的服務,降低已有云端大模型業務快速遷移到本地;

最快響應延時<0.5 秒;

M.2 板卡功耗<8 w,支持被動散熱,工業應用場景更可靠穩定。

| 模型 | 圖片編碼 | TTFT | 生成速度 |

| Qwen3-VL-2B | 130 ms | 320 ms | 14.1tokens/s |

| Qwen3-VL-4B | 130 ms | 670 ms | 7.2tokens/s |

| 模型 | 視頻編碼(8幀) | TTFT | 生成速度 |

| Qwen3-VL-2B | 460 ms | 840 ms | 14.1tokens/s |

| Qwen3-VL-4B | 460 ms | 1880 ms | 7.2tokens/s |

背景

今年下半年,隨著業務推廣需求增加,我們的大模型適配工作也有了新方向:不再只追求前沿模型的快速適配,而是更聚焦為銷售團隊提供“能打”的實戰“彈藥”——也就是貼近客戶剛需的、可快速落地的大模型解決方案。

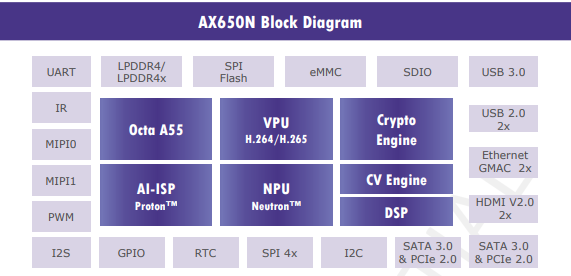

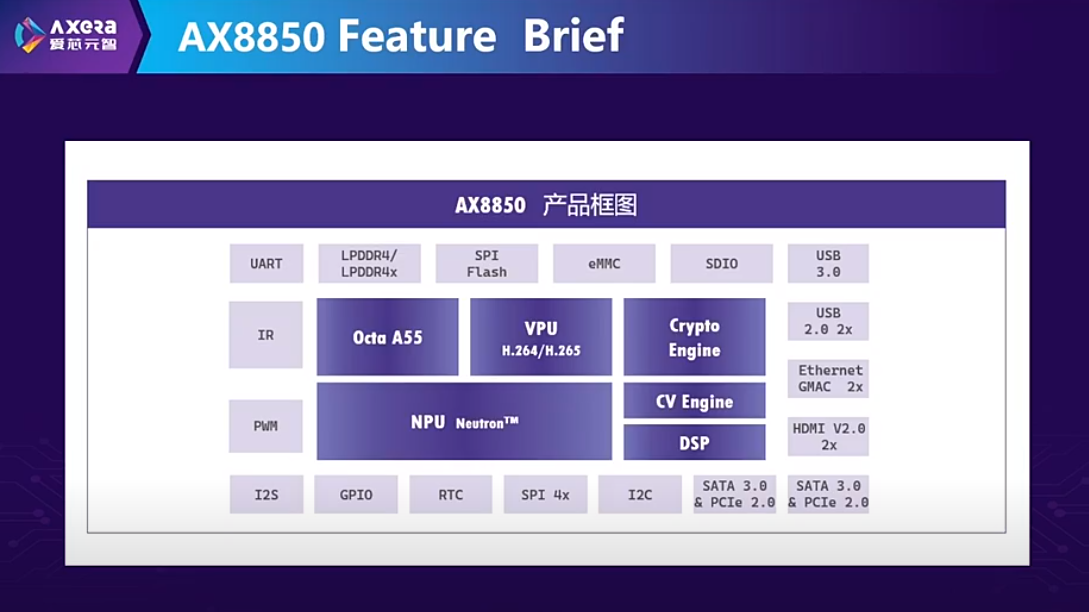

因此,接下來的技術分享會更聚焦在基于我司邊緣 AI 芯片(如AX8850)的實際應用落地,幫助客戶實現從 Demo 到量產的跨越。

其中一個重點場景就是:視頻事件分析。

目前很多視頻分析產品采用類似 CLIP 模型,已經能做到快速的單幀事件實時分析,但是對于時序性較高的場景支持并不太好。而通過多模態大語言模型,正好可以關聯相鄰幀的在時間軸上的語義特征信息,能夠進一步對某些持續性的事件進行理解和輸出。

最近 Qwen3-VL 開源了稠密小參數量的模型 Qwen3-VL-2B、Qwen3-VL-4B,從公開的 Benchmark 上看相比上一個版本 Qwen2.5-VL 系列有明顯的“跑分”優勢。我們已完成相關模型的適配,希望對關注端側多模態大模型部署實現離線視頻分析的開發者提供一種新的解題思路。

Qwen3-VL

Qwen3-VL 是阿里巴巴通義千問團隊于 2025 年 9 月 24 日 發布的最新一代多模態視覺語言模型(Vision-Language Model, VLM),是 Qwen 系列中目前性能最強、能力最全面的開源視覺語言模型。其整體能力接近甚至在多項指標上超越 Gemini 2.5 Pro 和 GPT-5,并在 32 項核心能力測評中刷新開源模型紀錄。

這一代模型實現了全方位的全面升級:更強的文本理解與生成能力、更深入的視覺感知與推理能力、更長的上下文長度、更出色的時空與視頻動態理解能力,以及更強大的智能體交互能力。

Huggingface 鏈接:

https://huggingface.co/Qwen/Qwen3-VL-2B-Instruct

Paper 鏈接:

https://huggingface.co/papers/2505.09388

在線 Demo:

https://huggingface.co/spaces/akhaliq/Qwen3-VL-2B-Instruct

主要特性:

視覺智能體(Visual Agent):可操作 PC/手機圖形用戶界面(GUI)——識別界面元素、理解功能、調用工具并完成任務;

視覺編程增強(Visual Coding Boost):可直接根據圖像或視頻生成 Draw.io 流程圖、HTML/CSS/JS 代碼;

高級空間感知(Advanced Spatial Perception):能判斷物體位置、視角與遮擋關系;提供更強的 2D 定位能力,并支持 3D 定位,為復雜空間推理和具身智能(embodied AI)奠定基礎;

長上下文與視頻理解(Long Context & Video Understanding):原生支持 256K 上下文長度,可擴展至 1M;能夠完整記憶并實現秒級索引,輕松處理整本書籍或數小時長的視頻內容;

增強的多模態推理(Enhanced Multimodal Reasoning):在 STEM/數學等領域表現卓越——擅長因果分析,能給出邏輯嚴謹、基于證據的回答;

升級的視覺識別能力(Upgraded Visual Recognition):通過更廣泛、更高品質的預訓練,真正做到“萬物皆可識”——涵蓋名人、動漫角色、商品、地標、動植物等豐富類別;

擴展的 OCR 能力(Expanded OCR):支持語言從 19 種提升至 32 種;在弱光、模糊、傾斜等復雜條件下依然穩健;對罕見字、古文字及專業術語識別更準確;同時顯著提升了對長文檔結構的解析能力;

媲美純文本大模型的文本理解能力(Text Understanding on par with pure LLMs):實現文本與視覺信息的無縫融合,達成無損、統一的理解體驗。

模型架構更新

Interleaved-MRoPE:通過魯棒的位置嵌入,在時間、寬度和高度維度上實現全頻段分配,從而增強長時程視頻推理能力;

DeepStack:融合多層級 ViT 特征,以捕捉細粒度細節并強化圖像與文本的對齊效果;

文本–時間戳對齊:超越 T-RoPE,實現精確的、基于時間戳的事件定位,從而提升視頻時序建模能力。

Benchmark

部署示例

為了更好的進行開發者社區技術推廣,因此我們將借助國內外非常成熟的樹莓派生態產品:樹莓派 5+AXCL 算力卡的形態進行說明。基于 AX8850 的社區開發板同樣也支持部署該實例,本文就不單獨說明了。

默認本文的閱讀者能自行解決訪問 Huggingface 的辦法。

硬件推薦

樹莓派 5 + LLM8850-Card

樹莓派 5 + Maix4-HAT

軟件步驟

默認已按照硬件產品的指導文檔完成了硬件及必要的軟件驅動安裝(例如 AXCL 驅動包)。預編譯好的模型和示例已經上傳到 huggingface(或者 hf-mirror)。

https://huggingface.co/AXERA-TECH/Qwen3-VL-2B-Instruct-GPTQ-Int4

如何將原始的模型轉換成 axmodel 并部署,請參考我們的 GitHub 倉庫。

https://github.com/AXERA-TECH/ax-llm/tree/ax-qwen3-vl

(友情提示:除非對該模型有 finetuning 需求的同學,否則我建議一開始不要浪費時間來學習該模型的轉換或者示例代碼的編譯,因為過程比較復雜┓( ′?` )┏)

安裝依賴

請務必完整閱讀 Readme

//代碼開始

cdAXERA-TECH/Qwen3-VL-2B-Instruct-GPTQ-Int4 pipinstall -r requirements.txt

//代碼結束

運行示例

這里我們選擇基于 Gradio WebGUI 的方案

運行 tokenizer 服務

//代碼開始

pythonqwen3_tokenizer.py --port12345--host0.0.0.0

//代碼結束

運行兼容 openai api 的大模型推理服務

//代碼開始

# for axcl, such as RaspberryPi5 + M.2 Card or x86 + M.2 Card ./run_axcl_api.sh # for ax8850 ./run_ax_api.sh

//代碼結束

運行 gradio 腳本

//代碼開始

pythongradio_demo.py

//代碼結束

通過 web 瀏覽器訪問

視頻理解示例

總結

隨著 Qwen3-VL-2B 多模態大模型完成開源發布,多模態大模型在端側落地已成事實。在 NAS、NVR 的智能升級改造過程中,必將成為基礎模型。

-

AI芯片

+關注

關注

17文章

2135瀏覽量

36815 -

OpenAI

+關注

關注

9文章

1245瀏覽量

10194 -

愛芯元智

+關注

關注

1文章

131瀏覽量

5547 -

大模型

+關注

關注

2文章

3687瀏覽量

5213

原文標題:愛芯分享 | AX8850完成Qwen3-VL適配

文章出處:【微信號:愛芯元智AXERA,微信公眾號:愛芯元智AXERA】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

愛芯元智邊緣AI芯片AX8850完成CosyVoice2大模型適配

基于米爾瑞芯微RK3576開發板的Qwen2-VL-3B模型NPU多模態部署評測

愛芯元智發布邊緣智能芯片AX8850

新品 | LLM-8850 Card, AX8850邊緣設備AI加速卡

愛芯元智攜手合作伙伴M5Stack亮相YOLO Vision 2025

太初元碁:40+AI大模型全覆蓋,新版本即發即適配、上線即可用,實現國產“芯”速度

愛芯元智邊緣SoC AX8850亮相MWC 2026

愛芯元智邊緣AI芯片AX8850完成Qwen3-VL多模態大模型適配

愛芯元智邊緣AI芯片AX8850完成Qwen3-VL多模態大模型適配

評論