由清華技術成果轉化的公司智譜 AI 宣布開源了 GLM 系列模型的新成員 ——中英雙語對話模型 ChatGLM-6B,支持在單張消費級顯卡上進行推理使用。這是繼此前開源 GLM-130B 千億基座模型之后,智譜 AI 再次推出大模型方向的研究成果。

此外,基于千億基座的 ChatGLM 線上模型目前也在 chatglm.cn 進行邀請制內測,用戶需要使用邀請碼進行注冊,也可以填寫基本信息申請內測。

根據介紹,ChatGLM-6B 是一個開源的、支持中英雙語問答的對話語言模型,并針對中文進行了優化。該模型基于 General Language Model (GLM)架構,具有 62 億參數。結合模型量化技術,用戶可以在消費級的顯卡上進行本地部署(INT4 量化級別下最低只需 6GB 顯存)。

ChatGLM-6B 使用了和 ChatGLM 相同的技術,針對中文問答和對話進行了優化。經過約 1T 標識符的中英雙語訓練,輔以監督微調、反饋自助、人類反饋強化學習等技術的加持,62 億參數的 ChatGLM-6B 雖然規模不及千億模型,但大大降低了推理成本,提升了效率,并且已經能生成相當符合人類偏好的回答。

ChatGLM-6B 具備以下特點:

充分的中英雙語預訓練:ChatGLM-6B 在 1:1 比例的中英語料上訓練了 1T 的 token 量,兼具雙語能力。

優化的模型架構和大小:吸取 GLM-130B 訓練經驗,修正了二維 RoPE 位置編碼實現,使用傳統 FFN 結構。6B(62 億)的參數大小,也使得研究者和個人開發者自己微調和部署 ChatGLM-6B 成為可能。

較低的部署門檻:FP16 半精度下,ChatGLM-6B 需要至少 13 GB 的顯存進行推理,結合模型量化技術,這一需求可以進一步降低到 10GB(INT8) 和 6GB(INT4),使得 ChatGLM-6B 可以部署在消費級顯卡上。

更長的序列長度:相比 GLM-10B(序列長度 1024),ChatGLM-6B 序列長度達 2048,支持更長對話和應用。

人類意圖對齊訓練:使用了監督微調(Supervised Fine-Tuning)、反饋自助(Feedback Bootstrap)、人類反饋強化學習(Reinforcement Learning from Human Feedback)等方式,使模型初具理解人類指令意圖的能力。輸出格式為 markdown,方便展示。

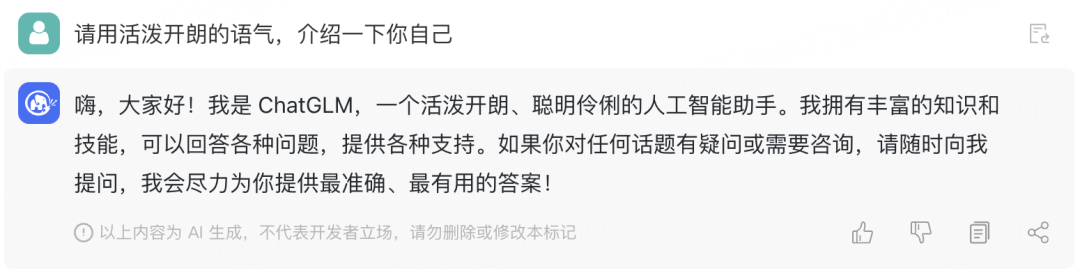

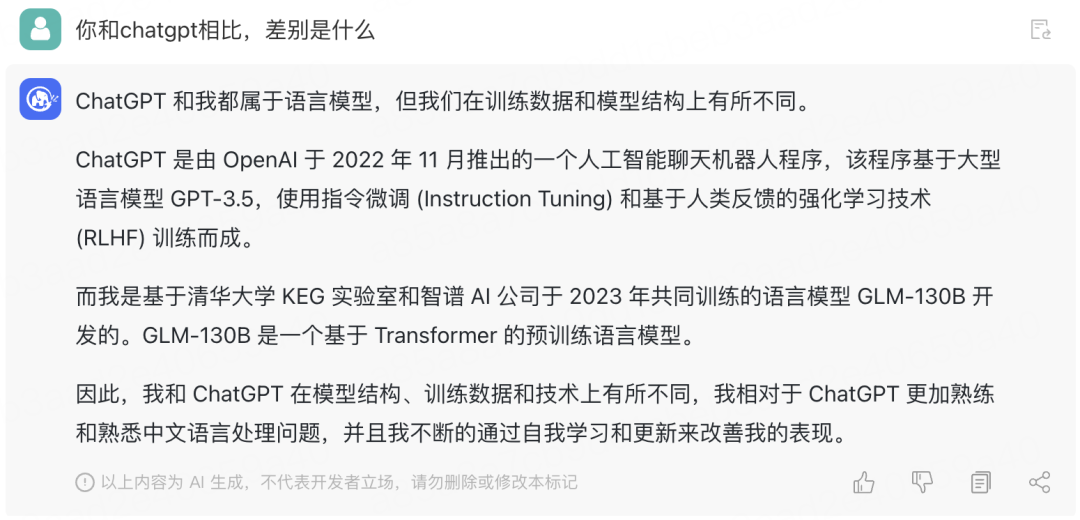

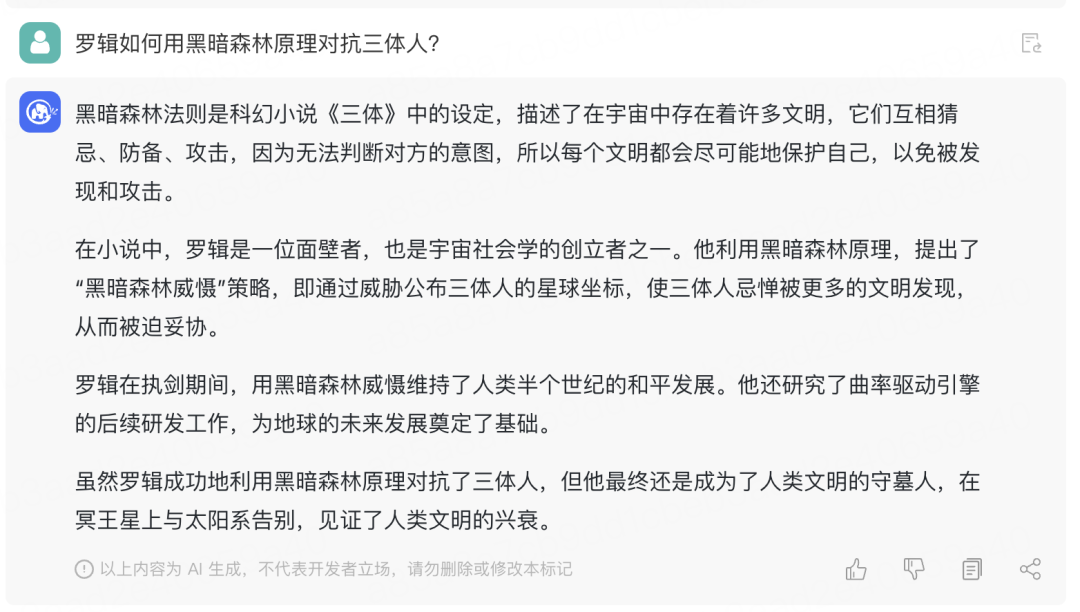

基于以上特點,ChatGLM-6B 在一定條件下具備較好的對話與問答能力。ChatGLM-6B 的對話效果展示如下:

不過由于 ChatGLM-6B 模型的容量較小,不可避免地存在一些局限和不足,包括:

相對較弱的模型記憶和語言能力。在面對許多事實性知識任務時,ChatGLM-6B 可能會生成不正確的信息,也不太擅長邏輯類問題(如數學、編程)的解答。

可能會產生有害說明或有偏見的內容:ChatGLM-6B 只是一個初步與人類意圖對齊的語言模型,可能會生成有害、有偏見的內容。

較弱的多輪對話能力:ChatGLM-6B 的上下文理解能力還不夠充分,在面對長答案生成和多輪對話的場景時,可能會出現上下文丟失和理解錯誤的情況。

相比起 ChatGLM-6B,ChatGLM 參考了 ChatGPT 的設計思路,在千億基座模型 GLM-130B 中注入了代碼預訓練,通過有監督微調(Supervised Fine-Tuning)等技術實現人類意圖對齊。ChatGLM 線上模型的能力提升主要來源于獨特的千億基座模型 GLM-130B。它采用了不同于 BERT、GPT-3 以及 T5 的 GLM 架構,是一個包含多目標函數的自回歸預訓練模型。

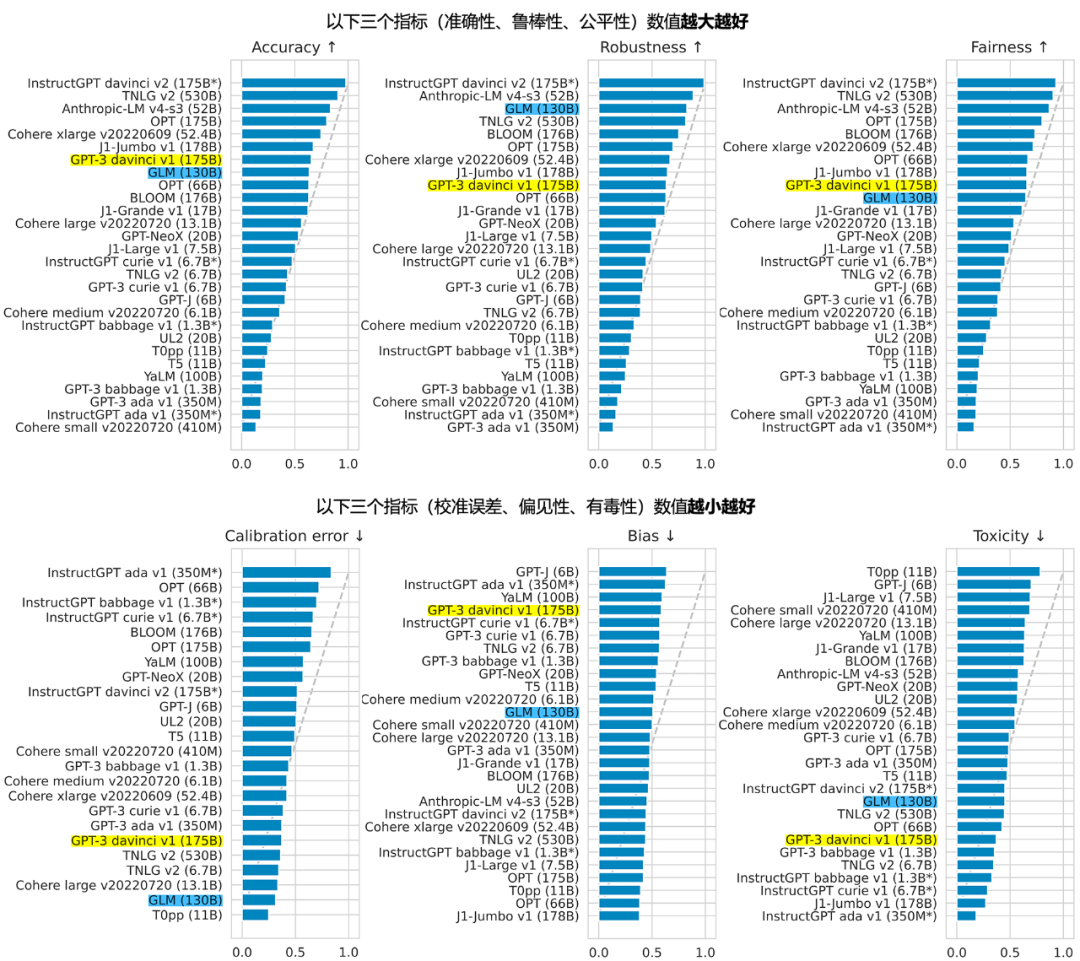

GLM 團隊表示,2022 年 11 月,斯坦福大學大模型中心對全球 30 個主流大模型進行了全方位的評測,GLM-130B 是亞洲唯一入選的大模型。在與 OpenAI、Google Brain、微軟、英偉達、Meta AI 的各大模型對比中,評測報告顯示 GLM-130B 在準確性和公平性指標上與 GPT-3 175B (davinci) 接近或持平,魯棒性、校準誤差和無偏性則優于 GPT-3 175B。

由 ChatGLM 生成的對話效果展示:

不過 GLM 團隊也坦言,整體來說 ChatGLM 距離國際頂尖大模型研究和產品(比如 OpenAI 的 ChatGPT 及下一代 GPT 模型)還存在一定的差距。該團隊表示,將持續研發并開源更新版本的 ChatGLM 和相關模型。“歡迎大家下載 ChatGLM-6B,基于它進行研究和(非商用)應用開發。GLM 團隊希望能和開源社區研究者和開發者一起,推動大模型研究和應用在中國的發展。”

審核編輯 :李倩

-

AI

+關注

關注

91文章

39793瀏覽量

301427 -

模型

+關注

關注

1文章

3752瀏覽量

52111

原文標題:清華系千億基座對話模型ChatGLM開啟內測,單卡版模型已全面開源

文章出處:【微信號:OSC開源社區,微信公眾號:OSC開源社區】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

清華大學電子工程系“無問錫東3.0”實踐支隊走進沐曦股份

地平線正式開源HoloBrain VLA基座模型

燧原科技訓推一體芯片L600適配階躍星辰基座模型Step 3.5 Flash

壁仞科技壁礪166系列產品適配階躍星辰基座模型Step 3.5 Flash

沐曦曦云C600 GPU產品適配階躍星辰基座模型Step 3.5 Flash

清華大學“啟·創”計劃走進拓維信息,校企共探AI時代產學研合作新范式

海康威視亮相第三屆清華質量強國論壇

廣和通發布端側情感對話大模型FiboEmo-LLM

【內測活動同步開啟】這么小?這么強?新一代大模型MCP開發板來啦!

米爾RK3576部署端側多模態多輪對話,6TOPS算力驅動30億參數LLM

清華大學TOP EE+項目參訪美光上海

輕量通信+重磅智能,利爾達全新Cat.1+AI大模型方案讓對話從此無界!

清華系千億基座對話模型ChatGLM開啟內測

清華系千億基座對話模型ChatGLM開啟內測

評論