新晉圖像生成王者擴(kuò)散模型,剛剛誕生沒(méi)多久。

有關(guān)它的理論和實(shí)踐都還在“野蠻生長(zhǎng)”。

來(lái)自英偉達(dá)StyleGAN的原班作者們站了出來(lái),嘗試給出了一些設(shè)計(jì)擴(kuò)散模型的竅門和準(zhǔn)則,結(jié)果模型的質(zhì)量和效率都有所改進(jìn),比如將現(xiàn)有ImageNet-64模型的FID分?jǐn)?shù)從2.07提高到接近SOTA的1.55分。

他們這一工作成果迅速得到了業(yè)界大佬的認(rèn)同。

DeepMind研究員就稱贊道:這篇論文簡(jiǎn)直就是訓(xùn)練擴(kuò)散模型的人必看,妥妥的一座金礦。

三大貢獻(xiàn)顯著提高模型質(zhì)量和效率

我們從以下幾個(gè)方面來(lái)看StyleGAN作者們對(duì)擴(kuò)散模型所做的三大貢獻(xiàn):

用通用框架表示擴(kuò)散模型

在這部分,作者的貢獻(xiàn)主要為從實(shí)踐的角度觀察模型背后的理論,重點(diǎn)關(guān)注出現(xiàn)在訓(xùn)練和采樣階段的“有形”對(duì)象和算法,更好地了解了組件是如何連接在一起的,以及它們?cè)谡麄€(gè)系統(tǒng)的設(shè)計(jì)中可以使用的自由度(degrees of freedom)。

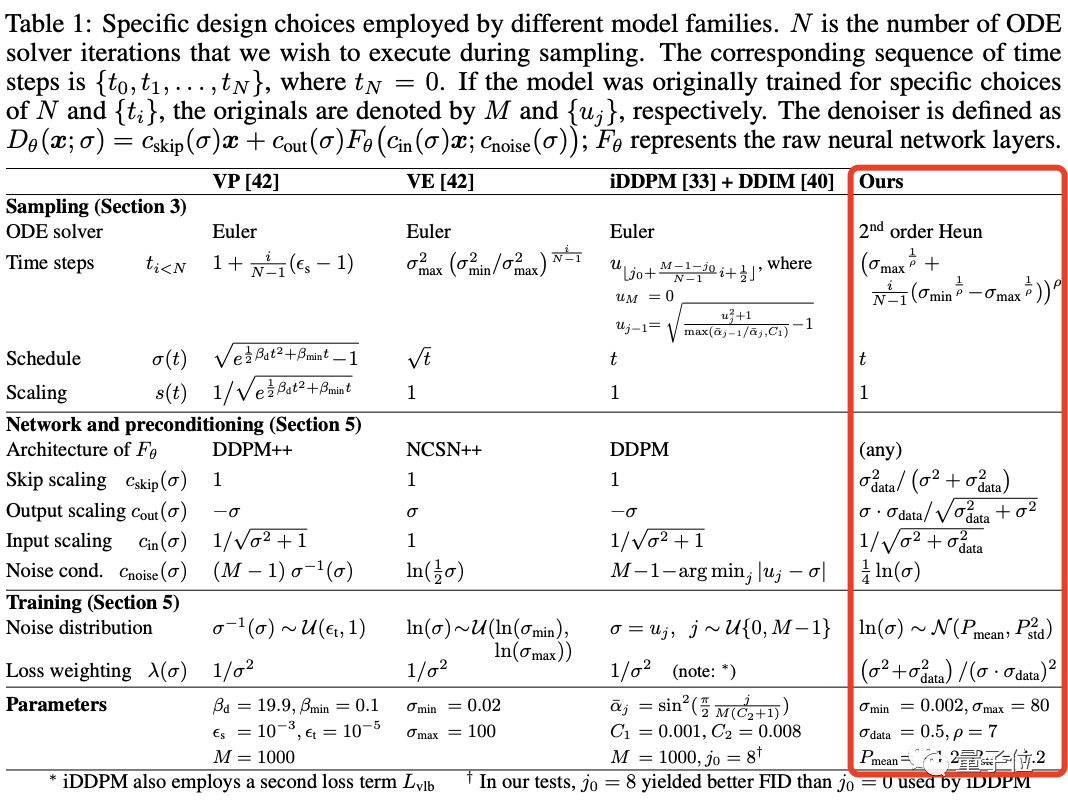

精華就是下面這張表:

該表給出了在他們的框架中復(fù)現(xiàn)三種模型的確定變體的公式。

(這三種方法(VP、VE、iDDPM+ DDIM)不僅被廣泛使用且實(shí)現(xiàn)了SOTA性能,還來(lái)自不同的理論基礎(chǔ)。)

這些公式讓組件之間原則上沒(méi)有隱含的依賴關(guān)系,在合理范圍內(nèi)選擇任意單個(gè)公示都可以得出一個(gè)功能模型。

隨機(jī)采樣和確定性采樣的改進(jìn)

作者的第二組貢獻(xiàn)涉及擴(kuò)散模型合成圖像的采樣過(guò)程。

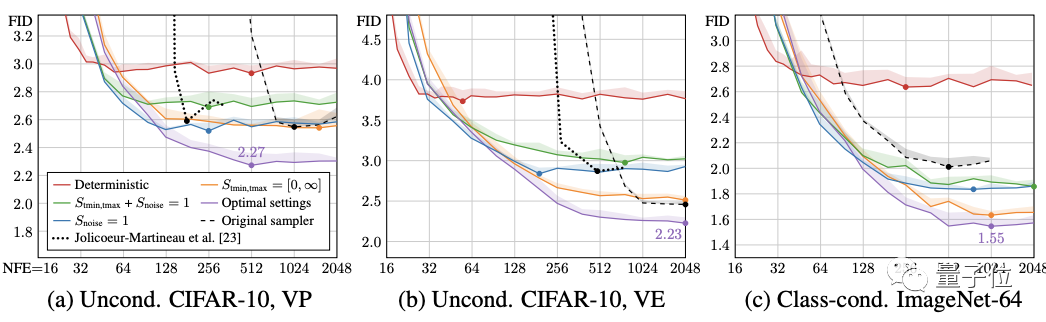

他們確定了最佳的時(shí)間離散化(time discretization),對(duì)采樣過(guò)程應(yīng)用了更高階的Runge–Kutta方法,并在三個(gè)預(yù)訓(xùn)練模型上評(píng)估不同的方法,分析了隨機(jī)性在采樣過(guò)程中的有用性。

結(jié)果在合成過(guò)程中所需的采樣步驟數(shù)量顯著減少,改進(jìn)的采樣器可以用作幾個(gè)廣泛使用的擴(kuò)散模型的直接替代品。

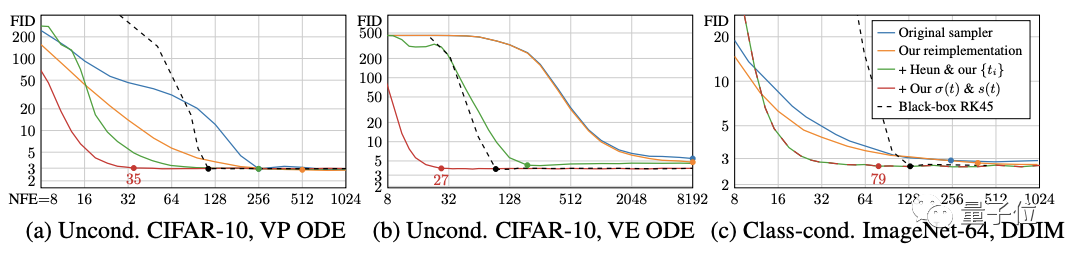

先看確定性采樣。用到的三個(gè)測(cè)試模型還是上面的那三個(gè),來(lái)自不同的理論框架和模型族。

作者首先使用原始的采樣器(sampler)實(shí)現(xiàn)測(cè)量這些模型的基線結(jié)果,然后使用表1中的公式將這些采樣方法引入他們的統(tǒng)一框架,再進(jìn)行改進(jìn)。

接著根據(jù)在50000張生成圖像和所有可用真實(shí)圖像之間計(jì)算的FID分?jǐn)?shù)來(lái)評(píng)估質(zhì)量。

可以看到,原始的的確定性采樣器以藍(lán)色顯示,在他們的統(tǒng)一框架(橙色)中重新實(shí)現(xiàn)這些方法會(huì)產(chǎn)生類似或更好的結(jié)果。

作者解釋,這些差異是由于原始實(shí)現(xiàn)中的某些疏忽,加上作者對(duì)離散噪聲級(jí)的處理更仔細(xì)造成的。

確定性采樣好處雖然多,但與每一步都向圖像中注入新噪聲的隨機(jī)采樣相比,它輸出的圖像質(zhì)量確實(shí)更差。

不過(guò)作者很好奇,假設(shè)ODE(常微分方程)和SDE(隨機(jī)微分方程)在理論上恢復(fù)相同的分布,隨機(jī)性的作用到底是什么?

在此他們提出了一種新的隨機(jī)采樣器,它將現(xiàn)有的高階ODE積分器與添加和去除噪聲的顯式“Langevin-like ‘churn’”相結(jié)合。

最終模型性能提升顯著,而且僅通過(guò)對(duì)采樣器的改進(jìn),就能夠讓ImageNet-64模型原來(lái)的FID分?jǐn)?shù)從2.07提高到1.55,接近SOTA水平。

預(yù)處理和訓(xùn)練

作者的第三組貢獻(xiàn)主要為分?jǐn)?shù)建模(score-modeling)神經(jīng)網(wǎng)絡(luò)的訓(xùn)練。

這部分繼續(xù)依賴常用的網(wǎng)絡(luò)體系結(jié)構(gòu)(DDPM、NCSN),作者通過(guò)對(duì)擴(kuò)散模型設(shè)置中網(wǎng)絡(luò)的輸入、輸出和損失函數(shù)的預(yù)處理進(jìn)行了原則性分析,得出了改進(jìn)訓(xùn)練動(dòng)態(tài)的最佳實(shí)踐。

比如使用依賴于σ(noise level)的跳躍連接對(duì)神經(jīng)網(wǎng)絡(luò)進(jìn)行預(yù)處理,使其能夠估計(jì)y(signal)或n(noise),或介于兩者之間的東西。

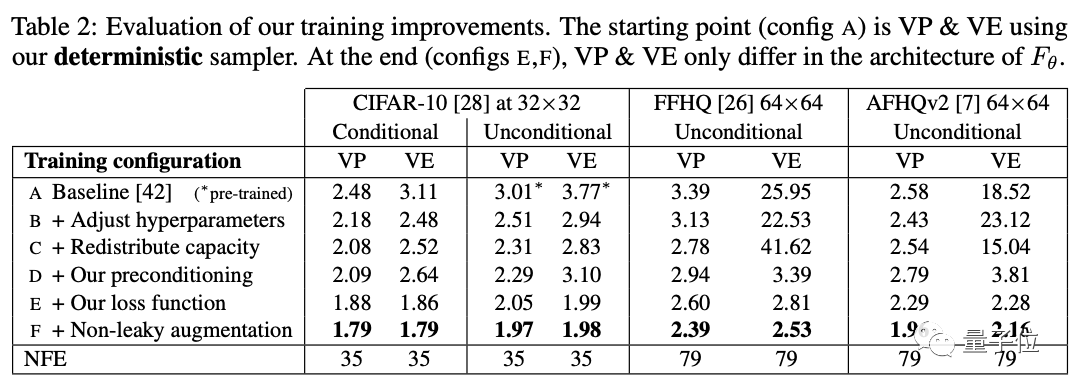

下表具體展示了模型彩英不同訓(xùn)練配置得到的FID分?jǐn)?shù)。

作者從基線訓(xùn)練配置開(kāi)始,使用確定性采樣器(稱為配置A),重新調(diào)整了基本超參數(shù)(配置B),并通過(guò)移除最低分辨率層,并將最高分辨率層的容量加倍來(lái)提高模型的表達(dá)能力(配置C)。

然后用預(yù)處理(配置D)替換原來(lái)的{cin,cout,cnoise,cskip}選項(xiàng)。這使結(jié)果基本保持不變,但VE在64×64分辨率下有很大改善。該預(yù)處理方法的主要好處不是改善FID本身,而是使訓(xùn)練更加穩(wěn)健,從而將重點(diǎn)轉(zhuǎn)向重新設(shè)計(jì)損失函數(shù)又不會(huì)產(chǎn)生不利影響。

VP和VE只在Fθ的架構(gòu)上有所不同(配置E和F)。

除此之外,作者還建議改進(jìn)訓(xùn)練期間的噪聲級(jí)分布,并發(fā)現(xiàn)通常與GANs一起使用的無(wú)泄漏風(fēng)險(xiǎn)增強(qiáng)(non-leaking augmentation)操作也有利于擴(kuò)散模型。

比如從上表中,我們可以看到:有條件和無(wú)條件CIFAR-10的最新FID分別達(dá)到了1.79和1.97,打破了之前的記錄(1.85和2.1046)。

審核編輯 :李倩

-

算法

+關(guān)注

關(guān)注

23文章

4784瀏覽量

98042 -

模型

+關(guān)注

關(guān)注

1文章

3752瀏覽量

52099

原文標(biāo)題:DeepMind谷歌研究員力薦:擴(kuò)散模型效率&生成質(zhì)量提升竅門,來(lái)自StyleGAN原作者

文章出處:【微信號(hào):CVSCHOOL,微信公眾號(hào):OpenCV學(xué)堂】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

大模型支撐后勤保障方案生成系統(tǒng)軟件平臺(tái)

使用Firebase AI Logic生成圖像模型的兩種新功能

如何讓大模型生成你想要的測(cè)試用例?

【Sipeed MaixCAM Pro開(kāi)發(fā)板試用體驗(yàn)】基于MaixCAM-Pro的AI生成圖像鑒別系統(tǒng)

如何進(jìn)行YOLO模型轉(zhuǎn)換?

一種基于擴(kuò)散模型的視頻生成框架RoboTransfer

無(wú)法使用OpenVINO?在 GPU 設(shè)備上運(yùn)行穩(wěn)定擴(kuò)散文本到圖像的原因?

【正點(diǎn)原子STM32MP257開(kāi)發(fā)板試用】基于 DeepLab 模型的圖像分割

利用NVIDIA 3D引導(dǎo)生成式AI Blueprint控制圖像生成

Gemini API集成Google圖像生成模型Imagen 3

如何使用離線工具od SPSDK生成完整圖像?

?VLM(視覺(jué)語(yǔ)言模型)?詳細(xì)解析

?Diffusion生成式動(dòng)作引擎技術(shù)解析

使用OpenVINO GenAI和LoRA適配器進(jìn)行圖像生成

新晉圖像生成王者擴(kuò)散模型

新晉圖像生成王者擴(kuò)散模型

評(píng)論