作者:

借助生成式 AI 模型(如 Stable Diffusion 和 FLUX.1),用戶可以將平平無奇的文本提示詞轉換為令人驚艷的視覺效果。但如果你想生成更具風格化或定制化的圖像,開源的基礎模型可能無法滿足你的所有需求。這時,LoRA(低秩自適應)就派上用場了。許多風格修改和增強功能現以 LoRA 的形式發布,作為基礎模型的模塊化附加組件。通過添加LoRA適配器,使得大家可以隨心所欲、生成風格多變的個性化圖像。

通過將 LoRA 集成到 OpenVINO GenAI 中,開發者可以一次加載多個 LoRA 適配器,并在運行推理時快速動態切換,無需重新編譯基礎模型。這使得用戶能夠以高效、可擴展的方式生成滿足特定需求的、多樣化、高質量的輸出。現在,讓我們深入了解具體步驟,借助 OpenVINO 將你的圖像生成項目推向全新高度!

目錄

克隆openvino.genai GitHub倉庫

為AI模型轉換安裝相關依賴包

下載和轉換AI模型及相應的分詞器

選擇單個或者多個LoRA 適配器來進行圖像生成

用C++創建和運行LoRA圖像生成示例

結論

第0步:

問 OpenVINO GenAI 示例代碼,體驗 LoRA 適配器加持的文本生成圖像功能

了解如何使用 OpenVINO GenAI 搭配 LoRA 進行文本生成圖像的最簡單方法,就是查看代碼倉庫中的示例源碼。

以下是使用 LoRA 進行圖像生成的 Python 示例腳本:

def main(): parser = argparse.ArgumentParser() parser.add_argument('models_path') parser.add_argument('prompt') args, adapters = parser.parse_known_args() prompt = args.prompt device = "CPU" # GPU, NPU can be used as well adapter_config = openvino_genai.AdapterConfig() # Multiple LoRA adapters applied simultaneously are supported, parse them all and corresponding alphas from cmd parameters: for i in range(int(len(adapters) / 2)): adapter = openvino_genai.Adapter(adapters[2 * i]) alpha = float(adapters[2 * i + 1]) adapter_config.add(adapter, alpha) # LoRA adapters passed to the constructor will be activated by default in next generates pipe = openvino_genai.Text2ImagePipeline(args.models_path, device, adapters=adapter_config) print("Generating image with LoRA adapters applied, resulting image will be in lora.bmp") image = pipe.generate(prompt, generator=Generator(42), width=512, height=896, num_inference_steps=20) image_write("lora.bmp", image)

你會發現,只需少量代碼,就能將 LoRA 適配器(單個或多個)輕松融入 OpenVINO GenAI 的文本生成圖像流程。運行 LoRA 圖像生成腳本,就像這樣簡單:

python lora_text2image.py FLUX.1-dev/INT4 " albert einstein, yarn art style" pytorch_lora_weights.safetensors 1.0

其中pytorch_lora_weights.safetensors 就是我們選擇的用于圖像生成的LoRA 適配器。

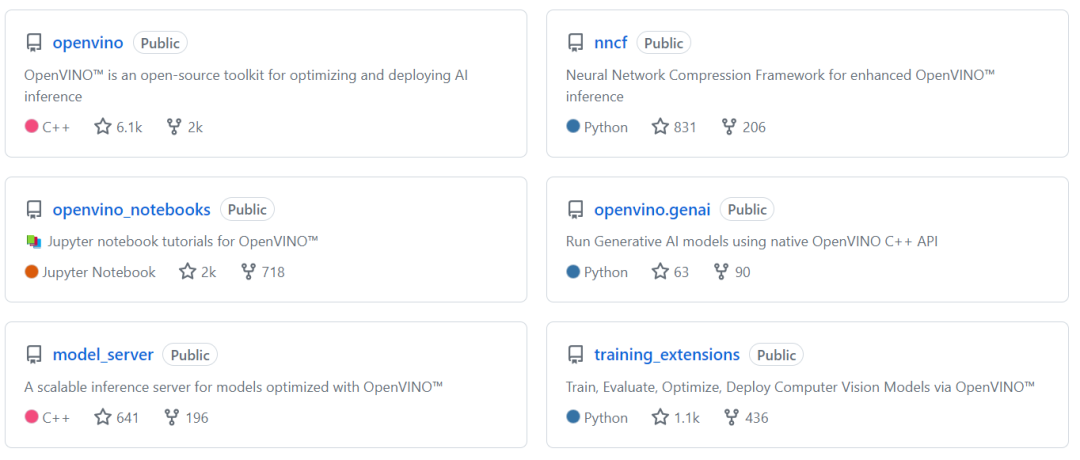

Step 1: 克隆openvino.genai GitHub倉庫

從openvino.genai GitHub倉庫克隆OpenVINO GenAI的開源代碼。

Step 2:為AI模型轉換安裝相關依賴包

前往 文本生成圖像(Text-to-Image)LoRA 示例:

openvino.genaisamplespythonimage_generation

在這個文件夾中,你可以找到關于示例的相關README.md 文件. 你也可以直接從 OpenVINO 下載頁面訪問該 README 文件。

現在,你需要準備一個 Python 虛擬環境,用于模型下載和轉換。可以使用以下代碼完成設置:

python -m venv venv_export venv_exportScriptsactivate pip install --upgrade-strategy eager -r ../../export-requirements.txt

Step 3:下載和轉換AI模型及相應的分詞器

為了生成圖像,我們將使用 FLUX.1-dev模型,并且可以通過一條命令下載并轉換為 OpenVINO IR 格式:

optimum-cli export openvino --model black-forest-labs/FLUX.1-dev --weight-format int4 --group-size 64 --ratio 1.0 FLUX.1-dev/INT4

如果由小伙伴不方便從HuggingFace的網站直接下載模型的,也可以先利用以下命令,從魔搭社區下載模型

modelscope download --model black-forest-labs/FLUX.1-dev

將模型保存在本地后,再次運行以下命令,

optimum-cli export openvino --model/FLUX.1-dev –task text-to-image --weight-format int4 --group-size 64 --ratio 1.0 FLUX.1-dev/INT4

完成模型的轉換和導出。此外,OpenVINO 還支持其他適用于 LoRA 適配器的文本生成圖像模型,完整列表請見此處。歡迎嘗試不同模型,探索更多可能性!

過一會兒,轉換完成后的模型就保留在了本地磁盤上,并準備好進行圖像生成。如果不再需要轉換(或優化)AI 模型,你可以刪除 venv_export 文件夾,這些依賴包在 AI 推理的過程中并不需要。或者,你也可以直接從我們在HuggingFace這里或者魔搭社區這里的模型專區下載我們工程師已轉換和量化的 FLUX.1 模型,跳過上述 第 2 步和第 3 步 的模型下載和轉換步驟,直接從下方的推理步驟開始使用模型!

HuggingFace

https://huggingface.co/OpenVINO/FLUX.1-schnell-int4-ov

魔搭社區

https://modelscope.cn/models/OpenVINO/FLUX.1-schnell-int4-ov

Step 4: 選擇單個或者多個LoRA 適配器來進行圖像生成

首先,我建議你準備一個 Python 虛擬環境來運行 AI 推理。與用于模型下載和轉換的環境不同,這里你只需要安裝一個 Python 包 —— openvino.genai。

python -m venv venv venvScriptsactivate pip install -r ../../deployment-requirements.txt

openvino_genai.AdapterConfig用于在 openvino_genai.Text2ImagePipeline 中管理 LoRA 適配器。它可以用于添加、移除適配器,或調整它們的權重系數(Alpha)來實現風格融合。你可以在配置中加入一個或多個適配器,并通過 Alpha 系數進行混合,以生成更具風格化和創意的圖像。目前,OpenVINO GenAI 支持以 Safetensors 格式保存的 LoRA 適配器。你可以使用 CivitAI 或 HuggingFace Hub上的公開預訓練適配器,或者自行訓練適配器來滿足個性化需求。

CivitAI

https://civitai.com/

HuggingFace Hub

https://huggingface.co/models

以下是用于處理多個 LoRA 適配器的代碼示例,

adapter_config = openvino_genai.AdapterConfig()

# Multiple LoRA adapters applied simultaneously are supported, parse them all and corresponding alphas from cmd parameters:

for i in range(int(len(adapters) / 2)):

adapter = openvino_genai.Adapter(adapters[2 * i])

alpha = float(adapters[2 * i + 1])

adapter_config.add(adapter, alpha)

將 LoRA 集成到 OpenVINO GenAI 的文本生成圖像流程中,僅需一行代碼,如下所示:

# LoRA adapters passed to the constructor will be activated by default in next generates pipe = openvino_genai.Text2ImagePipeline(args.models_path, device, adapters=adapter_config)

選擇單個LoRA適配器進行圖像生成

python lora_text2image.py .FLUX.1-devINT4 "albert einstein" pytorch_lora_weights.safetensors 1.0

使用上述命令,你可以生成帶有 “Yarn art” LoRA 風格的圖像,并使用 INT4 量化的 FLUX.1-dev 模型,效果如下:

選擇多個LoRA 適配器進行圖像生成

當然,你還可以在一次推理中輕松使用多個 LoRA 適配器運行 Text2ImagePipeline。例如,使用以下命令,可以將 “浮世繪藝術(Ukiyo-e Art)” 風格與 “點繪風格(Point style)” 結合,并搭配轉化和導出為OpenVINO 格式的SDXL-LCM模型(具體步驟參考這里)來生成圖像:

python lora.py "./sdxl-lcm" "a cute cat in sunglasses" araminta_k_the_point.safetensors 0.8 "Ukiyo-e Art.safetensors" 0.6

生成的融合了多個LoRA風格的圖像就如下圖所示

OpenVINO GenAI 支持以 Safetensors 格式保存的 LoRA 適配器。你可以使用 CivitAI 或 HuggingFace Hub上的公開預訓練適配器,或者自行訓練 LoRA 適配器,以滿足個性化需求。

請注意,在加載預訓練的 LoRA 適配器之前,請確保它們與基礎模型架構兼容。例如,如果你使用 SDXL 模型,則需要提供專為該模型類型訓練的 LoRA 適配器。否則,例如使用 FLUX 訓練的適配器,將無法正確集成到推理流水線中,也無法成功運行模型推理。

Step 5: 用C++創建和運行LoRA圖像生成示例

盡管 Python 作為編程語言功能強大,且非常適合代碼實驗,但在許多情況下,C++ 更適用于桌面應用程序的開發。下面是用于 LoRA 圖像生成 的 C++ 代碼示例:

const std::string device = "CPU"; // GPU, NPU can be used as well

ov::AdapterConfig adapter_config;

// Multiple LoRA adapters applied simultaneously are supported, parse them all and corresponding alphas from cmd parameters:

for(size_t i = 0; i < (argc - 3)/2; ++i) {

? ? ? ?ov::Adapter adapter(argv[3 + 2*i]);

? ? ? ?float alpha = std::atof(argv[3 + 2*i + 1]);

? ? ? ?adapter_config.add(adapter, alpha);

? ?}

? ?// LoRA adapters passed to the constructor will be activated by default in next generates

? ?ov::Text2ImagePipeline pipe(models_path, device, ov::adapters(adapter_config));

? ?std::cout << "Generating image with LoRA adapters applied, resulting image will be in lora.bmp

";

? ?ov::Tensor image = pipe.generate(prompt,

? ? ? ?ov::make_shared(42)),

ov::width(512),

ov::height(896),

ov::num_inference_steps(20));

imwrite("lora.bmp", image, true);

關于使用 C++ 構建 LoRA 文本生成圖像 應用的詳細指南,請查看此處。

小結

我們演示了如何使用 OpenVINO GenAI 通過文本提示詞結合多個 LoRA 適配器 進行圖像生成。借助提供的工具和代碼,無論你偏好哪種編程語言,都能輕松上手。

你還可以通過 OpenVINO Notebook (https://github.com/openvinotoolkit/openvino_notebooks/tree/latest/notebooks/multilora-image-generation)體驗 OpenVINO GenAI 的多 LoRA 適配器圖像生成,運行效果如下:

歡迎嘗試修改示例代碼,并調整以下生成參數,探索更多可能性:

更改生成圖像的寬度或高度

為同一提示詞生成多張圖片

調整推理步數,以優化生成質量和速度

調節引導尺度(Guidance Scale),影響生成結果的遵從度(了解更多詳情)

(適用于 SD 1.x 和 2.x)當引導尺度 >1 時,添加 負向提示詞 以優化生成效果

結合多個 LoRA 適配器,并調整混合系數,實現個性化風格融合

使用 OpenVINO GenAI,這一切都變得簡單高效!快來試試吧!

-

英特爾

+關注

關注

61文章

10310瀏覽量

180878 -

PC

+關注

關注

9文章

2168瀏覽量

159564 -

AI

+關注

關注

91文章

40578瀏覽量

302170 -

圖像生成

+關注

關注

0文章

25瀏覽量

7175 -

OpenVINO

+關注

關注

0文章

118瀏覽量

806

原文標題:開發者實戰|AI PC 新玩法:OpenVINO? GenAI+LoRA 助你輕松實現個性化圖像的高效生成

文章出處:【微信號:英特爾物聯網,微信公眾號:英特爾物聯網】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

使用OpenVINO GenAI和LoRA適配器進行圖像生成

使用OpenVINO GenAI和LoRA適配器進行圖像生成

評論