美國媒體北京時間23日曝光美國國家安全局(NSA)“Shotgiant”監控計劃,將監控目標對準中國通信設備制造商華為。華為23日強烈譴責此類入侵內部網絡的行為,表示反對一切危害網絡安全的行為。中國業界專家呼吁加強網絡安全建設。

2014-03-24 10:37:47 1464

1464 記者注意到,這是政府工作報告中首次提到“第五代移動通信技術(5G)”,對早已投身5G產業鏈的通信設備廠商、終端商和運營商等而言,意味著此前的投入得到肯定,也意味著前景更加明確。

2017-03-06 09:50:06 2128

2128 C919是我國具有完全自主知識產權的新一代大型噴氣式客機。它本次首飛之所激動人心,不僅因為這是中國民航最大、最顯著的里程碑,它也意味著中國將躋身美國、英國等少數國家能夠自主制造大型客機的行列中!

2017-05-05 20:07:09 5145

5145 這是一件讓人驚呼的事件。G20峰會之后美方改變了對華為禁售的游戲規則,從“全面禁售”開始過渡到“部分限制”。為什么發出危險信號后又出現逆轉?這其中究竟意味著什么?難道一切是要回到貿易戰開始前的樣子嗎?

2019-07-11 11:56:33 8810

8810 華為技術有限公司在美國提起訴訟,對美國聯邦通訊委員會將其列為國家安全威脅的做法提出異議。盡管美國政府換屆,華為仍加大了在美國的法律挑戰力度。

2021-02-12 12:38:13 5180

5180 38 BOD 靜態特性中:

問題:此表從 Datasheet v1.2 更新到 v1.4 意味著什么?這是否意味著不再支持小于 1.75V 的閾值電壓 (TRIGLVL)?

2023-05-04 07:07:37

需要有關FPGA封裝兼容性的信息。 如果有兩個FPGA并且兩個FPGA的封裝相同,那么是否意味著放置FPGA的電路板可以與相同封裝的另一個FPGA一起使用?問候Irshan以上來自于谷歌翻譯以下

2019-01-11 10:40:42

嗨,在5月的研究文章中,提到FPGA的底板假定為64 * 64 ..有些假設為80 * 120。那它究竟意味著什么呢?這是否意味著CLB被放置在2D數組中作為矩形(W * H)并且總共(64

2019-03-22 14:52:49

使用MX6UL QT5.6編譯openGL 例程,報圖片中的錯誤MX6UL芯片上沒有GPU,是不是意味著不支持OpenGL?如果支持的話,需要我怎么編譯才能解決這個問題?

2022-01-11 07:54:28

之間的時間間隔?還有一個問題:當POST_CRC約束設置為ENABLE時,是否意味著配置數據(或至少其中的一部分)被回讀到用戶邏輯中...減少可用于用戶設計的資源?謝謝。

2020-06-10 09:31:14

“收受者”(taker)心態轉變為積極的 “利益相關者” 態度。實際上,這意味著要吸收和實踐開源的做事方式:除了為上游貢獻代碼,增進分享,還要包括透明的治理方式,與其他利益相關者和開發者進行公開討論,以及

2020-08-21 18:24:14

SignalRtn 值來衡量我收到的讀數有多強。0 出現在我肯定希望 SignalRate 有很大價值的情況下。 有誰知道這個“0”是否意味著什么?或者如果有人以前遇到過這個?謝謝

2022-12-28 11:29:33

Virtex 7 PCIe硬IP是否意味著FPGA內部的ASIC?或者像Tandem方法一樣,在第一階段,CPLD將PCIe初始配置加載到FPGA? (http://www.em.avnet.com

2020-05-29 12:52:09

敢問各位大俠,仿真中出現這個警告的時候,是個啥子意思?zero diagonal found in jacobian at 'netxxx'按照我個人的理解是提示在雅可比矩陣中出現了零對角陣,但是這個在電路中究竟意味著什么呢?

2021-06-24 07:05:21

元器件清單上有瑞薩的MCU是不是意味著必須用瑞薩的單片機???還是用的話有加分??

2013-08-30 10:55:04

華為鴻蒙系統出來意味著什么,眾所周知,自鴻蒙系統2.0發布之后,大家對鴻蒙系統又掀起了一番新的期待,尤其華為還表示今年12月底將會開啟試用,明年正式使用。在當前芯片緊缺的情況之下,很多人認為華為

2021-07-28 08:07:23

我們的產品里有CYBLY-022001的BLE芯片。在數據表中,它被描述為藍牙4.1“單模模塊”,單模模塊意味著什么?當使用這個SoC時,我是否能夠采用BT核心版本4.2的BT特征,比如廣告擴展

2018-12-04 14:48:35

stm32任何程序都要先配置時鐘,這個時鐘到底意味著什么?有什么意義? 是否就是一種開關? 還是有什么其他作用?? 求大神回答 ~~~

2017-07-22 20:11:12

如今設備是越做越小,這個趨勢要求越來越小的精密電阻能夠支持越來越高的功率密度。這通常意味著只要可能就應該使用表貼片狀電阻。是這么個說法嗎?SMT技術也不是十全十美的。 更小有時意味著更熱

2018-11-21 11:08:50

如果電阻的第一個色環是黑色意味著什么?是不存在呢還是這個電阻可能是零點幾歐姆的小電阻呢

2020-09-24 20:41:59

我試圖找到一個文檔來描述不同的錯誤代碼對 CAN FD 模塊意味著什么。有沒有人知道從哪里搜索的鏈接或想法?我的 CAN FD 外設在某個時候以錯誤狀態 516 告終,我無法找到它的含義。

2023-02-03 06:44:20

嗨,那里。我想問一個問題(對我來說非常重要),在單擊“繼續”按鈕之后(在調試模式下),附件中的變量變為紅色。這意味著程序已經經歷了一個循環。但是其他變量不會改變顏色(應該是)。為什么會這樣?請給我一些調試的線索。謝謝您。

2020-04-06 18:20:53

)錯誤的安全管理、硬件或軟件中的隨機故障和環境條件引起的問題。功能安全不是關于可靠性或系統的可用性,只要車輛安全地發生故障,它仍然被認為是功能安全的。對于汽車設計人員,這意味著項目是在一個非常嚴格的框架

2018-10-22 09:06:19

加大研發力度,不斷創新和完善無人機威脅破解技術,為國家安全提供更加堅實的保障。同時,我們也呼吁廣大市民增強安全意識,共同維護國家的安全和穩定。

知語云智能科技在無人機威脅破解方面的探索和實踐,不僅體現了

2024-02-27 10:41:24

CARTIAN在函數CysLysIsStValualValuy中意味著什么?

2019-10-18 10:15:28

本帖最后由 一只耳朵怪 于 2018-6-25 10:50 編輯

請問diagnostic測試失敗意味著什么?板子有問題?(ps:u***和emulation這兩項測試過了)。歡迎賜教,不勝感激。

2018-06-25 02:59:37

固定增益芯片是否意味著我不能通過改變外圍參數來改變增益?

2024-09-11 07:13:50

導入SystemVerilog程序包意味著什么?

2020-12-11 06:53:29

嗨,我需要知道如何在xilinx spartan3E FPGA工具包中使用rs232端口通信編寫send recievefunction時建立“物理環回”。這是否意味著將電纜連接到套件?以上

2019-06-04 15:04:59

這是時間報告。我試圖從我的代碼中找到延遲。我無法專門找到延遲,但發現Max延遲高于此。這是最大延遲嗎?這是否意味著輸出需要138317個時鐘周期?如果不是這意味著什么?先謝謝你

2020-04-22 10:13:16

是正確的選擇呢?員工不同時間的離職對公司管理層又意味著什么呢?員工離職是由多方面的因素造成的,因人而異、因環境而異,很難去把握其中的規律,但大多數的選擇還是能簡單窺視這些數字下的潛在因素。對員工來說,選擇

2014-11-20 15:16:12

最常用于小信號放大器的輸出拓撲介紹重負載和空載時的ZO意味著什么?

2021-04-08 06:40:30

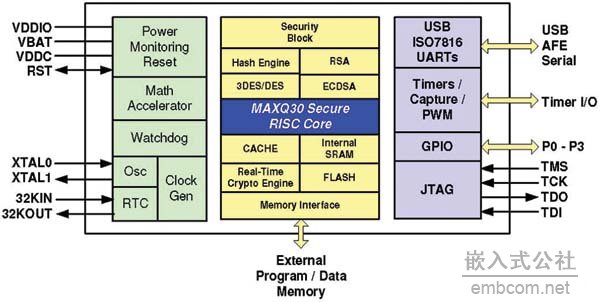

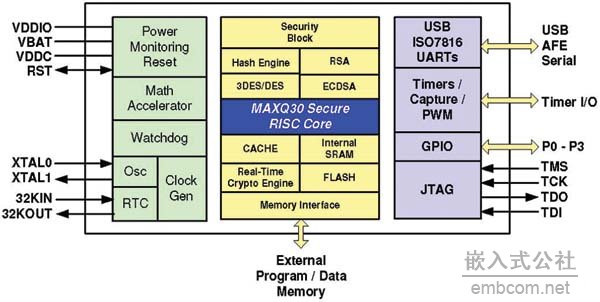

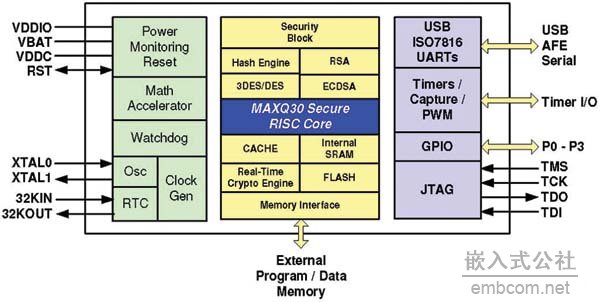

安全器件SHA-1和安全單片機

引言

信息安全無論對國家還是對個人都是非常重要的。信息安全意味著要防止非法復制重要數據信息和程序代碼;避免數據或代

2010-03-03 16:52:55 1080

1080

安全器件SHA-1和安全單片機

引言

信息安全無論對國家還是對個人都是非常重要的。信息安全意味著要防止非法復制重要數據信息和程序代碼;避免數據或代碼

2010-03-06 09:23:27 1295

1295

中歐國際工商學院教務長約翰·奎爾奇的分析一針見血:“華為和中興代表了新的時代:一個第三世界的國家生產著第一世界的高科技。美國的公司從內心覺得很難適應這一點。”

2012-10-29 09:17:58 1028

1028 每次看電視、聽廣播或看大街上的廣告牌時,都能看到推銷產品比競爭對手更加可靠的廣告。從汽車公司、工具公司到半導體公司的每個人都在嘗試證明他們公司生產的產品是唯一可信賴的產品。有如此多的營銷以可靠性為焦點說明可靠性是一項重要的問題。但是,到底最可靠意味著什么呢?

2017-04-18 07:54:30 1684

1684

隨著新Bluetooth低功耗軟件開發工具包(SDK)BLE-Stack 2.2軟件的發布,TI提供了如 藍牙4.2 核心規格中所描述的全新的安全級別。但是,這些安全提升到底意味著什么,為什么現在會做出這些提升?

2017-04-26 13:06:37 4181

4181

蘋果 HomePod已經獲得美國FCC認證,也意味著這款產品將隨時可以銷售。 HomePod是去年蘋果秋季發布會上“意外”的一個產品,它也是蘋果公司布局智能家居的一個重要“樞紐”。

2018-06-08 15:15:00 993

993 關鍵詞:國家安全 , 華為 , 競標 , 美政府 新聞來源:新浪科技 北京時間10月12日下午消息,針對美國政府以國家安全考慮為由禁止華為參與全美應急網絡建設一事,華為今日要求美國政府對此作出解釋

2018-02-15 15:27:35 887

887 國家安全的業者購買設備或服務。雖然新聞稿未提及設備或服務供應商名單,但一般相信結果印證了《華爾街日報》早前的說法。 FCC 主席 Ajit Pai 表示,由特定通訊設備供應商所帶來的國家安全威脅是兩黨所關心的問題,在美國網絡中的路

2018-04-09 03:33:00 2437

2437 5G意味著什么?意味著更快的上傳下載速度、炫酷的VR娛樂體驗、城市物聯、無人駕駛、遠程醫療。5G不僅僅是網速那么簡單,它能顛覆時代!

2018-06-21 02:15:00 2176

2176 據外媒報道,特朗普政府拒絕中國移動進入美國電信市場,稱其將威脅國家安全。 當地時間周一,來自美國商務部下屬國家電信和信息管理局(National Telecommunications

2018-07-04 10:29:04 981

981 最近,關于電信聯通合并的傳聞此起彼伏,牽動著很多人的神經,也引起了行業內外的廣泛關注。本文主要詳細介紹電信聯通合并,到底意味著什么?

2018-09-24 09:23:00 9233

9233 剛剛研制成功的世界首臺分辨力最高紫外超分辨光刻裝備意味著什么?對國內芯片行業有何影響?

2018-12-02 09:31:56 6135

6135

編者按 :美國國務卿蓬佩奧日前警告盟友,不要使用華為生產的設備,否則美國將比較難以與他們合作。英國廣播公司(BBC)中文網整理,截至目前多個國家對華為是否危及國家安全的這項議題表態。 美國國務卿蓬佩

2019-02-20 20:37:01 1941

1941 中國大力支持的華為「滿洲芯片」威脅國家安全。

2019-03-15 09:28:21 4170

4170 目前華為只是暫時被限制了參與Wi-Fi聯盟的活動,所以對于華為來說影響很小。即便是華為失去了會員資格,也并不意味著華為無法推出基于Wi-Fi技術的產品,最多不使用Wi-Fi商標、沒有認證,這也不影響產品的銷售。但是這卻意味著華為無法對于未來Wi-Fi技術和標準的發展產生影響。

2019-05-27 09:03:59 3570

3570 認識和理解無人駕駛飛機(UA)操作中的安全性經常被表達和夸大,作為“在那里安全”的簡短表達。

2019-06-06 16:35:15 3184

3184

近日,據報道,美國白宮經濟顧問庫德洛表示,總統特朗普允許美國企業繼續向華為銷售含有美國技術的產品,但將僅適用于全球廣泛使用的產品,不包含最敏感的國家安全相關設備。

庫德洛指出

2019-07-02 08:51:25 3643

3643 華為會威脅到國家安全

2019-07-23 09:57:56 3001

3001 數字貨幣行業內的許多人往往都將礦機商視為行業的最上游,因為看起來,幾乎源源不斷的資金都在涌向礦機制造者,一臺臺比特幣礦機在很多人眼中就如同“印鈔機”一般神奇,似乎只要能買到礦機,就意味著財富滾滾而來。

2019-12-20 10:40:24 1390

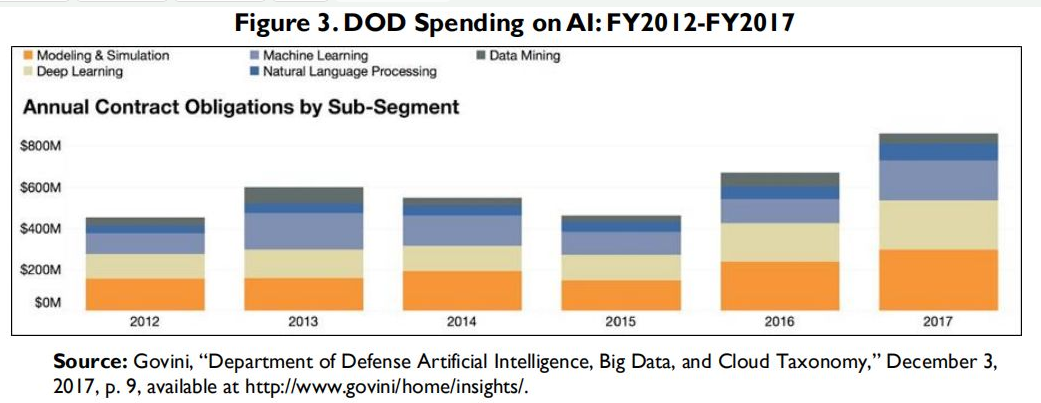

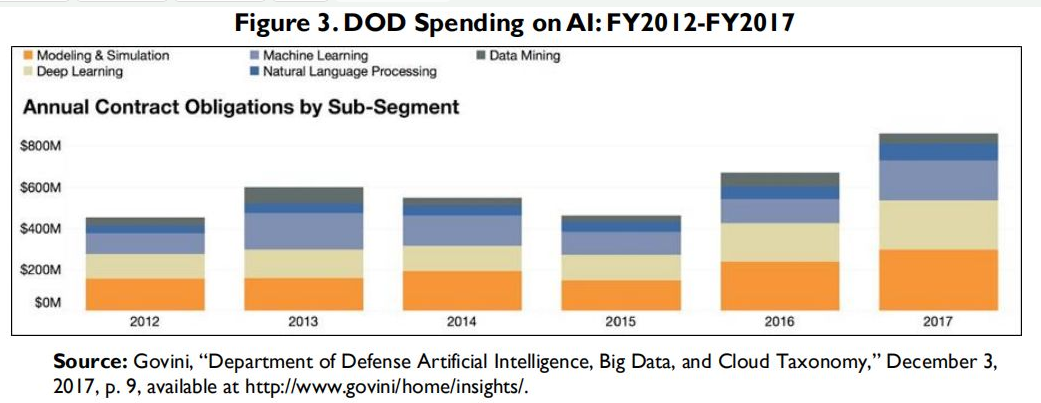

1390 人工智能(AI)是發展迅速的技術領域,對國家安全可能具有重大的影響,引起國際競爭對手、商業領導者、國防研究者和政策制定者的廣泛關注。

2020-01-10 15:08:42 5313

5313

本月的補丁星期二注定是不平凡的,不僅是因為2020年首個累積更新活動,而是修復了存在于Windows系統中的嚴重安全漏洞,更為重要的是美國國家安全局(NSA)首次向微軟發出警告,稱在Windows系統中發現安全漏洞。

2020-01-15 11:45:23 3192

3192 據彭博社報道,知情人士透露,因擔心德國半導體廠商英飛凌收購美國半導體廠商賽普拉斯會給國家安全帶來風險,美國國家安全官員建議總統特朗普阻止此項收購。

2020-03-06 15:36:05 2808

2808 首先是技術上的挑戰。頻譜共享意味著要讓兩種無線通訊網絡共享統一頻段,但信道之間很容易產生相互干擾的兼容問題。

2020-04-06 21:10:24 1088

1088 “如今,國家及其人民的生命比以往任何時候都更加依賴我們的電信網絡,”國家安全助理總檢察長約翰·德默斯(John Demers)講到,“政府和專業通信的安全,及私人數據,只能由美國信任的合作伙伴來運營。今天要求終止中國電信在美國運營授權行動,只是我們確保美國電信系統完整性的一步。”

2020-05-18 15:36:58 3672

3672 據外媒報道,美國聯邦通信委員會當地時間6月30日正式裁定,將中國華為和中興通訊(39.750,-0.38, -0.95%)列為“美國國家安全威脅”,禁止電信運營商使用政府資金向這兩家中企進行采購。

2020-07-02 08:44:30 2521

2521 隨著5G的到來,數據的發送和處理已移至網絡的邊緣。這種邊緣計算對業務意味著什么?優勢、機遇和威脅在哪里?

2020-08-22 11:46:36 2467

2467 近日,國家能源局下發《關于開展“十三五”電力規劃中期評估及滾動調整的通知》,推動“十三五”電力規劃中期評估及滾動調整工作, 這意味著多項新能源規劃目標將出現變化。

2020-08-31 14:59:01 1393

1393 Nadcap 認證。 繼續閱讀以了解有關 Nadcap 認證對 ECM 意味著什么的更多信息,以及它如何為您提供證明和安心。 什么是 NADCAP 認證? 該標準認證曾經被稱為 國家航空航天和國防承包商認證計劃

2020-11-04 19:45:36 4765

4765 G對于區塊鏈而言意味著什么?只有你想不到,更多的是你沒想到!

2020-11-12 11:08:33 3880

3880 據報道,美國聯邦通信委員會(FCC)本周二表示,該機構已駁回中興通訊要求其重新考慮將這家中國公司列為通信網絡美國國家安全威脅的請愿書。

2020-11-26 10:57:19 2859

2859 當地時間周二,美國聯邦通信委員會(FCC)駁回了中興通訊的一份請求。在這份請愿書中,中興要求該機構重新考慮其決定,即將中興列為美國國家安全威脅。

2020-11-26 11:14:19 3860

3860 隨著英國最終準備結束過渡期并退出歐盟,多年的政治紛爭即將進入高潮。但這對物聯網意味著什么?與此相關的一點是,物聯網對英國脫歐意味著什么? 我們知道,英國現任政府一直熱衷于將英國脫歐定位為英國及其企業

2020-12-03 11:28:57 3408

3408 不存在任何缺陷且無需在美國召回。看來進口到中國的特供特斯拉車型比美國的質量還好?意味著國產的特斯拉質量會更好? 相同問題中國召回而在美國則不愿召回 在早前,特斯拉在中國召回的Model S和Model X中部分車輛在經受較大的外部沖擊時,前懸架后連桿球頭螺栓會產

2020-12-03 18:03:21 2405

2405 最近不少網友應該都發現了,互聯網存款產品“下架”進行時,這到底意味著什么?

2020-12-22 09:44:57 4174

4174 如果說抖音海外版(TikTok)能夠對美國國家安全構成威脅,“迫使”特朗普在2020年強行要求TikTok賣給美國公司;那中國政府也許應立刻全面評估特斯拉在中國的發展及影響,因為理論上,特斯拉能夠

2021-01-29 09:16:33 9040

9040 美國一直變著花樣打壓中國通信企業,以維護所謂的美國國家安全。

2021-03-15 14:55:06 2948

2948 能量收集意味著什么?

2021-03-21 10:08:51 2

2 3月23日消息,加拿大公民實驗室(Citizen Lab)的一項新研究表明,TikTok代碼不會對美國國家安全構成威脅。

2021-03-23 13:59:55 2815

2815 降本增效,是每個企業喜聞樂見的事情,企業在自我轉型升級中,也在不斷尋求自己的降本空間。然而,對于大多數中小型企業來說,大批量購入agv小車產品意味著一筆不小的支出,其實不然,國辰機器人與你一起嘮一嘮。

2021-06-10 09:34:59 879

879 鴻蒙開源意味著什么?在華為開發者大會上,大家都為鴻蒙系統而激動,當華為表示會開源的時候,現場掌聲雷動。鴻蒙是華為的一個技術產品,鴻蒙好的話大家都點贊華為,鴻蒙不好的話也有人會噴華為。但是鴻蒙系統開源后,就沒那么簡單了。那么鴻蒙開源意味著什么?

2021-06-28 10:35:00 8601

8601 11月1日,《中華人民共和國個人信息保護法》正式生效,標志著我國對于個人信息安全的保護進入到了新的階段。而縱覽近幾年來的相關政策,會發現國內密集發布了多款數據安全相關法規。 有汽車數據安全方面的,在

2021-11-08 09:41:09 3976

3976 單個封裝中的多個裸片構成了一個非常大的設計;除了仿真之外,沒有其他方法可以進行徹底的驗證。這種設計充其量只能模擬繁瑣,而且必要的測試數量意味著沒有模擬就無法及時完成它們。

2022-07-05 10:03:26 1281

1281 實時警報 -無論您身在何處,都可以隨時了解重要事件的電子郵件、短信或視頻警報,例如孩子放學回家或最近的系統和傳感器活動。一旦發現家中的安全狀況,您還可以通過移動設備向警察或保安公司報警。

2022-08-28 10:51:15 1403

1403 降本增效,是每個企業喜聞樂見的事情,企業在自我轉型升級中,也在不斷尋求自己的降本空間。然而,對于大多數中小型企業來說,購入無人叉車產品意味著一筆不小的支出,往往不愿意將金錢花在這上面,而是繼續使用人力,畢竟勞動力與廉價總是相連,也深入人心,但其實不然,隨著人口紅利的逐

2022-09-07 16:31:07 1043

1043 在過去幾年中,廣域網發生了重大變化,其中最重要的莫過于軟件定義廣域網(SD-WAN),這正在改變網絡專業人士對優化連接使用的方式,這些連接與多協議標簽交換一樣多種多樣( MPLS )、幀中繼甚至 DSL。

2022-09-28 14:42:26 2588

2588 說到物聯網 (IoT),毫無疑問,巨大的潛力和好處將改變我們看待通信、業務和安全的方式。對于許多人來說,將物聯網用于業務安全是顯而易見的,但家庭安全是一個相對較新的應用程序,它提供了夢幻般的前景。提供實時洞察、分析和擴展商業智能的能力意味著物聯網在所有類型的互聯家庭服務方面都能提供大量服務。

2022-10-25 14:08:11 1800

1800 聯通騰訊新設合營企業意味著什么 國企改革的步伐一直沒有停止,日前國家市場監管總局批準聯通與騰訊設立混改新公司。聯通騰訊新設合營企業意味著什么?兩者合作對中國聯通或騰訊而言都是利好。雖然對公司當前

2022-11-03 12:13:47 7386

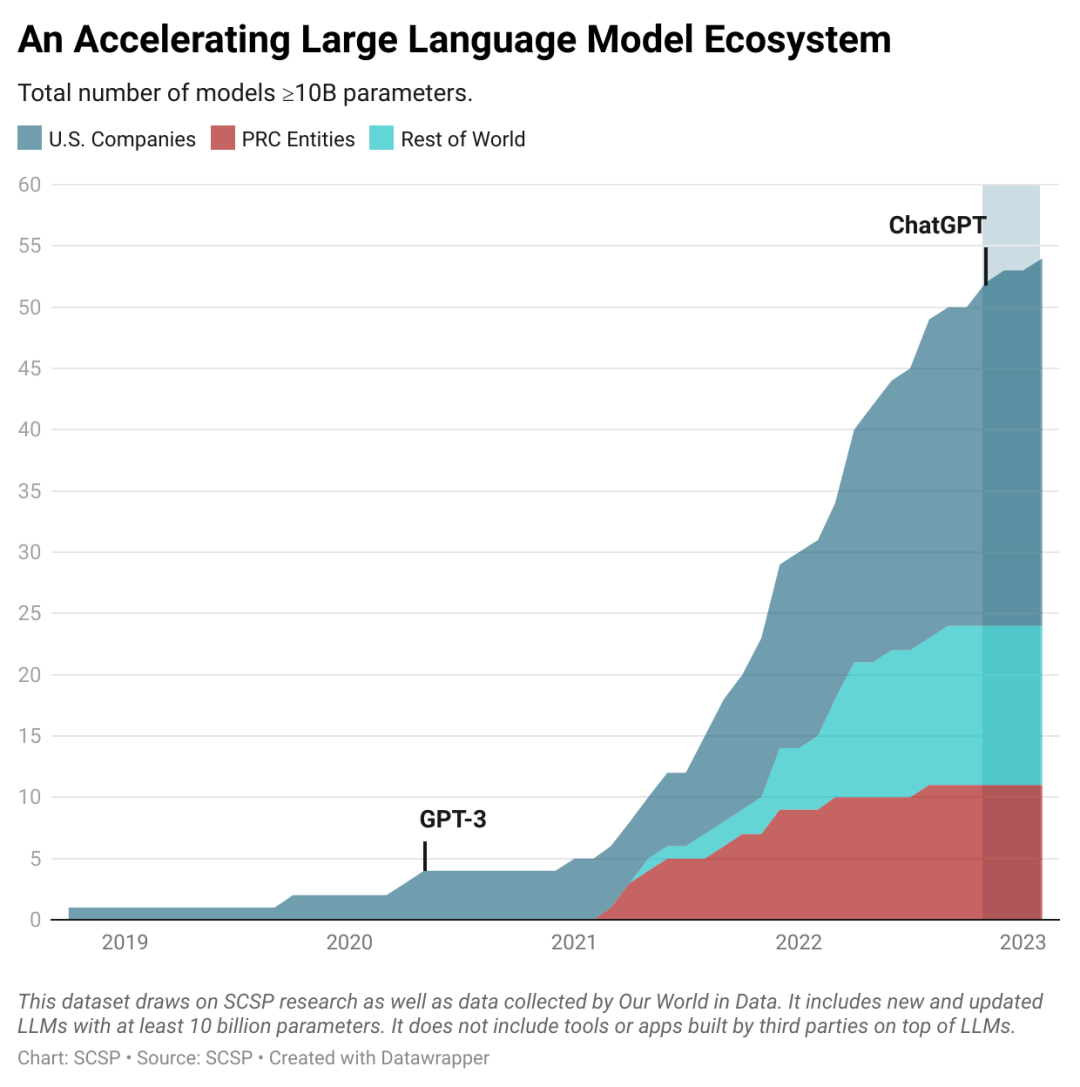

7386 ChatGPT(或其后繼和相關技術)將在多大程度上對國家安全和國防采購產生影響尚不清楚,因為該技術尚不具備可取代人類的能力。然而,基于最初的使用案例即對該工具的反應,ChatGPT已經給國防專業人員帶來了紅利與風險。

2023-03-06 11:20:25 1708

1708 是發消息方式。 消息方式是松耦合方式,比緊耦合的RPC方式要優越,但RPC方式如果用在適合的場景也有它的一席之地。 我們總在談耦合,那么耦合到底意味著什么呢? 耦合的種類: 時間耦合: 客戶端和服務端必須同時上線才能工作。發消息時,接受消息

2023-05-29 09:48:28 1584

1584

IBM 大中華區董事長、總經理陳旭東這樣說道:“ChatGPT 的橫空出世,證明了大語言模型是一條走得通、通往未來 AI 的道路,也意味著 AI 的發展經過幾十年的算法、算力、數據方面的量變積累,‘質變時刻’已經到來。”

2023-09-15 16:23:56 1094

1094 ,劇中的技術攻防并非虛構,維護國家安全需要強大的技術支撐。回歸現實,北京萬里紅科技有限公司(以下簡稱:萬里紅)作為中國“數字安全國家隊”,憑借在信息安全保密領域的深厚積累,正在時刻為國家安全構筑著一道道防竊密的隱形防線。

2025-07-21 14:31:59 1150

1150 LZ-100電能質量在線監測裝置 電能質量在線監測裝置通過CQC 認證(中國質量認證中心認證),意味著該裝置在合規性、技術性能、安全性、可靠性等核心維度,均符合國家 / 行業相關標準及 CQC 認證

2025-09-03 15:57:33 484

484

電子發燒友App

電子發燒友App

評論