未來將面臨大范圍的更新及替換,而輕質(zhì)材料之間也將掀起新一番的激烈競爭。ChinaLITE 2018將集中展示未來汽車開發(fā)材料及輕量化解決方案,展品包括:輕量化材料、材料成型加工技術(shù)與設(shè)備、輕量化材料連接

2018-02-27 11:08:45

未來將面臨大范圍的更新及替換,而輕質(zhì)材料之間也將掀起新一番的激烈競爭。ChinaLITE 2018將集中展示未來汽車開發(fā)材料及輕量化解決方案,展品包括:輕量化材料、材料成型加工技術(shù)與設(shè)備、輕量化材料連接

2018-03-27 09:03:06

未來將面臨大范圍的更新及替換,而輕質(zhì)材料之間也將掀起新一番的激烈競爭。ChinaLITE 2018將集中展示未來汽車開發(fā)材料及輕量化解決方案,展品包括:輕量化材料、材料成型加工技術(shù)與設(shè)備、輕量化材料連接

2018-05-29 09:04:16

量化算法具有什么特點?模型量化會帶來哪些好處?

2021-09-28 06:32:07

15 模型的過擬合 & 欠擬合 & 總體解決方案

2020-05-15 07:49:36

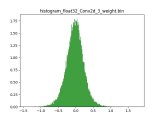

模型量化作為一種能夠有效減少模型大小,加速深度學習推理的優(yōu)化技術(shù),已經(jīng)得到了學術(shù)界和工業(yè)界的廣泛研究和應(yīng)用。模型量化有 8/4/2/1 bit等,本文主要討論目前相對比較成熟的 8-bit 低精度

2021-07-26 08:08:31

一、int8的輸出和fp32模型輸出差異比較大

解決方案:

檢查前后處理是否有問題,int8網(wǎng)絡(luò)輸入輸出一般需要做scale處理,看看是否遺漏?

通過量化可視化工具分析int8的輸出和fp

2023-09-19 06:09:33

本帖最后由 ***g 于 2021-4-6 11:58 編輯

一:方案名稱攝影補光燈照明驅(qū)動解決方案 & LED大功率PD移動電源解決方案二:方案組成部分1、DC-DC升壓恒流驅(qū)動

2021-04-06 11:57:55

無法確定使用 Optimum Intel / NNCF 在重量壓縮中選擇 FP16 模型的原因。

2025-03-06 06:04:09

YOLOv3的darknet模型先轉(zhuǎn)為caffe模型后再轉(zhuǎn)為fp32bmodel,模型輸出和原始模型輸出存在偏差?

2023-09-19 06:26:10

一 試著將模型進行了esp-dl上int16和int8的量化,并在測試數(shù)據(jù)集上進行精度評估,其中int16的模型精度基本沒有下降,但是int8的模型評估精度下降了很多,目前正在嘗試修改

2024-06-28 15:10:47

mobilenet_v1_1.0_224_quant.tflite 對 TFLite 進行基準推理,我發(fā)現(xiàn) XNNPACK 委托未用于推理(很可能是因為這是一個量化網(wǎng)絡(luò)- 因為它適用于 fp32 模型)。稍微瀏覽一下

2023-04-11 07:05:52

quantize_yolo.py注:附件中的quantize_yolo.py是我量化onnx模型的代碼。4. 使用 onnxruntime_perf_test 在 npu 上運行

2023-04-04 06:13:12

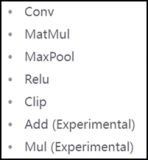

量化

七、Vitis AI 通過遷移學習訓(xùn)練自定義模型

八、Vitis AI 將自定義模型編譯并部署到KV260中

鋪墊

校準和量化有什么卻別?

校準和量化是 Vitis AI 中用于優(yōu)化神經(jīng)網(wǎng)絡(luò)模型

2023-10-15 10:51:32

生成回答。在特定領(lǐng)域或任務(wù)中,可以通過微調(diào)Embedding模型來提高檢索的相關(guān)性和準確性。Embedding在大模型RAG技術(shù)中發(fā)揮著至關(guān)重要的作用。它不僅實現(xiàn)了文本向量化,還為信息檢索和文本生成提供了基礎(chǔ)。通過不斷優(yōu)化和迭代Embedding模型,我們可以進一步提升RAG系統(tǒng)的性能和準確性。

2025-01-17 19:53:57

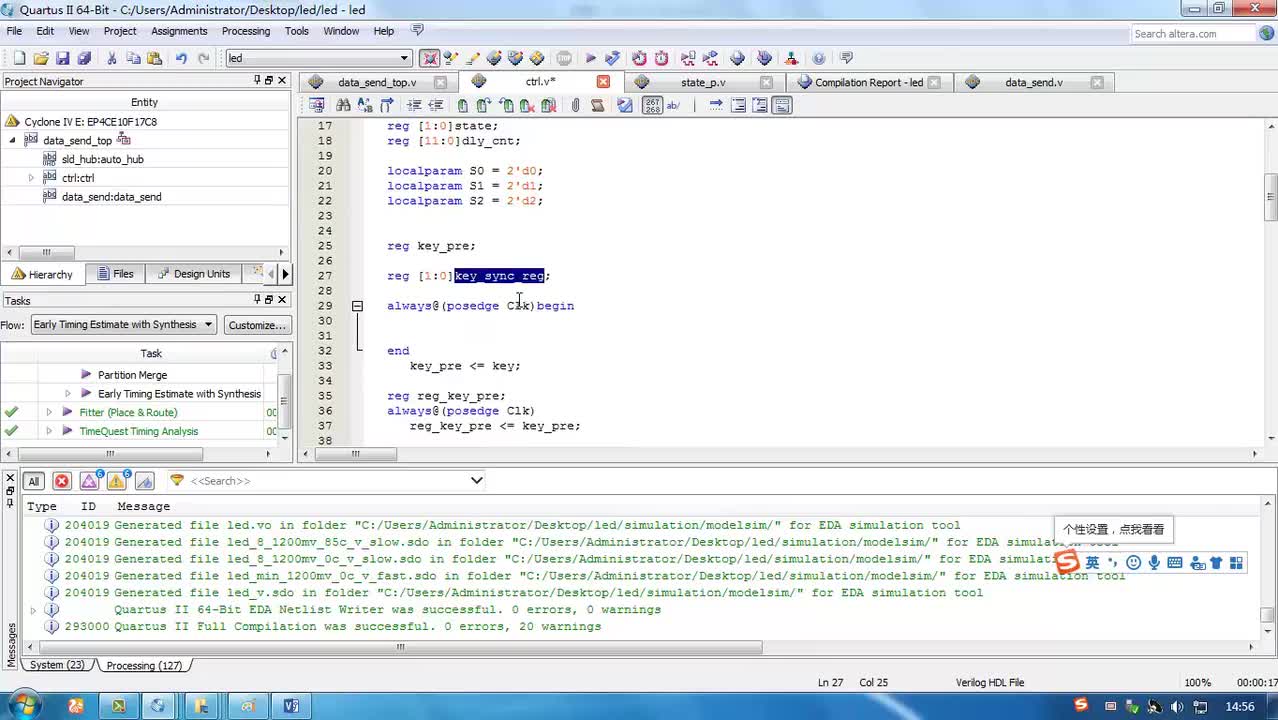

(model = modelpath)

if ret != 0:

print(\'Load model failed!\')

exit(ret)

模型量化構(gòu)建

# Build model

ret

2024-08-27 22:50:18

使用model_transform.py和model_deploy把caffe模型bf16量化成cvimodel,原模型的輸入shape是3*112*112,輸出是2*1*1,量化完測試的時候,輸入shape變成2*1*1了,而用該模型的onnx形式量化成cvimodel就是正常的

2023-09-18 07:19:54

使用esp-dl中的example量化我的YOLO模型時,提示:ValueError: current model is not supported by esp-dl 錯誤,

請看我的代碼和模型

2024-06-28 06:47:23

分享一個不錯的STM32串口DMA收發(fā)并解讀的方案

2021-12-08 06:46:20

分享一款不錯的基于Pixart PAH8011ES穿戴式心跳量測解決方案解決方案

2021-06-16 09:01:54

分立電池檢測解決方案

2021-02-26 08:38:00

可以使用已有的量化表(比如 TensorRT 量化后得到的量化表)作為輸入 來完成BModel模型的量化嗎?

2023-09-19 06:04:43

及的功能已經(jīng)可以輕松實現(xiàn)。 SMC目前能夠為客戶提供完整的PON OLT/ONU接收側(cè)芯片解決方案,包括PD/APD, 產(chǎn)品基于傳統(tǒng)的Ⅲ-Ⅴ族材料和當前方興未艾的硅光子平臺,在不久的將來,SMC也會推出發(fā)射側(cè)芯片解決方案,包括FP/DFB.

2020-07-03 10:15:13

基于Blackfin的解決方案 針對ADSP-BF706 BLACKFIN+處理器的EVWSS軟件架構(gòu)基于SigmaDSP的解決方案

2021-01-21 06:25:57

業(yè)內(nèi)首個signoff驅(qū)動的PrimeECO解決方案發(fā)布

2020-11-23 14:28:15

性能等相關(guān)問題:如結(jié)構(gòu)膠(導(dǎo)熱、絕緣)、灌封膠(灌封、導(dǎo)熱)、密封膠(密封)

以下是我司為各大圓柱電芯廠家提供的輕量化解決方案:

一、大圓柱電芯發(fā)泡灌封技術(shù):

電池包無模組方案采用大量發(fā)泡灌封膠填充,保證

2023-10-17 10:49:39

如何用單顆芯片實現(xiàn)出色的處理性能、能效和安全性?如何優(yōu)化AR解決方案?

2021-06-02 06:56:16

使用NVRAM的簡單解決方案

2021-01-13 06:56:35

將 openai/whisper-large-v3 FP32 模型轉(zhuǎn)換為 FP16、INT8 和 INT4。

推理所花費的時間比在 FP32 上花費的時間要多

2025-06-24 06:23:18

在 CPU 上推斷出 FP32 模型格式和 FP16 模型格式。

FP32 模型格式的推斷速度比 FP16 模型格式快。

無法確定推斷 FP32 模型格式的原因比 CPU 上的 FP16 模型格式快。

2023-08-15 08:03:04

無法確定是否可以輸入隨機數(shù)據(jù)集來生成 INT8 訓(xùn)練后量化模型。

2025-03-06 06:45:31

傳統(tǒng)電源方案有哪些弊端?取代傳統(tǒng)電源方案的LIPS解決方案

2021-06-08 07:18:50

未來將面臨大范圍的更新及替換,而輕質(zhì)材料之間也將掀起新一番的激烈競爭。ChinaLITE 2018將集中展示未來汽車開發(fā)材料及輕量化解決方案,展品包括:輕量化材料、材料成型加工技術(shù)與設(shè)備、輕量化材料

2018-01-18 17:00:04

未來將面臨大范圍的更新及替換,而輕質(zhì)材料之間也將掀起新一番的激烈競爭。ChinaLITE 2018將集中展示未來汽車開發(fā)材料及輕量化解決方案,展品包括:輕量化材料、材料成型加工技術(shù)與設(shè)備、輕量化材料連接

2018-02-27 11:10:31

未來將面臨大范圍的更新及替換,而輕質(zhì)材料之間也將掀起新一番的激烈競爭。ChinaLITE 2018將集中展示未來汽車開發(fā)材料及輕量化解決方案,展品包括:輕量化材料、材料成型加工技術(shù)與設(shè)備、輕量化材料

2018-01-19 11:53:44

模型是一張圖片輸入時,量化文件如上圖所示。但是我現(xiàn)在想量化deepprivacy人臉匿名模型,他的輸入是四個輸入。該模型訓(xùn)練時數(shù)據(jù)集只標注了人臉框和關(guān)鍵點,該模型的預(yù)處理是放到模型外的,不在模型

2025-06-13 09:07:13

TensorFlow模型,Arm建議您將32位未量化模型轉(zhuǎn)換為CoreML。要將模型轉(zhuǎn)換為CoreML,請使用34Tgithub.com/tf-CoreML/tf-coreml34T,然后

2023-08-10 06:01:27

提出一個新的自適應(yīng)動態(tài)信任關(guān)系量化模型。該模型在建立基于歷史函數(shù)的直接信任計算方法和基于路徑函數(shù)的反饋信任聚合模型的基礎(chǔ)上,引入自信因子和反饋因子來自動建立和

2009-04-09 08:40:00 12

12 混合信號應(yīng)用的解決方案因特定應(yīng)用而變化。非常重要的一點是分析自己的測量需求,確保選擇的解決方案足以解決問題。每個混合信號解決方案都有類似之處和差別及各自的優(yōu)缺點。在某些情況下,您可能會發(fā)現(xiàn)需要一種

2015-05-26 15:04:16 326

326 劉峰介紹,在Pack結(jié)構(gòu)輕量化過程中,主要實現(xiàn)輕量化的方式有:1、去模組化。把以前的單模組變成大模組,電芯大量采用A/B膠粘,應(yīng)用扎帶取代側(cè)板。2、電氣件輕量化,小型化,接插件集成化。3、取消從控。4、FPC取代傳統(tǒng)線速;5、箱體/箱蓋材質(zhì)輕量化。

2018-10-24 16:58:11 5745

5745 Materialise 在法蘭克福的Formnext展會上宣布了3D打印解決方案,用以提高生產(chǎn)力,并推進批量化增材制造。

2020-05-18 14:40:41 3430

3430 量化感知訓(xùn)練(Quantization Aware Training )是在模型中插入偽量化模塊(fake\_quant module)模擬量化模型在推理過程中進行的舍入(r...

2020-12-08 22:57:05 3972

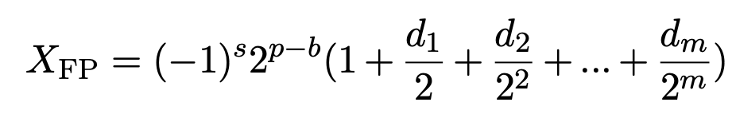

3972 大家都知道模型是有權(quán)重 (w) 和偏置 (b) 組成,其中 w,b 都是以 float32 存儲的,float32 在計算機中存儲時占 32bit,int8 在計算機中存儲時占 8bit;模型量化

2021-02-04 15:40:53 2557

2557

初次嘗試Tengine 適配 Ncnn FP32 模型,相較于mnn,ncnn而言,這個框架對于多框架模型有著很好的支持性 – Caffe,Tensorflow,TF-Lite, M...

2022-02-07 11:16:56 0

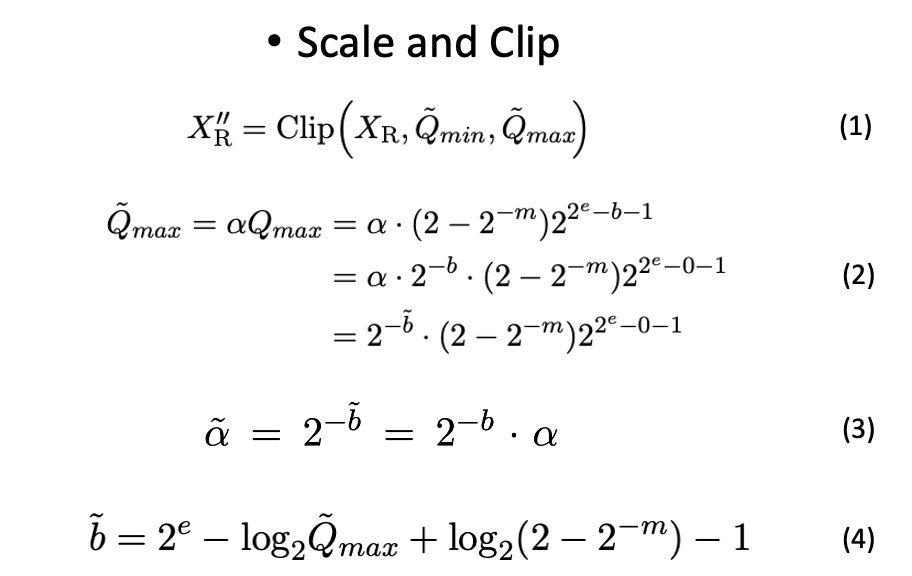

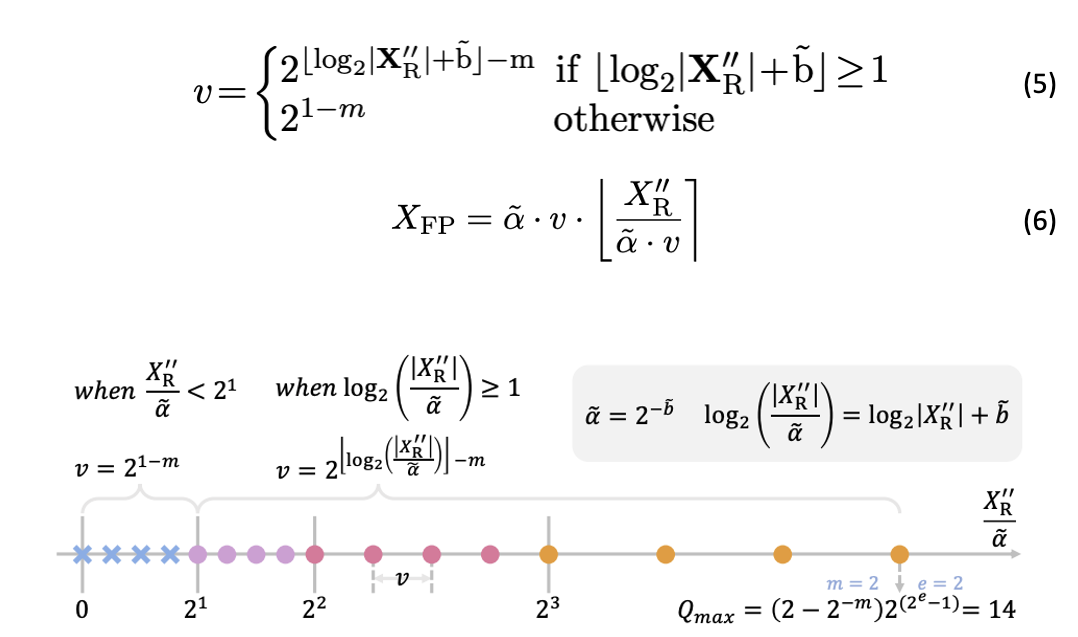

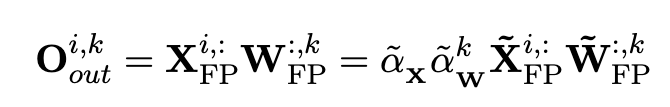

0 最近調(diào)研了一些關(guān)于CNN網(wǎng)絡(luò)量化的論文,結(jié)合之前基于MNN的使用感受,打算跟大家談一談MNN中的模型量化以及其相關(guān)的數(shù)學模型。本文可能關(guān)...

2022-02-07 12:22:19 2

2 因此量化模型被廣泛使用在推理側(cè),量化也成為了一個重要且非常活躍的研究領(lǐng)域。近期,MegEngine 開源了 4 bits 的量化的相關(guān)內(nèi)容,通過 MegEngine 4 bits 量化實現(xiàn)

2022-09-23 15:08:25 1536

1536 輕量化的材料就是可以用來減輕產(chǎn)品自重且可以提高產(chǎn)品綜合性能的材料。材料輕量化,指的是在滿足機械性能要求的前提下,通過采用輕量化的金屬和非金屬材料實現(xiàn)重量減輕的方法。在當前汽車制造領(lǐng)域,輕量化材料主要包括鋁合金、鎂合金和鈦合金。

2023-01-29 10:43:31 2541

2541 大數(shù)據(jù),加速模型的訓(xùn)練和推理優(yōu)化等在量化投研場景中非常重要。 NVIDIA GPU 加速的解決方案能夠助力量化金融加速邁入高算力大模型時代。 在日前舉辦的“技術(shù)圓桌派”第二期精英人才閉門會上, NVIDIA 中國區(qū)金融行業(yè)工程及解決方案經(jīng)理史永明 、

2023-05-24 06:05:02 1348

1348

深度學習模型量化支持深度學習模型部署框架支持的一種輕量化模型與加速模型推理的一種常用手段,ONNXRUNTIME支持模型的簡化、量化等腳本操作,簡單易學,非常實用。

2023-07-18 09:34:57 5763

5763

FP7209X+FP6195+TUYA智能調(diào)光應(yīng)用方案,雙色調(diào)光無頻閃

2023-07-25 17:13:31 7

7 電子發(fā)燒友網(wǎng)站提供《基于STSPIN32G4輕量化協(xié)作機器人關(guān)節(jié)伺服驅(qū)動解決方案.pdf》資料免費下載

2023-07-31 15:07:47 8

8 編譯|Hypothesis.小編|吃不飽MES公司與PikeTec公司達成合作,推出完整的基于模型的汽車軟件工程項目的互操作質(zhì)量解決方案。合作伙伴

2023-07-31 17:59:51 1255

1255

FP6291+FP8102:充電型桌面迷你臺式風扇方案

2023-02-25 23:59:11 3338

3338

FP7125:車燈單IC遠近光方案

2023-02-26 00:09:09 2207

2207

FP5207B:鋰電升壓音響驅(qū)動方案

2023-03-26 22:01:23 2822

2822

使用 GPTQ 量化的模型具有很大的速度優(yōu)勢,與 LLM.int8() 不同,GPTQ 要求對模型進行 post-training quantization,來得到量化權(quán)重。GPTQ 主要參考了

2023-08-28 16:44:51 2564

2564

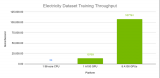

量化工具以 ONNX 文件和部分圖片為輸入,將神經(jīng)網(wǎng)絡(luò)從 FP32 量化為 INT8 精度,目前支持 PTQ 與 QAT 功能。僅需在代碼中將量化和編譯工具導(dǎo)入并通過 API 調(diào)用,即可對 ONNX 模型完成量化和編譯

2023-09-27 17:14:24 1814

1814

背景介紹TPU-MLIR編譯器可以將機器學習模型轉(zhuǎn)換成算能芯片上運行的bmodel模型。由于浮點數(shù)的計算需要消耗更多的計算資源和存儲空間,實際應(yīng)用中往往采用量化后的模型(也稱定點模型)進行推理。相比

2023-10-10 10:17:42 2774

2774

Vitis AI 校準和量化代碼導(dǎo)入必要的模塊執(zhí)行校準過程評估量化模型準確度導(dǎo)出量化模型?

2023-10-15 17:14:47 4

4 基于Benchmark的性能測試量化指標方案是一種用于評估和量化系統(tǒng)性能的方法。通過使用Benchmark測試工具,該方案旨在提供可靠的性能數(shù)據(jù),并使用具體的指標來衡量系統(tǒng)在各個方面的表現(xiàn)。本文將

2023-10-17 10:15:14 1720

1720 電子發(fā)燒友網(wǎng)站提供《FP6193 3A降壓穩(wěn)壓器解決方案.pdf》資料免費下載

2023-12-25 18:06:30 0

0 FP7209X-升降壓電路圖方案

2022-11-03 15:34:04 19

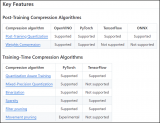

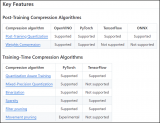

19 OpenVINO2023版本衍生出了一個新支持工具包NNCF(Neural Network Compression Framework – 神經(jīng)網(wǎng)絡(luò)壓縮框架),通過對OpenVINO IR格式模型的壓縮與量化更好的提升模型在OpenVINO框架上部署的推理性能。

2023-11-20 10:46:15 2460

2460

在基于PytorchQuantization導(dǎo)出的含有QDQ節(jié)點的onnx時,我們發(fā)現(xiàn)盡管量化版本的torch模型精度很高,但是在TensorRT部署時精度卻很低,TRT部署收精度損失很嚴重,通過

2023-11-23 16:40:20 2524

2524 AI Run-time 軟件以及 PC 端 Art. Studio 集成開發(fā)環(huán)境,是具備模型量化、模型編譯、協(xié)同仿真和模型部署四大功能的一站式解決方案。

2023-12-05 11:23:12 2096

2096

電子發(fā)燒友網(wǎng)站提供《瑞薩量化寬松(快速有效)工具解決方案介紹.pdf》資料免費下載

2023-12-21 10:39:02 0

0 PyTorch作為一個開源的機器學習庫,以其動態(tài)計算圖、易于使用的API和強大的靈活性,在深度學習領(lǐng)域得到了廣泛的應(yīng)用。本文將深入解讀PyTorch模型訓(xùn)練的全過程,包括數(shù)據(jù)準備、模型構(gòu)建、訓(xùn)練循環(huán)、評估與保存等關(guān)鍵步驟,并結(jié)合相關(guān)數(shù)字和信息進行詳細闡述。

2024-07-03 16:07:57 2544

2544 深度學習模型量化是一種重要的模型輕量化技術(shù),旨在通過減少網(wǎng)絡(luò)參數(shù)的比特寬度來減小模型大小和加速推理過程,同時盡量保持模型性能。從而達到把模型部署到邊緣或者低算力設(shè)備上,實現(xiàn)降本增效的目標。

2024-07-15 11:01:56 1728

1728

深度神經(jīng)網(wǎng)絡(luò)模型量化是深度學習領(lǐng)域中的一種重要優(yōu)化技術(shù),旨在通過減少模型參數(shù)的精度(即從高精度浮點數(shù)如32位浮點數(shù)FP32降低到低精度整數(shù)如8位整數(shù)INT8或更低)來降低模型的計算和存儲需求,同時

2024-07-15 11:26:24 1938

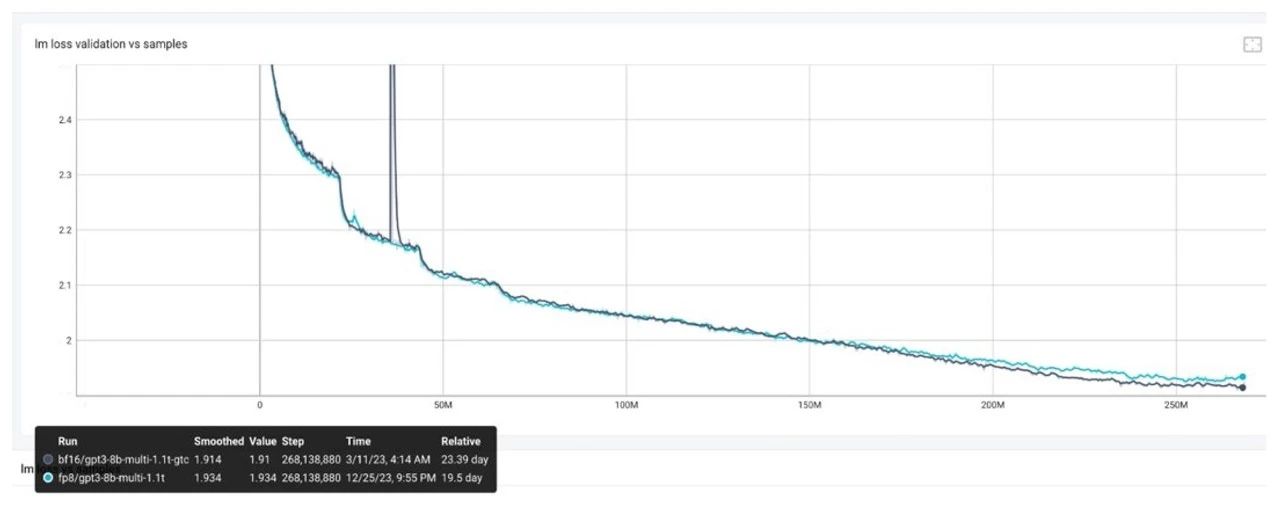

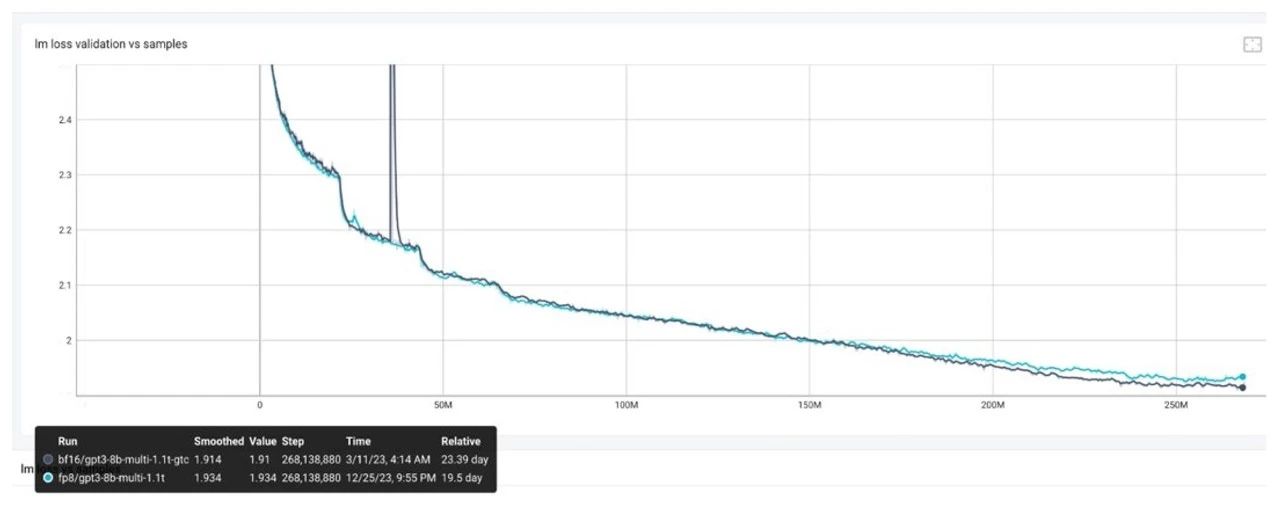

1938 目前,市場上許多公司都積極開展基于 FP8 的大模型訓(xùn)練,以提高計算效率和性能。在此,我們整理并總結(jié)了客戶及 NVIDIA 技術(shù)團隊在 FP8 模型訓(xùn)練過程中的 debug 思路和方法,供大家參考。

2024-09-06 14:36:46 1696

1696

在本文中,我們將探討一種廣泛采用的技術(shù),用于減小大型語言模型(LLM)的大小和計算需求,以便將這些模型部署到邊緣設(shè)備上。這項技術(shù)稱為模型量化。它使得人工智能模型能夠在資源受限的設(shè)備上高效部署。在當

2024-10-25 11:26:01 1147

1147

近日,Meta在開源Llama 3.2的1B與3B模型后,再次為人工智能領(lǐng)域帶來了新進展。10月24日,Meta正式推出了這兩個模型的量化版本,旨在進一步優(yōu)化模型性能,拓寬其應(yīng)用場景。

2024-10-29 11:05:25 1251

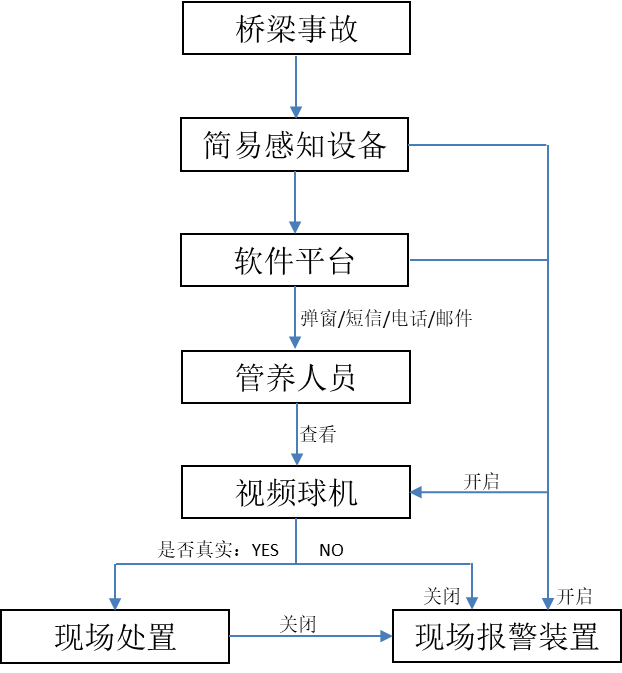

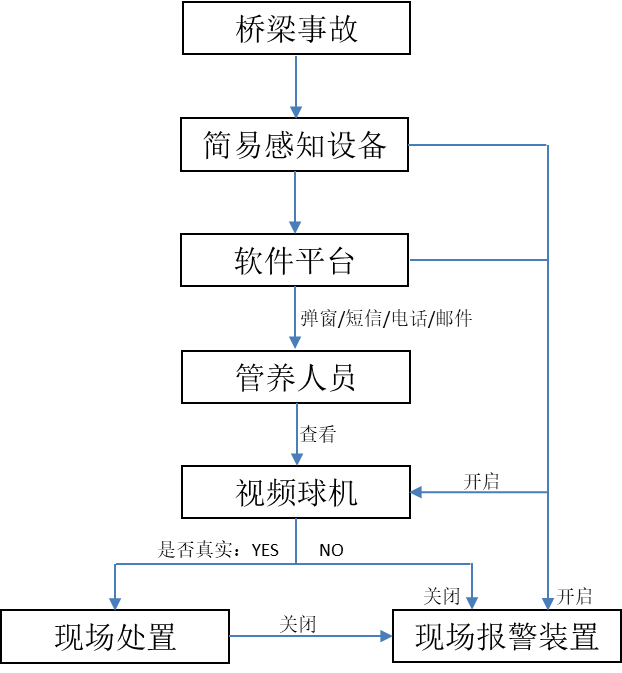

1251 近期,針對汛期橋梁結(jié)構(gòu)和公路邊坡受自然災(zāi)害影響出現(xiàn)滑坡、坍塌等事故,交通運輸部和應(yīng)急管理部密集發(fā)布相關(guān)政策文件,明確各地需加強橋梁結(jié)構(gòu)和公路邊坡檢測監(jiān)測工作,多地積極響應(yīng)政策號召,提出通過輕量化監(jiān)測簡易感知方案來保障公路安全。順應(yīng)市場需求,中海達推出中小橋和公路邊坡輕量化監(jiān)測簡易感知解決方案。

2024-11-19 11:40:40 1530

1530 本文主要介紹了 FP8 數(shù)據(jù)格式在大型模型訓(xùn)練中的應(yīng)用、挑戰(zhàn)及最佳實踐,展示了 FP8 在提升訓(xùn)練速度和效率方面的潛力和實際效果。

2024-11-19 14:54:09 3343

3343

簡易感知方案來保障公路安全。順應(yīng)市場需求,中海達推出中小橋和公路邊坡輕量化監(jiān)測簡易感知解決方案。 ? 輕量化監(jiān)測簡易感知解決方案是什么? 為了滿足管養(yǎng)需求,通過布設(shè)高集成、低功耗、易安裝的感知設(shè)備,對中小橋和

2024-11-29 17:48:21 966

966

利用 FP8 技術(shù)加速 LLM 推理和訓(xùn)練越來越受到關(guān)注,本文主要和大家介紹如何使用 FP8 這項新技術(shù)加速大模型的訓(xùn)練。 使用 FP8 進行大模型訓(xùn)練的優(yōu)勢 FP8 是一種 8 位浮點數(shù)表示法

2024-12-09 11:30:29 2231

2231 廣和通推出AI玩具大模型解決方案,該方案深度融合豆包等AI大模型、內(nèi)置廣和通Cat.1模組,助力智能玩具實現(xiàn)AI化升級。該解決方案無需外接MCU,即可實現(xiàn)音視頻及圖像傳輸、語音識別、自然語言處理

2025-01-21 10:27:33 1766

1766 近日,廣和通推出了一項專為AI玩具設(shè)計的創(chuàng)新解決方案——AI玩具大模型解決方案。該方案深度融合了豆包等領(lǐng)先的AI大模型技術(shù),并內(nèi)置了廣和通先進的Cat.1模組,旨在助力智能玩具實現(xiàn)AI化升級,開啟

2025-01-21 14:45:52 1640

1640 越來越多的技術(shù)團隊開始使用 FP8 進行大模型訓(xùn)練,這主要因為 FP8 有很多技術(shù)優(yōu)勢。比如在新一代的 GPU 上,FP8 相對于 BF16 對矩陣乘算子這樣的計算密集型算子,NVIDIA

2025-01-23 09:39:45 2027

2027

廣和通近期推出了一款創(chuàng)新的AI玩具大模型解決方案,該方案深度融合了豆包等AI大模型,并內(nèi)置了廣和通Cat.1模組,為智能玩具的AI化升級提供了強有力的支持。 通過這一解決方案,智能玩具無需外接MCU

2025-01-24 10:36:13 1853

1853 MambaQuant在Mamba系列模型上實現(xiàn)了W8A8/W4A8量化的方法,精度逼近浮點,超過Quarot等SOTA方法。該工作已被人工智能頂會ICLR-2025接收。

2025-03-05 11:10:23 1133

1133

這不是幻想,是基于思必馳空調(diào)大模型解決方案發(fā)生的真實體驗,該方案深度融合了思必馳自研的全鏈路智能語音交互技術(shù)與對話式語言大模型DFM,它不僅能“聽見”指令,更能“聽懂”情緒,根據(jù)用戶的習慣和喜好智能調(diào)節(jié)溫度、風速、模式等,真正做到懂你所想。

2025-07-31 17:46:03 824

824

電子發(fā)燒友App

電子發(fā)燒友App

評論