楊強(qiáng)教授認(rèn)為,DeepMind把端到端的深度學(xué)習(xí)應(yīng)用在強(qiáng)化學(xué)習(xí)上,使得強(qiáng)化學(xué)習(xí)能夠應(yīng)付大數(shù)據(jù),因此能在圍棋上把人類完全擊倒,它做到這樣是通過完全的自學(xué)習(xí)、自我修煉、自我改正,然后一個一個迭代。楊強(qiáng)還指出,搜索和學(xué)習(xí)的結(jié)合才是人工智能的發(fā)展方向。未來,遷移學(xué)習(xí)會是這個問題的解決途徑。

2016-04-29 14:44:46 12803

12803 人工智能競爭,從算法模型的研發(fā)競爭,轉(zhuǎn)向數(shù)據(jù)和數(shù)據(jù)質(zhì)量的競爭,這些成功的模型和算法主要是由監(jiān)督學(xué)習(xí)推動的,而監(jiān)督學(xué)習(xí)對數(shù)據(jù)極度饑渴,需要海量數(shù)據(jù)(大數(shù)據(jù))支撐來達(dá)到應(yīng)用的精準(zhǔn)要求。而人工智能發(fā)展更趨向于

2018-05-11 09:12:00 13047

13047 具有深度學(xué)習(xí)模型的嵌入式系統(tǒng)應(yīng)用程序帶來了巨大的好處。深度學(xué)習(xí)嵌入式系統(tǒng)已經(jīng)改變了各個行業(yè)的企業(yè)和組織。深度學(xué)習(xí)模型可以幫助實現(xiàn)工業(yè)流程自動化,進(jìn)行實時分析以做出決策,甚至可以預(yù)測預(yù)警。這些AI

2021-10-27 06:34:15

一:深度學(xué)習(xí)DeepLearning實戰(zhàn)時間地點:1 月 15日— 1 月18 日二:深度強(qiáng)化學(xué)習(xí)核心技術(shù)實戰(zhàn)時間地點: 1 月 27 日— 1 月30 日(第一天報到 授課三天;提前環(huán)境部署 電腦

2021-01-09 17:01:54

深度學(xué)習(xí)常用模型有哪些?深度學(xué)習(xí)常用軟件工具及平臺有哪些?深度學(xué)習(xí)存在哪些問題?

2021-10-14 08:20:47

一:深度學(xué)習(xí)DeepLearning實戰(zhàn)時間地點:1 月 15日— 1 月18 日二:深度強(qiáng)化學(xué)習(xí)核心技術(shù)實戰(zhàn)時間地點: 1 月 27 日— 1 月30 日(第一天報到 授課三天;提前環(huán)境部署 電腦

2021-01-10 13:42:26

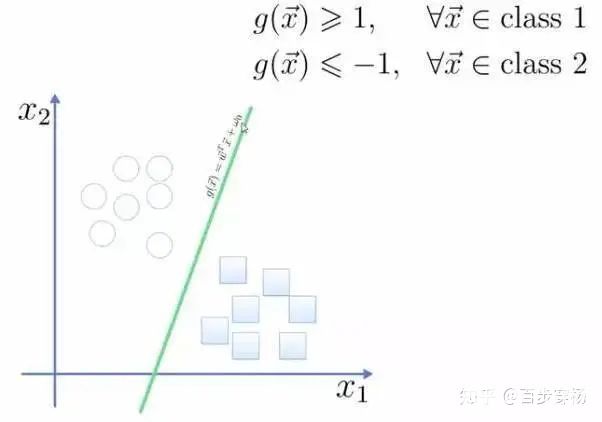

經(jīng)典機(jī)器學(xué)習(xí)算法介紹章節(jié)目標(biāo):機(jī)器學(xué)習(xí)是人工智能的重要技術(shù)之一,詳細(xì)了解機(jī)器學(xué)習(xí)的原理、機(jī)制和方法,為學(xué)習(xí)深度學(xué)習(xí)與遷移學(xué)習(xí)打下堅實的基礎(chǔ)。二、深度學(xué)習(xí)簡介與經(jīng)典網(wǎng)絡(luò)結(jié)構(gòu)介紹 神經(jīng)網(wǎng)絡(luò)簡介神經(jīng)網(wǎng)絡(luò)組件簡介

2022-04-21 15:15:11

學(xué)習(xí),也就是現(xiàn)在最流行的深度學(xué)習(xí)領(lǐng)域,關(guān)注論壇的朋友應(yīng)該看到了,開發(fā)板試用活動中有【NanoPi K1 Plus試用】的申請,介紹中NanopiK1plus的高大上優(yōu)點之一就是“可運行深度學(xué)習(xí)算法的智能

2018-06-04 22:32:12

處理器,最新一代的TDA4處理器在算例上得到了大幅提高的同時,在軟件方面提供了更好地支持,同時提供了更多的深度學(xué)習(xí)模型的部署示例,方便開發(fā)人員快速開發(fā)迭代產(chǎn)品,極大地縮短的產(chǎn)品開發(fā)周期。圖1. TIDL

2022-11-03 06:53:11

安裝labview2019 vision,自帶深度學(xué)習(xí)推理工具,支持tensorflow模型。配置好python下tensorflow環(huán)境配置好object_detection API下載SSD模型

2020-08-16 17:21:38

本帖最后由 wcl86 于 2021-9-9 10:39 編輯

`labview調(diào)用深度學(xué)習(xí)tensorflow模型非常簡單,效果如下,附上源碼和訓(xùn)練過的模型:[hide][/hide

2021-06-03 16:38:25

`? GAN 是什么?:Generative Adversarial Network我們可以這樣定義:“對抗生成網(wǎng)絡(luò)(GAN)是一種深度學(xué)習(xí)模型,模型通過框架中至少兩個框架:生成模型和判別模型的互相

2021-07-01 10:53:46

基于FPGA的數(shù)據(jù)中心CNN算法加速(Ovtcharov et al.)4. 未來展望深度學(xué)習(xí)的未來不管是就FPGA還是總體而言,主要取決于可擴(kuò)展性。要讓這些技術(shù)成功解決未來的問題,必須要拓展到能夠支持

2018-08-13 09:33:30

當(dāng)被賦予了相應(yīng)的智能性之后,數(shù)字工廠就具有足夠的靈活性,能夠根據(jù)新的及變化中的要求快速、動態(tài)地調(diào)整生產(chǎn)線。這種配置正在有效提高工廠的效率和吞吐量。但是這僅僅是個開始。實現(xiàn)真正的產(chǎn)業(yè)融合取決于以下四個關(guān)鍵領(lǐng)域的技術(shù)進(jìn)步

2019-07-30 07:55:14

,Deep Learning—遷移學(xué)習(xí)5,Deep Learning—深度強(qiáng)化學(xué)習(xí)6,深度學(xué)習(xí)的常用模型或者方法深度學(xué)習(xí)交流大群: 372526178 (資料共享,加群備注楊春嬌邀請)

2018-09-05 10:22:34

深度學(xué)習(xí)是什么意思

2020-11-11 06:58:03

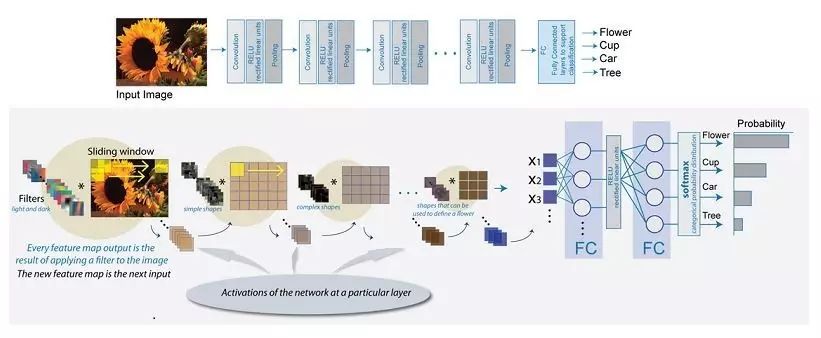

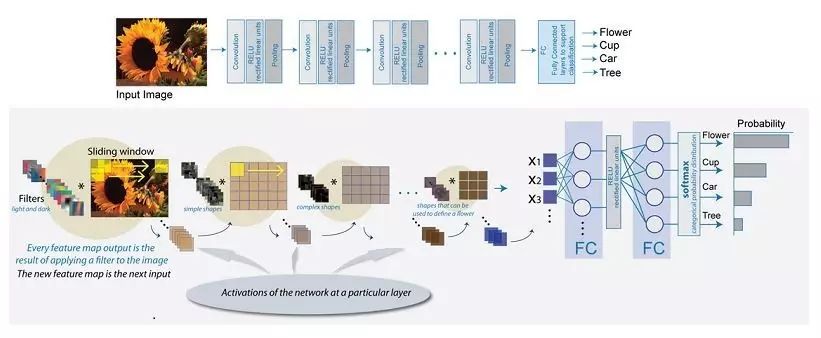

什么是深度學(xué)習(xí)為了解釋深度學(xué)習(xí),有必要了解神經(jīng)網(wǎng)絡(luò)。神經(jīng)網(wǎng)絡(luò)是一種模擬人腦的神經(jīng)元和神經(jīng)網(wǎng)絡(luò)的計算模型。作為具體示例,讓我們考慮一個輸入圖像并識別圖像中對象類別的示例。這個例子對應(yīng)機(jī)器學(xué)習(xí)中的分類

2023-02-17 16:56:59

智能鎖能輸入指紋的多少,主要取決于智能鎖儲存空間的大小,儲存空間越大,能錄入的指紋數(shù)量越多;區(qū)別也是在于儲存空間大小的區(qū)別。同時儲存空間的大小,也限制著儲存開鎖記錄的條數(shù)。 一般家庭可錄入300枚

2018-09-21 16:39:05

經(jīng)典機(jī)器學(xué)習(xí)算法介紹章節(jié)目標(biāo):機(jī)器學(xué)習(xí)是人工智能的重要技術(shù)之一,詳細(xì)了解機(jī)器學(xué)習(xí)的原理、機(jī)制和方法,為學(xué)習(xí)深度學(xué)習(xí)與遷移學(xué)習(xí)打下堅實的基礎(chǔ)。二、深度學(xué)習(xí)簡介與經(jīng)典網(wǎng)絡(luò)結(jié)構(gòu)介紹神經(jīng)網(wǎng)絡(luò)簡介神經(jīng)網(wǎng)絡(luò)組件簡介

2022-04-28 18:56:07

`請問極限頻率到底取決于什么?`

2019-08-23 16:34:41

芯片的速度取決于哪幾個方面?CPU和GPU擅長和不擅長的地方看了就知道

2021-04-06 09:05:14

請教大神電機(jī)的磁通取決于電壓還是取決于電流?為什么?

2023-03-02 10:36:18

誰來闡述一下集成電路的工作速度主要取決于什么?

2020-04-09 16:59:51

市場分析:OLED成敗取決于市場

索尼公司日前宣布,由于滯銷的原因,該公司已決定從3月底開始停止在日本供應(yīng)其于2007年推出的11

2010-04-06 13:24:02 528

528 機(jī)床的精度大致取決于五個方面:設(shè)計、材料、加工、裝配、使用。 設(shè)計方面,包括機(jī)械部分和電氣控制部分,需要有基礎(chǔ)的知識技術(shù),有思考推斷的深度,有積累的經(jīng)驗和反饋,還需要有團(tuán)隊的合作與互補(bǔ)。這些不是單純

2017-09-29 11:16:30 3

3 聲譽(yù)卓著。在此前接受CSDN采訪時,楊強(qiáng)介紹了他目前的主要工作致力于一個將深度學(xué)習(xí)、強(qiáng)化學(xué)習(xí)和遷移學(xué)習(xí)有機(jī)結(jié)合的Reinforcement Transfer Learning(RTL)體系的研究。那么,這個技術(shù)框架對工業(yè)界的實際應(yīng)用有什么用的實際意義?在本文中,CSDN結(jié)合楊強(qiáng)的另外一個身份國內(nèi)人工智能創(chuàng)業(yè)

2017-10-09 18:23:18 0

0 模型驅(qū)動的深度學(xué)習(xí)方法近年來,深度學(xué)習(xí)在人工智能領(lǐng)域一系列困難問題上取得了突破性成功應(yīng)用。

2018-01-24 11:30:13 5356

5356

為提高低配置計算環(huán)境中的視覺目標(biāo)實時在線分類特征提取的時效性和分類準(zhǔn)確率,提出一種新的目標(biāo)分類特征深度學(xué)習(xí)模型。根據(jù)高時效性要求,選用分類器模型離線深度學(xué)習(xí)的策略,以節(jié)約在線訓(xùn)練時間。針對網(wǎng)絡(luò)深度

2018-03-20 17:30:42 0

0 日本富士通也針對AI及HPC應(yīng)用自行開發(fā)特殊應(yīng)用芯片(ASIC),包括專為AI深度學(xué)習(xí)量身打造的DLU深度學(xué)習(xí)專用芯片,以及針對新一代Post京(Post-K)超級電腦設(shè)計的ARM架構(gòu)HPC芯片。

2018-05-24 10:39:45 4926

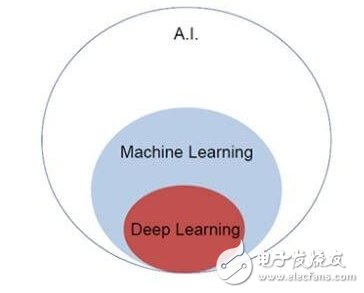

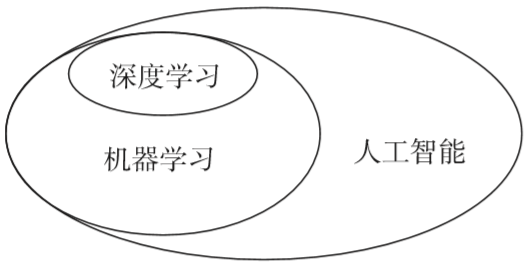

4926 深度學(xué)習(xí)屬于機(jī)器學(xué)習(xí)的一個子域,其相關(guān)算法受到大腦結(jié)構(gòu)與功能(即人工神經(jīng)網(wǎng)絡(luò))的啟發(fā)。深度學(xué)習(xí)如今的全部價值皆通過監(jiān)督式學(xué)習(xí)或經(jīng)過標(biāo)記的數(shù)據(jù)及算法實現(xiàn)。深度學(xué)習(xí)中的每種算法皆經(jīng)過相同的學(xué)習(xí)過程。深度學(xué)習(xí)包含輸入內(nèi)容的非近線變換層級結(jié)構(gòu),可用于創(chuàng)建統(tǒng)計模型并輸出對應(yīng)結(jié)果。

2018-06-23 12:25:00 82103

82103

近年來,隨著深度學(xué)習(xí)在圖像視覺領(lǐng)域的發(fā)展,一類基于單純的深度學(xué)習(xí)模型的點云目標(biāo)檢測方法被提出和應(yīng)用,本文將詳細(xì)介紹其中一種模型——SqueezeSeg,并且使用ROS實現(xiàn)該模型的實時目標(biāo)檢測。

2018-11-05 16:47:29 18783

18783 AutoDL降低門檻,支持深度學(xué)習(xí)設(shè)計、遷移、適配,使得沒有大數(shù)據(jù)、大算力的工程師團(tuán)隊也能直接使用深度學(xué)習(xí)網(wǎng)絡(luò),從而實現(xiàn)高效定制。據(jù)介紹,機(jī)器自動構(gòu)建的深度學(xué)習(xí)網(wǎng)絡(luò)已經(jīng)全面超越專家手工設(shè)計。AutoDL 2.0 Transfer則可以大幅提高原有模型能力,有效支持小數(shù)據(jù)AI建模。

2018-11-05 17:21:37 10895

10895 對于設(shè)計和集成智能視頻分析(IVA)端應(yīng)用程序(如停車管理、安全基礎(chǔ)設(shè)施、零售分析、物流管理和訪問控制等)的開發(fā)人員,NVIDIA 的遷移學(xué)習(xí)工具包提供了端到端的深度學(xué)習(xí)工作流,可以加速深度學(xué)習(xí)訓(xùn)練

2018-12-07 14:45:47 3739

3739 我現(xiàn)在開始認(rèn)為,無監(jiān)督學(xué)習(xí)和元學(xué)習(xí)實際上是同一個問題。進(jìn)化解決這個問題的方法是通過踏腳石(stepping stone )技能的發(fā)展。這意味著它完全取決于正在解決的問題的類型:是用于預(yù)測,自助控制

2018-12-10 09:31:09 3389

3389 展示幾種最先進(jìn)的通用句子嵌入編碼器,特別是在遷移學(xué)習(xí)任務(wù)的少量數(shù)據(jù)上與 Word embedding 模型相比的情況下,它們往往會給出令人驚訝的良好性能。

2018-12-13 15:52:19 3519

3519 具體來看,對于傳統(tǒng)的機(jī)器學(xué)習(xí)算法,模型的表現(xiàn)先是遵循冪定律(power law),之后趨于平緩;而對于深度學(xué)習(xí),該問題還在持續(xù)不斷地研究中,不過圖一為目前較為一致的結(jié)論,即隨著數(shù)據(jù)規(guī)模的增長,深度

2019-05-05 11:03:31 7090

7090 目前在深度學(xué)習(xí)領(lǐng)域分類兩個派別,一派為學(xué)院派,研究強(qiáng)大、復(fù)雜的模型網(wǎng)絡(luò)和實驗方法,為了追求更高的性能;另一派為工程派,旨在將算法更穩(wěn)定、高效的落地在硬件平臺上,效率是其追求的目標(biāo)。復(fù)雜的模型固然具有

2019-06-08 17:26:00 6000

6000

把我們當(dāng)前要處理的NLP任務(wù)叫做T(T稱為目標(biāo)任務(wù)),遷移學(xué)習(xí)技術(shù)做的事是利用另一個任務(wù)S(S稱為源任務(wù))來提升任務(wù)T的效果,也即把S的信息遷移到T中。至于怎么遷移信息就有很多方法了,可以直接利用S的數(shù)據(jù),也可以利用在S上訓(xùn)練好的模型,等等。

2019-07-18 11:29:47 8597

8597

訓(xùn)練 CNN 需要相當(dāng)大量的數(shù)據(jù),因為對于典型的圖像分類問題,其需要學(xué)習(xí)幾百萬個權(quán)值。從頭開始訓(xùn)練 CNN 的另一個常見做法是使用預(yù)先訓(xùn)練好的模型自動從新的數(shù)據(jù)集提取特征。這種方法稱為遷移學(xué)習(xí),是一種應(yīng)用深度學(xué)習(xí)的便捷方式,其無需龐大的數(shù)據(jù)集以及長時間的訓(xùn)練。

2019-09-16 15:11:20 6344

6344

在Cortex,用戶推出了基于深度學(xué)習(xí)的新一代產(chǎn)品,與以前不同的是,這些產(chǎn)品并非都是使用獨一無二的模型架構(gòu)構(gòu)建的。

2020-03-19 20:08:58 950

950 3月25日下午,中國人工智能領(lǐng)軍企業(yè)曠視科技舉辦線上發(fā)布會,正式宣布開源新一代AI生產(chǎn)力平臺Brain++的核心深度學(xué)習(xí)框架曠視天元(MegEngine),成為全球首個將底層框架開源的人工智能企業(yè)。

2020-03-26 11:50:06 4214

4214 生成的數(shù)據(jù)生成準(zhǔn)確的預(yù)測。這些新數(shù)據(jù)示例可能是用戶交互、應(yīng)用處理或其他軟件系統(tǒng)的請求生成的——這取決于模型需要解決的問題。在理想情況下,我們會希望自己的模型在生產(chǎn)環(huán)境中進(jìn)行預(yù)測時,能夠像使用訓(xùn)練過程中使用

2020-04-10 08:00:00 0

0 的分析識別更是研究的重中之重。近年來深 10 度學(xué)習(xí)模型的廣泛發(fā)展和計算能力的大幅提升對語音識別技術(shù)的提升起到了關(guān)鍵作用。本文立足于語音識別與深度學(xué)習(xí)理論緊密結(jié)合,針對如何利用深度學(xué)習(xí)模型搭建區(qū)分能力更強(qiáng)魯棒性更

2020-05-09 08:00:00 41

41 樣本滿足獨立同分布的條件;(2) 必須有足夠可利用的訓(xùn)練樣本才能學(xué)習(xí)得到一個好的分類模型。目的是遷移已有的知識來解決目標(biāo)領(lǐng)域中僅有少量有標(biāo)簽樣本數(shù)據(jù)甚至沒有的學(xué)習(xí)問題。對遷移學(xué)習(xí)算法的研究以及相關(guān)理論研究的進(jìn)展進(jìn)行

2020-07-17 08:00:00 0

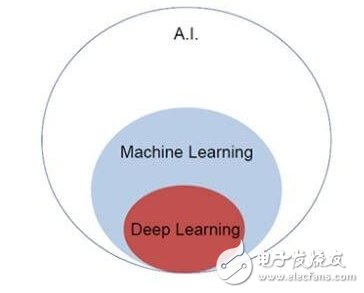

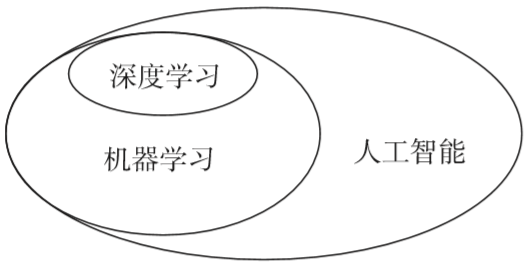

0 “機(jī)器學(xué)習(xí)”“人工智能”“深度學(xué)習(xí)”這三個詞常常被人混淆,但其實它們出現(xiàn)的時間相隔甚遠(yuǎn),“人工智能”(Artificial Intelligence,AI)出現(xiàn)于20世紀(jì)50年代,“機(jī)器學(xué)習(xí)

2021-01-03 15:29:00 8939

8939

詞常常被人混淆,但其實它們出現(xiàn)的時間相隔甚遠(yuǎn),“人工智能”(Artificial Intelligence,AI)出現(xiàn)于20世紀(jì)50年代,“機(jī)器學(xué)習(xí)”(Machine Learning,ML)出現(xiàn)于20世紀(jì)80年代,而“深度學(xué)習(xí)”(Deep Learning,DL)則是近些年才出現(xiàn)的。三者是包

2021-01-12 17:17:00 4626

4626 深度學(xué)習(xí)作為人工智能技術(shù)的重要組成部分,被廣泛應(yīng)用于計算機(jī)視覺和自然語言處理等領(lǐng)域。盡管深度學(xué)習(xí)在圖像分類和目標(biāo)檢測等任務(wù)中取得了較好性能,但是對抗攻擊的存在對深度學(xué)習(xí)模型的安全應(yīng)用構(gòu)成了潛在威脅

2021-03-12 13:45:53 78

78 深度學(xué)習(xí)是機(jī)器學(xué)習(xí)和人工智能研究的最新趨勢,作為一個十余年來快速發(fā)展的嶄新領(lǐng)域,越來越受到研究者的關(guān)注。卷積神經(jīng)網(wǎng)絡(luò)(CNN)模型是深度學(xué)習(xí)模型中最重要的一種經(jīng)典結(jié)構(gòu),其性能在近年來深度學(xué)習(xí)任務(wù)上

2021-04-02 15:29:04 21

21 深度模型中的優(yōu)化與學(xué)習(xí)課件下載

2021-04-07 16:21:01 3

3 圖像修復(fù)是計算機(jī)視覺領(lǐng)域中極具挑戰(zhàn)性的硏究課題。近年來,深度學(xué)習(xí)技術(shù)的發(fā)展推動了圖像修復(fù)性能的顯著提升,使得圖像修復(fù)這一傳統(tǒng)課題再次引起了學(xué)者們的廣泛關(guān)注。文章致力于綜述圖像修復(fù)研究的關(guān)鍵技術(shù)。由于

2021-04-08 09:38:00 20

20 獲得大量數(shù)據(jù),因此為搭建新領(lǐng)域的深度學(xué)習(xí)模型提出了挑戰(zhàn)。遷移學(xué)習(xí)是深度學(xué)習(xí)的一種特殊應(yīng)用,在遷移學(xué)習(xí)中,能夠利用源堿和目標(biāo)域完成對只有少量標(biāo)注數(shù)據(jù)的目標(biāo)堿模型的構(gòu)建,通過對源域和目標(biāo)域之間的知識遷移完成學(xué)習(xí)過

2021-04-12 11:18:34 4

4 機(jī)器學(xué)習(xí) (ML) 模型的性能既取決于學(xué)習(xí)算法,也取決于用于訓(xùn)練和評估的數(shù)據(jù)。算法的作用已經(jīng)得到充分研究,也是眾多挑戰(zhàn)(如 SQuAD、GLUE、ImageNet 等)的焦點。此外,數(shù)據(jù)也已經(jīng)過改進(jìn)

2021-04-13 14:37:16 3191

3191 為了提高駕駛分心識別的應(yīng)用性及識別模型的可解釋性,利用遷移學(xué)習(xí)方法硏究構(gòu)建駕駛?cè)笋{駛分心行為識別模型并采用神經(jīng)網(wǎng)絡(luò)可視化技術(shù)硏究對模型進(jìn)行解釋。以ⅤGσ-6模型為基礎(chǔ),對原模型全連接層進(jìn)行修改以適應(yīng)

2021-04-30 13:46:51 10

10 基于評分矩陣與評論文本的深度學(xué)習(xí)模型

2021-06-24 11:20:30 58

58 基于深度學(xué)習(xí)的文本主題模型研究綜述

2021-06-24 11:49:18 68

68 基于WordNet模型的遷移學(xué)習(xí)文本特征對齊算法

2021-06-27 16:14:43 8

8 結(jié)合基擴(kuò)展模型和深度學(xué)習(xí)的信道估計方法

2021-06-30 10:43:39 63

63 本文大致介紹將深度學(xué)習(xí)算法模型移植到海思AI芯片的總體流程和一些需要注意的細(xì)節(jié)。海思芯片移植深度學(xué)習(xí)算法模型,大致分為模型轉(zhuǎn)換,...

2022-01-26 19:42:35 11

11 了一種基于時頻分析、深度學(xué)習(xí)和遷移學(xué)習(xí)融合模型的雷達(dá)信號自動分選識別算法。首先通過引入的多重同步壓縮變換得到雷達(dá)信號的時頻圖像,然后利用灰度化、維納濾波、雙三次插值法和歸一化等手段對時頻圖像進(jìn)行預(yù)處理,最后基于遷移

2022-03-02 17:35:02 2320

2320 摘要: 標(biāo)簽比例學(xué)習(xí)問題是一項僅使用樣本標(biāo)簽比例信息去構(gòu)建分類模型的挖掘任務(wù),由于訓(xùn)練樣本不充分,現(xiàn)有方法將該問題視為單一任務(wù),在文本分類中的表現(xiàn)并不理想。考慮到遷移學(xué)習(xí)在一定程度上能解決訓(xùn)練數(shù)據(jù)

2022-03-30 15:46:31 784

784 學(xué)習(xí)中的“深度”一詞表示用于識別數(shù)據(jù)模式的多層算法或神經(jīng)網(wǎng)絡(luò)。DL 高度靈活的架構(gòu)可以直接從原始數(shù)據(jù)中學(xué)習(xí),這類似于人腦的運作方式,獲得更多數(shù)據(jù)后,其預(yù)測準(zhǔn)確度也將隨之提升。? ? 此外,深度學(xué)習(xí)是在語音識別、語言翻譯和

2022-04-01 10:34:10 13161

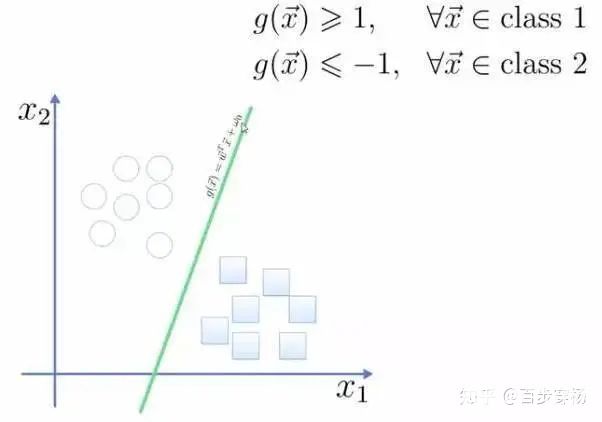

13161 問題的分類 經(jīng)典機(jī)器學(xué)習(xí)算法介紹 章節(jié)目標(biāo):機(jī)器學(xué)習(xí)是人工智能的重要技術(shù)之一,詳細(xì)了解機(jī)器學(xué)習(xí)的原理、機(jī)制和方法,為學(xué)習(xí)深度學(xué)習(xí)與遷移學(xué)習(xí)打下堅實的基礎(chǔ)。 二、深度學(xué)習(xí)簡介與經(jīng)典網(wǎng)絡(luò)結(jié)構(gòu)介紹 神經(jīng)網(wǎng)絡(luò)簡介 神經(jīng)網(wǎng)絡(luò)組件簡介 神經(jīng)網(wǎng)絡(luò)訓(xùn)練方法 卷積神經(jīng)網(wǎng)絡(luò)介

2022-04-28 17:13:01 2208

2208

前面我們花了很多力氣在 TAO 上面訓(xùn)練模型,其最終目的就是要部署到推理設(shè)備上發(fā)揮功能。除了將模型訓(xùn)練過程進(jìn)行非常大幅度的簡化,以及整合遷移學(xué)習(xí)等功能之外,TAO 還有一個非常重要的任務(wù),就是讓我們更輕松獲得 TensorRT 加速引擎。

2022-05-25 11:24:17 3296

3296 與此同時,Boaz Barak 通過展示擬合統(tǒng)計模型和學(xué)習(xí)數(shù)學(xué)這兩個不同的場景案例,探討其與深度學(xué)習(xí)的匹配性;他認(rèn)為,雖然深度學(xué)習(xí)的數(shù)學(xué)和代碼與擬合統(tǒng)計模型幾乎相同,但在更深層次上,深度學(xué)習(xí)中的極大部分都可在“向?qū)W生傳授技能”場景中被捕獲。

2022-08-09 10:01:10 1648

1648 雖然大多數(shù)深度學(xué)習(xí)模型都是在 Linux 系統(tǒng)上訓(xùn)練的,但 Windows 也是一個非常重要的系統(tǒng),也可能是很多機(jī)器學(xué)習(xí)初學(xué)者更為熟悉的系統(tǒng)。要在 Windows 上開發(fā)模型,首先當(dāng)然是配置開發(fā)環(huán)境

2022-11-08 10:57:44 2322

2322 與傳統(tǒng)機(jī)器學(xué)習(xí)相比,深度學(xué)習(xí)是從數(shù)據(jù)中學(xué)習(xí),而大模型則是通過使用大量的模型來訓(xùn)練數(shù)據(jù)。深度學(xué)習(xí)可以處理任何類型的數(shù)據(jù),例如圖片、文本等等;但是這些數(shù)據(jù)很難用機(jī)器完成。大模型可以訓(xùn)練更多類別、多個級別的模型,因此可以處理更廣泛的類型。另外:在使用大模型時,可能需要一個更全面或復(fù)雜的數(shù)學(xué)和數(shù)值計算的支持。

2023-02-16 11:32:37 2833

2833 使用SOTA的預(yù)訓(xùn)練模型來通過遷移學(xué)習(xí)解決現(xiàn)實的計算機(jī)視覺問題。

2023-04-23 18:08:41 2840

2840

引導(dǎo)(TOAST),這是一種新的遷移學(xué)習(xí)算法,它可以凍結(jié)預(yù)先訓(xùn)練的骨干模型,選擇與任務(wù)相關(guān)的特征輸出,并將這些特征反饋到模型中,以引導(dǎo)注意力關(guān)注特定任務(wù)的特征。僅通過重新聚焦注意力,TOAST在多個遷移

2023-08-11 16:56:17 7738

7738

深度學(xué)習(xí)是什么領(lǐng)域? 深度學(xué)習(xí)是機(jī)器學(xué)習(xí)的一種子集,由多層神經(jīng)網(wǎng)絡(luò)組成。它是一種自動學(xué)習(xí)技術(shù),可以從數(shù)據(jù)中學(xué)習(xí)高層次的抽象模型,以進(jìn)行推斷和預(yù)測。深度學(xué)習(xí)廣泛應(yīng)用于計算機(jī)視覺、語音識別、自然語言處理

2023-08-17 16:02:59 3480

3480 什么是深度學(xué)習(xí)算法?深度學(xué)習(xí)算法的應(yīng)用 深度學(xué)習(xí)算法被認(rèn)為是人工智能的核心,它是一種模仿人類大腦神經(jīng)元的計算模型。深度學(xué)習(xí)是機(jī)器學(xué)習(xí)的一種變體,主要通過變換各種架構(gòu)來對大量數(shù)據(jù)進(jìn)行學(xué)習(xí)以及分類處理

2023-08-17 16:03:04 3075

3075 深度學(xué)習(xí)框架是什么?深度學(xué)習(xí)框架有哪些?? 深度學(xué)習(xí)框架是一種軟件工具,它可以幫助開發(fā)者輕松快速地構(gòu)建和訓(xùn)練深度神經(jīng)網(wǎng)絡(luò)模型。與手動編寫代碼相比,深度學(xué)習(xí)框架可以大大減少開發(fā)和調(diào)試的時間和精力,并提

2023-08-17 16:03:09 3886

3886 深度學(xué)習(xí)框架的作用是什么 深度學(xué)習(xí)是一種計算機(jī)技術(shù),它利用人工神經(jīng)網(wǎng)絡(luò)來模擬人類的學(xué)習(xí)過程。由于其高度的精確性和精度,深度學(xué)習(xí)已成為現(xiàn)代計算機(jī)科學(xué)領(lǐng)域的重要工具。然而,要在深度學(xué)習(xí)中實現(xiàn)高度復(fù)雜

2023-08-17 16:10:57 2408

2408 。TensorFlow可以用于各種不同的任務(wù),包括圖像和語音識別、自然語言處理和推薦系統(tǒng)等。 TensorFlow提供了一個靈活和強(qiáng)大的平臺,可以用于構(gòu)建和訓(xùn)練各種深度學(xué)習(xí)模型。TensorFlow的核心是一個

2023-08-17 16:11:02 3410

3410 深度學(xué)習(xí)框架連接技術(shù) 深度學(xué)習(xí)框架是一個能夠幫助機(jī)器學(xué)習(xí)和人工智能開發(fā)人員輕松進(jìn)行模型訓(xùn)練、優(yōu)化及評估的軟件庫。深度學(xué)習(xí)框架連接技術(shù)則是需要使用深度學(xué)習(xí)模型的應(yīng)用程序必不可少的技術(shù),通過連接技術(shù)

2023-08-17 16:11:16 1355

1355 深度學(xué)習(xí)框架和深度學(xué)習(xí)算法教程 深度學(xué)習(xí)是機(jī)器學(xué)習(xí)領(lǐng)域中的一個重要分支,多年來深度學(xué)習(xí)一直在各個領(lǐng)域的應(yīng)用中發(fā)揮著極其重要的作用,成為了人工智能技術(shù)的重要組成部分。許多深度學(xué)習(xí)算法和框架提供了

2023-08-17 16:11:26 1829

1829 。因此,深度學(xué)習(xí)服務(wù)器逐漸成為了人們進(jìn)行深度學(xué)習(xí)實驗的必要工具。本文將介紹深度學(xué)習(xí)服務(wù)器的DIY,并討論如何選擇主板。 一、深度學(xué)習(xí)服務(wù)器的DIY 1.選擇適合的處理器 深度學(xué)習(xí)對處理器的要求非常高,因為訓(xùn)練一個深度學(xué)習(xí)模型需要進(jìn)行

2023-08-17 16:11:29 1414

1414 深度學(xué)習(xí)(Deep Learning)是一種基于人工神經(jīng)網(wǎng)絡(luò)的機(jī)器學(xué)習(xí)算法,其主要特點是模型由多個隱層組成,可以自動地學(xué)習(xí)特征,并進(jìn)行預(yù)測或分類。該算法在計算機(jī)視覺、語音識別、自然語言處理、推薦系統(tǒng)和數(shù)據(jù)挖掘等領(lǐng)域被廣泛應(yīng)用,成為機(jī)器學(xué)習(xí)領(lǐng)域的一種重要分支。

2023-08-21 18:22:53 6209

6209 機(jī)器學(xué)習(xí)和深度學(xué)習(xí)是當(dāng)今最流行的人工智能(AI)技術(shù)之一。這兩種技術(shù)都有助于在不需要人類干預(yù)的情況下讓計算機(jī)自主學(xué)習(xí)和改進(jìn)預(yù)測模型。本文將探討機(jī)器學(xué)習(xí)和深度學(xué)習(xí)的概念以及二者之間的區(qū)別。

2023-08-28 17:31:09 2257

2257 Torchvision是基于Pytorch的視覺深度學(xué)習(xí)遷移學(xué)習(xí)訓(xùn)練框架,當(dāng)前支持的圖像分類、對象檢測、實例分割、語義分割、姿態(tài)評估模型的遷移學(xué)習(xí)訓(xùn)練與評估。支持對數(shù)據(jù)集的合成、變換、增強(qiáng)等,此外還支持預(yù)訓(xùn)練模型庫下載相關(guān)的模型,直接預(yù)測推理。

2023-09-22 09:49:51 1906

1906

深度學(xué)習(xí)作為機(jī)器學(xué)習(xí)的一個分支,其學(xué)習(xí)方法可以分為監(jiān)督學(xué)習(xí)和無監(jiān)督學(xué)習(xí)。兩種方法都具有其獨特的學(xué)習(xí)模型:多層感知機(jī) 、卷積神經(jīng)網(wǎng)絡(luò)等屬于監(jiān) 督學(xué)習(xí);深度置信網(wǎng) 、自動編碼器 、去噪自動編碼器 、稀疏編碼等屬于無監(jiān)督學(xué)習(xí)。

2023-10-09 10:23:42 1153

1153

算法工程、數(shù)據(jù)派THU深度學(xué)習(xí)在近年來得到了廣泛的應(yīng)用,從圖像識別、語音識別到自然語言處理等領(lǐng)域都有了卓越的表現(xiàn)。但是,要訓(xùn)練出一個高效準(zhǔn)確的深度學(xué)習(xí)模型并不容易。不僅需要有高質(zhì)量的數(shù)據(jù)、合適的模型

2023-12-07 12:38:24 1884

1884

性能重大提升的背后往往是模型設(shè)計的改變。不過有些時候?qū)?b class="flag-6" style="color: red">模型進(jìn)行微調(diào)也可以提升機(jī)器學(xué)習(xí)的性能。最終的判斷可能會取決于你對相應(yīng)任務(wù)的基準(zhǔn)測試結(jié)果。

2024-01-11 10:49:48 670

670

導(dǎo)讀深度學(xué)習(xí)是機(jī)器學(xué)習(xí)的一個子集,已成為人工智能領(lǐng)域的一項變革性技術(shù),在從計算機(jī)視覺、自然語言處理到自動駕駛汽車等廣泛的應(yīng)用中取得了顯著的成功。深度學(xué)習(xí)的有效性并非偶然,而是植根于幾個基本原則和進(jìn)步

2024-03-09 08:26:27 1302

1302

極化繼電器是一種電子元件,其狀態(tài)的改變取決于輸入信號的極性。在本文中,我們將詳細(xì)探討極化繼電器的工作原理、特性、應(yīng)用以及與其他類型的繼電器的比較。 極化繼電器的工作原理 極化繼電器是一種利用

2024-06-24 09:29:39 1507

1507 深度學(xué)習(xí)模型在訓(xùn)練過程中,往往會遇到各種問題和挑戰(zhàn),如過擬合、欠擬合、梯度消失或爆炸等。因此,對深度學(xué)習(xí)模型進(jìn)行優(yōu)化與調(diào)試是確保其性能優(yōu)越的關(guān)鍵步驟。本文將從數(shù)據(jù)預(yù)處理、模型設(shè)計、超參數(shù)調(diào)整、正則化、模型集成以及調(diào)試與驗證等方面,詳細(xì)介紹深度學(xué)習(xí)的模型優(yōu)化與調(diào)試方法。

2024-07-01 11:41:13 2534

2534 深度學(xué)習(xí)模型訓(xùn)練是一個復(fù)雜且關(guān)鍵的過程,它涉及大量的數(shù)據(jù)、計算資源和精心設(shè)計的算法。訓(xùn)練一個深度學(xué)習(xí)模型,本質(zhì)上是通過優(yōu)化算法調(diào)整模型參數(shù),使模型能夠更好地擬合數(shù)據(jù),提高預(yù)測或分類的準(zhǔn)確性。本文將

2024-07-01 16:13:10 4025

4025 在深度學(xué)習(xí)這一充滿無限可能性的領(lǐng)域中,模型權(quán)重(Weights)作為其核心組成部分,扮演著至關(guān)重要的角色。它們不僅是模型學(xué)習(xí)的基石,更是模型智能的源泉。本文將從模型權(quán)重的定義、作用、優(yōu)化、管理以及應(yīng)用等多個方面,深入探討深度學(xué)習(xí)中的模型權(quán)重。

2024-07-04 11:49:42 5570

5570 遷移學(xué)習(xí)(Transfer Learning)是機(jī)器學(xué)習(xí)領(lǐng)域中的一個重要概念,其核心思想是利用在一個任務(wù)或領(lǐng)域中學(xué)到的知識來加速或改進(jìn)另一個相關(guān)任務(wù)或領(lǐng)域的學(xué)習(xí)過程。這種方法在數(shù)據(jù)稀缺或領(lǐng)域遷移的情況下尤為有效,因為它能夠顯著減少對大量標(biāo)記數(shù)據(jù)的需求,提高模型的學(xué)習(xí)效率和泛化能力。

2024-07-04 17:30:11 4547

4547 預(yù)訓(xùn)練和遷移學(xué)習(xí)是深度學(xué)習(xí)和機(jī)器學(xué)習(xí)領(lǐng)域中的兩個重要概念,它們在提高模型性能、減少訓(xùn)練時間和降低對數(shù)據(jù)量的需求方面發(fā)揮著關(guān)鍵作用。本文將從定義、原理、應(yīng)用、區(qū)別和聯(lián)系等方面詳細(xì)探討預(yù)訓(xùn)練和遷移學(xué)習(xí)。

2024-07-11 10:12:42 2703

2703 深度學(xué)習(xí)模型量化是一種重要的模型輕量化技術(shù),旨在通過減少網(wǎng)絡(luò)參數(shù)的比特寬度來減小模型大小和加速推理過程,同時盡量保持模型性能。從而達(dá)到把模型部署到邊緣或者低算力設(shè)備上,實現(xiàn)降本增效的目標(biāo)。

2024-07-15 11:01:56 1728

1728

深度學(xué)習(xí)模型作為人工智能領(lǐng)域的重要分支,已經(jīng)在多個應(yīng)用場景中展現(xiàn)出其巨大的潛力和價值。這些應(yīng)用不僅改變了我們的日常生活,還推動了科技進(jìn)步和產(chǎn)業(yè)升級。以下將詳細(xì)探討深度學(xué)習(xí)模型的20個主要應(yīng)用場景,每個場景均涵蓋其具體應(yīng)用、技術(shù)原理、實現(xiàn)方式及未來發(fā)展趨勢。

2024-07-16 18:25:54 5624

5624 AI大模型與深度學(xué)習(xí)之間存在著密不可分的關(guān)系,它們互為促進(jìn),相輔相成。以下是對兩者關(guān)系的介紹: 一、深度學(xué)習(xí)是AI大模型的基礎(chǔ) 技術(shù)支撐 :深度學(xué)習(xí)是一種機(jī)器學(xué)習(xí)的方法,通過多層神經(jīng)網(wǎng)絡(luò)來模擬

2024-10-23 15:25:50 3785

3785 FPGA(現(xiàn)場可編程門陣列)加速深度學(xué)習(xí)模型是當(dāng)前硬件加速領(lǐng)域的一個熱門研究方向。以下是一些FPGA加速深度學(xué)習(xí)模型的案例: 一、基于FPGA的AlexNet卷積運算加速 項目名稱

2024-10-25 09:22:03 1857

1857 GPU在深度學(xué)習(xí)中的應(yīng)用廣泛且重要,以下是一些GPU深度學(xué)習(xí)應(yīng)用案例: 一、圖像識別 圖像識別是深度學(xué)習(xí)的核心應(yīng)用領(lǐng)域之一,GPU在加速圖像識別模型訓(xùn)練方面發(fā)揮著關(guān)鍵作用。通過利用GPU的并行計算

2024-10-27 11:13:45 2283

2283

電子發(fā)燒友App

電子發(fā)燒友App

評論