谷歌AI研究部門華人科學(xué)家再發(fā)論文《EfficientNet:重新思考CNN模型縮放》,模型縮放的傳統(tǒng)做法是任意增加CNN的深度和寬度,或使用更大的輸入圖像分辨率進(jìn)行訓(xùn)練,而使用EfficientNet使用一組固定額縮放系數(shù)統(tǒng)一縮放每個維度,超越了當(dāng)先最先進(jìn)圖像識別網(wǎng)絡(luò)的準(zhǔn)確率,效率提高了10倍,而且更小。

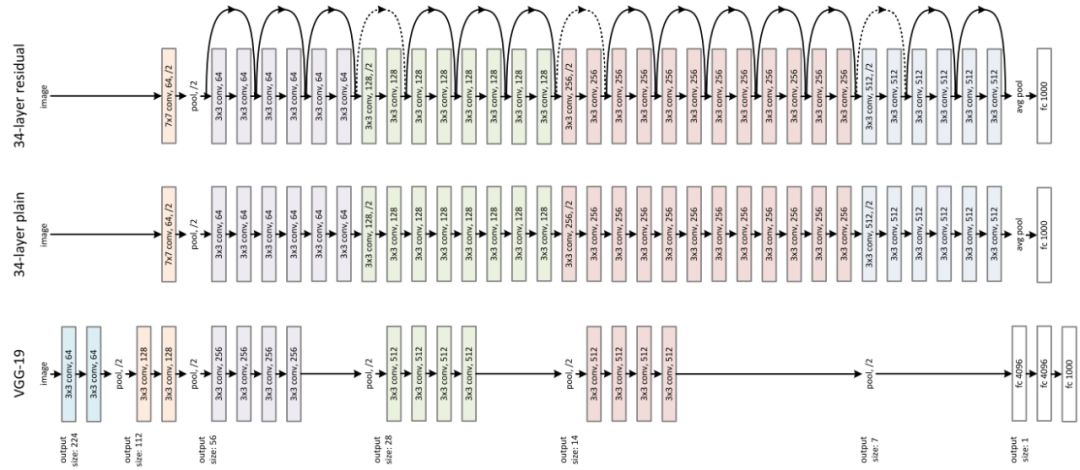

目前提高CNN精度的方法,主要是通過任意增加CNN深度或?qū)挾龋蚴褂酶蟮妮斎雸D像分辨率進(jìn)行訓(xùn)練和評估。

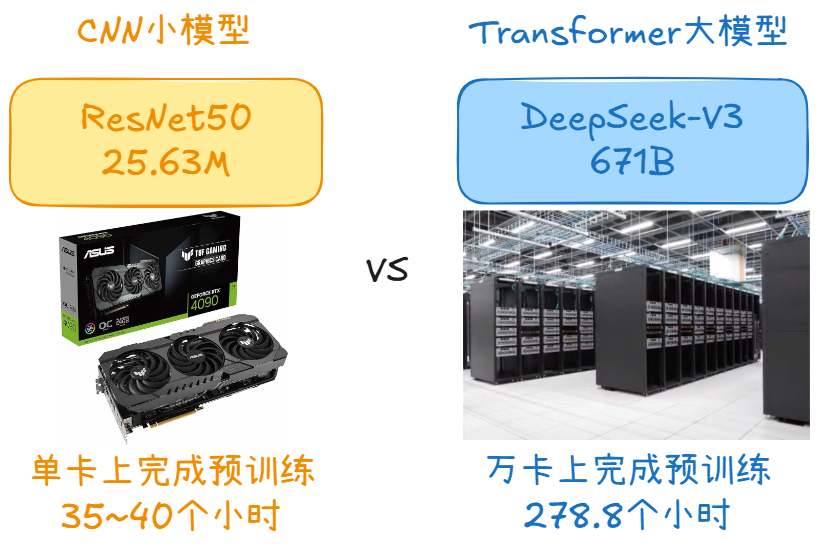

以固定的資源成本開發(fā),然后按比例放大,以便在獲得更多資源時實(shí)現(xiàn)更好的準(zhǔn)確性。例如ResNet可以通過增加層數(shù)從ResNet-18擴(kuò)展到ResNet-200。

再比如開源大規(guī)模神經(jīng)網(wǎng)絡(luò)模型高效訓(xùn)練庫GPipe,通過將基線CNN擴(kuò)展四倍來實(shí)現(xiàn)84.3% ImageNet top-1精度。

這種方法的優(yōu)勢在于確實(shí)可以提高精度,但劣勢也很明顯。這個時候往往需要進(jìn)行繁瑣的微調(diào)。一點(diǎn)點(diǎn)的摸黑去試、還經(jīng)常的徒勞無功。這絕對不是一件能夠讓人身心愉快的事情,對于谷歌科學(xué)家們也一樣。

這就是為什么,谷歌人工智能研究部門的科學(xué)家們正在研究一種新的“更結(jié)構(gòu)化”的方式,來“擴(kuò)展”卷積神經(jīng)網(wǎng)絡(luò)。他們給這個新的網(wǎng)絡(luò)命名為:EfficientNet(效率網(wǎng)絡(luò))。

代碼已開源,論文剛剛上線arXiv,并將在6月11日,作為poster亮相ICML 2019。

比現(xiàn)有卷積網(wǎng)絡(luò)小84倍,比GPipe快6.1倍

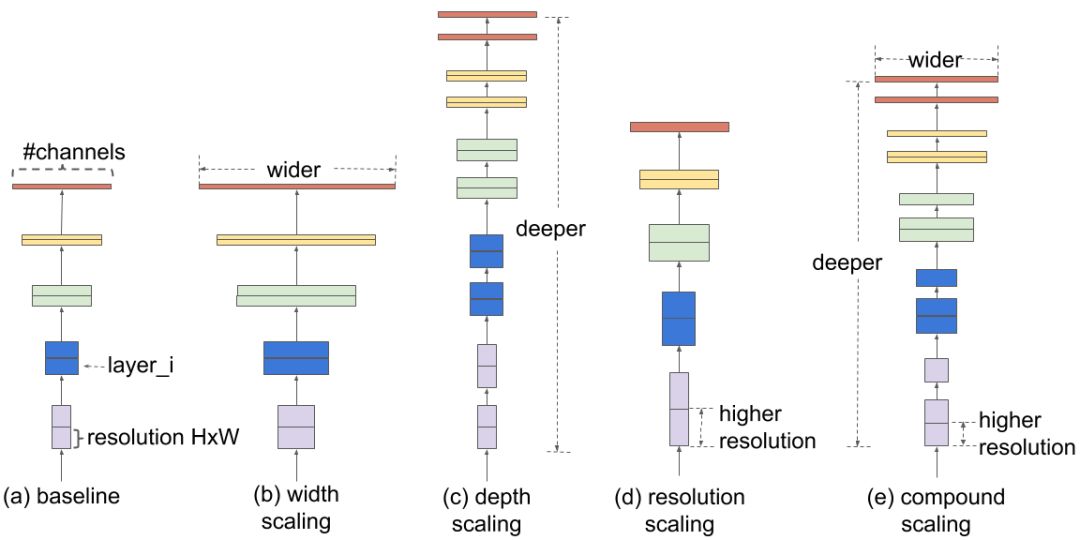

為了理解擴(kuò)展網(wǎng)絡(luò)的效果,谷歌的科學(xué)家系統(tǒng)地研究了縮放模型不同維度的影響。模型縮放并確定仔細(xì)平衡網(wǎng)絡(luò)深度后,發(fā)現(xiàn)只要對網(wǎng)絡(luò)的深度、寬度和分辨率進(jìn)行合理地平衡,就能帶來更好的性能。基于這一觀察,科學(xué)家提出了一種新的縮放方法,使用簡單但高效的復(fù)合系數(shù)均勻地縮放深度、寬度和分辨率的所有尺寸。

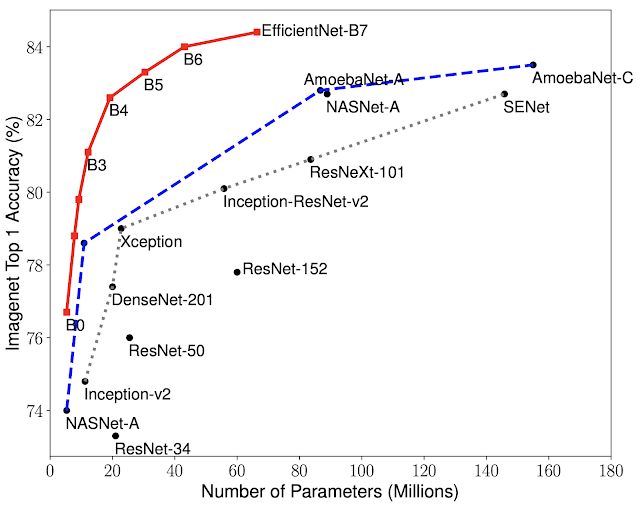

據(jù)悉,EfficientNet-B7在ImageNet上實(shí)現(xiàn)了最先進(jìn)精度的84.4% Top 1/97.1% Top 5,同時比最好的現(xiàn)有ConvNet小84倍,推理速度快6.1倍;在CIFAR-100(91.7%),F(xiàn)lower(98.8%)和其他3個遷移學(xué)習(xí)數(shù)據(jù)集上,也能很好地傳輸和實(shí)現(xiàn)最先進(jìn)的精度。參數(shù)減少一個數(shù)量級,效率卻提高了10倍(更小,更快)。

與流行的ResNet-50相比,另一款EfficientNet-B4使用了類似的FLOPS,同時將ResNet-50的最高精度從76.3%提高到82.6%。

這么優(yōu)秀的成績是如何做到的

這種復(fù)合縮放方法的第一步是執(zhí)行網(wǎng)格搜索,在固定資源約束下找到基線網(wǎng)絡(luò)的不同縮放維度之間的關(guān)系(例如,2倍FLOPS),這樣做的目的是為了找出每個維度的適當(dāng)縮放系數(shù)。然后應(yīng)用這些系數(shù),將基線網(wǎng)絡(luò)擴(kuò)展到所需的目標(biāo)模型大小或算力預(yù)算。

與傳統(tǒng)的縮放方法相比,這種復(fù)合縮放方法可以持續(xù)提高擴(kuò)展模型的準(zhǔn)確性和效率,和傳統(tǒng)方法對比結(jié)果:MobileNet(+ 1.4% imagenet精度),ResNet(+ 0.7%)。

新模型縮放的有效性,很大程度上也依賴基線網(wǎng)絡(luò)。

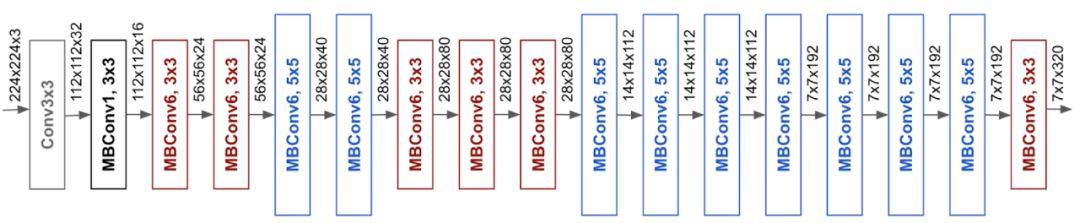

為了進(jìn)一步提高性能,研究團(tuán)隊(duì)還通過使用AutoML MNAS框架執(zhí)行神經(jīng)架構(gòu)搜索來開發(fā)新的基線網(wǎng)絡(luò),該框架優(yōu)化了準(zhǔn)確性和效率(FLOPS)。

由此產(chǎn)生的架構(gòu)使用移動倒置瓶頸卷積(MBConv),類似于MobileNetV2和MnasNet,但由于FLOP預(yù)算增加而略大。然后,通過擴(kuò)展基線網(wǎng)絡(luò)以獲得一系列模型,被稱為EfficientNets。

不僅局限于ImageNet

EfficientNets在ImageNet上的良好表現(xiàn),讓谷歌的科學(xué)家希望將其應(yīng)用于更廣泛的網(wǎng)絡(luò)中,造福更多的人。

在8個廣泛使用的遷移學(xué)習(xí)數(shù)據(jù)集上測試之后,EfficientNet在其中的5個網(wǎng)絡(luò)實(shí)現(xiàn)了最先進(jìn)的精度。例如,在參數(shù)減少21倍的情況下,實(shí)現(xiàn)了CIFAR-100(91.7%)和Flowers(98.8%)。

看到這樣的結(jié)果,谷歌科學(xué)家預(yù)計(jì)EfficientNet可能成為未來計(jì)算機(jī)視覺任務(wù)的新基礎(chǔ),因此將EfficientNet開源。

-

谷歌

+關(guān)注

關(guān)注

27文章

6254瀏覽量

111371 -

AI

+關(guān)注

關(guān)注

91文章

39755瀏覽量

301361 -

cnn

+關(guān)注

關(guān)注

3文章

355瀏覽量

23417

原文標(biāo)題:谷歌出品EfficientNet:比現(xiàn)有卷積網(wǎng)絡(luò)小84倍,比GPipe快6.1倍

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

晶晨攜手谷歌,助力端側(cè)大模型Gemini的硬件落地

每年10億美元,蘋果與谷歌官宣合作,Gemini大模型注入Siri

泰凌微:布局端側(cè)AI,產(chǎn)品支持谷歌LiteRT、TVM開源模型

大模型中常提的快慢思考會對自動駕駛產(chǎn)生什么影響?

CNN卷積神經(jīng)網(wǎng)絡(luò)設(shè)計(jì)原理及在MCU200T上仿真測試

構(gòu)建CNN網(wǎng)絡(luò)模型并優(yōu)化的一般化建議

谷歌AlphaEarth和維智時空AI大模型的核心差異

谷歌AlphaEarth和維智時空AI大模型的技術(shù)路徑

谷歌AI模型點(diǎn)亮開發(fā)無限可能

大模型時代的深度學(xué)習(xí)框架

CoT 數(shù)據(jù)集如何讓大模型學(xué)會一步一步思考?

谷歌發(fā)表論文EfficientNet 重新思考CNN模型縮放

谷歌發(fā)表論文EfficientNet 重新思考CNN模型縮放

評論