無人駕駛數(shù)據(jù)集你只知道Kitti嗎?而實(shí)際比你想象的多。

H3D - HRI-US(地址:https://usa.honda-ri.com/hdd/introduction/h3d)本田研究所于2019年3月發(fā)布其無人駕駛方向數(shù)據(jù)集,相關(guān)介紹于https://arxiv.org/abs/1903.01568介紹。本數(shù)據(jù)集使用3D LiDAR掃描儀收集的大型全環(huán)繞3D多目標(biāo)檢測(cè)和跟蹤數(shù)據(jù)集。其包含160個(gè)擁擠且高度互動(dòng)的交通場(chǎng)景,在27,721幀中共有100萬個(gè)標(biāo)記實(shí)例。憑借獨(dú)特的數(shù)據(jù)集大小,豐富的注釋和復(fù)雜的場(chǎng)景,H3D聚集在一起,以激發(fā)對(duì)全環(huán)繞3D多目標(biāo)檢測(cè)和跟蹤的研究。

nuScenes(地址:https://www.nuscenes.org/)安波福于2019年3月正式公開了其數(shù)據(jù)集,并已在GitHub(地址:https://github.com/nutonomy/nuscenes-devkit)公開教程。數(shù)據(jù)集擁有從波士頓和新加坡收集的1000個(gè)“場(chǎng)景”的信息,包含每個(gè)城市環(huán)境中都有的最復(fù)雜的一些駕駛場(chǎng)景。該數(shù)據(jù)集由140萬張圖像、39萬次激光雷達(dá)掃描和140萬個(gè)3D人工注釋邊界框組成,是迄今為止公布的最大的多模態(tài)3D 無人駕駛數(shù)據(jù)集。

ApolloCar3D該數(shù)據(jù)集包含5,277個(gè)駕駛圖像和超過60K的汽車實(shí)例,其中每輛汽車都配備了具有絕對(duì)模型尺寸和語義標(biāo)記關(guān)鍵點(diǎn)的行業(yè)級(jí)3D CAD模型。該數(shù)據(jù)集比PASCAL3D +和KITTI(現(xiàn)有技術(shù)水平)大20倍以上。

KITTI Vision Benchmark Suite(地址:

http://www.cvlibs.net/datasets/kitti/raw_data.php)數(shù)據(jù)集為使用各種傳感器模式,例如高分辨率彩色和灰度立體相機(jī),Velodyne 3D激光掃描儀和高精度GPS/IMU慣性導(dǎo)航系統(tǒng),在10-100 Hz下進(jìn)行6小時(shí)拍攝的交通場(chǎng)景。

Cityscape Dataset(地址:https://www.cityscapes-dataset.com/)專注于對(duì)城市街景的語義理解。大型數(shù)據(jù)集,包含從50個(gè)不同城市的街景中記錄的各種立體視頻序列,高質(zhì)量的像素級(jí)注釋為5000幀,另外還有一組較大的20000個(gè)弱注釋幀。因此,數(shù)據(jù)集比先前的類似嘗試大一個(gè)數(shù)量級(jí)。可以使用帶注釋的類的詳細(xì)信息和注釋示例。

Mapillary Vistas Dataset(地址:https://www.mapillary.com/dataset/vistas?pKey=xyW6a0ZmrJtjLw2iJ71Oqg&lat=20&lng=0&z=1.5)數(shù)據(jù)集是一個(gè)新穎的大規(guī)模街道級(jí)圖像數(shù)據(jù)集,包含25,000個(gè)高分辨率圖像,注釋為66個(gè)對(duì)象類別,另有37個(gè)類別的特定于實(shí)例的標(biāo)簽。通過使用多邊形來描繪單個(gè)對(duì)象,以精細(xì)和細(xì)粒度的樣式執(zhí)行注釋。

CamVid

(地址:http://mi.eng.cam.ac.uk/research/projects/VideoRec/CamVid/)劍橋駕駛標(biāo)簽視頻數(shù)據(jù)庫(kù)(CamVid)是第一個(gè)具有對(duì)象類語義標(biāo)簽的視頻集合,其中包含元數(shù)據(jù)。數(shù)據(jù)庫(kù)提供基礎(chǔ)事實(shí)標(biāo)簽,將每個(gè)像素與32個(gè)語義類之一相關(guān)聯(lián)。該數(shù)據(jù)庫(kù)解決了對(duì)實(shí)驗(yàn)數(shù)據(jù)的需求,以定量評(píng)估新興算法。雖然大多數(shù)視頻都使用固定位置的閉路電視風(fēng)格相機(jī)拍攝,但我們的數(shù)據(jù)是從駕駛汽車的角度拍攝的。駕駛場(chǎng)景增加了觀察對(duì)象類的數(shù)量和異質(zhì)性。

Caltech數(shù)據(jù)集(地址:

http://www.vision.caltech.edu/Image_Datasets/CaltechPedestrians/) - 加州理工學(xué)院行人數(shù)據(jù)集包括大約10小時(shí)的640x480 30Hz視頻,這些視頻來自在城市環(huán)境中通過常規(guī)交通的車輛。大約250,000個(gè)幀(137個(gè)近似分鐘的長(zhǎng)段)共有350,000個(gè)邊界框和2300個(gè)獨(dú)特的行人被注釋。注釋包括邊界框和詳細(xì)遮擋標(biāo)簽之間的時(shí)間對(duì)應(yīng)。更多信息可以在我們的PAMI 2012和CVPR 2009基準(zhǔn)測(cè)試文件中找到。

Comma.ai(地址:https://archive.org/details/comma-dataset)7.25小時(shí)的高速公路駕駛。包含10個(gè)可變大小的視頻片段,以20 Hz的頻率錄制,相機(jī)安裝在Acura ILX 2016的擋風(fēng)玻璃上。與視頻平行,還記錄了一些測(cè)量值,如汽車的速度、加速度、轉(zhuǎn)向角、GPS坐標(biāo),陀螺儀角度。這些測(cè)量結(jié)果轉(zhuǎn)換為均勻的100 Hz時(shí)基。

Oxford's Robotic Car(地址:https://robotcar-dataset.robots.ox.ac.uk/) - 超過100次重復(fù)對(duì)英國(guó)牛津的路線進(jìn)行一年多采集拍攝。該數(shù)據(jù)集捕獲了許多不同的天氣,交通和行人組合,以及建筑和道路工程等長(zhǎng)期變化。

伯克利BDD100K數(shù)據(jù)(地址:https://bdd-data.berkeley.edu/)超過100K的視頻和各種注釋組成,包括圖像級(jí)別標(biāo)記,對(duì)象邊界框,可行駛區(qū)域,車道標(biāo)記和全幀實(shí)例分割,該數(shù)據(jù)集具有地理,環(huán)境和天氣多樣性。

Udacity(地址:https://github.com/udacity/self-driving-car/tree/master/datasets) - 為Udacity Challenges(地址:https://cn.udacity.com/course/self-driving-car-engineer--nd013)發(fā)布的Udacity數(shù)據(jù)集。包含ROSBAG訓(xùn)練數(shù)據(jù)。(大約80 GB)。

University of Michigan North Campus Long-Term Vision and LIDAR Dataset(地址:http://robots.engin.umich.edu/nclt/) - 包括全方位圖像,3D激光雷達(dá),平面激光雷達(dá),GPS和本體感應(yīng)傳感器,用于使用Segway機(jī)器人收集的測(cè)距。

University of Michigan Ford Campus Vision and Lidar Data Set(地址:http://robots.engin.umich.edu/SoftwareData/Ford)基于改進(jìn)的福特F-250皮卡車的自動(dòng)地面車輛測(cè)試臺(tái)收集的數(shù)據(jù)集。該車配備了專業(yè)(Applanix POS LV)和消費(fèi)者(Xsens MTI-G)慣性測(cè)量單元(IMU),Velodyne 3D激光雷達(dá)掃描儀,兩個(gè)推掃式前視Riegl激光雷達(dá)和Point Grey Ladybug3全方位攝像頭系統(tǒng)。

DIPLECS Autonomous Driving Datasets (2015)(地址:https://cvssp.org/data/diplecs/)通過在Surrey鄉(xiāng)村周圍駕駛的汽車中放置高清攝像頭來記錄數(shù)據(jù)集。該數(shù)據(jù)集包含大約30分鐘的駕駛時(shí)間。視頻為1920x1080,采用H.264編解碼器編碼。通過跟蹤方向盤上的標(biāo)記來估計(jì)轉(zhuǎn)向。汽車的速度是從汽車的速度表OCR估算的(但不保證方法的準(zhǔn)確性)。

Velodyne SLAM Dataset from Karlsruhe Institute of Technology(地址:

https://www.mrt.kit.edu/z/publ/download/velodyneslam/dataset.html)在德國(guó)卡爾斯魯厄市使用Velodyne HDL64E-S2掃描儀記錄的兩個(gè)具有挑戰(zhàn)性的數(shù)據(jù)集。

SYNTHetic collection of Imagery and Annotations (SYNTHIA)(地址:http://synthia-dataset.net/)包括從虛擬城市渲染的照片般逼真的幀集合,并為13個(gè)類別提供精確的像素級(jí)語義注釋:misc,天空,建筑,道路,人行道,圍欄,植被,桿,汽車,標(biāo)志,行人, 騎自行車的人,車道標(biāo)記。

CSSAD Dataset(地址:http://aplicaciones.cimat.mx/Personal/jbhayet/ccsad-dataset) 包括若干真實(shí)世界的立體數(shù)據(jù)集,用于在自動(dòng)駕駛車輛的感知和導(dǎo)航領(lǐng)域中開發(fā)和測(cè)試算法。然而,它們都沒有記錄在發(fā)展中國(guó)家,因此它們?nèi)狈υ诮值篮偷缆飞峡梢哉业降奶厥馓卣鳎缲S富的坑洼,減速器和特殊的行人流。該立體數(shù)據(jù)集是從移動(dòng)的車輛記錄的,并且包含高分辨率立體圖像,其補(bǔ)充有從IMU,GPS數(shù)據(jù)和來自汽車計(jì)算機(jī)的數(shù)據(jù)獲得的定向和加速度數(shù)據(jù)。

Daimler Urban Segmetation Dataset(地址:http://www.6d-vision.com/scene-labeling) 包括城市交通中記錄的視頻序列。該數(shù)據(jù)集由5000個(gè)經(jīng)過校正的立體圖像對(duì)組成,分辨率為1024x440。500幀(序列的每10幀)帶有5個(gè)類的像素級(jí)語義類注釋:地面,建筑,車輛,行人,天空。提供密集視差圖作為參考,但是這些不是手動(dòng)注釋的,而是使用半全局匹配(sgm)計(jì)算的。

Self Racing Cars- XSens/Fairchild Dataset(地址:http://data.selfracingcars.com/)文件包括來自Fairchild FIS1100 6自由度(DoF)IMU,F(xiàn)airchild FMT-1030 AHRS,Xsens MTi-3 AHRS和Xsens MTi-G-710 GNSS / INS的測(cè)量結(jié)果。事件中的文件都可以在MT Manager軟件中讀取,該軟件可作為MT軟件套件的一部分提供,可在此處獲得。

MIT AGE Lab(地址:http://lexfridman.com/automated-synchronization-of-driving-data-video-audio-telemetry-accelerometer/) - 由AgeLab收集的1,000多小時(shí)多傳感器駕駛數(shù)據(jù)集的一小部分樣本。

LaRA(地址:http://www.lara.prd.fr/lara)-巴黎的交通信號(hào)燈數(shù)據(jù)集

KUL Belgium Traffic Sign Dataset(地址:http://www.vision.ee.ethz.ch/~timofter/traffic_signs/) - 具有10000多個(gè)交通標(biāo)志注釋的大型數(shù)據(jù)集,數(shù)千個(gè)物理上不同的交通標(biāo)志。用8個(gè)高分辨率攝像頭錄制的4個(gè)視頻序列安裝在一輛面包車上,總計(jì)超過3個(gè)小時(shí),帶有交通標(biāo)志注釋,攝像機(jī)校準(zhǔn)和姿勢(shì)。大約16000張背景圖片。這些材料通過GeoAutomation在比利時(shí),佛蘭德斯地區(qū)的城市環(huán)境中捕獲。

LISA: Laboratory for Intelligent & Safe Automobiles, UC San Diego Datasets(地址:http://cvrr.ucsd.edu/LISA/datasets.html)交通標(biāo)志,車輛檢測(cè),交通燈,軌跡模式。

博世小交通燈(地址:https://hci.iwr.uni-heidelberg.de/node/6132) - 用于深度學(xué)習(xí)的小型交通燈的數(shù)據(jù)集。

Multisensory Omni-directional Long-term Place Recognition (MOLP) dataset for autonomous driving(地址:http://hcr.mines.edu/code/MOLP.html) - 它是在美國(guó)科羅拉多州的一年內(nèi)使用全向立體相機(jī)錄制的。論文(地址:https://arxiv.org/abs/1704.05215)

DeepTesla(地址:https://selfdrivingcars.mit.edu/deeptesla/):主要包括tesla在兩種不同駕駛模式(human driving和autopilot)下的前置相機(jī)錄制的視頻和車輛的轉(zhuǎn)向控制信號(hào)。數(shù)據(jù)可以從這里下載:百度云(地址:https://pan.baidu.com/s/1c2J2IFA#list/path=%2F)。可以參考此GitHub(地址:https://github.com/CJHMPower/deep-tesla)

看到其他數(shù)據(jù)將繼續(xù)更新。。。

-

傳感器

+關(guān)注

關(guān)注

2576文章

55050瀏覽量

791456 -

數(shù)據(jù)集

+關(guān)注

關(guān)注

4文章

1236瀏覽量

26202 -

無人駕駛

+關(guān)注

關(guān)注

100文章

4297瀏覽量

126847

原文標(biāo)題:無人駕駛數(shù)據(jù)集匯總

文章出處:【微信號(hào):IV_Technology,微信公眾號(hào):智車科技】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

格陸博科技榮獲2025低速無人駕駛行業(yè)TOP20核心供應(yīng)鏈獎(jiǎng)

佑駕創(chuàng)新助力低速無人駕駛行業(yè)高質(zhì)量發(fā)展

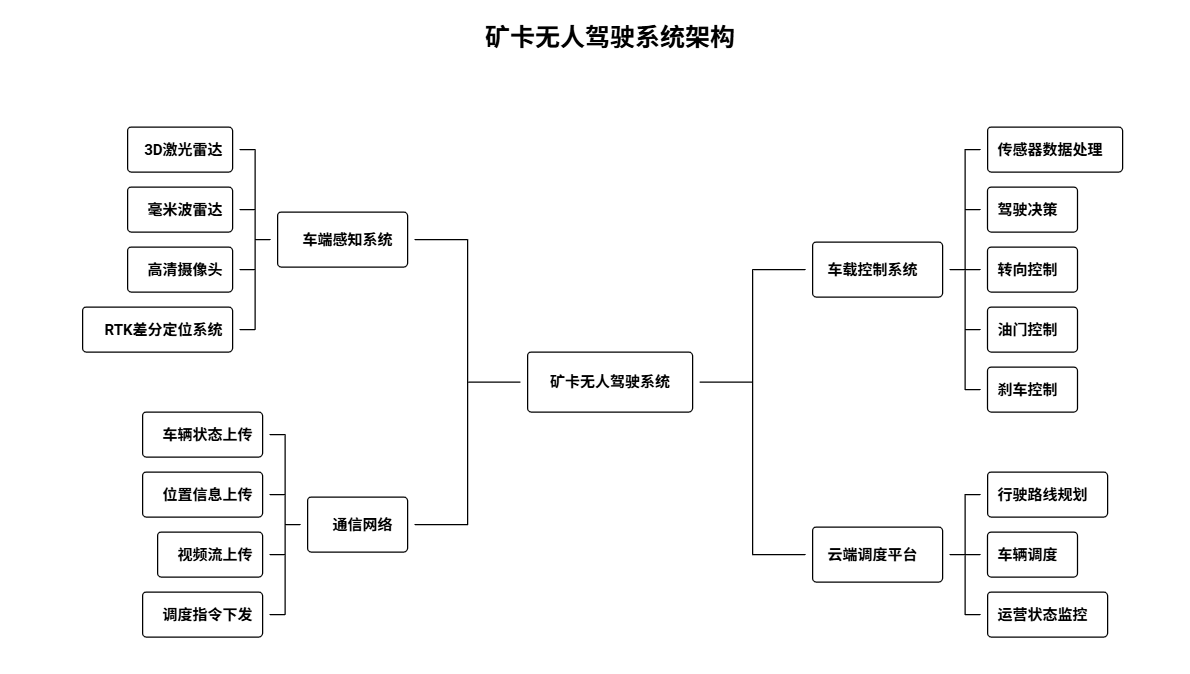

礦卡無人駕駛從理論到落地的全過程記錄(轉(zhuǎn)載)

西井科技無人駕駛集卡全球項(xiàng)目再進(jìn)階

SimData:基于aiSim的高保真虛擬數(shù)據(jù)集生成方案

小馬智行無人駕駛車參與第十五屆全運(yùn)會(huì)火炬?zhèn)鬟f

西井科技無人駕駛新能源集卡落地四川瀘州港

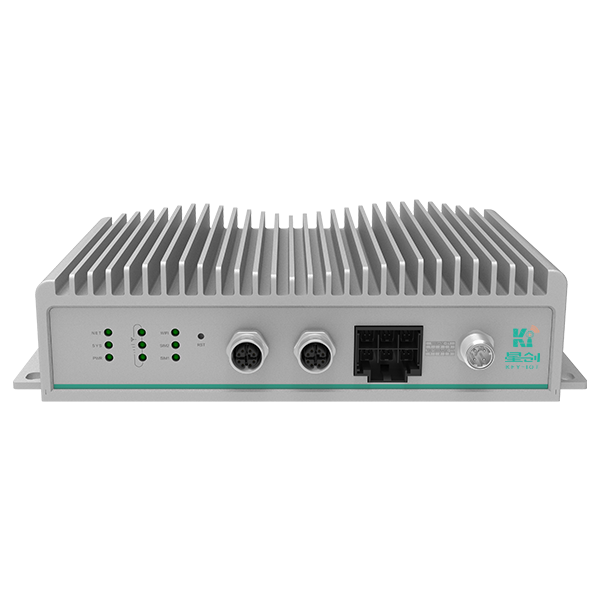

2025無人駕駛技術(shù)細(xì)節(jié)及發(fā)展趨勢(shì)|(星創(chuàng)易聯(lián)細(xì)節(jié)解析)

無人駕駛:智能決策與精準(zhǔn)執(zhí)行的融合

Linux權(quán)限體系解析

主線科技無人駕駛集卡助力中越智慧口岸建設(shè)

智行者科技無人駕駛小巴落地海南

無人駕駛技術(shù)未來在哪里?低速才是突破口

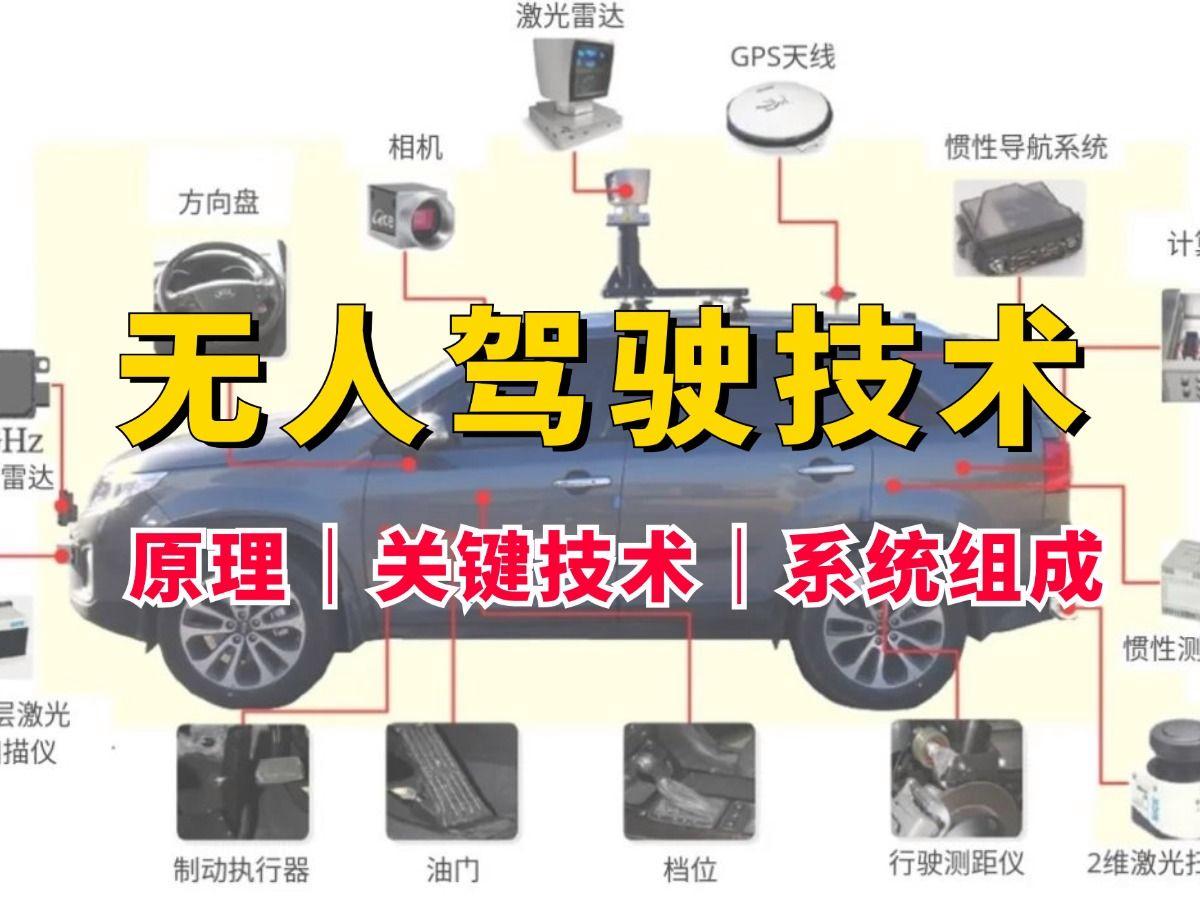

無人駕駛解決方案包含哪些方面?感知、決策與控制

無人駕駛數(shù)據(jù)集你只知道Kitti嗎?而實(shí)際比你想象的多

無人駕駛數(shù)據(jù)集你只知道Kitti嗎?而實(shí)際比你想象的多

評(píng)論