Lingvo 是國(guó)際性語(yǔ)言世界語(yǔ)中的一個(gè)單詞,意為 “語(yǔ)言”。此名稱寓指 Lingvo 框架的根基,即它是使用 TensorFlow 開發(fā)的一款通用深度學(xué)習(xí)框架,側(cè)重于針對(duì)語(yǔ)言相關(guān)任務(wù)(例如機(jī)器翻譯、語(yǔ)音識(shí)別和語(yǔ)音合成)的序列模型。

此框架在 Google 內(nèi)部非常受歡迎,使用它的研究人員也越來(lái)越多。目前已發(fā)表 數(shù)十篇使用 Lingvo 獲得頂尖成果的論文,未來(lái)還會(huì)有更多論文面世。Lingvo 支持多種架構(gòu),從傳統(tǒng)的循環(huán)神經(jīng)網(wǎng)絡(luò) (RNN) 序列模型到 Transformer 模型,再到包含變分自編碼器 (VAE) 組件的模型,不一而足。為表示對(duì)研究社區(qū)的支持,同時(shí)鼓勵(lì)可復(fù)現(xiàn)的研究工作,我們開源了此框架,并開始發(fā)布論文中使用的模型。

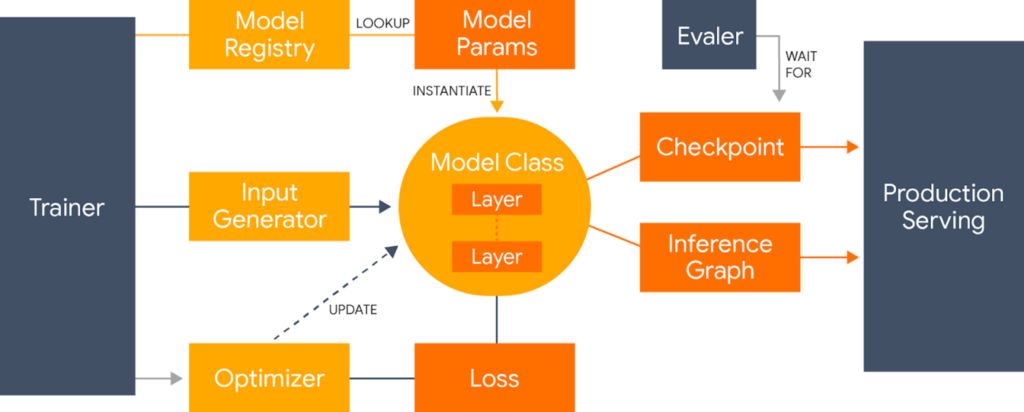

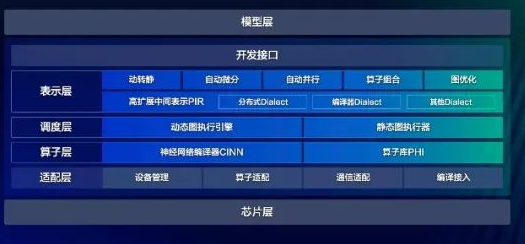

圖 1:Lingvo 框架概覽,簡(jiǎn)要展示了如何實(shí)例化和訓(xùn)練模型,以及如何將模型導(dǎo)出以進(jìn)行評(píng)估和部署

在構(gòu)建 Lingvo 時(shí),我們秉持著協(xié)作研究的理念,通過(guò)在不同任務(wù)之間共享公共層的實(shí)現(xiàn)來(lái)提升代碼復(fù)用率。此外,所有層都采用相同的公共界面,并且以相同的方式布局。這不僅可以產(chǎn)生更簡(jiǎn)潔易懂的代碼,還能讓您非常輕松地將其他開發(fā)者為其他任務(wù)所做的改進(jìn)應(yīng)用到您自己的任務(wù)上。執(zhí)行這種一致性的確成本不菲,需要更多的規(guī)則和樣板文件,但 Lingvo 會(huì)努力將成本降至最低,以確保在研究過(guò)程中更快地進(jìn)行迭代。

協(xié)作的另一個(gè)方面是共享可復(fù)現(xiàn)的成果。Lingvo 提供一個(gè)集中的位置,用于存儲(chǔ)檢入的模型超參數(shù)配置。這不僅可以用來(lái)記錄重要的實(shí)驗(yàn),還能讓其他研究者通過(guò)訓(xùn)練相同的模型,輕松復(fù)現(xiàn)您的成果。

雖然 Lingvo 最初的關(guān)注重點(diǎn)是 NLP,但它其實(shí)非常靈活,研究人員已經(jīng)使用此框架成功實(shí)現(xiàn)了圖像分割、點(diǎn)云分類等任務(wù)的模型。它還支持提煉、生成式對(duì)抗網(wǎng)絡(luò) (GAN) 和多任務(wù)模型。同時(shí),此框架的速度并未因此而受到影響,它具有經(jīng)優(yōu)化的輸入管道和快速分布式訓(xùn)練能力。最后,Lingvo 還將易于實(shí)現(xiàn)生產(chǎn)化也納入考慮,它甚至有一條明確定義的路徑,可以將模型移植到移動(dòng)推理。

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4838瀏覽量

107797 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5599瀏覽量

124398 -

tensorflow

+關(guān)注

關(guān)注

13文章

334瀏覽量

62187

原文標(biāo)題:Lingvo:TensorFlow 序列建模框架

文章出處:【微信號(hào):tensorflowers,微信公眾號(hào):Tensorflowers】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

物聯(lián)網(wǎng)新手小白,求前輩推薦一款學(xué)習(xí)用開發(fā)板

VLA與世界模型有什么不同?

摩爾線程新一代大語(yǔ)言模型對(duì)齊框架URPO入選AAAI 2026

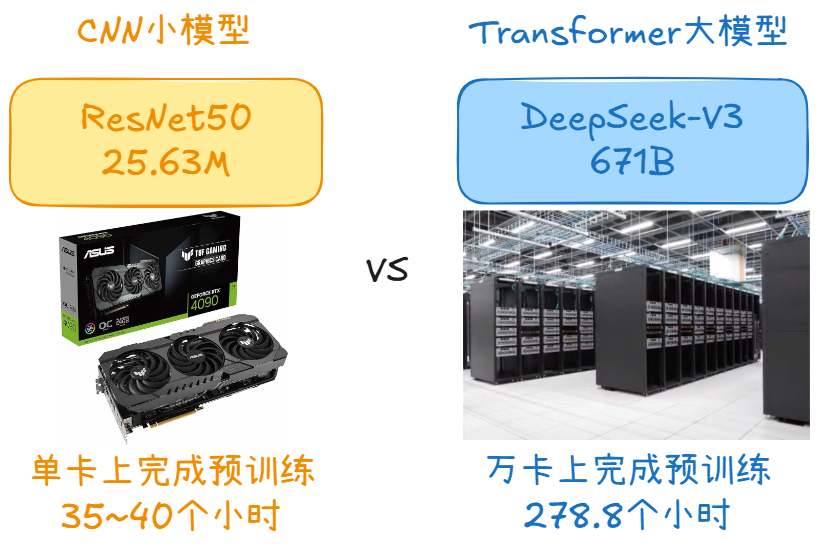

自動(dòng)駕駛中Transformer大模型會(huì)取代深度學(xué)習(xí)嗎?

超小型Neuton機(jī)器學(xué)習(xí)模型, 在任何系統(tǒng)級(jí)芯片(SoC)上解鎖邊緣人工智能應(yīng)用.

不用UI也能開發(fā)NXP Time Series Studio(TSS)應(yīng)用嗎?一起看下TSS命令行形式介紹

任正非說(shuō) AI已經(jīng)確定是第四次工業(yè)革命 那么如何從容地加入進(jìn)來(lái)呢?

Nordic收購(gòu) Neuton.AI 關(guān)于產(chǎn)品技術(shù)的分析

ESP-Brookesia:融合 AI 大模型,全新一代 GUI 開發(fā)與管理平臺(tái)

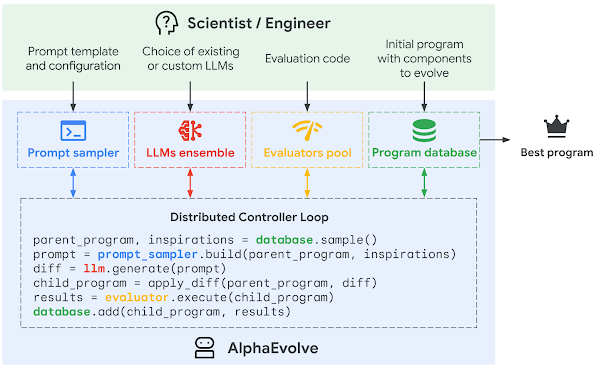

AlphaEvolve:一款基于Gemini的編程Agent,用于設(shè)計(jì)高級(jí)算法

小白學(xué)大模型:從零實(shí)現(xiàn) LLM語(yǔ)言模型

大模型時(shí)代的深度學(xué)習(xí)框架

百度飛槳框架3.0正式版發(fā)布

用樹莓派搞深度學(xué)習(xí)?TensorFlow啟動(dòng)!

一種多模態(tài)駕駛場(chǎng)景生成框架UMGen介紹

使用TensorFlow開發(fā)的一款通用深度學(xué)習(xí)框架,側(cè)重于針對(duì)語(yǔ)言相關(guān)任務(wù)的序列模型

使用TensorFlow開發(fā)的一款通用深度學(xué)習(xí)框架,側(cè)重于針對(duì)語(yǔ)言相關(guān)任務(wù)的序列模型

評(píng)論