提到 AI,大家常說它 “算得快”,其實是指 AI 能在眨眼間處理海量數據。可它為啥有這本事?答案就藏在 “GPU + 高速內存 + 并行計算” 這 trio(組合)里。

咱們可以把 AI 要處理的數據,想象成一大堆 “小任務”。

比如一張圖片里的每個像素、一段語音里的每段聲波、一句話里的每個詞,都得單獨拿出來計算。

而且這些任務可不是幾十個,而是幾百萬、幾億甚至更多,數量特別驚人。

| CPU | GPU | |

任務類型 | 單任務,慢 | 多任務并行,快 |

內存特性 | 數據秒取(高速緩存+內存) | 快,但核心靠內存(顯存帶寬高,依賴內存協作) |

工作流程 | 讀→算→寫(內存必用) | 批量讀→并行算→批量寫(依賴內存吞吐) |

CPU:聰明卻“手少”的“學霸”

以前的電腦,主要靠 CPU 來做計算。CPU 就像個超級聰明的學霸,計算能力超強,復雜的問題都能搞定。

但它有個小缺點 ——“手臂” 太少,通常只有 4 條、8 條,同一時間能處理的事情很有限。它更擅長應對少量但難度高的任務,就像讓學霸做一堆重復的簡單題,雖然能做好,但速度肯定快不起來。

GPU:“人多力量大”的團隊

GPU(圖形處理器)一開始是用來處理圖像的,可它有個獨特優勢 —— 擁有成千上萬的 “小核心”。這些小核心單獨看可能不算特別聰明,但勝在能一起干活、同步計算,這就是咱們說的 “并行計算”。

打個比方,要是讓一萬個人同時算簡單的數學題,速度肯定比一個學霸單打獨斗快得多。AI 剛好需要大量這種 “重復的小計算”,所以 GPU 就成了它的 “得力助手”。

高速內存:GPU的“專屬倉庫”

GPU 的計算速度快到什么程度呢?快到如果數據沒及時送過來,它就只能 “等米下鍋”,白白浪費時間。于是工程師們給 GPU 配了個 “專屬倉庫”—— 顯存,也就是高速內存。

平時會把要計算的數據提前存進顯存里,這樣 GPU 想用的時候,一瞬間就能拿到,不用像 CPU 那樣,還得頻繁去訪問速度慢不少的普通內存。就像一個超高效的工廠,門口的倉庫里材料備得足足的,工廠才能一直高速運轉,不耽誤事兒。

不管CPU還是GPU,都離不開“內存三步曲”

其實不管是 CPU 還是 GPU,計算時都逃不開三個步驟:第一步,從內存里把數據讀出來;第二步,對數據進行計算;第三步,把算好的結果寫回內存。

GPU 和 CPU 的區別在于:GPU 一次能處理好多數據,也就是并行計算;它還有自己專用的高速內存(顯存);整體速度比傳統的 “CPU + 普通內存” 快好幾倍。也正因為這樣,現在的 AI 都離不開 GPU。

一句話總結。AI 的快,靠的是 GPU 的并行計算能力,但不管它速度多驚人,本質上還是 “從內存讀數據、計算、再寫回內存” 的過程,始終離不開內存。

本文轉自:柏睿數據

-

gpu

+關注

關注

28文章

5118瀏覽量

134556 -

內存

+關注

關注

9文章

3174瀏覽量

76168 -

AI

+關注

關注

90文章

38414瀏覽量

297709 -

并行計算

+關注

關注

0文章

30瀏覽量

9702

發布評論請先 登錄

一文看懂AI大模型的并行訓練方式(DP、PP、TP、EP)

神經網絡的并行計算與加速技術

科普:什么AI 內存技術

從自然仿真到智能調度——GPU并行計算的多場景突破

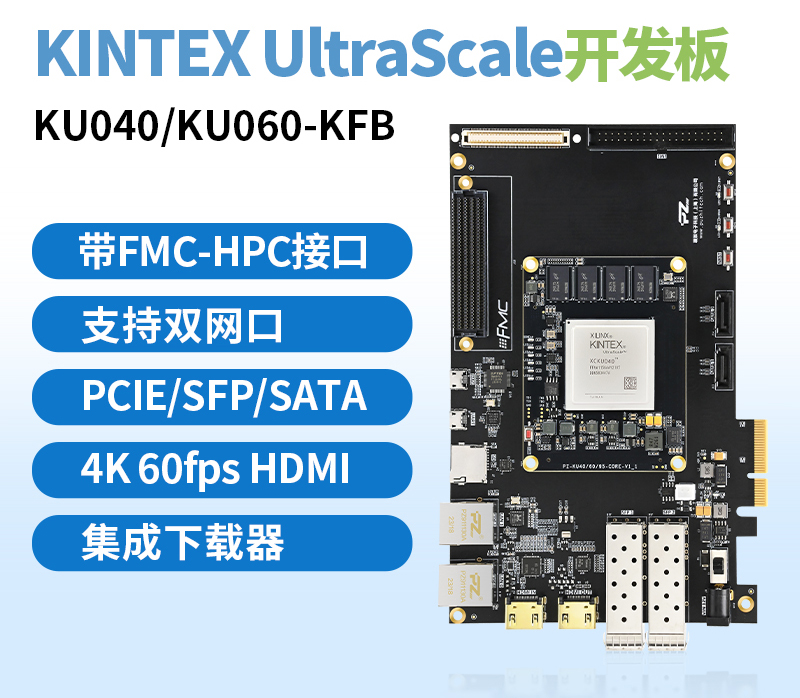

Kintex UltraScale 純 FPGA 開發平臺,釋放高速并行計算潛能,高性價比的 FPGA 解決方案

AI芯片:加速人工智能計算的專用硬件引擎

邊緣AI廣泛應用推動并行計算崛起及創新GPU滲透率快速提升

并行計算的崛起:為什么GPU將在邊緣AI中取代NPU

Imagination與澎峰科技攜手推動GPU+AI解決方案,共拓計算生態

GPU加速計算平臺的優勢

云 GPU 加速計算:突破傳統算力瓶頸的利刃

xgboost的并行計算原理

直播預告|RISC-V 并行計算技術沙龍,邀您與國內外專家共探 AI 時代無限可能

為啥 AI 計算速度這么驚人?—— 聊聊 GPU、內存與并行計算

為啥 AI 計算速度這么驚人?—— 聊聊 GPU、內存與并行計算

評論