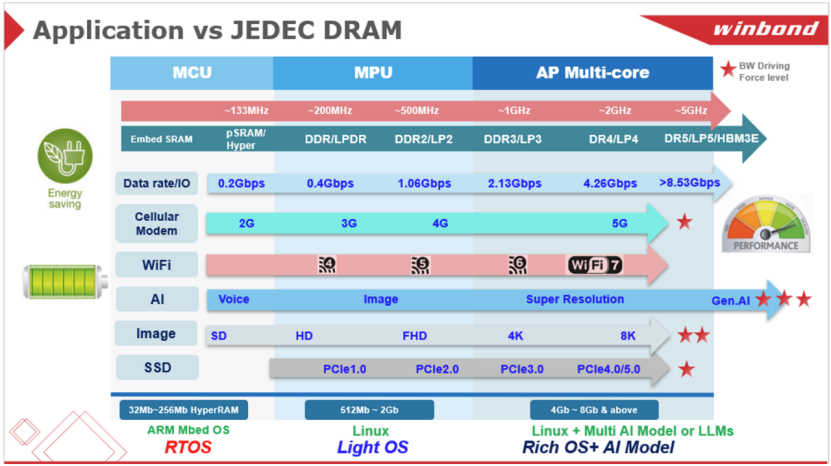

AI 內存是一種專為人工智能 (AI) 應用設計的新型內存技術。與傳統的通用內存(如 DDR5 或 LPDDR5)不同,AI 內存的核心目標是解決 AI 計算中遇到的兩大挑戰:帶寬瓶頸和延遲問題。

為什么 AI 內存很重要?

在 AI 模型訓練和推理過程中,大量的數據需要從內存傳輸到處理器(如 GPU 或 TPU)進行計算。傳統的內存技術由于其物理架構限制,數據傳輸速度往往跟不上處理器的計算速度。這就好比一條只有兩車道的高速公路,無法滿足數十萬輛汽車同時通行的需求,導致交通擁堵。

AI 模型,尤其是大型語言模型(LLMs)和生成式 AI 模型,對數據吞吐量的需求極高。如果內存無法快速提供數據,處理器就會因為“等待數據”而閑置,導致整體性能下降,效率低下。

AI 內存如何解決這些問題?

AI 內存通過以下幾種關鍵技術來解決這些挑戰:

高帶寬存儲(HBM):這是目前最主流的 AI 內存技術。HBM 通過將多個 DRAM 芯片垂直堆疊并使用硅通孔(TSV)技術連接,極大地增加了數據傳輸的通道數量。這就像把高速公路從兩車道擴展到了幾十個車道,數據傳輸能力呈幾何級數增長。例如,HBM3E 的帶寬可以達到 1.2 TB/s,遠超 DDR5 的 60-80 GB/s。

近內存計算(Processing-in-Memory, PIM):這項技術更進一步,它將部分計算功能直接集成到內存芯片內部或非常靠近內存芯片的位置。這意味著一些簡單的、重復性的計算任務(例如矩陣乘法)可以直接在內存中完成,而不需要將數據來回傳輸到處理器。這不僅減少了數據移動,也顯著降低了延遲和功耗。

更高能效比:AI 內存通常設計得更節能。在數據中心,為 AI 加速器提供數據傳輸的能耗是巨大的。通過優化架構,AI 比如 HBM 技術,可以在提供更高帶寬的同時,比傳統內存消耗更少的電能。

總的來說,AI 內存是 AI 硬件生態系統中不可或缺的一部分,它與高性能處理器(如英偉達的 GPU)協同工作,共同提升 AI 模型的訓練速度和推理效率。

審核編輯 黃宇

-

內存

+關注

關注

9文章

3222瀏覽量

76450 -

AI

+關注

關注

91文章

40578瀏覽量

302178

發布評論請先 登錄

邊緣AI算力臨界點:深度解析176TOPS香橙派AI Station的產業價值

南亞科技3D堆疊AI內存UltraWIO技術

使用NORDIC AI的好處

應對端側AI算力、內存、功耗“三堵墻”困境,安謀科技Arm China “周易”X3給出技術錦囊

移遠通信×炯為智能:AI賦能,打造更懂孩子的“十萬個為什么”全時在線科普伙伴

校園科普氣象站:技術賦能下的自然探索課堂

北京科技創新促進中心文科與科普部李守勇部長一行蒞臨昱櫟技術科普基地實地踏勘

科普:什么AI 內存技術

科普:什么AI 內存技術

評論