在 Microsoft Ignite 2025 大會上,隨著Microsoft SQL Server 2025 的發布,AI 就緒型企業數據庫愿景成為現實,為開發者提供強大的新工具,例如內置向量搜索和調用外部 AI 模型的 SQL 原生 API。NVIDIA 與微軟共同將SQL Server 2025與NVIDIA Nemotron RAG開放模型集合無縫連接,這使您能夠在云端或本地環境中基于自己的數據構建高性能、安全的 AI 應用。

檢索增強生成 (RAG)是企業利用數據的最有效方法。RAG 使 AI 能夠基于實時的、專有的數據進行工作,無需從零開始重新訓練模型,從而避免了巨大的成本和復雜性。然而,RAG 的有效性依賴于計算密集型的步驟,其中之一是向量嵌入生成。這在傳統的 CPU 基礎設施上造成了巨大的性能瓶頸。

大規模部署的復雜性和對模型靈活性的需求加劇了這一挑戰。企業需要一系列嵌入式模型來平衡不同任務的準確性、速度和成本。

本篇詳細介紹了為解決這個問題的 NVIDIA 新參考架構。該架構建立在 SQL Server 2025 和Llama Nemotron Embed 1B v2上,后者屬于 Nemotron RAG 系列。文中解釋了這種集成如何允許您直接從 SQL Server 數據庫調用 Nemotron RAG 模型,并將其轉變為高性能的 AI 應用引擎。實施方案基于 Azure Cloud 和 Azure Local,涵蓋了 SQL Server 在云端或本地的主要使用場景。

使用 Nemotron RAG 和 SQL Server 2025 解決企業 AI RAG 挑戰

通過 Nemotron RAG 將 SQL Server 2025 連接到靈活、加速的 NVIDIA AI 引擎,解決了企業 AI RAG 的核心挑戰:性能、部署以及靈活性和安全性。

提升 RAG 性能瓶頸

該架構通過使用 Llama Nemotron Embed 1B v2,將嵌入生成任務從 CPU 卸載到 NVIDIA GPU,解決了 RAG 核心的性能瓶頸。Llama Nemotron Embed 1B v2 是一款先進的開放模型,能夠生成準確度高的專為檢索任務優化的嵌入。它支持多語言及跨語言的文本問答檢索,具備長上下文支持能力并優化數據存儲。

Llama Nemotron Embed 1B v2 屬于 Nemotron RAG 系列,它包含提取、嵌入、重新排序模型,并通過 Nemotron RAG 數據集和腳本進行微調,以實現最佳準確性。

在數據庫方面,SQL Server 2025 在本機矢量距離函數的支持下,通過矢量搜索提供無縫、高性能的數據檢索。當嵌入式模型本地托管時,能夠消除網絡開銷、降低延遲,這兩大因素顯著提升了整體性能。

將 AI 模型部署為簡易的容器化端點

部署環節是NVIDIA NIM的用武之地。NIM 是預構建的、生產就緒的容器,旨在簡化最新優化的 AI 模型 (如 NVIDIA Nemotron RAG) 在任何 NVIDIA 加速基礎設施上的部署,無論是在云端還是本地。借助 NIM,您可以將 AI 模型部署為簡易的容器化端點,無需管理復雜的庫或環境。

此外,通過使用由 NIM 支持的本地托管模型,可以有效滿足數據駐留與合規性要求。易于使用是另一個關鍵優勢。NIM 的預構建性質與原生 SQL REST API 相結合,顯著縮短了學習曲線,使企業能夠更輕松地讓 AI 貼近其客戶已有的數據。

保持安全性和靈活性

該架構提供了一系列先進的 Nemotron RAG 模型,同時確保專有數據在 SQL Server 數據庫中的安全。NIM 專為企業級安全性而設計,并由 NVIDIA 企業支持提供保障。NIM 和 SQL Server 之間的所有通信均通過端到端 HTTPS 加密得到進一步保護。

Nemotron RAG 和 Microsoft SQL Server 2025 參考架構

Nemotron RAG 和 SQL Server 2025 參考架構詳細描述了使用 Llama Nemotron Embed 1B v2 嵌入模型(作為 NIM 提供)以實現解決方案的過程。該方案支持直接基于 Azure Cloud 或 Azure Local 部署的 SQL Server 實現企業級、安全、GPU 加速的 RAG 工作流。

有關此解決方案的完整代碼、部署腳本和詳細操作指南,請參閱NVIDIA NIM with SQL Server 2025 AI on Azure Cloud and Azure Local。

核心架構組件

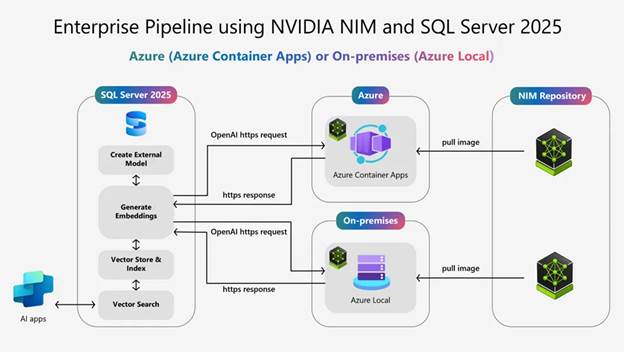

圖 1 展示了三個核心架構組件和流程基礎,下面也將對其進行詳解。

圖1. 該架構由三個協同工作的核心組件組成

SQL Server 2025:AI 就緒數據庫

該解決方案基于 SQL Server 2025 引入的兩項變革性功能,充當數據庫內 AI 的引擎:

原生矢量數據類型:此功能使您能夠直接將矢量嵌入安全地與結構化數據存儲在一起,免除了對單獨矢量數據庫的需求,簡化了架構,減少了數據移動,并支持混合搜索,例如查找既是“跑鞋”(矢量搜索)又是“庫存中”(結構化過濾器)的產品。

矢量距離搜索:您現在可以使用內置函數直接在 SQL Server 2025 中執行相似性搜索。您可以根據嵌入空間的緊密程度對結果進行排名,支持語義搜索、推薦系統和個性化等用例,所有這些都無需離開數據庫。

創建外部模型:在 SQL Server 2025 中將外部 AI 模型(例如 NIM)注冊和管理為一流實體。這提供了一種無縫的方式來編排推理工作流,同時保持集中化治理和安全性。

生成嵌入:使用AI_GENERATE_EMBEDDINGS函數直接從 T-SQL 創建文本或其他數據的嵌入。該函數在底層利用外部 REST API 調用,無需復雜的集成步驟即可實現實時嵌入生成。

NVIDIA NIM:加速的 AI 引擎

Nemotron RAG系列開放模型,包括本參考架構中使用的 Llama Nemotron Embed 1B v2 模型,作為生產就緒型NVIDIA NIM提供,可在標準 Docker 容器中運行。

這種方法簡化了部署,并確保云和本地 Windows 或 Linux 環境與 NVIDIA GPU 的兼容性。這些模型可以部署在 Azure Container App 上或使用 Azure Local 進行本地部署。這種容器化交付支持自動和手動擴縮容的策略,并為 SQL Server 2025 提供了理想的“本地到云端”的靈活性。

云規模:您可以使用無服務器 NVIDIA GPU將 NIM 部署到 ACA。這種方法屏蔽了所有的基礎設施管理工作。您將獲得支持自動縮容至零、按秒計費的按需 GPU 加速推理服務,在優化成本的同時簡化運維。

本地部署:為了實現更強的數據主權和低延遲,您可以使用帶有 NVIDIA GPU 的 Azure Local 在本地運行相同的 NIM 容器。Azure Local 將 Azure 的管理平面擴展到您自己的硬件,能夠直接在本地數據上運行 AI,同時滿足嚴格的合規性或性能需求。

SQL Server和NIM 之間的鏈接

SQL Server 和 NIM 之間的通信橋梁簡單而穩固,基于標準、安全的 Web 協議構建。

兼容 OpenAI 的 API:NVIDIA NIM 提供兼容 OpenAI 的 API 端點。SQL Server 2025 可以使用其原生函數來調用 NIM 服務,就像調用 OpenAI 服務一樣,從而確保無縫、開箱即用的集成。

標準 POST 請求:SQL Server 2025 通過標準的 HTTPS POST 請求來檢索諸如嵌入等結果。

安全且靈活的通信:該設計使用 TLS 證書進行端到端加密,建立雙向信任并確保所有響應對于云和本地部署都是安全、高性能且符合標準的。這相比僅限遠程模型具有顯著優勢,因為您保有完全控制,并且專有數據永遠不會離開安全環境。

此參考架構采用先進的 Nemotron RAG 模型,它也可以進行擴展,使 SQL Server 2025 能夠調用任何 NIM 以支持廣泛的 AI 應用程序,例如文本摘要、內容分類或預測分析,所有這些都可以直接在 SQL Server 2025 中的數據上執行。

兩種部署方式

本文介紹此解決方案的兩種主要部署模式:本地部署 (使用 Azure Local) 和云部署 (使用 Azure Container App)。這兩種模式都基于相同的核心機制:SQL Server 2025 使用標準的 OpenAI 兼容協議調用 NVIDIA NIM 端點。

使用 Azure Local 進行本地部署

本地部署方案可提供更強的靈活性,支持在搭載 NVIDIA GPU 的服務器上運行多種 Windows 和 Linux 的系統組合,例如:

同時運行 SQL Server 和 NVIDIA NIM 的 Windows/Ubuntu Server 或 Windows/Ubuntu 本地虛擬機

運行 SQL Server 的 Windows 系統和運行 NVIDIA NIM 的 Ubuntu 系統,反之亦可

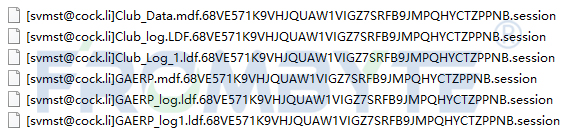

如進行部署,使用微軟新推出的 Azure Local 方案,可將 Azure Cloud 平臺直接擴展到本地環境。有關建立安全通信的完整安裝說明(包括 NIM 部署的詳細信息),請訪問 GitHub 上的NVIDIA/GenerativeAIExamples。注意此解決方案已通過 SQL Server 2025 (RC 17.0.950.3) 驗證。

云部署

云部署方案采用托管在 Azure Container App (ACA) 上的 NVIDIALlama Nemotron Embedding NIM。ACA 是微軟 Azure 提供的全托管無服務器容器平臺,不僅全面支持該架構,還進一步放大了架構優勢。如需了解更多信息,請參閱 NVIDIA/GenerativeAIExamples GitHub 存儲庫中的NVIDIA NIM with Microsoft SQL Server 2025 AI on Azure Cloud and Azure Local。

這種無服務器的方式為部署基于 SQL Server 2025 數據的 AI 應用程序提供了若干關鍵優勢。

為加速 NIM 副本啟動,建議使用由 Azure File Share 或臨時存儲支持的 ACA 卷,以保留本地 NIM 緩存。副本數量通過 ACA HTTP 擴展功能自動管理,可支持縮容至零。

ACA 應用程序能夠并行托管多個版本和類型的 NIM,每個 NIM 都可通過在 SQL Server 中配置的獨立 URL 進行訪問。

解決方案演示

要獲取運行完整端到端工作流的全套說明,可查閱SQL Server 2025 AI functionality with NVIDIA Retrieval QA using E5 Embedding v5。

該演示 SQL 腳本將引導您完成以下步驟:

創建 AdventureWorks 示例數據庫

創建 ProductDescriptionEmbeddings 演示表

執行演示腳本,通過 NVIDIA NIM 集成填充嵌入

使用 Select_Embeddings.sql 驗證并可視化存儲的嵌入

此工作流演示了 SQL Server 2025 AI 的新功能,其中運用了內置的 T-SQL AI 功能,包括:VECTOR_DISTANC、AI_GENERATE_EMBEDDINGS和CREATE EXTERNAL MODEL,這些功能共同構成了 SQL Server 2025 中新 AI 集成的基礎。

開始使用 SQL Serve 2025 和 NVIDIA Nemotron RAG

Microsoft SQL Server 2025與以生產級 NVIDIA NIM 形式交付的 NVIDIA Nemotron RAG 相集成,為構建高性能 AI 應用提供了一條無縫的“本地到云端”實現路徑。通過結合 SQL Server 2025 內置的 AI 功能與 NVIDIA GPU 優化推理堆棧,能夠有效解決 RAG 核心性能瓶頸,將 AI 安全、高效地引入到數據中,并且無需額外管理復雜的數據管道。

此聯合參考架構演示了如何在 SQL Server 2025 中構建 RAG 應用,使其能夠直接生成嵌入、執行語義搜索并調用推理服務。這種方法可以在保留完整的數據主權的情況下,靈活地在數據所在的任何位置(如 Azure Cloud 或使用 Azure Local 進行本地部署)部署 NVIDIA Nemotron 等先進模型。

準備好開始了嗎?通過 NVIDIA/GenerativeAIExamples GitHub 存儲庫中的NVIDIA NIM with Microsoft SQL Server 2025 AI on Azure Cloud and Azure Local查閱所有部署腳本、代碼示例和云端及本地部署的詳細操作步驟。

-

NVIDIA

+關注

關注

14文章

5662瀏覽量

109942 -

AI

+關注

關注

91文章

40329瀏覽量

301921 -

模型

+關注

關注

1文章

3777瀏覽量

52179 -

Microsoft

+關注

關注

0文章

239瀏覽量

8029

原文標題:使用 NVIDIA Nemotron RAG 和Microsoft SQL Server 2025在企業數據上構建可擴展的 AI

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

NVIDIA 成立由全球領先 AI 實驗室組成的 Nemotron Coalition,推動開放前沿模型發展

利用NVIDIA Nemotron開放模型構建智能文檔處理系統

RAG(檢索增強生成)原理與實踐

如何在NVIDIA CUDA Tile中編寫高性能矩陣乘法

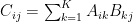

使用NVIDIA Nemotron模型構建語音驅動RAG智能體

NVIDIA 推出 Nemotron 3 系列開放模型

NVIDIA Nemotron如何助力企業構建專業AI智能體

NVIDIA擴大與微軟合作推動AI超級工廠建設

NVIDIA DGX Spark助力構建自己的AI模型

使用NVIDIA Nemotron RAG和Microsoft SQL Server 2025構建高性能AI應用

使用NVIDIA Nemotron RAG和Microsoft SQL Server 2025構建高性能AI應用

評論