電子發燒友網報道(文/梁浩斌)近日,英偉達在AI infra峰會上發布了專為大規模上下文推理設計的全新GPU系列Rubin CPX,性能堪稱炸裂!

英偉達創始人兼CEO黃仁勛表示,“正如 RTX 革新了圖形技術與物理 AI,Rubin CPX 則是首款專為大規模上下文 AI 設計的 CUDA GPU—— 在該場景下,模型可一次性基于數百萬個token進行推理。”

作為基于Rubin架構的一款AI芯片,Rubin CPX采用了成本效益極高的單芯片設計,集成強大的NVFP4計算資源,其GPU專為AI推理任務優化,可以實現極高的性能和能效比。按照英偉達的說法,Rubin CPX平臺可實現 30 至 50 倍的投資回報率(ROI),這意味著1億美元的資本性支出(CAPEX)投入,能帶來高達50億美元的收入,又呼應了老黃此前的名言“買得越多賺得越多”,這不是新一代“印鈔機”嗎?

那么Rubin CPX是怎么實現高效AI推理的?

為什么需要Rubin CPX?

要理解Rubin CPX的作用,首先要知道分布式推理的架構原理。

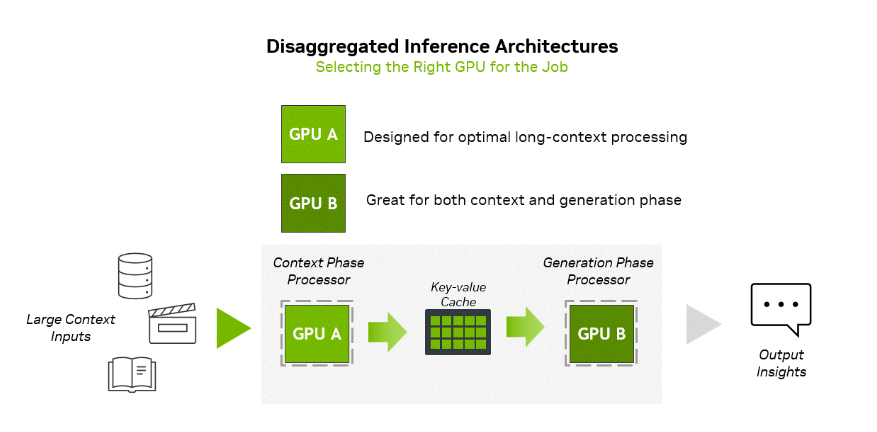

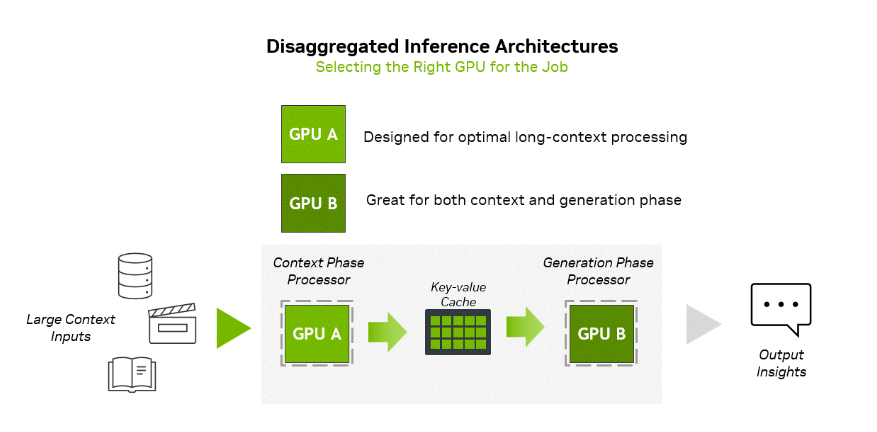

AI推理過程包含兩個截然不同的階段:上下文階段與生成階段,這兩個階段對AI基礎設施的需求存在本質差異。其中,上下文階段受計算能力限制,需要通過高吞吐量處理來接收并分析大量輸入數據,進而生成首個token輸出結果。

與之不同的是,生成階段受內存帶寬限制,需依賴高速內存傳輸及NVLink等高速互聯方案,以維持逐推理單元(token-by-token)的輸出性能。

為了提高計算效率,英偉達通過分布式推理可以實現這兩個階段的獨立處理,從而對計算和內存資源進行針對性優化。這一架構變革能夠提升吞吐量、降低延遲,并提高整體資源利用率。

為了提高計算效率,英偉達通過分布式推理可以實現這兩個階段的獨立處理,從而對計算和內存資源進行針對性優化。這一架構變革能夠提升吞吐量、降低延遲,并提高整體資源利用率。

具體來說,分布式推理的流程是,文檔 / 數據庫 / 視頻等數據輸入至上下文處理器;其輸出會傳輸至鍵值緩存(KV 緩存),供 GPU B 生成節點讀取以生成結果。GPU A 針對長上下文處理進行了優化,而 GPU B 則在上下文階段與生成階段均能實現出色的總擁有成本表現。

然而,分布式架構也帶來了新的復雜性層級,需要在低延遲 KV 緩存傳輸、大語言模型感知路由(LLM-aware Routing)及高效內存管理之間實現精準協同。英偉達 Dynamo可作為這些組件的編排層,其功能在最新的 MLPerf 推理基準測試結果中發揮了關鍵作用。

而分布式推理要發揮出其優勢,在上下文處理階段的效率提升尤為重要。Rubin CPX GPU就是專為解決這個階段的計算效率的一種解決方案,目標是為高價值長上下文推理工作負載提供高吞吐量性能,同時可無縫集成至分布式基礎設施中。

Vera Rubin NVL144 CPX平臺:GB300 NVL72的7.5倍性能

Rubin CPX 具備30 petaFLOPs的NVFP4計算能力、128 GB的GDDR7內存、硬件級別的視頻解碼/編碼支持,以及三倍于NVIDIA GB300的注意力機制加速性能。

比如處理視頻時,AI模型每處理1小時的內容可能需要多達100 萬個token,這突破了傳統 GPU的計算極限。Rubin CPX在單芯片中集成了視頻解碼器與編碼器,以及長上下文推理處理功能,從而在視頻搜索、高質量生成式視頻等長時長應用場景中,實現了前所未有的性能。

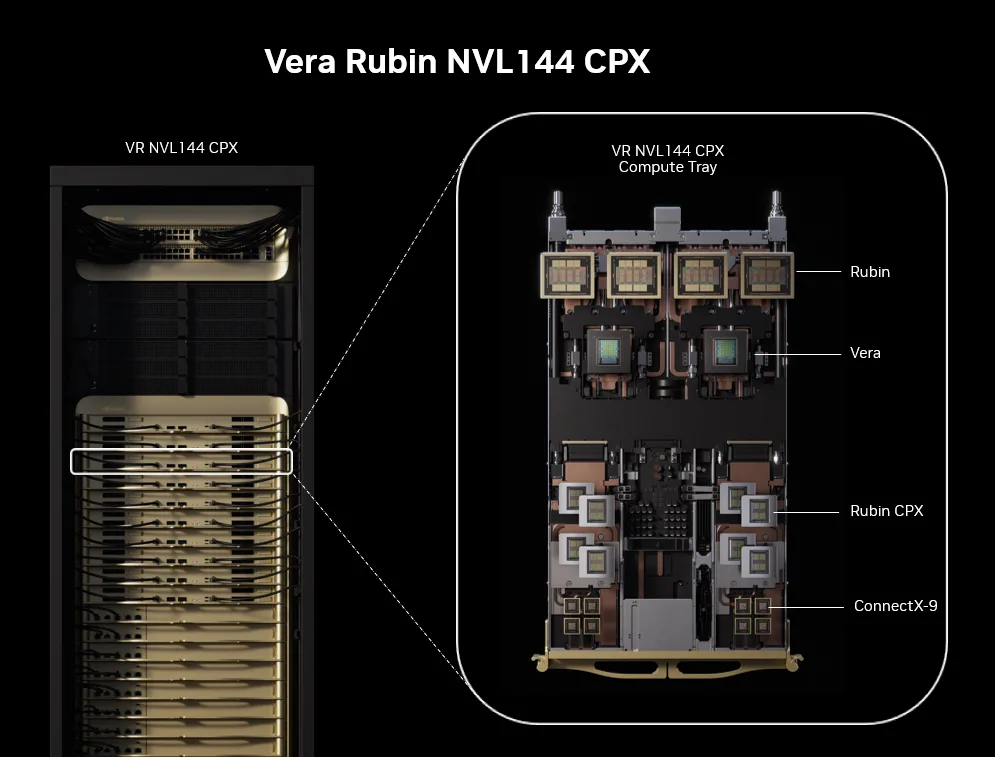

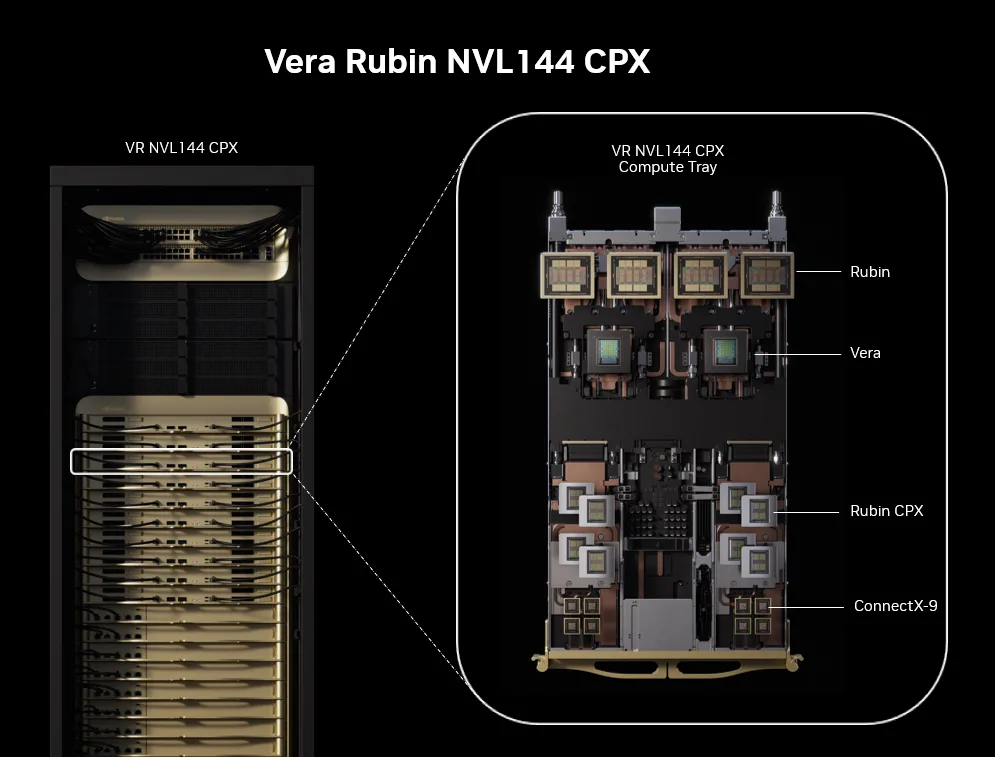

同時,英偉達也推出了一套集成Rubin CPX 、NVIDIA Vera CPU、Rubin GPU的完整高性能分布式服務解決方案——NVIDIA Vera Rubin NVL144 CPX。

?

?

Vera Rubin NVL144 CPX 圖源:英偉達

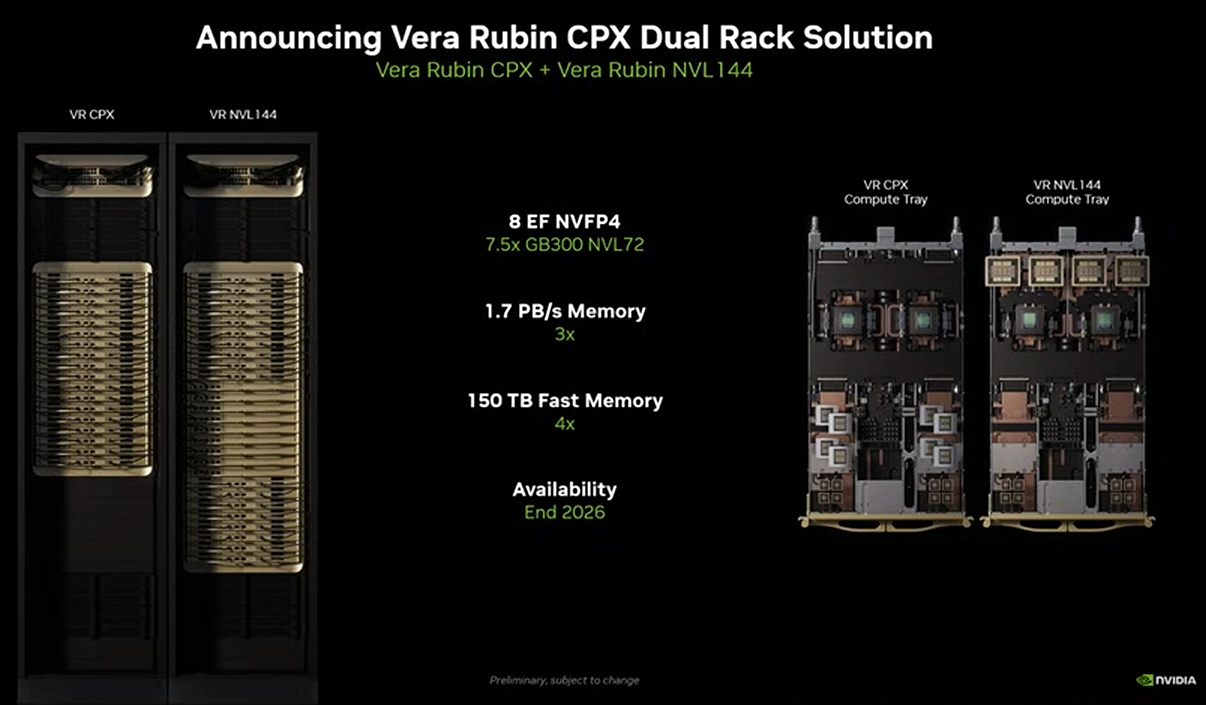

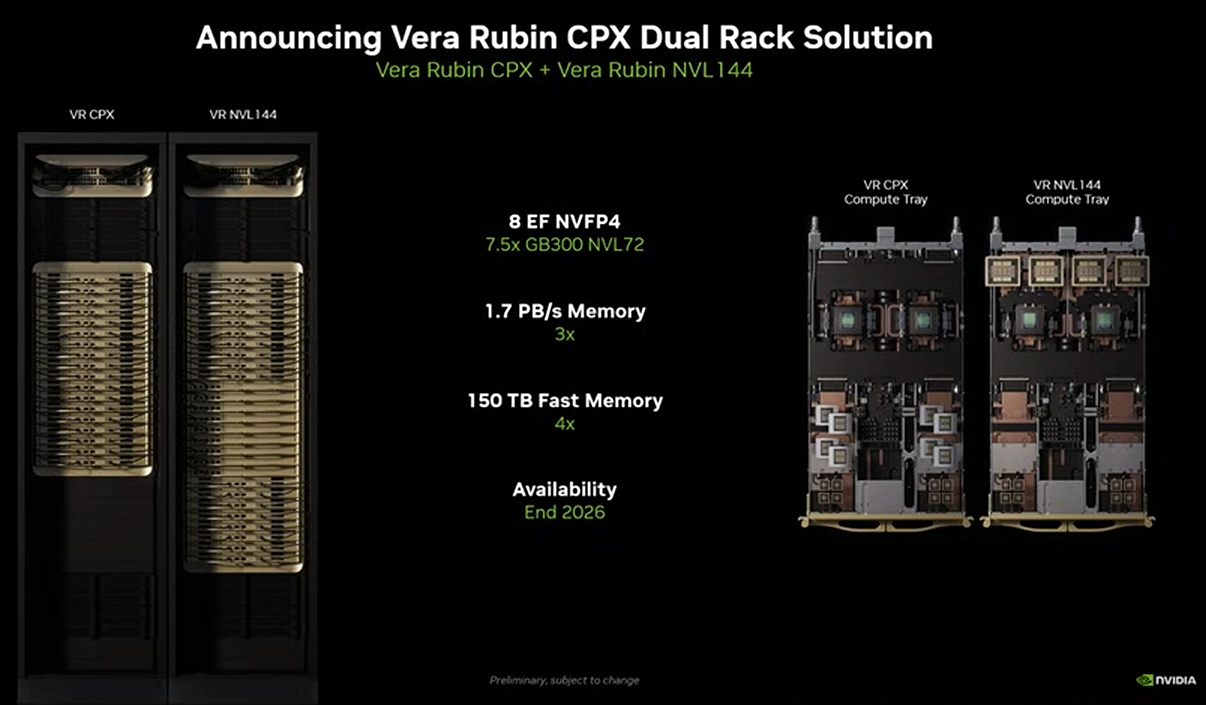

NVIDIA Vera Rubin NVL144 CPX機架集成144個Rubin CPX GPU、144個Rubin GPU 以及36個 Vera CPU,能夠實現8 exaFLOPs的NVFP4計算性能,是GB300 NVL72的7.5倍,同時還提供100 TB的高速內存和高達1.7 PB/s的內存帶寬。

Vera Rubin NVL144 CPX采用了NVIDIA Quantum-X800 InfiniBand或Spectrum-X以太網技術,與NVIDIA ConnectX-9 SuperNIC配合使用,并由Dynamo平臺進行管理。英偉達表示,在規模化應用中,該平臺能夠實現30至50倍的投資回報。

值得一提的是,對于已經訂購Vera Rubin NVL144系統的用戶,英偉達也提供專用的Rubin CPX 計算托盤,可以在現有的Vera Rubin NVL144系統上拓展推理能力。

值得一提的是,對于已經訂購Vera Rubin NVL144系統的用戶,英偉達也提供專用的Rubin CPX 計算托盤,可以在現有的Vera Rubin NVL144系統上拓展推理能力。

根據此前英偉達的上市時間表,Rubin架構GPU預計在2026年正式上市,預計在今年9月交付客戶測試。而同為Rubin架構的Rubin CPX GPU,英偉達預計會在2026年下半年上市,Vera Rubin NVL144 CPX則預計在2026年底上市。

近日英偉達宣布,年度技術大會GTC2026將會在2026年3月16日至19日舉行,預計在大會上將正式推出Rubin GPU和Vera CPU兩大產品。

寫在最后

Rubin CPX的推出,可以說是AI推理側的一顆“重磅炸彈”。正如黃仁勛提到的“Rubin CPX 是 AI 推理領域的 RTX”,AI算力硬件正在通過細分場景的優化,實現革命性的效率提升。同時借助Rubin CPX,英偉達開拓了算力硬件的新形式,占領長上下文推理領域的“無人區”。在視頻、代碼生成等用到巨量Token的領域,未來Rubin CPX可能會占據極為有利的生態位,繼續筑牢英偉達在AI基建市場的護城河。

英偉達創始人兼CEO黃仁勛表示,“正如 RTX 革新了圖形技術與物理 AI,Rubin CPX 則是首款專為大規模上下文 AI 設計的 CUDA GPU—— 在該場景下,模型可一次性基于數百萬個token進行推理。”

作為基于Rubin架構的一款AI芯片,Rubin CPX采用了成本效益極高的單芯片設計,集成強大的NVFP4計算資源,其GPU專為AI推理任務優化,可以實現極高的性能和能效比。按照英偉達的說法,Rubin CPX平臺可實現 30 至 50 倍的投資回報率(ROI),這意味著1億美元的資本性支出(CAPEX)投入,能帶來高達50億美元的收入,又呼應了老黃此前的名言“買得越多賺得越多”,這不是新一代“印鈔機”嗎?

那么Rubin CPX是怎么實現高效AI推理的?

為什么需要Rubin CPX?

要理解Rubin CPX的作用,首先要知道分布式推理的架構原理。

AI推理過程包含兩個截然不同的階段:上下文階段與生成階段,這兩個階段對AI基礎設施的需求存在本質差異。其中,上下文階段受計算能力限制,需要通過高吞吐量處理來接收并分析大量輸入數據,進而生成首個token輸出結果。

與之不同的是,生成階段受內存帶寬限制,需依賴高速內存傳輸及NVLink等高速互聯方案,以維持逐推理單元(token-by-token)的輸出性能。

具體來說,分布式推理的流程是,文檔 / 數據庫 / 視頻等數據輸入至上下文處理器;其輸出會傳輸至鍵值緩存(KV 緩存),供 GPU B 生成節點讀取以生成結果。GPU A 針對長上下文處理進行了優化,而 GPU B 則在上下文階段與生成階段均能實現出色的總擁有成本表現。

然而,分布式架構也帶來了新的復雜性層級,需要在低延遲 KV 緩存傳輸、大語言模型感知路由(LLM-aware Routing)及高效內存管理之間實現精準協同。英偉達 Dynamo可作為這些組件的編排層,其功能在最新的 MLPerf 推理基準測試結果中發揮了關鍵作用。

而分布式推理要發揮出其優勢,在上下文處理階段的效率提升尤為重要。Rubin CPX GPU就是專為解決這個階段的計算效率的一種解決方案,目標是為高價值長上下文推理工作負載提供高吞吐量性能,同時可無縫集成至分布式基礎設施中。

Vera Rubin NVL144 CPX平臺:GB300 NVL72的7.5倍性能

Rubin CPX 具備30 petaFLOPs的NVFP4計算能力、128 GB的GDDR7內存、硬件級別的視頻解碼/編碼支持,以及三倍于NVIDIA GB300的注意力機制加速性能。

比如處理視頻時,AI模型每處理1小時的內容可能需要多達100 萬個token,這突破了傳統 GPU的計算極限。Rubin CPX在單芯片中集成了視頻解碼器與編碼器,以及長上下文推理處理功能,從而在視頻搜索、高質量生成式視頻等長時長應用場景中,實現了前所未有的性能。

同時,英偉達也推出了一套集成Rubin CPX 、NVIDIA Vera CPU、Rubin GPU的完整高性能分布式服務解決方案——NVIDIA Vera Rubin NVL144 CPX。

?

?Vera Rubin NVL144 CPX 圖源:英偉達

NVIDIA Vera Rubin NVL144 CPX機架集成144個Rubin CPX GPU、144個Rubin GPU 以及36個 Vera CPU,能夠實現8 exaFLOPs的NVFP4計算性能,是GB300 NVL72的7.5倍,同時還提供100 TB的高速內存和高達1.7 PB/s的內存帶寬。

Vera Rubin NVL144 CPX采用了NVIDIA Quantum-X800 InfiniBand或Spectrum-X以太網技術,與NVIDIA ConnectX-9 SuperNIC配合使用,并由Dynamo平臺進行管理。英偉達表示,在規模化應用中,該平臺能夠實現30至50倍的投資回報。

根據此前英偉達的上市時間表,Rubin架構GPU預計在2026年正式上市,預計在今年9月交付客戶測試。而同為Rubin架構的Rubin CPX GPU,英偉達預計會在2026年下半年上市,Vera Rubin NVL144 CPX則預計在2026年底上市。

近日英偉達宣布,年度技術大會GTC2026將會在2026年3月16日至19日舉行,預計在大會上將正式推出Rubin GPU和Vera CPU兩大產品。

寫在最后

Rubin CPX的推出,可以說是AI推理側的一顆“重磅炸彈”。正如黃仁勛提到的“Rubin CPX 是 AI 推理領域的 RTX”,AI算力硬件正在通過細分場景的優化,實現革命性的效率提升。同時借助Rubin CPX,英偉達開拓了算力硬件的新形式,占領長上下文推理領域的“無人區”。在視頻、代碼生成等用到巨量Token的領域,未來Rubin CPX可能會占據極為有利的生態位,繼續筑牢英偉達在AI基建市場的護城河。

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

gpu

+關注

關注

28文章

5235瀏覽量

135901 -

英偉達

+關注

關注

23文章

4109瀏覽量

99506

發布評論請先 登錄

相關推薦

熱點推薦

Vera rubin平臺即將交付,英偉達800VDC電源方案進展如何?

電子發燒友網報道(文/梁浩斌)在剛剛結束的?GTC 2026上,英偉達推出了Vera Rubin POD,這是一套極致的軟硬件協同設計的多機架系統組成的集群,也是一臺AI超級計算機。 ? 具體來說

中國AI芯片市場:華為將占半壁江山,英偉達跌落,這家第二

2026年華為將占據中國AI芯片市場50%的份額,成為該領域的絕對領導者。 ? 目前,英偉達(NVIDIA)以39%的市場份額位居中國AI芯片

英特爾至強6“芯”動GTC 2026,為英偉達DCG Rubin解鎖系統級性能

在英偉達GTC 2026大會上,英特爾正式宣布,英特爾至強 6處理器將作為主控處理器,應用于NVIDIA DGX Rubin NVL8 系統。這一舉措充分彰顯了在AI工作負載快速邁向大規模、實時

SambaNova發布第五代RDU AI芯片,專為智能體推理工作負載設計

。SN50芯片專為智能體推理工作負載設計,具備超低延遲、高吞吐量和節能等突出特性,性能更是達到上代產品的5倍。在存儲結構上,它采用大容量內存 + HBM + SRAM的三層次架構,極大

從英偉達電話會看Agentic AI推理與FPGA價值

2026年2月,英偉達發布2026財年Q4財報:營收681億美元,同比增長73%,數據中心業務增長75%——預期中的超預期。更值得關注的,是電話會中反復出現的幾個關鍵詞:Agentic AI、

英偉達Rubin GPU采用鉆石銅散熱,解決芯片散熱難題

散熱難題帶來了新的曙光。 ? 隨著AI大模型、云計算的迭代提速,芯片算力與功耗同步飆升。英偉達新一代Vera Rubin GPU堪稱“算力巨

英偉達Rubin平臺引入微通道冷板技術,100%全液冷設計

電子發燒友網報道(文/李彎彎)英偉達在近期舉辦的 CES 2026 展會上,正式推出了其全新的 Vera Rubin 計算平臺。作為繼 Blackwell 架構之后的又一力作,Rubin

邁向吉瓦級AI工廠的能源變革:英偉達Rubin平臺電源架構解析

轉變。英偉達(NVIDIA)推出的Rubin平臺,作為Blackwell架構的繼任者,不僅是算力密度的又一次飛躍,更是對數據中心能源基礎設施的一次極限挑戰。

堪稱史上最強推理芯片!英偉達發布 Rubin CPX,實現50倍ROI

堪稱史上最強推理芯片!英偉達發布 Rubin CPX,實現50倍ROI

評論