該技術是一款以KV Cache為中心的推理加速套件,UCM集成了多類型緩存加速算法工具,實現推理過程中KV Cache記憶數據的分級管理,從而擴大推理上下文窗口,提升推理效率。“銀聯的實際案例和大量測試顯示,UCM顯著降低首Token的時延,最高降低90%,系統吞吐率最大提升22倍,上下文的推理窗口可以擴展10倍以上,這是對于AI推理系統一個巨大的進步。” 周越峰指出。

華為UCM技術已率先應用在中國銀聯“客戶之聲”、“營銷策劃”和“辦公助手”三大業務場景,開展智慧金融AI推理加速應用試點,并且已經取得成果。華為表示,計劃于2025年9月正式開源UCM,將在魔擎社區首發,并共享給業內所有Share Everything(共享架構)存儲廠商和生態伙伴。

AI大模型推理給存儲帶來哪些挑戰?UCM的創新之處如何解讀?本文結合中國信通院人工智能研究平臺與工程化部主任曹峰、華為數據存儲產品線AI存儲首席架構師李國杰的觀點,進行詳細分析。

AI大模型推理給存儲帶來三重挑戰

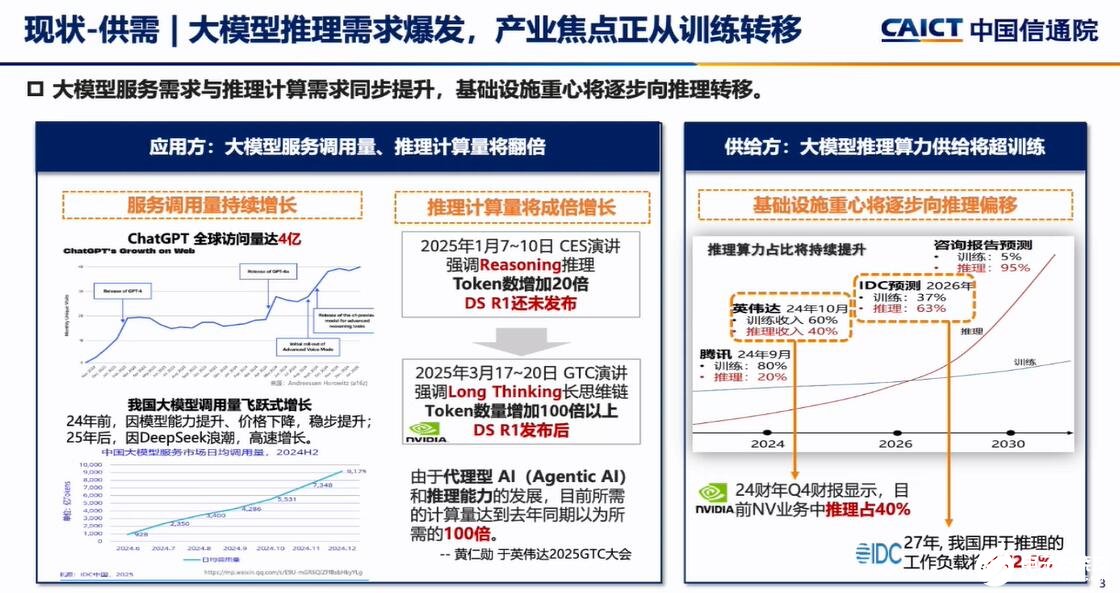

“ChatGPT的訪問量呈現線性增長,最新訪問量達到4億,受益于中國AI大模型DeepSeek爆發,日均調用量也在快速上升,2025年1月開始,中國AI推理的需求增長20倍,未來三年算力需求爆發。IDC表示,2024年算力需求60%是訓練,40%是推理,到2027年中國用于推理的算力需求——工作負載將達到72.6%。” 中國信通院人工智能研究平臺與工程化部主任曹峰分析說。

當下,AI大模型推理應用落地中,遇到推不動、推得慢和推得貴的三大挑戰。首先,長文本越來越多,輸入超過模型上下文窗口的內容,推理窗口小就推不動;其次,由于中美在AI基礎設施的差距,中國互聯網大模型首Token時延普遍慢于美國頭部廠商的首Token時延,時延長度為后者的兩倍;推得貴,美國大模型的推理吞吐率為中國大模型推理吞吐率的10倍。

華為公司副總裁、數據存儲產品線總裁周越峰指出,AI時代,模型訓練、推理效率與體驗的量綱都以Token數為表征,Token經濟已經到來。

在AI基礎設施投資,中國和美國有差距,為了保障流暢的推理體驗,企業要加大算力投入,但是如何改善AI推理的效率和體驗,在推理效率與成本之間找到最佳平衡點?華為推出UCM,以KV Cache和記憶管理為中心提供全場景化系列化推理加速能力。

UCM兩大關鍵能力和創新算法,破解HBM受困難題

HBM是解決"數據搬運"的關鍵技術。當HBM不足時,用戶使用AI推理的體驗會明顯下降,導致出現任務卡頓、響應慢等問題。華為此次技術突破有望緩解這一瓶頸。

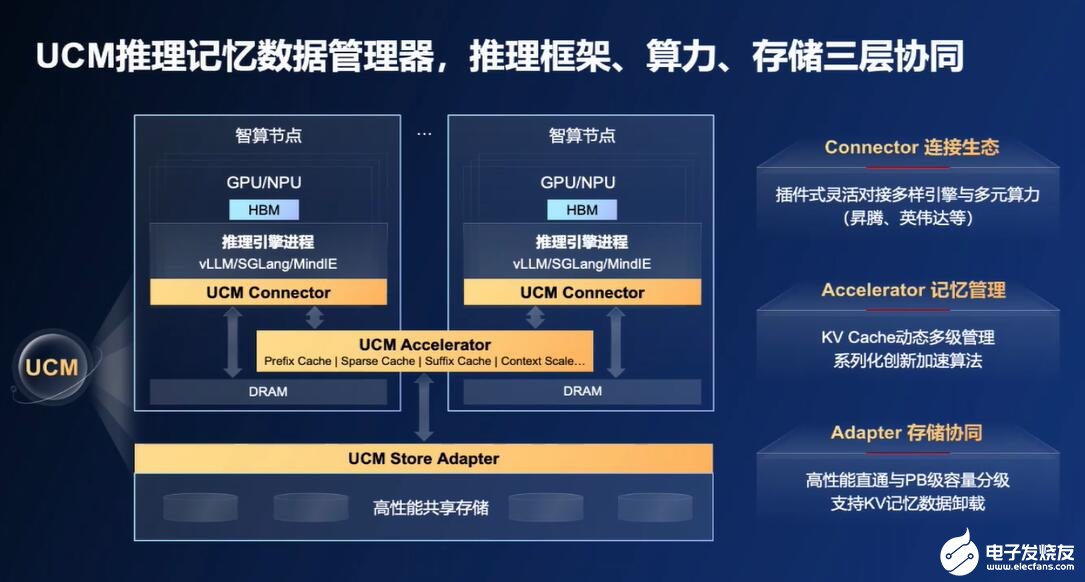

華為重磅推出UCM推理記憶數據管理器,包括對接不同引擎與算力的推理引擎插件(Connector)、支持多級KV Cache管理及加速算法的功能庫(Accelerator)、高性能KV Cache存取適配器(Adapter)三大組件,通過推理框架、算力、存儲三層協同,實現AI推理“更優體驗、更低成本”。

UCM的創新之處,在于可以根據記憶熱度在HBM、DRAM、SSD等存儲介質中實現按需流動,同時融合多種稀疏注意力算法實現存算深度協同,使長序列場景下TPS(每秒處理token數)提升2至22倍,從而降低每個Token的推理成本。

“實時數據放在HBM當中,短期記憶數據放在DRAM中,其他數據就放在共享存儲SSD中,極大提高系統的效率和AI推理能力。針對AI推理平衡成本和效能的挑戰,華為推出UCM統一的記憶數據管理器,在兩個層面以系統化的方案來解決問題。” 華為數據存儲產品線AI存儲首席架構師李國杰表示。

一、在底層的框架和機制上提供了多級緩存空間,構建智能管理以及智能流動的基礎框架能力。在此基礎之上,華為構筑了一系列創新的推理的加速算法和加速特性,包括自適應的全局Prefix Cache,降低首Token時延與單位Token成本。

二、采用動態的Training稀疏加速算法,倍數級提升長序列吞吐和體驗。還有后綴檢索、預測加速算法、PD檢索加速和Agent原生記憶加速。

UCM將超長序列Cache分層卸載至外置專業存儲,通過算法創新突破模型和資源限制,實現推理上下文窗口的10倍級擴展,滿足長文本處理需求。

中國銀聯執行副總裁涂曉軍分享說,華為與中國銀聯的聯合創新技術試點中,在中國銀聯的“客戶之聲”業務場景下,借助UCM技術及工程化手段,大模型推理速度提升125倍,僅需10秒就可以精準識別客戶高頻問題,促進服務質量提升。

眾所周知,目前,AI大模型訓練對內存帶寬需求呈指數級增長,傳統DDR內存已無法滿足需求。HBM(高帶寬內存)是一種專用內存技術,用于 AI 處理器、GPU 和 HPC 系統,這些系統中帶寬和能效比原始容量更為重要。HBM3 每堆棧可提供高達 819 GB/s 的傳輸速度,對于支持大型語言模型 (LLM)、神經網絡訓練和推理工作負載至關重要。

但是去年12月以來美國將HBM2E列入對中國的禁售清單,國產廠商HBM的突破還在推進中,華為推出UCM的重大意義,在于加速推進國產AI推理生態,其核心價值是推進更快的推理響應和更長的推理序列,以及更優化的成本。

中國信通院人工智能研究平臺與工程化部主任曹峰認為,國產化AI推理生態建設應該加速,KV Cache已經成為架構優化的焦點,以KV Cache為核心的推理方案迭出,背后依賴的高性能存儲、先進調度策略的重要性愈發顯現。

李國杰還強調指出,AI是一個快速發展的行業,每6個月就會迎來新一輪的技術革新,UCM不僅定位于當下,解決AI推理問題,未來發展UCM將從KV Cache分層管理走向Agentic AI原生記憶管理和應用加速。

本文由電子發燒友原創,轉載請注明以上來源。微信號zy1052625525。需入群交流,請添加微信elecfans999,投稿爆料采訪需求,請發郵箱zhangying@huaqiu.com。

-

華為

+關注

關注

218文章

36005瀏覽量

262109 -

UC

+關注

關注

2文章

58瀏覽量

61985 -

銀聯

+關注

關注

0文章

13瀏覽量

9603 -

HBM

+關注

關注

2文章

431瀏覽量

15835 -

AI大模型

+關注

關注

0文章

398瀏覽量

999

發布評論請先 登錄

使用NORDIC AI的好處

華為發布并開源創新AI容器技術Flex:ai

AI推理芯片賽道猛將,200億市值AI芯片企業赴港IPO

華為破解HBM依賴!AI推理黑科技UCM上線,9月正式開源

華為破解HBM依賴!AI推理黑科技UCM上線,9月正式開源

評論