機器人領域的一大核心挑戰在于如何讓機器人掌握新任務,而無需針對每個新任務和環境耗費大量精力收集和標注數據集。NVIDIA 的最新研究方案通過生成式 AI、世界基礎模型(如NVIDIA Cosmos)以及數據生成藍圖(如Isaac GR00T-Mimic與GR00T-Dreams)來克服這一挑戰。

本期 NVIDIA 機器人研究與開發摘要 (R2D2) 將介紹如何通過世界基礎模型實現可擴展的合成數據生成與機器人模型訓練工作流,具體包括:

DreamGen:Isaac GR00T-Dreams blueprint的研究基礎。

GR00T N1:開源基礎模型,使機器人能夠通過真實數據、人類演示和合成數據學習跨任務與形態的通用技能。

通過視頻進行潛在動作預訓練:無監督的學習方法,無需人工動作標注,就能從大規模視頻中學習機器人相關動作。

仿真與現實協同訓練:結合仿真環境與真實世界機器人數據的訓練方法,可構建更具魯棒性和適應性的機器人策略。

機器人世界基礎模型

NVIDIA Cosmos 世界基礎模型經過數百萬小時真實世界數據訓練,能夠預測未來世界狀態,并基于單張輸入圖像生成視頻序列。這項技術使機器人和自動駕駛車輛具備預判未來事件的能力,這種預測能力對于合成數據生成流程至關重要,有助于快速創建多樣化、高保真的訓練數據。這一方法大幅加速了機器人的學習過程,提升了模型的魯棒性,并將原本需要數月人工投入的開發時間縮短至僅數小時。

DreamGen

DreamGen 是一種合成數據生成流程。機器人學習需要收集大規模人類遠程操作數據,成本高昂且耗費人力,而 DreamGen 就有助于解決這一問題,它是 Isaac GR00T-Dreams 的基礎,這一藍圖可借助世界基礎模型生成海量的合成機器人軌跡數據。

傳統的機器人基礎模型在面對每一項新任務和新環境時,都需要大量人工演示,這種方式不具備可擴展性。而基于仿真的替代方案則經常受到“仿真到現實”差距的困擾,且需要大量人工工程投入。

DreamGen 通過世界基礎模型突破這些限制,僅需極少量人工干預即可生成高真實性、多樣化的訓練數據。該方法實現了機器人學習的規模化擴展,并能在不同行為模式、環境場景及機器人形態間實現泛化。

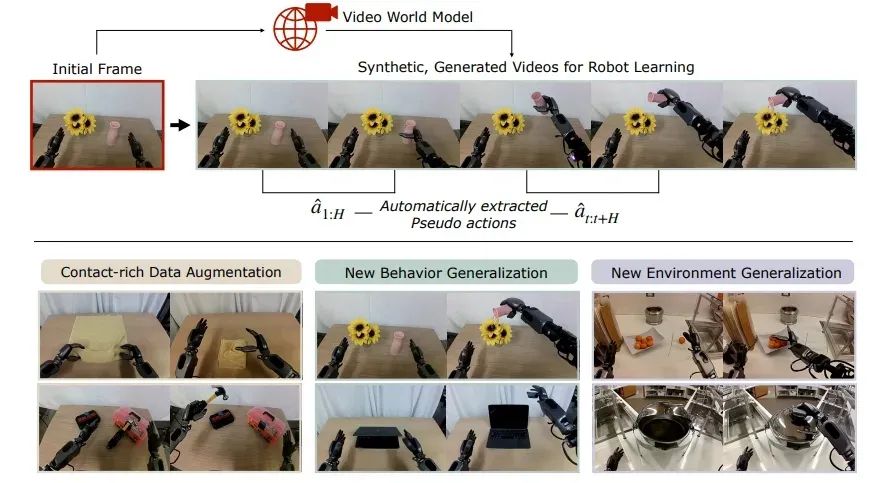

圖 1. 通過 DreamGen 實現泛化

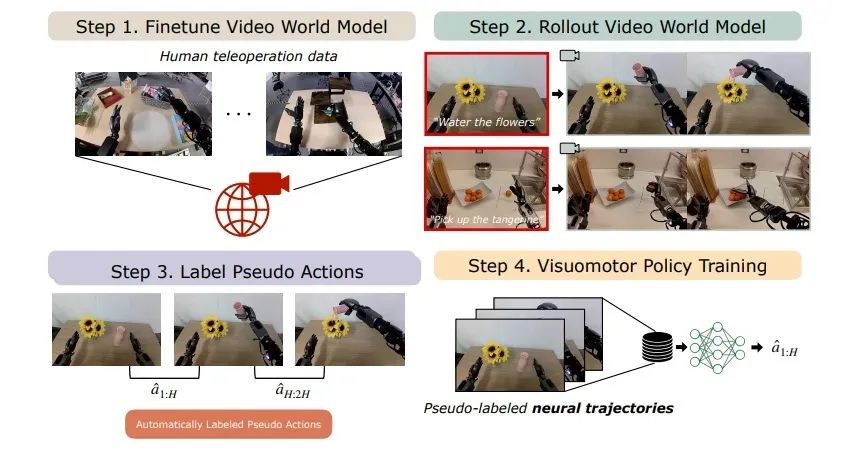

DreamGen 技術流程包含四個核心步驟:

1. 世界基礎模型的后訓練:

利用少量真實演示數據,將Cosmos-Predict2等世界基礎模型適配至目標機器人。Cosmos-Predict2 能夠通過文本生成高質量圖像(文本到圖像),并通過圖像或視頻生成視覺仿真內容(視頻到世界)。

2. 生成合成視頻:

基于經過后訓練的模型,通過圖像和語言提示,為新任務與新環境創建多樣化、逼真的機器人視頻。

3. 提取偽動作:

應用潛在動作模型或逆動力學模型 (IDM),將這些視頻轉換為帶標簽的動作序列(神經軌跡)。

4. 訓練機器人策略:

利用生成的合成軌跡訓練視覺運動策略,使機器人能夠執行新行為,并能泛化至未見過的場景。

圖 2. DreamGen 工作流概覽

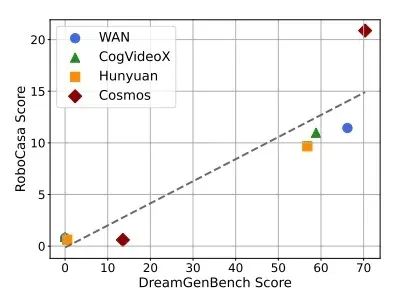

DreamGen Bench

DreamGen Bench 是一個專門設計的基準測試,用于評估視頻生成模型在適配特定機器人形態時的效果,同時考察這些模型對剛體物理規律的內化程度,以及向新物體、新行為和新環境的泛化能力。該基準測試對四個領先的世界基礎模型進行測試,分別是 NVIDIA Cosmos、WAN 2.1、混元和 CogVideoX,并衡量兩項關鍵指標:

指令遵循:評估生成視頻是否準確反映任務指令(如"拿起洋蔥"),采用 Qwen-VL-2.5 等視覺語言模型和人工標注進行雙重驗證。

物理規律遵循:通過 VideoCon-Physics 和 Qwen-VL-2.5 等工具量化物理真實性,確保視頻符合真實世界物理規律。

如圖 3 所示,我們發現,在 DreamGen 基準測試中得分較高的模型(即能夠生成更真實且符合指令的合成數據的模型),在用于機器人真實操作任務的訓練和測試時,也有更優的性能表現。這種正相關關系表明,投入研發更強大的世界基礎模型,不僅能提升合成訓練數據的質量,還能直接轉化為實際應用中能力更強、適應性更優的機器人。

圖 3. DreamGen Bench 與 RoboCasa 之間的性能正相關

Isaac GR00T-Dreams

基于 DreamGen 研究的 Isaac GR00T-Dreams,是一套用于生成大規模機器人動作合成軌跡數據集的工作流。這些數據集可用于實體機器人的訓練,與收集真實世界動作數據相比,能節省大量時間和人力投入。

GR00T-Dreams 借助 Cosmos Predict2 世界基礎模型和Cosmos Reason來為不同任務和環境生成數據。Cosmos Reason 模型包含多模態大型語言模型,能針對用戶提示生成基于物理原理的響應。

通用機器人訓練模型與工作流

視覺語言動作 (VLA) 模型可以通過世界基礎模型生成的數據進行后訓練,從而在未知環境中實現新的行為和操作。

NVIDIA 研究中心使用 GR00T-Dreams blueprint 生成合成訓練數據,僅用 36 小時就開發出了GR00T N1的升級版本GR00T N1.5。如果采用人工收集數據的方式,這個過程需要近三個月時間。

GR00T N1 是全球首個面向通用人形機器人的開源基礎模型,標志著機器人和 AI 領域的重大突破。該模型采用受人類認知啟發的雙系統架構,統一了視覺、語言和動作,使機器人能夠理解指令、感知環境并執行復雜的多步驟任務。

GR00T N1 以通過視頻進行潛在動作預訓練 (LAPA) 等技術為基礎,能夠從無標簽的人類視頻中學習,同時它還采用了仿真與現實協同訓練等方法,通過融合合成數據與真實世界數據來增強模型的泛化能力。本文后續將詳細介紹 LAPA 和仿真與現實協同訓練技術。通過整合這些創新成果,GR00T N1 不僅能夠遵循指令、執行任務,更在復雜且不斷變化的環境中,為通用人形機器人的能力設立了新標桿。

GR00T N1.5 是基于 GR00T N1 升級的通用人形機器人開源基礎模型,其特點是采用了經過優化的視覺語言模型,該模型訓練數據包括真實數據、仿真數據和 DreamGen 生成的合成數據的多樣化組合。

通過架構優化與數據質量提升,GR00T N1.5 實現了三大核心突破:提升任務成功率、增強語言理解能力、增強對新物體與任務的泛化能力,從而成為更穩定可靠、適應性更強的先進機器人操作解決方案。

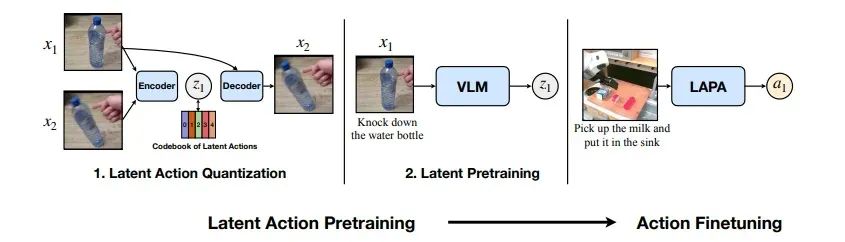

通過視頻進行潛在動作預訓練

通過視頻進行潛在動作預訓練 (LAPA) 是一種用于視覺-語言-動作 (VLA) 模型預訓練的無監督方法,無需使用成本高昂且需人工標注的機器人動作數據。LAPA 不依賴大規模帶標注的數據集,這類數據集的收集既昂貴又耗時,而是利用超過 181,000 個未標注的互聯網視頻來學習有效的特征表示。

這種方法在真實世界任務中,相比先進模型實現了 6.22% 的性能提升,且預訓練效率提高了 30 倍以上,這使得具備可擴展性和穩健性的機器人學習變得更加便捷高效。

LAPA 工作流分為三個階段:

潛在動作量化:Vector Quantized Variational AutoEncoder (VQ-VAE) 模型通過分析視頻幀之間的轉換,學習離散的“潛在動作”,從而構建一套基礎行為詞匯(例如抓取、傾倒)。潛在動作是低維度的習得表征,可概括復雜的機器人行為或運動,便于對高維度動作進行控制或模仿。

潛在預訓練:利用行為克隆對 VLM 進行預訓練,使其能基于視頻觀察結果和語言指令,預測第一階段得到的這些潛在動作。行為克隆是一種模型學習方法,通過將觀察結果映射到動作,利用演示數據中的示例來復制或模仿動作。

機器人后訓練:之后,使用小型帶標簽數據集對預訓練模型進行后訓練,使其適配實體機器人,將潛在動作映射為物理指令。

圖 4. 潛在動作預訓練概覽

仿真與現實協同訓練工作流

機器人策略訓練面臨兩大關鍵挑戰:一是收集真實世界數據的成本高昂;二是存在“現實差距”,僅在仿真環境中訓練的策略,往往難以在真實物理環境中良好運行。

仿真與現實協同訓練工作將少量真實世界機器人演示數據與大量仿真數據相結合,有效解決了這些問題。這種方法能夠訓練出魯棒策略,同時有效降低成本并彌合現實差距。

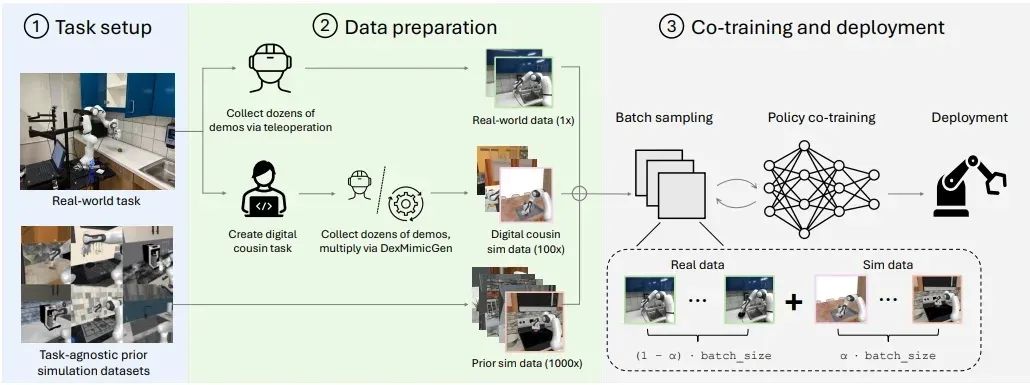

圖 5.仿真與現實協同訓練工作流概覽

該工作流的關鍵步驟如下:

任務與場景設置:搭建真實世界任務場景,并選擇與任務無關的先驗仿真數據集。

數據準備:在數據準備階段,從實體機器人收集真實世界演示數據,同時生成額外的仿真演示數據。這些仿真數據既包括與真實任務高度匹配的、具有任務針對性的“digital cousins”數據,也包括多樣化的、與任務無關的先驗仿真數據。

協同訓練參數調優:隨后,將這些不同來源的數據按優化后的協同訓練比例進行融合,重點在于對齊攝像頭視角并最大化仿真數據的多樣性(而非追求照片級真實感)。最后階段包括批量采樣,以及利用真實數據和仿真數據進行策略協同訓練,最終得到可部署在機器人上的穩健策略。

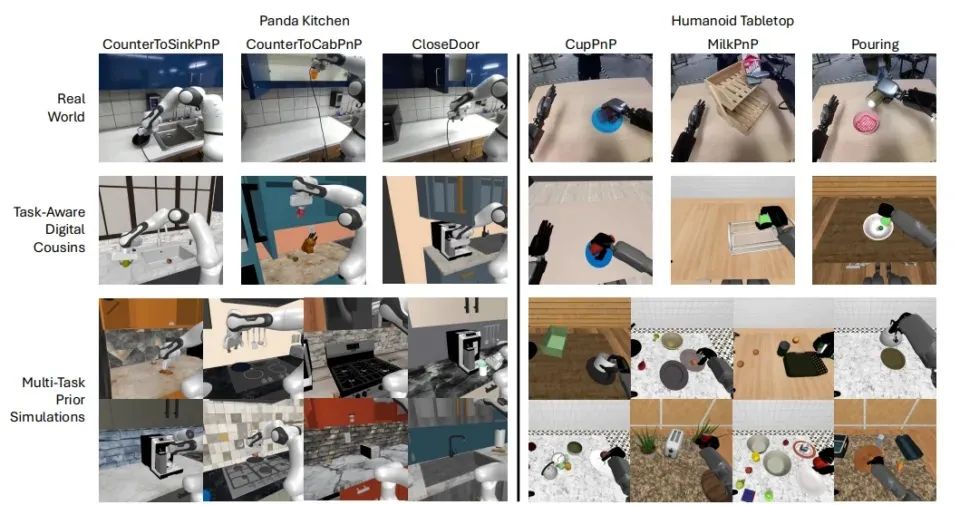

圖 6. 仿真與現實任務對比示意圖

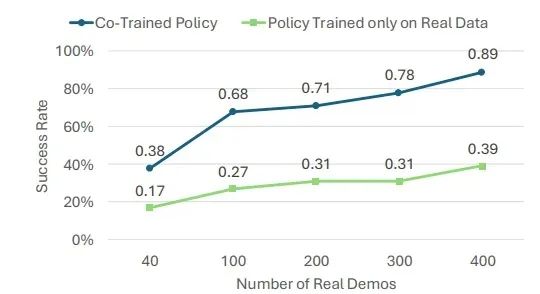

如圖 7 所示,增加真實演示數據的數量,能提升僅使用真實數據訓練策略,以及經過協同訓練策略的成功率。即使使用 400 組真實演示數據,協同訓練策略的表現仍始終優于僅用真實數據訓練的策略,平均提升幅度達 38%。這表明,即便在數據充足的場景中,仿真與現實協同訓練依然能帶來顯著成效。

圖 7. 協同訓練策略與純真實數據策略性能對比圖

生態系統應用

領先的機器人公司正在采用 NVIDIA 研究中心開發的工作流來加速研發進程。GR00T N 系列模型的早期采用者包括:

AeiRobot:應用該模型使工業機器人能夠理解自然語言指令,完成復雜分揀放置任務。

Foxlink:利用模型提升工業機械臂的作業靈活性與操作效率。

光輪智能:通過模型驗證合成數據,加速人形機器人在工廠場景的部署進程。

NEURA Robotics:評估模型性能以加速家庭自動化系統的研發。

-

機器人

+關注

關注

213文章

31073瀏覽量

222162 -

NVIDIA

+關注

關注

14文章

5592瀏覽量

109713 -

AI

+關注

關注

91文章

39755瀏覽量

301350

原文標題:R2D2:利用 NVIDIA 研究中心的工作流和世界基礎模型訓練通用機器人

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

NVIDIA Isaac 機器人平臺利用最新的生成式 AI 和先進的仿真技術,加速 AI 機器人技術的發展

Al大模型機器人

NVIDIA Cosmos世界基礎模型平臺發布

英偉達推出基石世界模型Cosmos,解決智駕與機器人具身智能訓練數據問題

NVIDIA通過全新 Omniverse庫、Cosmos物理AI模型及AI計算基礎設施,為機器人領域開啟新篇章

NVIDIA三臺計算機解決方案如何協同助力機器人技術

NVIDIA Jetson Thor:開啟通用機器人新時代

機器人看點:寧德時代入股銀河通用機器人 機器人企業扎堆赴港上市

NVIDIA 利用全新開源模型與仿真庫加速機器人研發進程

利用NVIDIA Cosmos開放世界基礎模型加速物理AI開發

NVIDIA Cosmos世界基礎模型如何塑造機器人未來

利用NVIDIA Cosmos模型訓練通用機器人

利用NVIDIA Cosmos模型訓練通用機器人

評論