7月26日,以“智能時代,同球共濟”為主題的2025世界人工智能大會在上海開幕;亮點很多。我們看到在世界人工智能大會論壇上,螞蟻數科正式發布了金融推理大模型Agentar-Fin-R1,金融推理大模型Agentar-Fin-R1是基于Qwen3研發,Agentar-Fin-R1包括有32B和8B參數兩個版本。在FinEval1.0、FinanceIQ等權威金融大模型評測基準上超越Deepseek-R1等同尺寸開源通用大模型以及金融大模型。更為重要的是,Agentar-Fin-R1還能不斷更新迭代,更新金融政策、市場動態等關鍵信息,并通過配套評測工具進行針對性優化。

螞蟻數科還推出基于百靈大模型的MOE架構模型,獲得更優推理速度。此外,還有非推理版本的14B和72B參數大模型,以滿足金融機構在多樣化場景下的部署需求。

正如螞蟻數科表達的那樣,AI智能體產業價值釋放的關鍵在于“水平通用”向“垂直專用”的戰略轉變。金融AI應用更需要“可靠、可控、可優化”;這也是金融推理大模型Agentar-Fin-R1的優勢。

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

螞蟻

+關注

關注

0文章

18瀏覽量

8122 -

大模型

+關注

關注

2文章

3726瀏覽量

5257

發布評論請先 登錄

相關推薦

熱點推薦

大模型推理服務的彈性部署與GPU調度方案

7B 模型 FP16 推理需要約 14GB 顯存,70B 模型需要 140GB+,KV Cache 隨并發數線性增長,顯存碎片化導致實際利用率不足 60%。

LLM推理模型是如何推理的?

這篇文章《(How)DoReasoningModelsReason?》對當前大型推理模型(LRM)進行了深刻的剖析,超越了表面的性能宣傳,直指其技術本質和核心局限。以下是基于原文的詳細技術原理、關鍵

軟通動力榮膺螞蟻數科“領航AI Agent合作伙伴”

12月11日,首屆螞蟻數科生態合作伙伴大會在蘇州召開。大會以“與AI同行· 價值共生”為主題,匯聚數字科技產業鏈核心力量,共探AI大模型產業落地路徑與生態協同機遇,軟通動力高級副總裁霍

華為數據存儲與「DaoCloud 道客」發布AI推理加速聯合解決方案

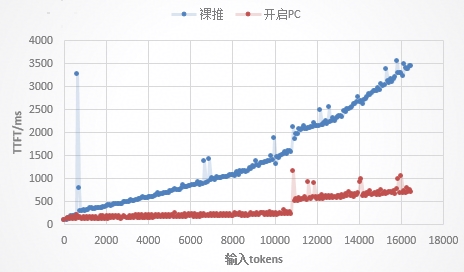

規模化發展的攔路虎。在有限算力下,長序列輸入導致首Token時延(TTFT)增加,甚至超長序列超出模型上下文窗口限制;隨著并發數增加,推理吞吐開始下降,任務頻繁卡頓;歷史對話和行業知識的重復調用造成算力浪費,加大

什么是AI模型的推理能力

NVIDIA 的數據工廠團隊為 NVIDIA Cosmos Reason 等 AI 模型奠定了基礎,該模型近日在 Hugging Face 的物理推理模型排行榜中位列榜首。

華為亮相2025金融AI推理應用落地與發展論壇

近日,2025金融AI推理應用落地與發展論壇在上海舉行。中國銀聯執行副總裁涂曉軍、華為數字金融軍團CEO曹沖出席本次論壇并發表致辭。論壇上,華為公司副總裁、數據存儲產品線總裁周躍峰博士發布

請問如何在RK3588上使用npu,用onnx模型來推理

請問如何在瑞芯微 RK3588上使用npu,用onnx模型來推理。官網上介紹說要把ONNX模型轉換成RKNN模型。但是我并不想這么干,請問有什么辦法嗎?

發表于 08-09 00:51

大模型推理顯存和計算量估計方法研究

隨著人工智能技術的飛速發展,深度學習大模型在各個領域得到了廣泛應用。然而,大模型的推理過程對顯存和計算資源的需求較高,給實際應用帶來了挑戰。為了解決這一問題,本文將探討大模型

發表于 07-03 19:43

超低延時重構AI推理體驗!白山云發布“大模型API”產品

白山云科技正式發布“大模型API”產品,首發上線DeepSeek-R1-0528、DeepSeek-R1-0528-Qwen3-8B、Qwen3-32B-FP8等大語言模型。基于白山全球邊緣云架構

GAITC2025|張科:端云一體大模型推理應用實戰

出席并在《行業大模型應用與發展》論壇發表演講,首次深入介紹京東零售在端云一體大模型推理架構的實戰經驗與技術探索,并分享AI推理方向的未來發展思考。 以下為張

商湯科技“小浣熊家族”與螞蟻集團旗下智能體開發平臺“螞蟻百寶箱”正式達成生態合作

打開螞蟻百寶箱,跳出一只商湯小浣熊。 商湯科技“小浣熊家族”與螞蟻集團旗下智能體開發平臺“螞蟻百寶箱”正式達成生態合作,雙方聯合打造“AI數據分析助手”,為百寶箱廣大用戶提供大模型服務

中興通訊星云大模型登頂SuperCLUE推理專項榜單

近日,中文大模型權威測評基準SuperCLUE發布《中文大模型基準測評2025年5月報告》。報告顯示,中興通訊自主研發的星云大模型NebulaCoder-V6在

螞蟻數科正式發布金融推理大模型

螞蟻數科正式發布金融推理大模型

評論