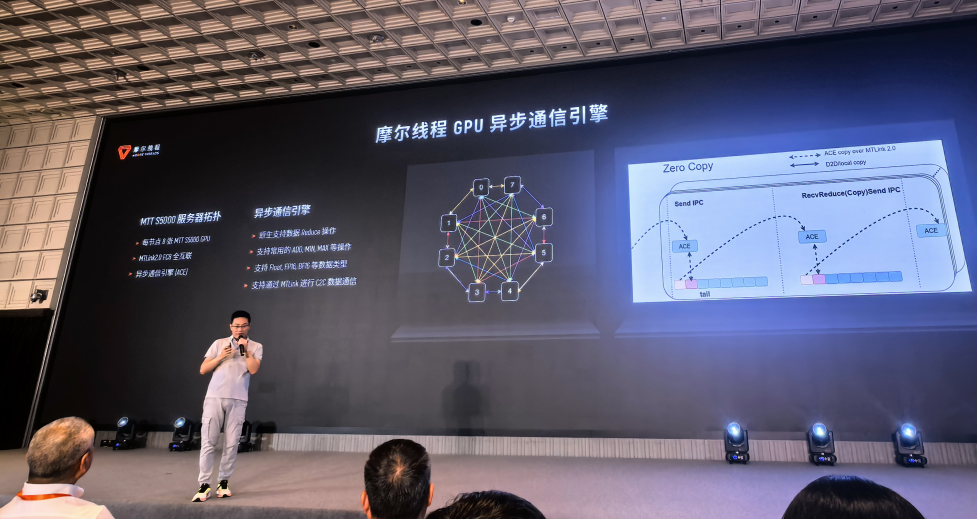

WAIC 2025前夕,在摩爾線程技術分享日上,摩爾線程GPU 計算軟件開發總監吳慶,發表了題為《摩爾線程 MUSA 軟件棧助力 KUAE 集群釋放無限潛能》的演講。他從專業視角出發,深入剖析了 MUSA 軟件棧在驅動 KUAE 集群高效運轉方面的核心技術與創新成果。

摩爾線程GPU 計算軟件開發總監吳慶在WAIC 期間的技術分享 (來源:電子發燒友網拍攝)

一、MUSA 驅動和運行時庫:KUAE 集群的堅實底座?

首先是驅動的重要性。在推理場景中,Kernel 延時如同懸在高效運算頭上的 “達摩克利斯之劍”,對運算效率影響極大。而摩爾線程的 MUSA 驅動和運行時庫就像是一位技藝精湛的調度大師,憑借自身高效的任務調度能力,將用戶的 Kernel launch 開銷大幅縮減,為 KUAE 集群筑牢了根基。

吳慶詳細介紹,MUSA 實現即時任務下發,通過獨特的軟硬協同方式,將核函數啟動延遲成功降低到業界平均水平的 1/2。打個比方,這就如同在酷熱的仲夏,人們能夠借助手機遠程提前開啟暴曬在戶外車輛的空調,待上車時便能立刻享受清涼。MUSA 正是巧妙地將調度開銷前置,在上一個 Kernel 執行尚未結束時,就提前有條不紊地完成下一個 Kernel 的配置,由此最大程度減少了 Kernel 間的調度延時,讓運算銜接更加緊密流暢。?

在批量任務下發方面,吳慶表示,MUSA 將近千次的計算和通信任務下發開銷巧妙優化為單次。他舉例解釋道,這類似于汽車座椅的一鍵記憶功能,駕駛者只需輕松操作一次,就能一次性打包調節好多個復雜步驟,后續使用時無需再重復繁瑣操作。在實際應用中,這種優化帶來的端到端收益因不同應用場景而有所差異,最高可達好幾倍,極大節省了 GPU 的等待時間,提升了整體運算效率。

談及引擎間依賴解析能力,吳慶強調,GPU 擁有多引擎可配置的特性,MUSA 借助硬件解析引擎間的依賴進行同步,這一創新之處在于無需再回到 host,從而使任務流之間的依賴解析延時大幅降低至 1.5μs,相較于業界頭部算力卡表現更為出色。此外,吳慶還介紹了調優工具接口 MUPTI,它能夠像貼心助手一般,幫助開發者深入優化 MUSA 應用程序;而 GPU 錯誤轉存功能(GCD)則在程序遭遇出錯情況時,迅速生成詳細信息,大大提升了問題定位的效率,為程序穩定運行保駕護航。?

二、MUSA 算子庫生態:性能與廣度兼備?

吳慶在演講中著重提到,算子庫的效率在分布式集群的訓練過程中扮演著關鍵角色,恰似汽車的引擎決定著汽車的動力表現。MUSA 算子庫在研發過程中,始終秉持著追求極致性能的理念,同時兼顧覆蓋廣度和兼容性,致力于為用戶提供豐富多元的選擇。?

MUSA 算子庫生態涵蓋三大算子庫。吳慶首先介紹了 muDNN,它堪稱是開箱即用的標準算子庫,功能十分全面,完整覆蓋常見的前向和反向算子,對完整的 XMMA、Tensor Core 全精度及所有量化模式等均提供支持。在性能數據上,其矩陣乘算子效率可達 98%,Flash Attention 算子效率能達到 95%,這些數據遠超行業平均水平,彰顯出強大的運算實力。在講解 FP8 GEMM 算子效率時,吳慶形象地比喻道,Per-Tensor scale 如同整面墻刷一種顏色,操作過程簡單直接;而 Per-Block scale 則像給墻上的小方塊刷不同顏色,復雜度明顯更高。但摩爾線程通過深度的軟硬協同優化,成功使 Per-Block 與 Per-Tensor FP8 GEMM 計算效率差距控制在不到 2%,極大提升了復雜場景下的運算性能。?

接著,吳慶介紹了 MUTLASS,它作為高性能線性代數模板庫,已經在 Github 開源。MUTLASS 支持平湖架構所有特性,并且貼心地提供 Attention 最優化示例,這一舉措極大降低了用戶自定義算子的開發工作量,讓開發者能夠更便捷地進行相關開發工作。最后,吳慶透露,即將發布的 MUSA AI Tensor Engine 是面向大語言模型的開源推理算子庫,它提供友好的 Python API,未來還將支持豐富后端,能夠助力開發者快速搭建自定義推理引擎,為大語言模型領域的開發工作帶來更多便利與可能。?

三、高性能通信技術:避免通信搶占計算核心資源?

在大模型分布式訓練領域,通信問題一直是制約發展的主要瓶頸,猶如交通擁堵阻礙城市高效運轉。吳慶在演講中指出,摩爾線程在 MTT S5000 上支持 MTLINK 2.0,并創新性地配備 GPU 異步通信引擎,成功實現了通信技術與計算的高度并行,為解決這一瓶頸問題提供了有效方案。

圖:摩爾線程的異步通信引擎技術支持通過MTLink進行C2C數據通信

吳慶回顧道,早在之前,摩爾線程的技術團隊就敏銳洞察到通信與計算搶占 SM 計算單元這一行業痛點,經過深入研究與技術攻關,最終在 GPU 上成功增加了異步通信引擎。以 MTT S5000 服務器為例,每節點配備 8 張 GPU,通過 MTLINK 2.0 實現全互連,每張 GPU 與其他 7 張 GPU 直連。并且,每個 GPU 的異步通信引擎原生支持多種 reduce 操作和數據類型,還能借助 Zero Copy 技術避免本地 D2D 拷貝,直接進行跨卡通信,大大提升了通信效率。?

在通信性能方面,吳慶詳細列舉了相關數據。基于全互聯(FC8)拓撲的高效通信算法,在單機 8 卡 All Reduce 場景中,將延遲從 Ring 算法的 53us 大幅降至 7.8us,縮減近 1/7;帶寬方面,單機 8 卡 All Reduce 帶寬利用率接近 85%,跨節點通信中,All Reduce 帶寬達 194GB/s,RDMA 通信帶寬利用率更是高達 97%。不僅如此,異步通信引擎的通信優化將通信部分巧妙卸載到單獨引擎,不占用 MPC 計算資源,在無數據依賴時能夠實現完全 overlap。吳慶特別提到,結合 MT Transformer Engine,這一優化使 Llama 模型端到端計算通信性能提升約 10%,切實為大模型分布式訓練的高效運行提供了有力支撐。?

四、展望未來:首屆MUSA開發者大會即將啟幕

分享日最后,摩爾線程還宣布將于今年10月舉辦首屆MUSA開發者大會,進一步推動國產GPU生態建設。從芯片架構到集群系統,從技術突破到行業落地,摩爾線程正以“AI工廠”為藍圖,引領國產算力基礎設施邁向AGI時代的新高度。(完)

-

gpu

+關注

關注

28文章

5227瀏覽量

135799 -

MUSA

+關注

關注

0文章

6瀏覽量

2179 -

摩爾線程

+關注

關注

2文章

280瀏覽量

6553

發布評論請先 登錄

摩爾線程MTT S5000率先完成對GLM-5的適配

摩爾線程正式開源TileLang-MUSA項目

算力即國力!摩爾線程架構/芯片/超節點/萬卡集群四連發,助力打造AI國之重器

摩爾線程在MDC 2025重磅發布全棧創新成果

MDC 2025 摩爾線程首屆MUSA開發者大會成功舉辦,加速構建國產GPU生態

摩爾線程公布全功能GPU架構路線圖:以“花港”新架構與萬卡訓練集群,開啟自主算力新時代

國產GPU技術與生態雙重突破,摩爾線程舉辦首屆MUSA開發者大會

摩爾線程新一代GPU架構即將揭曉

摩爾線程發布Torch-MUSA v2.7.0版本

摩爾線程亮相GOTC 2025全球開源技術峰會

摩爾線程發布Torch-MUSA v2.1.1版本

摩爾線程副總裁王華:AI工廠全棧技術重構算力基建,開啟國產 GPU 黃金時代

摩爾線程亮相WAIC 2025:以“AI工廠”理念驅動算力進化,全棧AI應用賦能千行百業

摩爾線程發布Torch-MUSA v2.0.0版本 支持原生FP8和PyTorch 2.5.0

摩爾線程GPU成功適配Deepseek-V3-0324大模型

摩爾線程吳慶詳解 MUSA 軟件棧:以技術創新釋放 KUAE 集群潛能,引領 GPU 計算新高度

摩爾線程吳慶詳解 MUSA 軟件棧:以技術創新釋放 KUAE 集群潛能,引領 GPU 計算新高度

評論