來源:OpenVINO 中文社區

作者:

武卓英特爾 OpenVINO 布道師

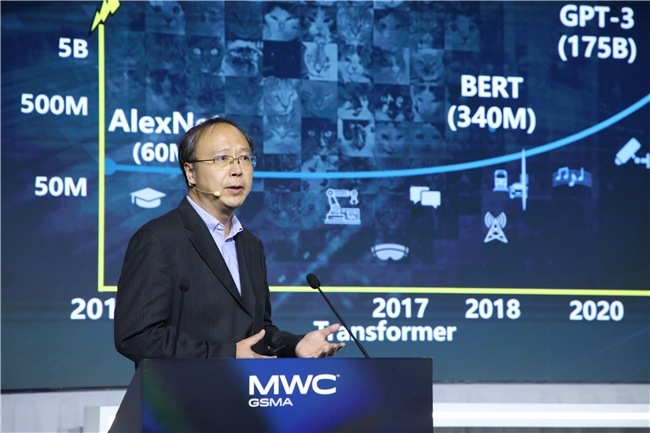

生成式AI(GenAI)在模型質量與應用范圍上持續爆發式增長,DeepSeek 等頂尖模型已引發行業熱議,這種勢頭預計將在 2025年延續。本次更新聚焦性能提升、更多生成式AI 模型的支持,并針對英特爾神經處理單元(NPU)推出關鍵優化。讓我們來一探究竟吧!

新增圖像生成場景與模型支持

OpenVINO 2025.0 版本正式支持FLUX.1 圖像生成模型(含Dev與Schnell變體),可在英特爾 CPU/GPU 上通過 GenAI 流水線運行。開發者現可通過 Optimum-Intel 導出 Flux 模型,并結合 Text2ImagePipeline 生成圖像。針對 Flux 模型對精度變化非常敏感的特點,我們進行了深度優化,確保圖像生成性能與準確度兼得。

LoRA適配器:模型定制利器

自前期版本起,OpenVINO 已支持基于 Safetensor 文件的LoRA 低秩適配技術,無需重新編譯即可動態切換 LoRA 適配器,從而快速方便的生成不同定制化風格的圖像。本次更新進一步擴展至 Flux 模型家族,開發者可直接從 Hugging Face Hub 下載適配器,通過 GenAI 的 Text2ImagePipeline 快速實現風格定制。

示例:

LoRA 增強的 FLUX.1-Dev 圖像生成效果

展示了 INT8 量化版 FLUX.1-dev 模型在應用 Yarn 風格 LoRA 前后的對比(提示詞:"albert einstein, yarn art style",初始種子=420,迭代次數=20):

新場景支持:Image2Image 與 Inpainting

新增Image2Image與Inpainting流水線(預覽版),解鎖更可控的創作方式:

Image2Image:以圖像+文本為輸入生成新圖像,提升結果可控性;

Inpainting:通過掩碼圖像替換輸入圖像的指定區域,支持局部內容再生。

兩種流水線均兼容 LoRA 適配器,滿足定制化需求。

文本生成場景優化

本次新版本在 LLMPipeline API 中引入了對提示詞查找解碼的預覽支持,這是對推測解碼的簡化,它在輸入提示詞本身中用直接查找機制取代了傳統的草稿模型。這有助于在具有高相似性的請求的情況下顯著減少生成延遲。例如,通過對一組文檔的問答可以觀察到性能優勢,因為答案將根據作為提示詞本身一部分的文檔來生成。

如我們的示例所示,只需對 LLMPipeline 中的代碼進行很小的修改,即可啟用此功能。總結來說,您需要將提示查找作為流水線中的一個參數啟用,并修改生成配置以添加兩個重要參數:在提示詞中查找多少 token 數以及匹配后取多少 token 數。

生成過程中的內存使用是運行應用的一個重要考慮因素,因為 LLM 權重非常占用內存。KV Cache 代表了額外的內存消耗,并且可能會增長得相當大。我們引入了 KV Cache 的壓縮作為一種減少內存消耗的技術,在這個版本中,我們默認在 CPU 上啟用它。為了確保壓縮的準確性,我們引入了非對稱 INT8 壓縮,被證明是總體來說最準確的壓縮方式。如果需要,INT4 壓縮也可作為進一步減少內存消耗的選項。在未來的版本中,我們計劃啟用更多的壓縮技術,請持續關注。

另外,我們一直在努力支持和驗證最新的模型,包括 Mistral-7B-Instruct-v0.2、Qwen2.5,當然我們也支持基于 LLama 和 Qwen 架構的 DeepSeek 蒸餾模型。您可以探索我們的新的使用 DeepSeek-R1 蒸餾模型進行 LLM 推理的 Notebook 代碼示例,并查看下面與英特爾 酷睿 Ultra 200V GPU 上的 DeepSeek-R1-Llama-8b 模型的對話:

https://github.com/openvinotoolkit/openvino_notebooks/tree/latest/notebooks/deepseek-r1

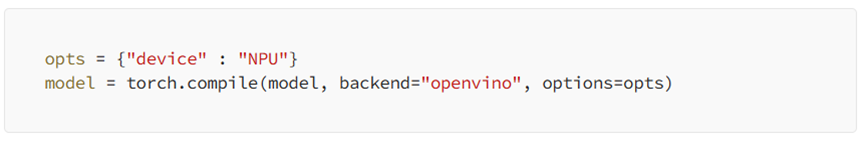

通過 torch.compile

支持英特爾 NPU

2025.0 版本首次實現 NPU 加速支持,開發者可通過 PyTorch 的 torch.compile 接口調用英特爾 NPU 算力。OpenVINO 作為 torch.compile 生態系統中的編譯器已經面世一段時間了。它已經在 CPU 和 GPU 上得到支持,并且在性能方面非常接近原生 OpenVINO 推理。在 2025.0 版本中,我們將推出對 Intel NPU 作為推理設備的預覽支持。這包括對 TorchVision、Timm 和 TorchBench 存儲庫中的300多個模型的支持。

啟用方式非常簡單,只需要增加如下兩行代碼:

結果因模型而異,因此建議您嘗試使用自己的模型以查看性能的提升情況。同時我們建議在英特爾 酷睿 Ultra Series 2 及更高版本的平臺上使用此功能。

總結

隨著我們迎來激動人心的新一年,生成式AI的潛力繼續重塑我們的創造、工作和創新方式。

借助 OpenVINO 2025.0,我們提供了更多的模型覆蓋、更快的推理性能和擴展的英特爾 NPU 支持。這只是一個開始——今年我們全年計劃發布更多版本,請繼續關注即將到來的更新!

-

英特爾

+關注

關注

61文章

10309瀏覽量

180742 -

gpu

+關注

關注

28文章

5222瀏覽量

135755 -

模型

+關注

關注

1文章

3773瀏覽量

52174 -

OpenVINO

+關注

關注

0文章

118瀏覽量

793

原文標題:開發者實戰|OpenVINO? 2025.0正式發布!DeepSeek支持、FLUX.1圖像生成、英特爾? NPU加速全面升級

文章出處:【微信號:英特爾物聯網,微信公眾號:英特爾物聯網】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

釋放極致游戲性能!英特爾酷睿Ultra 200S Plus發布

英特爾舉辦行業解決方案大會,共同打造機器人“芯”動脈

硬件與應用同頻共振,英特爾Day 0適配騰訊開源混元大模型

使用英特爾? NPU 插件C++運行應用程序時出現錯誤:“std::Runtime_error at memory location”怎么解決?

英特爾發布邊緣AI控制器與邊緣智算一體機,創造“AI新視界”

無法將Openvino? 2025.0與onnx運行時Openvino? 執行提供程序 1.16.2 結合使用,怎么處理?

為什么無法通過“pip install openvino-dev==2025.0.0”安裝 2025.0 OpenVINO??

英特爾銳炫Pro B系列,邊緣AI的“智能引擎”

直擊Computex 2025:英特爾重磅發布新一代GPU,圖形和AI性能躍升3.4倍

直擊Computex2025:英特爾重磅發布新一代GPU,圖形和AI性能躍升3.4倍

英特爾發布全新GPU,AI和工作站迎來新選擇

Intel OpenVINO? Day0 實現阿里通義 Qwen3 快速部署

英特爾OpenVINO 2025.1版本發布

英特爾宣布裁員20% 或2萬人失業

英特爾首秀上海車展:以“芯”賦能,攜手合作伙伴推動全車智能化

英特爾OpenVINO 2025.0正式發布

英特爾OpenVINO 2025.0正式發布

評論