近日,DeepSeek公司宣布推出一種全新的稀疏注意力機制——NSA(Native Sparse Attention)。據DeepSeek介紹,NSA旨在與現代硬件實現高度一致,并且具備本機可訓練的特性,專為超快速的長上下文訓練和推理而設計。

NSA通過針對現代硬件的優化設計,顯著加快了推理速度,并大幅度降低了預訓練成本,同時保持了卓越的性能表現。這一機制在確保效率的同時,并未犧牲模型的準確性或功能。

在廣泛的基準測試、涉及長上下文的任務以及基于指令的推理場景中,NSA的表現與采用完全注意力機制的模型相當,甚至在部分測試中展現出更優的性能。這一成果不僅驗證了NSA機制的有效性和實用性,也展示了DeepSeek在人工智能領域的深厚技術積累和創新能力。

DeepSeek推出的NSA機制,不僅為長上下文訓練和推理提供了全新的解決方案,也為人工智能領域的發展注入了新的活力。

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

人工智能

+關注

關注

1819文章

50206瀏覽量

266418 -

NSA

+關注

關注

4文章

109瀏覽量

19331 -

DeepSeek

+關注

關注

2文章

837瀏覽量

3352

發布評論請先 登錄

相關推薦

熱點推薦

NVIDIA推出BlueField-4 STX存儲架構

NVIDIA 今日宣布推出 NVIDIA BlueField-4? STX 模塊化參考架構,該架構可助力企業、云計算及 AI 服務商輕松部署加速存儲基礎設施,以滿足代理式 AI 所需的長上下文

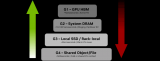

NVIDIA BlueField-4為推理上下文記憶存儲平臺提供強大支持

隨著代理式 AI 工作流將上下文窗口擴展到數百萬個 token,并將模型規模擴展到數百萬億個參數,AI 原生企業正面臨著越來越多的擴展挑戰。這些系統目前依賴于智能體長期記憶來存儲跨多輪、工具和會話持續保存的上下文,以便智能體能夠基于先前的

NVIDIA DGX SuperPOD為Rubin平臺橫向擴展提供藍圖

NVIDIA DGX Rubin 系統整合了 NVIDIA 在計算、網絡和軟件領域的最新突破,將推理 token 成本降至 NVIDIA Blackwell 平臺的十分之一,可加速從推理和訓練

奇異摩爾入選2025中國科創好公司半導體榜單

隨著國產大模型接連取得突破,AI產業的焦點正迅速轉移。就在本月,DeepSeek正式發布V3.2和其高算力版本Speciale,主力模型V3.2強化通用Agent與長上下文處理能力,而

大語言模型如何處理上下文窗口中的輸入

本博客介紹了五個基本概念,闡述了大語言模型如何處理上下文窗口中的輸入。通過明確的例子和實踐中獲得的見解,本文介紹了多個與上下文窗口有關的基本概念,如詞元化、序列長度和注意力等。

華為數據存儲與「DaoCloud 道客」發布AI推理加速聯合解決方案

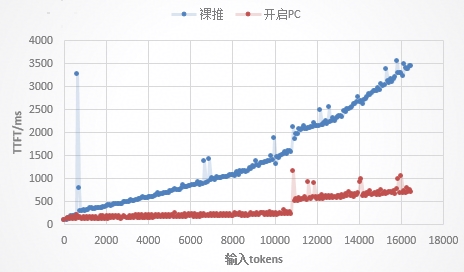

規模化發展的攔路虎。在有限算力下,長序列輸入導致首Token時延(TTFT)增加,甚至超長序列超出模型上下文窗口限制;隨著并發數增加,推理吞吐開始下降,任務頻繁卡頓;歷史對話和行業知識的重復調用造成算力浪費,加大推理成本。如何優

請問riscv中斷還需要軟件保存上下文和恢復嗎?

以下是我拷貝的文檔里的說明,這個中斷處理還需要軟件來寫上下文保存和恢復,在使用ARM核的單片機都不需要考慮這些的,使用過的小伙伴能解答嗎?

3.8. 進出中斷的上下文保存和恢復

RISC-V架構

發表于 10-20 09:56

英特爾Gaudi 2E AI加速器為DeepSeek-V3.1提供加速支持

英特爾? Gaudi 2EAI加速器現已為DeepSeek-V3.1提供深度優化支持。憑借出色的性能和成本效益,英特爾Gaudi 2E以更低的投入、更高的效率,實現從模型訓練的深度突破到推理

今日看點丨華為發布AI推理創新技術UCM;比亞迪汽車出口暴增130%

緩存加速算法工具,分級管理推理過程中產生的KV Cache記憶數據,可擴大推理上下文窗口,實現高吞吐、低時延的推理體驗,降低每Token推理

發表于 08-13 09:45

?5655次閱讀

【「DeepSeek 核心技術揭秘」閱讀體驗】--全書概覽

講解Deepseek的使用方法

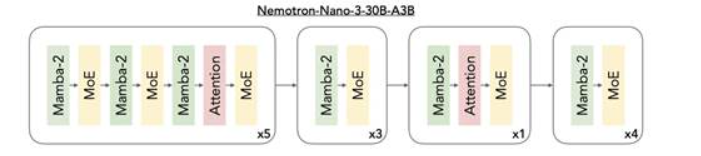

第三章 深入剖析Deepseek-V3的模型架構、訓練框架、推理階段優化、后訓練優化等關鍵技術

第四章關于

發表于 07-21 00:04

【「DeepSeek 核心技術揭秘」閱讀體驗】書籍介紹+第一章讀后心得

)機制和多 token 預測的詳細解讀,幫助讀者全面了解 DeepSeek-V3 在技術上的先進性和創新性。同時,對訓練框架的并行策略、FP8 混合精度訓練及

發表于 07-17 11:59

信而泰×DeepSeek:AI推理引擎驅動網絡智能診斷邁向 “自愈”時代

模態的技術特性,DeepSeek正加速推動AI在金融、政務、科研及網絡智能化等關鍵領域的深度應用。 信而泰:AI推理引擎賦能網絡智能診斷新范式信而泰深度整合DeepSeek-R1大模型

發表于 07-16 15:29

鴻蒙NEXT-API19獲取上下文,在class中和ability中獲取上下文,API遷移示例-解決無法在EntryAbility中無法使用最新版

摘要:隨著鴻蒙系統API升級至16版本(modelVersion5.1.1),多項API已廢棄。獲取上下文需使用UIContext,具體方法包括:在組件中使用getUIContext(),在類中使

【書籍評測活動NO.62】一本書讀懂 DeepSeek 全家桶核心技術:DeepSeek 核心技術揭秘

(MLA)機制和多 token 預測的詳細解讀,幫助讀者全面了解 DeepSeek-V3 在技術上的先進性和創新性。同時,對訓練框架的并行策略、FP8 混合精度訓練及

發表于 06-09 14:38

DeepSeek推出NSA機制,加速長上下文訓練與推理

DeepSeek推出NSA機制,加速長上下文訓練與推理

評論