在當今快速發展的人工智能世界中,推理模型處于創新的前沿。該領域已經出現了兩種領先的模型:OpenAI的o3-mini和DeepSeek R1。雖然兩者都是為了回答復雜的問題、解決編碼問題和處理科學任務而設計的,但它們在設計、性能、成本和方法上都有所不同。

本文用簡單而專業的語言解釋了這些差異,檢查每個模型的架構、性能基準、定價和用例,以幫助讀者決定哪一個最適合您的需求。

OpenAI o3-mini概述

OpenAI的o3 - mini于2025年初推出,作為該公司不斷努力提供高效、準確推理模型的一部分。它可以通過ChatGPT界面提供給免費用戶(有使用限制)和高級用戶(Plus,Team和Pro)。它的主要目的是處理需要邏輯推理、編碼和快速準確地解決STEM問題的任務。

o3 - mini的主要功能

高級推理:o3 - mini被設計成一步一步地“思考”,使其能夠在給出答案之前將復雜的問題分解成更小的部分。

快速響應時間:基準測試表明,o3 - mini可以在幾秒鐘內解決編碼和數學問題等任務。

密集變壓器架構:每個輸入token都由完整的模型參數集處理,確保性能一致。

在編碼和STEM中的使用:它已被證明在生成代碼、解決邏輯謎題和處理科學相關查詢方面特別有效。

集成在ChatGPT:該模型支持ChatGPT API和web界面的高級功能。

o3 - mini的定價

根據最近的比較,o3 - mini的費用約為:

每百萬輸入token 1.10美元

每百萬輸出token 4.40美元

這種定價在每個token的基礎上高于一些競爭對手,但其速度和準確性通常證明其成本是合理的。

DeepSeek R1概述

發布及目的

DeepSeek R1于2025年1月發布,因其能夠以極低的成本完成高級推理任務而成為頭條新聞。它是開源的,意味著開發人員可以訪問和修改其代碼以滿足他們的需要。

DeepSeek R1的主要特性

開源性質:任何人都可以下載和集成DeepSeek R1。它的透明度是吸引許多開發商的主要因素。

成本效益:R1的設計非常高效。它使用更少的資源(得益于混合專家設計),并且具有更低的運營成本。

可見的思維鏈:與o3 - mini不同,DeepSeek R1經常詳細展示其推理過程,一些用戶認為這有助于理解模型如何得出答案。

混合專家體系結構:每個token只激活參數子集(“專家”)。這使得模型在處理大規模任務時更有效。

關注效率:它的設計有助于保持較低的訓練和推理成本,使其對主要關注預算的應用程序具有吸引力。

DeepSeek R1的定價

與o3-mini相比,DeepSeek R1的每token成本更低:

大約為每百萬輸入token 0.14美元(緩存命中),緩存未命中則略高。

每百萬輸出token約2.19美元。

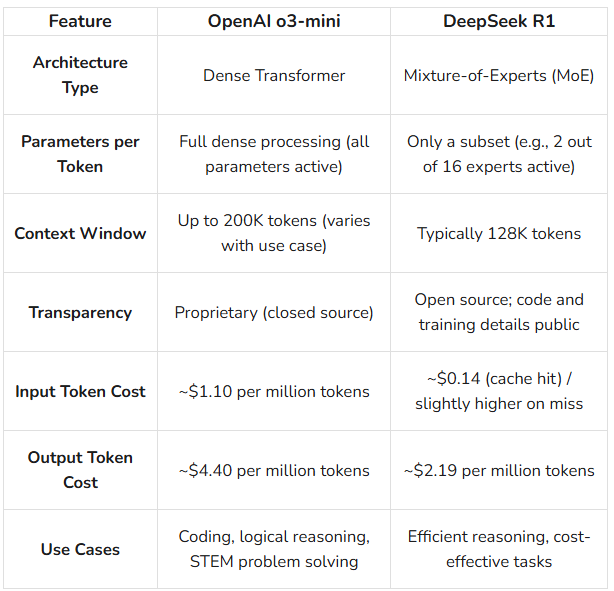

技術架構比較

人工智能模型的體系結構對其性能、成本和效率有很大影響。下表比較了OpenAI的o3 - mini和DeepSeek R1的主要架構特征。

架構和價格比較

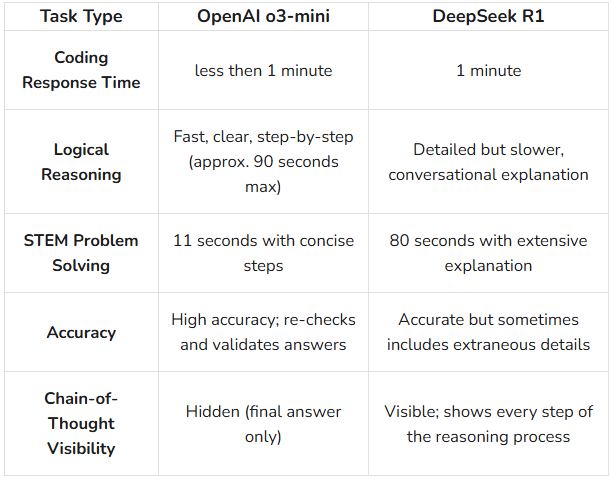

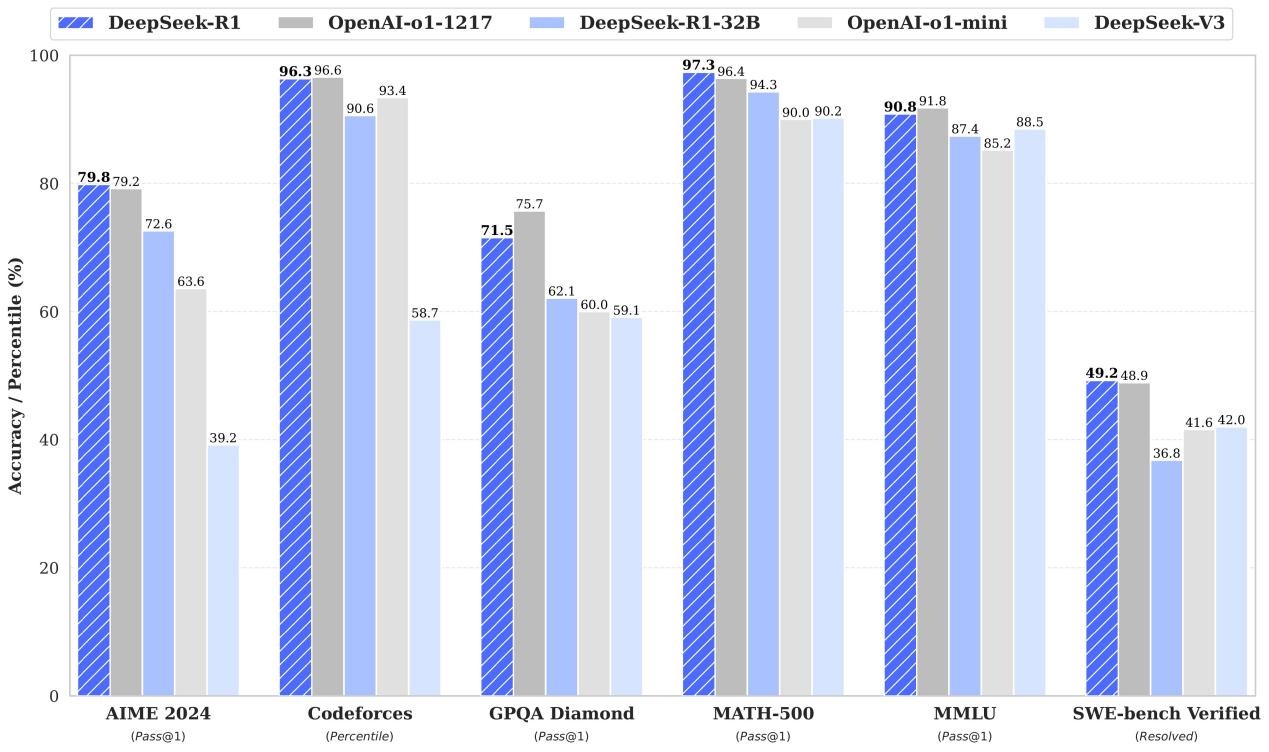

真實世界的性能基準

這兩種模型都經過了各種任務的測試,包括編碼、邏輯推理和STEM問題解決。這里我們總結了一些關鍵的性能指標。

編碼任務

在本節中,我們給AI模塊和兩者分配了一個編碼任務,并嘗試獲得輸出。在這個比較中,我們將注意到結果生成的時間,代碼的準確性。

OpenAI o3 -mini:

快速生成代碼(例如,一個JavaScript動畫任務在27秒內完成)。

生成具有準確響應的清晰、結構良好的代碼。

DeepSeek R1:

生成代碼需要更長的時間(對于相同的任務大約需要1分45秒)。

雖然代碼得到了很好的解釋,但響應有時可能包含額外的細節或合并未請求的元素。

邏輯推理

OpenAI o3 -mini:

提供逐步推理并驗證其推論。

答題質量高,解釋清晰簡潔。

DeepSeek R1:

提供一個可見的思路鏈,詳細和對話。

雖然準確,但它的解釋可能更長、更慢。

解決STEM問題

OpenAI o3 -mini:

在短短11秒內解決STEM問題(如RLC電路計算)。

顯示清晰、結構良好的計算和必要時的舍入。

DeepSeek R1:

類似的STEM任務可能需要80秒。

提供詳細的解釋,但以速度為代價。

實時性能比較摘要

思維鏈是如何工作的?

思維鏈提示允許模型將復雜的問題分解成更小的步驟。在o3 -mini high下,這意味著當給定一個復雜的問題時,模型在給出最終答案之前會顯示其內部推理步驟(盡管這些步驟對最終用戶是隱藏的)。這有助于為復雜查詢獲得更準確和詳細的響應。

用例和應用程序

這兩種模型都適用于各種任務。下面是它們的一些常見用例:

OpenAI o3-mini的用例

編碼及軟件開發:

快速生成語法正確的代碼。

集成到ide和編程助手中。

STEM問題解決:

解決數學問題和物理計算

為科學問題提供一步一步的解釋。

邏輯推理任務:

用清晰、簡潔的步驟分解謎題和邏輯問題。

企業應用程序:

為大型組織自動化數據提取和分析。

安全掃描:

檢測代碼中的漏洞并提出修復建議。

DeepSeek R1的用例

開源項目:

對于喜歡可以定制的開源解決方案的開發人員來說是理想的選擇。

詳細推理可見性:

透明的“思維鏈”對于調試或教育目的很重要的應用程序。

敏感的環境:

在降低token成本至關重要并且可以接受輕微延遲的場景中使用。

大規模數據處理:

適合需要處理大量查詢而不需要高每個請求成本的項目。

研究與實驗:

對于需要定制模型的學術設置或實驗項目來說,這是一個很好的選擇。

限制與挑戰

雖然這兩種模式在許多領域都很出色,但它們都有自己的局限性。

OpenAI o3-mini的局限性

每個token的成本更高:

雖然速度很快,但o3 - mini每個token的成本更高,這對于非常大容量的應用程序來說可能會增加成本。

專有的架構:

由于是閉源的,它為想要修改或微調模型的開發人員提供了較少的靈活性。

資源密集型:

密集的變壓器設計意味著每個token使用更多的計算資源。

DeepSeek R1的局限性

較慢的響應時間:

在許多基準測試中,DeepSeek R1需要更長的時間來生成答案,這對于實時應用程序來說可能是一個缺點。

可見的思維鏈:

雖然透明度可能是一個好處,但冗長的可見推理過程可能會降低整體性能。

開源的權衡:

開源并不總是保證健壯性;第三方修改可能導致性能不一致。

過度細節的可能性:

詳細的解釋雖然有用,但有時會包含最終答案不需要的無關信息。

結論

在這個正面比較中,我們看到OpenAI的o3 - mini和DeepSeek R1都有獨特的優勢。OpenAI的o3 - mini快速、準確、更安全,非常適合時間和可靠性至關重要的任務。DeepSeek R1提供了一種具有成本效益、透明的替代方案,吸引了開源愛好者和預算限制最為重要的項目。選擇正確的模型在很大程度上取決于應用程序的具體需求。如果您需要對編碼、邏輯推理或STEM問題做出快速、高質量的響應,并且可以在每個token上多投入一點,那么o3 - mini無疑是最佳選擇。

o3 - mini和DeepSeek R1在架構上的主要區別是什么?

OpenAI的o3 - mini使用密集的轉換器模型,用全套參數處理每個token。相比之下,DeepSeek R1使用混合專家方法,每個token僅激活參數子集。這使得o3 - mini更加一致和快速,而R1更具成本效益。

哪個模型在編碼和STEM問題解決方面更快?

基準測試表明,o3 - mini始終提供更快的響應。例如,在編碼任務中,o3 - mini可以在27秒內生成代碼,而DeepSeek R1需要1分45秒;在STEM任務中,o3 - mini的響應速度可以達到11秒,而DeepSeek R1需要80秒。

兩種模型之間的token成本比較如何?

OpenAI o3.0 - mini的成本約為每百萬輸入token 1.10美元,每百萬輸出token 4.40美元。另一方面,DeepSeek R1每百萬輸入token的成本約為0.14美元(如果使用緩存命中),每百萬個輸出token的成本約為2.19美元,這使得R1在每個token的基礎上更便宜。

DeepSeek R1是開源的嗎?

是的,DeepSeek R1是一個開源模型,這意味著開發人員可以查看和修改其源代碼。

原文鏈接:

https://www.geeksforgeeks.org/openai-o3-mini-vs-deepseek-r1/

-

AI

+關注

關注

91文章

39755瀏覽量

301364 -

OpenAI

+關注

關注

9文章

1245瀏覽量

10060 -

DeepSeek

+關注

關注

2文章

835瀏覽量

3257

原文標題:外媒:OpenAI-o3-mini vs DeepSeek R1高級AI推理的完整比較

文章出處:【微信號:SSDFans,微信公眾號:SSDFans】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

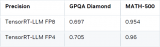

DeepSeek R1 MTP在TensorRT-LLM中的實現與優化

如何在NVIDIA Blackwell GPU上優化DeepSeek R1吞吐量

【「DeepSeek 核心技術揭秘」閱讀體驗】書籍介紹+第一章讀后心得

信而泰×DeepSeek:AI推理引擎驅動網絡智能診斷邁向 “自愈”時代

【書籍評測活動NO.62】一本書讀懂 DeepSeek 全家桶核心技術:DeepSeek 核心技術揭秘

DeepSeek開源新版R1 媲美OpenAI o3

上新:小米首個推理大模型開源 馬斯克:下周推出Grok 3.5

科大訊飛深度解析DeepSeek-V3/R1推理系統成本

顯存也能疊疊樂,雙 Intel Arc A770 顯卡低成本部署 DeepSeek R1 32B 蒸餾模型體驗

如何使用OpenVINO運行DeepSeek-R1蒸餾模型

在 MAC mini4 上使用 VSCode 和 Cline 插件對接 Deepseek-R1:32b 的完整指南

OpenAI的o3-mini和DeepSeek R1高級AI推理的完整比較

OpenAI的o3-mini和DeepSeek R1高級AI推理的完整比較

評論