2 月 6 日消息,字節跳動近日發布了一項重大成果 ——OmniHuman 多模態框架,其優勢在于其強大的視頻生成能力。用戶只需提供一張任意尺寸和人物占比的單張圖片,再結合一段輸入音頻,就能生成栩栩如生的人物視頻。

與傳統 AI 模型不同,OmniHuman-1 能夠生成逼真的全身動畫,并且可以精準地將手勢和面部表情與語音或音樂同步,打破了以往只能生成面部或上半身動畫的局限。

基于約 19000 小時的人類運動數據訓練,OmniHuman-1 模型支持不同的體型和畫面比例,能在內存限制內生成任意長度的視頻,并適應不同輸入信號,在真實性和準確性方面超越其他同類動畫工具。值得一提的是,它還支持卡通角色、人工物體、動物以及復雜姿勢的輸入,確保生成的動作特征與每種風格的獨特特點相匹配。

在實際應用場景中,OmniHuman 潛力巨大。在影視制作領域,創作者能輕松為虛擬角色打造全身動作戲份;虛擬直播里,主播動作更加自然,可增強直播的趣味性與吸引力;游戲世界中,數字人 NPC 的動作和表情更豐富,能提升玩家的沉浸感。

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

AI

+關注

關注

91文章

39755瀏覽量

301355 -

人工智能

+關注

關注

1817文章

50094瀏覽量

265273 -

字節跳動

+關注

關注

0文章

352瀏覽量

10075

發布評論請先 登錄

相關推薦

熱點推薦

全球首個最大規模跨本體視觸覺多模態數據集白虎-VTouch發布

全球首個最大規模跨本體視觸覺多模態數據集——白虎-VTouch(Vision-Based Tactile Sensor),總規模超過60,000分鐘。

格靈深瞳多模態大模型榮登InfoQ 2025中國技術力量年度榜單

靈感實驗室聯合LLaVA社區發布的多模態大模型LLaVA-OneVision-1.5,實現了訓練數據、代碼和模型權重的全鏈路開源,在多項公開多模態

涂鴉Omni AI Foundation V2.6發布:低代碼+多模態,重塑AI硬件創新體驗

硬件產品的落地。今天,我們非常高興地宣布:面向多模態AI硬件的基座平臺OmniAIFoundation正式發布V2.6版本。本次升級不僅顯著提升了端到端多

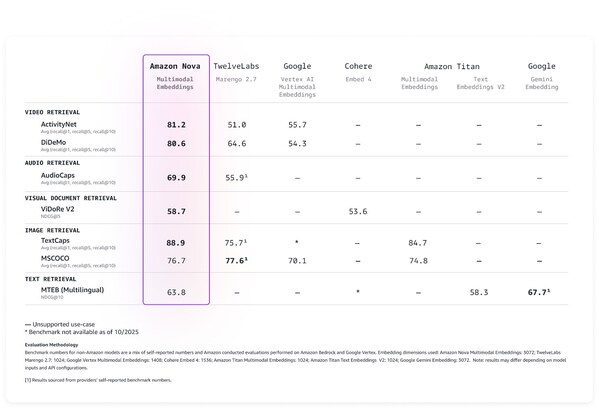

亞馬遜云科技上線Amazon Nova多模態嵌入模型

Embeddings多模態嵌入模型現已在Amazon Bedrock上線,這是一款專為Agentic RAG與語義搜索應用打造的頂尖多模態嵌入模型。該模型是首個通過單一模型支持文本、

淺析多模態標注對大模型應用落地的重要性與標注實例

?在人工智能邁向AGI通用智能的關鍵道路上,大模型正從單一的文本理解者,演進為能同時看、聽、讀、想的“多面手”。驅動這一進化的核心燃料,正是高質量的多模態數據,而將原始數據轉化為“機器可讀教材

商湯科技多模態通用智能戰略思考

時間是最好的試金石,AI領域尤其如此。當行業熱議大模型走向時,商湯早已錨定“多模態通用智能”——這是我們以深厚研究積累和實踐反復驗證的可行路徑。

“端云+多模態”新范式:《移遠通信AI大模型技術方案白皮書》正式發布

7月28日,移遠通信聯合智次方研究院正式發布《AI大模型技術方案白皮書》(以下簡稱“白皮書”)。這份白皮書系統梳理了AI大模型的技術特點、產業發展態勢與多元應用場景,以及移遠通信“端云+多模態”AI

潤和軟件發布StackRUNS異構分布式推理框架

當下,AI模型規模持續膨脹、多模態應用場景日益復雜,企業正面臨異構算力資源碎片化帶來的嚴峻挑戰。為應對行業痛點,江蘇潤和軟件股份有限公司(以下簡稱“潤和軟件”)正式發布自主研發的StackRUNS異構分布式推理

愛芯通元NPU適配Qwen2.5-VL-3B視覺多模態大模型

熟悉愛芯通元NPU的網友很清楚,從去年開始我們在端側多模態大模型適配上一直處于主動緊跟的節奏。先后適配了國內最早開源的多模態大模MiniCPM V 2.0,上海人工智能實驗室的書生

海康威視發布多模態大模型AI融合巡檢超腦

基于海康觀瀾大模型技術體系,海康威視推出新一代多模態大模型AI融合巡檢超腦,全面升級人、車、行為、事件等算法,為行業帶來全新的多模態大模型巡檢體驗,以更準確、更高效的智慧巡檢,為各行各

賽思×字節跳動 高精度同步時鐘助力火山引擎打造“云上新宇宙”

摘要: 賽思同步時鐘將對火山引擎長三角算力中心進行從基礎設施到業務引擎的全方位賦能,助力字節跳動旗下火山引擎打造“云上新宇宙”。 火山引擎長三角算力中心 — 蕪湖“東數西算”數據集群重點項目 火山云

?多模態交互技術解析

多模態交互 多模態交互( Multimodal Interaction )是指通過多種感官通道(如視覺、聽覺、觸覺等)或多種交互方式(如語音、手勢、觸控、眼動等)與計算機系統進行自然、

字節跳動發布OmniHuman 多模態框架

字節跳動發布OmniHuman 多模態框架

評論