涂鴉智能AI開發(fā)者平臺(tái)始終致力于打造行業(yè)內(nèi)最具競(jìng)爭(zhēng)力的AI硬件創(chuàng)新中間件平臺(tái)。我們不斷強(qiáng)化平臺(tái)能力、提升開放水平,通過更安全、更可靠、更可規(guī)模化的技術(shù)體系,持續(xù)助力客戶實(shí)現(xiàn)自主創(chuàng)新,加速下一代AI硬件產(chǎn)品的落地。

今天,我們非常高興地宣布:面向多模態(tài)AI硬件的基座平臺(tái)Omni AI Foundation正式發(fā)布V2.6版本。本次升級(jí)不僅顯著提升了端到端多模態(tài)交互體驗(yàn),還全面開放了基于自研架構(gòu)Dynamic Orchestration Agent System(DOS)的工作流編排引擎,為全球開發(fā)者提供更強(qiáng)大、更靈活、更高效的AI硬件構(gòu)建能力。

核心亮點(diǎn)一睹為快:

端到端交互平均時(shí)延1.3秒,全球網(wǎng)絡(luò)和實(shí)時(shí)算力穩(wěn)定性雙重加碼;

開放編排引擎,賦能開發(fā)者低代碼構(gòu)建復(fù)雜AI應(yīng)用,有效降低開發(fā)成本;

自然語音與意圖分類等核心算法升級(jí),靈活適配不同場(chǎng)景的多模態(tài)交互需求;

正式上線OmniMem個(gè)體記憶系統(tǒng),提升AI設(shè)備交互一致性與情感體驗(yàn)。

關(guān)于Omni AI Foundation:

Omni AI Foundation是涂鴉智能傾力打造的多模態(tài)AI與實(shí)時(shí)音視頻基座平臺(tái)。它整合了涂鴉在實(shí)時(shí)音視頻(RTC)、AI Agent運(yùn)行環(huán)境、多Agent編排架構(gòu)及全球部署方面的核心能力,為企業(yè)和開發(fā)者提供從設(shè)備接入、多模態(tài)交互到業(yè)務(wù)流程編排的全生命周期AI解決方案。

01

端到端時(shí)延與全球穩(wěn)定性再上新臺(tái)階

我們持續(xù)加強(qiáng)全球化基礎(chǔ)設(shè)施投入和技術(shù)布局,截至當(dāng)前已在全球部署7個(gè)數(shù)據(jù)中心、數(shù)10個(gè)主流國家實(shí)時(shí)媒體加速網(wǎng)絡(luò)、數(shù)千個(gè)主流城市邊緣加速節(jié)點(diǎn)。基于Tuya Real-Time Communication(T-RTC)加速網(wǎng)絡(luò),為全球開發(fā)者提供全球一致的端到端實(shí)時(shí)交互體驗(yàn)。

● 全球領(lǐng)先的響應(yīng)速度:在全球范圍內(nèi),包含記憶、知識(shí)庫以及工具調(diào)用的復(fù)雜場(chǎng)景下,端到端交互平均時(shí)延已穩(wěn)定在1.3秒以內(nèi),顯著優(yōu)于行業(yè)平均水平。

(注:以上數(shù)據(jù)基于800ms VAD時(shí)延測(cè)得,整體體驗(yàn)優(yōu)于行業(yè)300-500ms VAD時(shí)間。)

●金融級(jí)服務(wù)可靠性:通過動(dòng)態(tài)負(fù)載均衡技術(shù),支持全球主流大模型就近加速接入和實(shí)時(shí)(公共/專享)算力調(diào)度,毫秒級(jí)容災(zāi)降級(jí)切換,服務(wù)穩(wěn)定性高達(dá)99.95%。

●全球網(wǎng)絡(luò)優(yōu)化:Omni AI Foundation協(xié)議全面支持TCP、UDP及WebSocket協(xié)議,并針對(duì)不同業(yè)務(wù)場(chǎng)景實(shí)現(xiàn)了擁塞控制算法的自適應(yīng)匹配,確保了在全球任何角落都能獲得穩(wěn)定、低延遲的連接體驗(yàn)。

(注:WebSocket面向?yàn)g覽器側(cè)開放、UDP已釋放APP SDK集成,嵌入式SDK后續(xù)釋放。)

02

更開放、更靈活,賦能開發(fā)者低代碼構(gòu)建復(fù)雜AI應(yīng)用

本次升級(jí)的核心亮點(diǎn)在于聚焦技術(shù)架構(gòu)的全面升級(jí),著力解決開發(fā)者在AI硬件創(chuàng)新中普遍面臨的多模態(tài)能力集成復(fù)雜、自主創(chuàng)新受限、開發(fā)效率不足等痛點(diǎn)。主要升級(jí)包括:

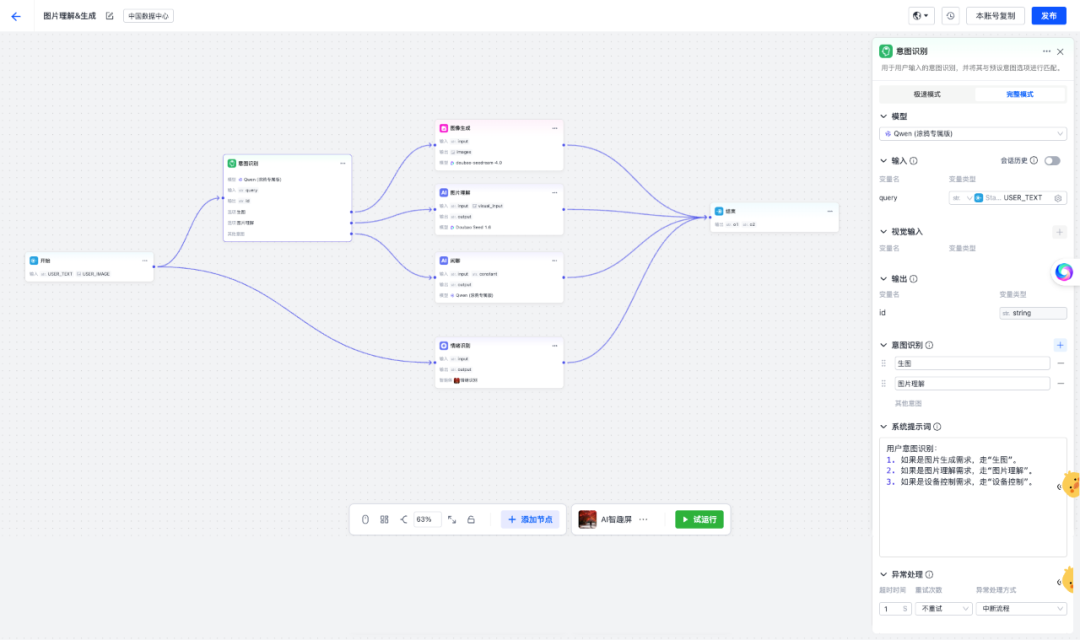

▍多Agent編排引擎:可視化協(xié)同、最短路徑、多路并行

Omni AI Foundation現(xiàn)已全面支持可視化的多Agent協(xié)同流程。開發(fā)者可通過拖拽式操作,快速搭建「統(tǒng)一輸入→意圖理解與分類→多Agent并行處理→統(tǒng)一輸出」的復(fù)雜業(yè)務(wù)鏈路。新架構(gòu)具備最短路徑?jīng)Q策與并行處理能力,以平衡開發(fā)者既要實(shí)現(xiàn)更復(fù)雜的差異能力又要保持實(shí)時(shí)端到端響應(yīng)交互。同時(shí)在能力擴(kuò)展上允許開發(fā)者在不同Agent中靈活啟用或關(guān)閉MCP工具,以更簡(jiǎn)化的提示詞來降低模型幻覺,提升響應(yīng)時(shí)間。

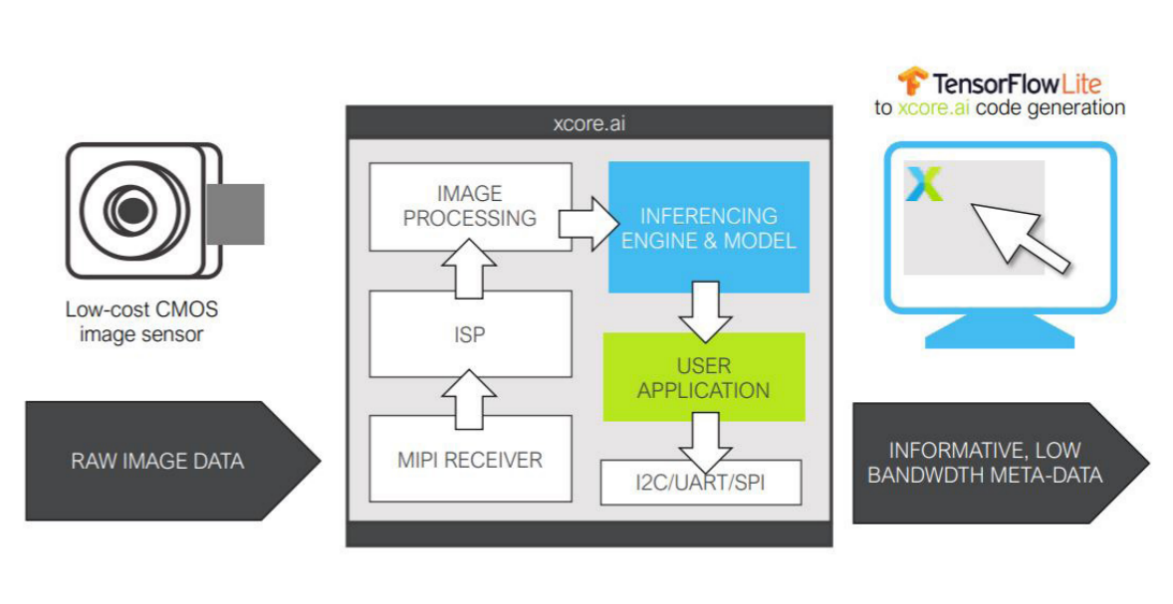

▍更簡(jiǎn)化的MCP集成:端云能力統(tǒng)一、視覺端到端快50%

平臺(tái)全面重構(gòu)了設(shè)備側(cè)MCP集成方案。在支持標(biāo)準(zhǔn)MCP協(xié)議的基礎(chǔ)上,將AI硬件常用能力(如實(shí)時(shí)圖像抓取、圖像識(shí)別、傳感器數(shù)據(jù)采集、設(shè)備控制等),統(tǒng)一抽象為標(biāo)準(zhǔn)化云端服務(wù),使AI Agent可以在統(tǒng)一、安全、可控的方式下調(diào)用端側(cè)能力,顯著降低了端側(cè)開發(fā)成本,同時(shí)實(shí)現(xiàn)了更快的端到端多模態(tài)響應(yīng),視覺理解鏈路整體性能提升約50%。

(注:端側(cè)MCP集成需基于wukongV3.13.0以上版本使用。)

▍更加豐富的平臺(tái)協(xié)議開放,支持拓展更多應(yīng)用場(chǎng)景

為滿足開發(fā)者更為豐富的應(yīng)用場(chǎng)景,除支持Tuya Wukong AI、TuyaOpen、Tuya APP SDK外,新增開放WebSocket以支持PC/瀏覽器等終端接入,后續(xù)將開放更原子的Foundation SDK,以支持客戶在更多開放系統(tǒng)中使用。

03

核心算法模型持續(xù)升級(jí),全面釋放多模態(tài)交互潛能

為更好適配不同芯片平臺(tái)、硬件形態(tài)及應(yīng)用場(chǎng)景中的自然語音與多模態(tài)交互需求,我們持續(xù)迭代核心算法模型,在確保算法可靠性與一致性的前提下,為開發(fā)者提供更加靈活、開放且可自主選擇的模型能力組合。

▍高精度VAD模型:在“流暢響應(yīng)”與“誤判控制”之間取得最佳平衡

在語音活動(dòng)檢測(cè)(VAD)落地中,開發(fā)者往往面臨兩難:一方面,追求毫秒級(jí)響應(yīng)速度,極易將環(huán)境噪聲誤判為有效語音,導(dǎo)致頻繁中斷;另一方面,過度強(qiáng)調(diào)準(zhǔn)確率又會(huì)犧牲交互即時(shí)性,造成延遲和不自然體驗(yàn)。涂鴉自研的高精度VAD模型基于海量真實(shí)場(chǎng)景數(shù)據(jù)進(jìn)行深度優(yōu)化,實(shí)現(xiàn)了低至500ms靜音檢測(cè)和300ms的極速打斷能力,為用戶帶來更自然流暢的對(duì)話體驗(yàn)。

“建議開發(fā)者在涂鴉AI開發(fā)者平臺(tái)將打斷檢測(cè)設(shè)為極速300ms,VAD檢測(cè)設(shè)為優(yōu)雅800ms——即便VAD為800ms,全球端到端平均時(shí)延仍可控制在1.3s,有效保證用戶體驗(yàn)。”

▍領(lǐng)域意圖分類模型:降低意圖幻覺,加速?zèng)Q策響應(yīng)

當(dāng)開發(fā)者為AI產(chǎn)品拓展能力時(shí),大模型常常會(huì)出現(xiàn)意圖幻覺增多、響應(yīng)鏈路變長等問題。針對(duì)這一痛點(diǎn),涂鴉基于多年在AI硬件領(lǐng)域的場(chǎng)景經(jīng)驗(yàn)與生態(tài)數(shù)據(jù),推出自訓(xùn)練的領(lǐng)域意圖分類模型。該模型基于涂鴉對(duì)AI硬件的數(shù)據(jù)積累和市場(chǎng)洞察持續(xù)迭代,開發(fā)者只需在工作流中選擇,即可為AI產(chǎn)品實(shí)時(shí)添加能力擴(kuò)展。

目前,涂鴉意圖分類模型已全面覆蓋涂鴉官方技能,后續(xù)將逐步開放對(duì)第三方MCP工具與客戶自定義技能的分類與召回支持,為開發(fā)者提供更高魯棒性的技能拓展。

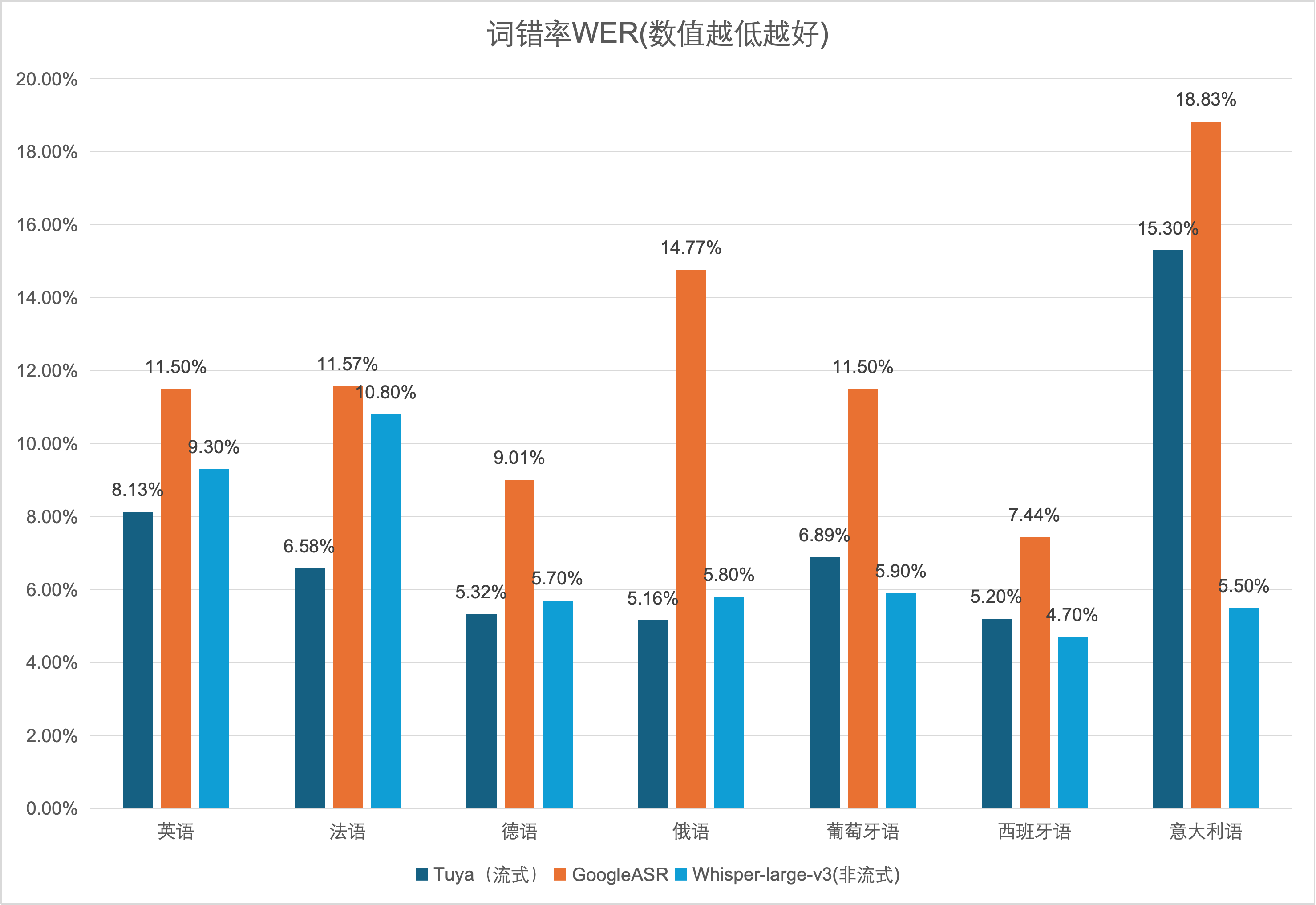

▍突破全球多語言技術(shù)壁壘,支撐客戶業(yè)務(wù)出海

在全球市場(chǎng)部署AI應(yīng)用,多語言支持是一大核心技術(shù)壁壘。不同語言的語法結(jié)構(gòu)、語調(diào)、口音差異巨大,訓(xùn)練一個(gè)在所有語言上都表現(xiàn)優(yōu)異的統(tǒng)一模型極具挑戰(zhàn)。

涂鴉的意圖分類與語音識(shí)別(ASR)模型,已針對(duì)全球主要市場(chǎng)(如英語、西班牙語、日語及東南亞多語種)進(jìn)行專項(xiàng)優(yōu)化和數(shù)據(jù)增強(qiáng),確保不同語言環(huán)境下的高識(shí)別率和意圖理解準(zhǔn)確性。同時(shí),我們也為開發(fā)者在不同地區(qū)挑選最為優(yōu)秀的合作伙伴,以保障開發(fā)者AI產(chǎn)品在當(dāng)?shù)乜色@得行業(yè)最佳的準(zhǔn)確率和響應(yīng)時(shí)間,為客戶的全球化業(yè)務(wù)提供堅(jiān)實(shí)可靠的技術(shù)支撐。

(注:以下測(cè)試均基于開源音頻測(cè)試集(CommonVoice)測(cè)得。)

(注:Whisper-large-v3為離線模型無法在對(duì)話式語音交互場(chǎng)景使用,但離線模型相比流式模型擁有更低的WER,借助Whisper-large-v3的參考數(shù)據(jù)將更好幫助我們驗(yàn)證本地區(qū)ASR準(zhǔn)確率。)

04

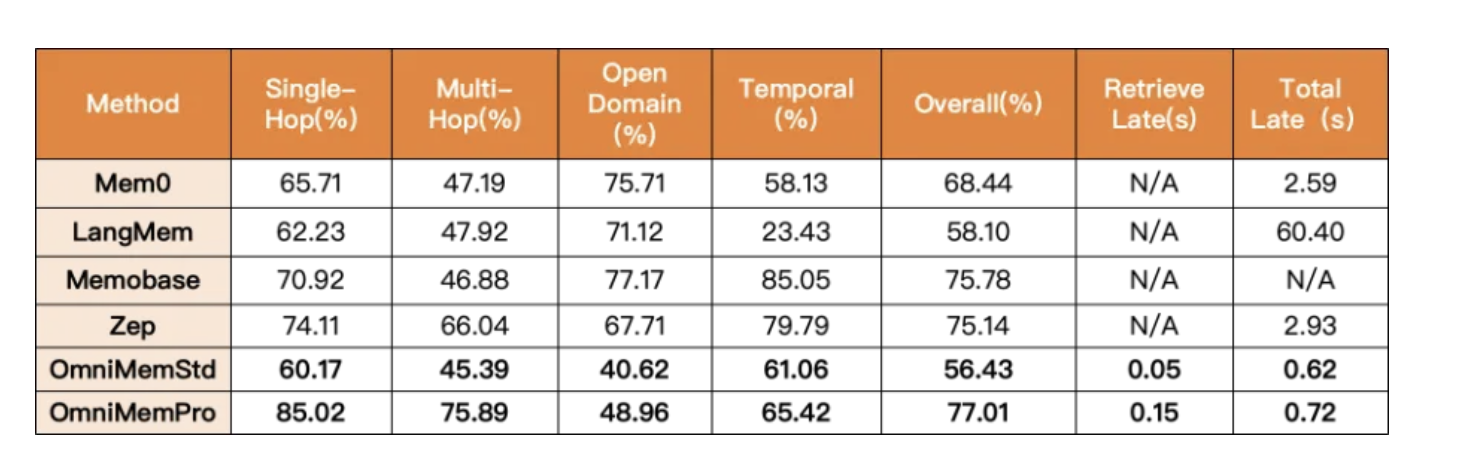

OmniMem個(gè)體記憶正式商用,重構(gòu)AI記憶體驗(yàn)

OmniMem通過針對(duì)AI記憶領(lǐng)域的時(shí)間處理、信息干擾、記憶割裂和動(dòng)態(tài)更新等多個(gè)技術(shù)痛點(diǎn)進(jìn)行攻堅(jiān),憑借底層架構(gòu)優(yōu)化與算法創(chuàng)新,實(shí)現(xiàn)了低延遲+高精度的有效平衡。平臺(tái)只需一步配置,即可快速解鎖AI記憶的核心能力。

OmniMem以開源測(cè)試集的領(lǐng)先得分、低延遲表現(xiàn)、多維度痛點(diǎn)解決方案與低門檻落地體驗(yàn),成為“更懂用戶、更穩(wěn)性能、更具價(jià)值”的AI記憶選擇。后續(xù),我們將帶來多模態(tài)記憶融合、跨設(shè)備遷移能力優(yōu)化、記憶擬人化體驗(yàn)升級(jí)等新能力,持續(xù)完善能力邊界,讓智能記憶的價(jià)值持續(xù)生長。

戳這里,詳細(xì)了解OmniMem的核心技術(shù)與優(yōu)勢(shì)。

-

DoS

+關(guān)注

關(guān)注

0文章

129瀏覽量

45984 -

涂鴉智能

+關(guān)注

關(guān)注

7文章

315瀏覽量

20739 -

ai硬件

+關(guān)注

關(guān)注

0文章

36瀏覽量

2646

發(fā)布評(píng)論請(qǐng)先 登錄

嵌入式AI開發(fā)必看:杜絕幻覺,才是工業(yè)級(jí)IDE的核心底氣

兆易創(chuàng)新與涂鴉智能達(dá)成深度合作,共啟AI+IoT生態(tài)協(xié)同新篇

軟硬全開源 + 擴(kuò)展無邊界!涂鴉 T5 AI 口袋機(jī),讓 AI + IoT 創(chuàng)意在掌心生長

格靈深瞳智慧體育解決方案打造AI運(yùn)動(dòng)新體驗(yàn)

何同學(xué)“AI尋牛”硬件激發(fā)創(chuàng)意,2025 SparkS全球AI硬件創(chuàng)新大賽啟動(dòng)

10分鐘用涂鴉王牌開發(fā)板,打造能玩熱門游戲的AI紙巾盒!低成本低門檻有手就會(huì)

【「AI芯片:科技探索與AGI愿景」閱讀體驗(yàn)】+AI芯片到AGI芯片

代碼如何重塑硬件設(shè)計(jì),AI如何加速創(chuàng)新?

“端云+多模態(tài)”新范式:《移遠(yuǎn)通信AI大模型技術(shù)方案白皮書》正式發(fā)布

涂鴉OmniAI Foundation 2.2版本正式發(fā)布:AI智能體全面升級(jí),響應(yīng)速度迅猛提高40%

涂鴉智能重磅發(fā)布四大AIoT技術(shù)引擎,賦能開發(fā)者以AI重構(gòu)物理世界

涂鴉Omni AI Foundation V2.6發(fā)布:低代碼+多模態(tài),重塑AI硬件創(chuàng)新體驗(yàn)

涂鴉Omni AI Foundation V2.6發(fā)布:低代碼+多模態(tài),重塑AI硬件創(chuàng)新體驗(yàn)

評(píng)論