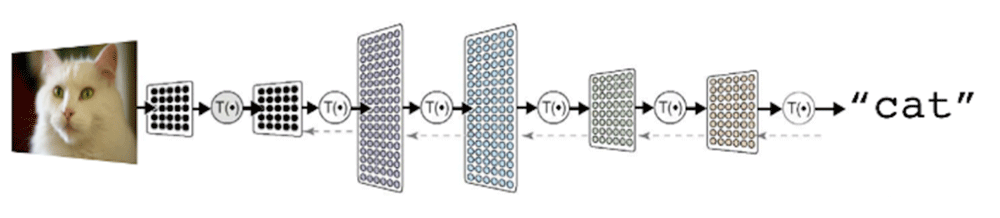

在深度學習的廣闊領域中,反卷積(Deconvolution,也稱作Transposed Convolution)作為一種重要的圖像上采樣技術,扮演著至關重要的角色。特別是在計算機視覺任務中,如圖像分割、圖像重建和生成對抗網絡(GANs)等,反卷積展現出了其獨特的優勢和廣泛的應用前景。本文將詳細探討深度學習中的反卷積技術,包括其定義、原理、實現方式、應用場景以及與其他上采樣方法的比較,以期為讀者提供一個全面而深入的理解。

一、反卷積的定義與原理

1. 定義

反卷積,顧名思義,是卷積操作的逆過程或一種特殊形式的前向卷積。然而,需要明確的是,反卷積并不是卷積操作的嚴格逆運算,它主要關注的是恢復圖像或特征圖的尺寸,而非精確還原原始像素值。反卷積通過一定的算法(如補零、步長調整等)擴大輸入圖像或特征圖的尺寸,并進行正向卷積,以達到上采樣的目的。

2. 原理

反卷積的原理可以通過矩陣操作來直觀理解。在正向卷積中,輸入特征圖(input feature map)通過卷積核(kernel)進行卷積操作,輸出特征圖(output feature map)的尺寸通常會減小。而在反卷積中,為了恢復尺寸,首先會對輸入特征圖進行補零(padding)操作,然后采用一個特殊的卷積核(通常是原卷積核的轉置或類似結構)進行正向卷積。這里的“轉置”并非數學意義上的嚴格轉置,而是指一種特殊的操作方式,用于模擬尺寸恢復的效果。

具體來說,反卷積的操作步驟如下:

- 補零 :按照一定規則在輸入特征圖的周圍填充零,以擴大其尺寸。

- 旋轉卷積核 (可選):在某些實現中,會將卷積核進行旋轉,但這并非所有反卷積操作的必要步驟。

- 正向卷積 :使用擴大后的輸入特征圖和特定的卷積核進行正向卷積操作,得到輸出特征圖。

需要注意的是,由于反卷積的卷積核并非原卷積核的嚴格轉置,因此反卷積操作只能恢復尺寸,而不能精確還原原始像素值。

二、反卷積的實現方式

在深度學習框架中,如PyTorch和TensorFlow,反卷積操作通常通過特定的函數或層來實現。

1. PyTorch中的反卷積

在PyTorch中,反卷積操作通過nn.ConvTranspose2d類來實現。該類的參數包括輸入通道數(in_channels)、輸出通道數(out_channels)、卷積核大小(kernel_size)、步長(stride)、填充(padding)、輸出填充(output_padding)等。其中,stride參數在反卷積中通常設置為小于1的小數(如0.5),以模擬步長增大的效果,從而實現尺寸的恢復。

2. TensorFlow中的反卷積

在TensorFlow中,反卷積操作通過tf.nn.conv2d_transpose函數來實現。該函數同樣需要指定輸入張量、卷積核、輸出張量的形狀、步長以及填充方式等參數。TensorFlow的反卷積實現與PyTorch類似,都是通過對輸入特征圖進行補零和正向卷積來恢復尺寸。

三、反卷積的應用場景

1. 圖像分割

在圖像分割任務中,反卷積常用于將經過卷積神經網絡提取的特征圖恢復到原始圖像的尺寸,以便進行像素級的分類。通過反卷積操作,可以使得網絡輸出的分割圖與輸入圖像具有相同的尺寸,從而便于后續的處理和評估。

2. 圖像重建

在圖像重建任務中,如超分辨率重建和去模糊等,反卷積也是重要的工具之一。通過反卷積操作,可以逐步恢復圖像的細節信息,提高重建圖像的質量。

3. 生成對抗網絡(GANs)

在GANs中,反卷積常用于生成器(Generator)中,以將隨機噪聲或低分辨率圖像轉換為高分辨率圖像。通過反卷積操作,生成器可以逐步擴大圖像的尺寸和豐富圖像的細節,從而生成逼真的圖像。

四、反卷積與其他上采樣方法的比較

1. 雙線性插值(Bilinear Interpolation)

雙線性插值是一種簡單而有效的上采樣方法,它通過計算插值點周圍四個像素點的加權平均值來生成新的像素值。與反卷積相比,雙線性插值不需要額外的訓練參數,計算速度快,但生成的圖像質量可能不如反卷積精細。

2. 反池化(Unpooling)

反池化是池化操作(如最大池化或平均池化)的逆過程,通常用于卷積神經網絡中特征圖的上采樣。與反卷積不同,反池化操作需要額外的信息來指導上采樣的過程,比如記錄池化時選擇的最大值的位置(在最大池化中)。在反池化時,這些記錄的位置會被用來放置原始的最大值,而其余位置則可以通過填充零或采用某種插值方法(如雙線性插值)來填充。反池化在某些特定的任務中(如圖像分割中的上采樣路徑)有其獨特的優勢,因為它能夠保留一些重要的位置信息,但相比反卷積,它在生成新的特征信息方面較為有限。

3. 上采樣卷積(Up-Convolution)

雖然“上采樣卷積”這個詞不是深度學習中的標準術語,但它有時被用來泛指任何用于上采樣的卷積操作,包括反卷積。然而,為了明確區分,我們可以將那些直接通過調整卷積參數(如步長、填充)來實現上采樣效果的卷積操作稱為上采樣卷積。這種上采樣方式不需要顯式的“反卷積”層,而是通過在正向卷積中設置適當的參數(如步長小于1)來直接增大特征圖的尺寸。然而,這種方式在尺寸恢復方面可能不如反卷積靈活和精確。

五、反卷積的優缺點

優點:

- 靈活性 :反卷積通過調整卷積核、步長和填充等參數,可以靈活地控制輸出特征圖的尺寸和形狀。

- 學習能力 :作為神經網絡的一部分,反卷積層可以通過訓練學習到適合任務的上采樣模式,從而生成更加精細和逼真的圖像。

- 集成性 :反卷積可以無縫集成到現有的卷積神經網絡架構中,用于構建端到端的上采樣-下采樣網絡。

缺點:

- 計算成本 :與簡單的插值方法相比,反卷積需要更多的計算資源,因為它涉及到卷積操作的執行。

- 參數冗余 :在某些情況下,反卷積層可能會引入冗余的參數,特別是當輸出特征圖的尺寸遠大于輸入特征圖時。

- 棋盤效應 :在某些配置下,反卷積操作可能會產生明顯的棋盤狀偽影,這可能是由于卷積核的周期性采樣導致的。

六、結論

反卷積作為深度學習中的一種重要上采樣技術,在圖像分割、圖像重建和生成對抗網絡等任務中發揮著重要作用。通過理解反卷積的定義、原理、實現方式以及與其他上采樣方法的比較,我們可以更好地掌握這一技術,并在實際應用中發揮其優勢。同時,我們也應注意到反卷積的潛在缺點,并在設計和訓練網絡時采取相應的措施來克服這些問題。未來,隨著深度學習技術的不斷發展,反卷積技術也將繼續演進和完善,為更多領域的應用提供有力支持。

-

圖像分割

+關注

關注

4文章

182瀏覽量

18775 -

反卷積

+關注

關注

0文章

4瀏覽量

6454 -

深度學習

+關注

關注

73文章

5598瀏覽量

124394

發布評論請先 登錄

機器學習和深度學習中需避免的 7 個常見錯誤與局限性

穿孔機頂頭檢測儀 機器視覺深度學習

如何深度學習機器視覺的應用場景

CNN卷積神經網絡設計原理及在MCU200T上仿真測試

如何在機器視覺中部署深度學習神經網絡

深度學習對工業物聯網有哪些幫助

自動駕駛中Transformer大模型會取代深度學習嗎?

當深度學習遇上嵌入式資源困境,特征空間如何破局?

深度學習中反卷積的原理和應用

深度學習中反卷積的原理和應用

評論