圖 1:基于深度學(xué)習(xí)的目標(biāo)檢測(cè)可定位已訓(xùn)練的目標(biāo)類(lèi)別,并通過(guò)矩形框(邊界框)對(duì)其進(jìn)行標(biāo)識(shí)。

在討論人工智能(AI)或深度學(xué)習(xí)時(shí),經(jīng)常會(huì)出現(xiàn)“神經(jīng)網(wǎng)絡(luò)”、“黑箱”、“標(biāo)注”等術(shù)語(yǔ)。這些概念對(duì)非專業(yè)人士而言往往難以理解,人們也常常誤以為需要扎實(shí)的編程技能才能真正掌握并合理使用這項(xiàng)技術(shù)。事實(shí)上,這種印象忽視了該技術(shù)為機(jī)器視覺(jué)(乃至生產(chǎn)自動(dòng)化)帶來(lái)的潛力,因?yàn)樯疃葘W(xué)習(xí)并非只屬于計(jì)算機(jī)科學(xué)家或程序員。

從頭開(kāi)始:什么是深度學(xué)習(xí)?

作為機(jī)器學(xué)習(xí)的子集,深度學(xué)習(xí)基于多層神經(jīng)網(wǎng)絡(luò),它們能夠逼真地模擬人腦的復(fù)雜結(jié)構(gòu)和過(guò)程,并獨(dú)立做出決策。在全面的訓(xùn)練過(guò)程中,深度學(xué)習(xí)模型通過(guò)分析數(shù)據(jù)學(xué)習(xí)識(shí)別特定模式和關(guān)系。

那么,深度學(xué)習(xí)技術(shù)為何在機(jī)器視覺(jué)領(lǐng)域如此成功呢?因?yàn)闄C(jī)器視覺(jué)會(huì)產(chǎn)生海量的圖像數(shù)據(jù),這為神經(jīng)網(wǎng)絡(luò)的有效訓(xùn)練提供了完美基礎(chǔ)。與此同時(shí),用戶也能從深度學(xué)習(xí)技術(shù)中獲益:深度學(xué)習(xí)能提供的識(shí)別率達(dá)到了新的質(zhì)量水平,這也使得全新的機(jī)器視覺(jué)自動(dòng)化應(yīng)用成為可能。

整體而言,深度學(xué)習(xí)為機(jī)器視覺(jué)注入了新的發(fā)展動(dòng)力,因此越來(lái)越多人認(rèn)為深度學(xué)習(xí)值得使用。許多大大小小的公司都在考慮引入AI或深度學(xué)習(xí),但往往因某些顧慮而遲遲未有行動(dòng)。實(shí)際上,使用該技術(shù)并不像他們想象的那么復(fù)雜,目前也有工具能簡(jiǎn)化深度學(xué)習(xí)的應(yīng)用流程。

適配不同應(yīng)用的深度學(xué)習(xí)方法

在落地實(shí)踐中,最核心的問(wèn)題是:你究竟想自動(dòng)化什么任務(wù)?集成商、工廠運(yùn)營(yíng)商、機(jī)器制造商可使用的深度學(xué)習(xí)方法,正在不斷增多。

(1)異常檢測(cè)

異常檢測(cè)能快速輕松地識(shí)別缺陷,使質(zhì)量管理流程中的缺陷檢測(cè)效率大大提高。其最大的優(yōu)勢(shì)在于:傳統(tǒng)深度學(xué)習(xí)方法相比,該技術(shù)需要更少的訓(xùn)練數(shù)據(jù)—— 完整的訓(xùn)練只需 20~100 張圖像。而且,異常檢測(cè)僅需“正常圖像”即可滿足要求,這使訓(xùn)練數(shù)據(jù)集的生成速度大大加快。基于正常圖像訓(xùn)練的異常檢測(cè)模型,能夠識(shí)別與訓(xùn)練圖像的結(jié)構(gòu)偏差(即異常),從而檢測(cè)出此前未知的缺陷形態(tài)。

(2)全局背景異常檢測(cè)

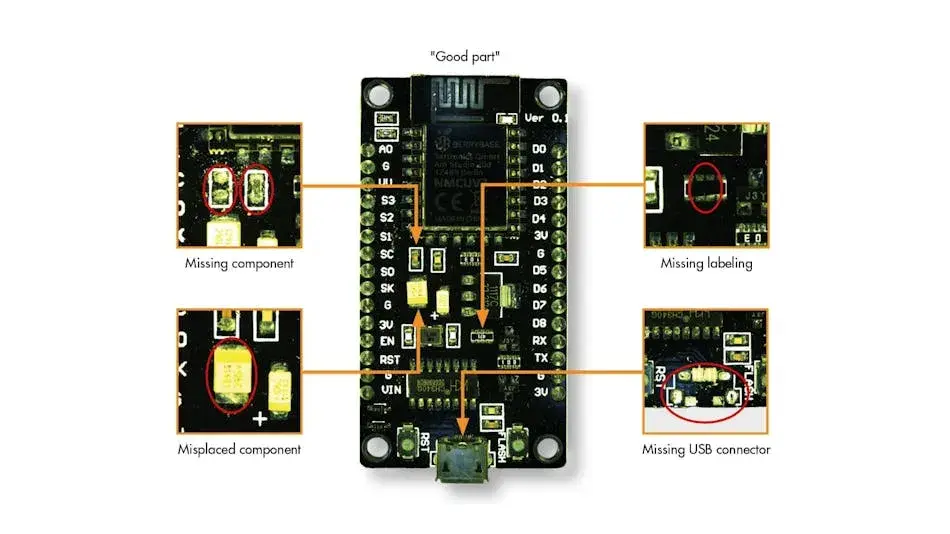

全局背景異常檢測(cè)更進(jìn)一步,它能識(shí)別全新的異常類(lèi)型,如部件缺失、變形或排列錯(cuò)誤。因此,缺陷檢測(cè)不再局限于結(jié)構(gòu)缺陷,還涵蓋了邏輯異常,這為半導(dǎo)體制造中的印刷電路板檢測(cè)、印刷驗(yàn)證等全新場(chǎng)景開(kāi)辟了道路。

編輯

?

圖2:基于深度學(xué)習(xí)的全局上下文異常檢測(cè)技術(shù),可以實(shí)現(xiàn)半導(dǎo)體生產(chǎn)中印刷電路板的可靠檢測(cè)。

(3)分類(lèi)

分類(lèi)利用圖像數(shù)據(jù)將對(duì)象歸屬于特定類(lèi)別或等級(jí),例如“合格品”或“不良品”。這使得每張圖像都能以一定概率確定其所屬類(lèi)別。

(4)目標(biāo)檢測(cè)

基于深度學(xué)習(xí)的目標(biāo)檢測(cè)技術(shù),能定位目標(biāo)的位置并識(shí)別其類(lèi)別。該過(guò)程能夠識(shí)別不同目標(biāo)類(lèi)別和實(shí)例的各種目標(biāo)實(shí)體,包括它們?cè)趫D像中的位置。

(5)分割

基于深度學(xué)習(xí)的分割有兩種類(lèi)型:語(yǔ)義分割和實(shí)例分割。

· 語(yǔ)義分割:對(duì)經(jīng)過(guò)訓(xùn)練的目標(biāo)、結(jié)構(gòu)和缺陷進(jìn)行像素級(jí)精確定位。在此過(guò)程中,圖像中的每個(gè)像素都會(huì)被分配類(lèi)別標(biāo)簽,并基于訓(xùn)練數(shù)據(jù)“教導(dǎo)”模型,使其能夠?qū)π聢D像中的每個(gè)像素的所屬類(lèi)別進(jìn)行高概率預(yù)測(cè)。這種方法使得執(zhí)行此前無(wú)法實(shí)現(xiàn)或僅能通過(guò)大量編程工作才能完成的檢測(cè)任務(wù)成為可能。

· 實(shí)例分割:結(jié)合了語(yǔ)義分割和目標(biāo)檢測(cè)的雙重優(yōu)勢(shì),能以像素級(jí)精度為不同目標(biāo)分配類(lèi)別標(biāo)簽。該技術(shù)特別適用于物體緊密排列、相互接觸或重疊的應(yīng)用場(chǎng)景,典型應(yīng)用包括從料箱中隨機(jī)抓取散放工件(料箱隨機(jī)抓取),以及識(shí)別和測(cè)量自然生長(zhǎng)的結(jié)構(gòu)。

(6)邊緣提取

這是一種基于深度學(xué)習(xí)的可靠的創(chuàng)新性邊緣提取方法,它能夠從圖像中大量可見(jiàn)的邊緣中精準(zhǔn)地提取目標(biāo)邊緣。該技術(shù)即使在低對(duì)比度或強(qiáng)噪聲環(huán)境下也能穩(wěn)定識(shí)別邊緣,可提取傳統(tǒng)邊緣識(shí)別濾波器無(wú)法識(shí)別的邊緣。該技術(shù)通常與基于規(guī)則的機(jī)器視覺(jué)方法結(jié)合使用。

?

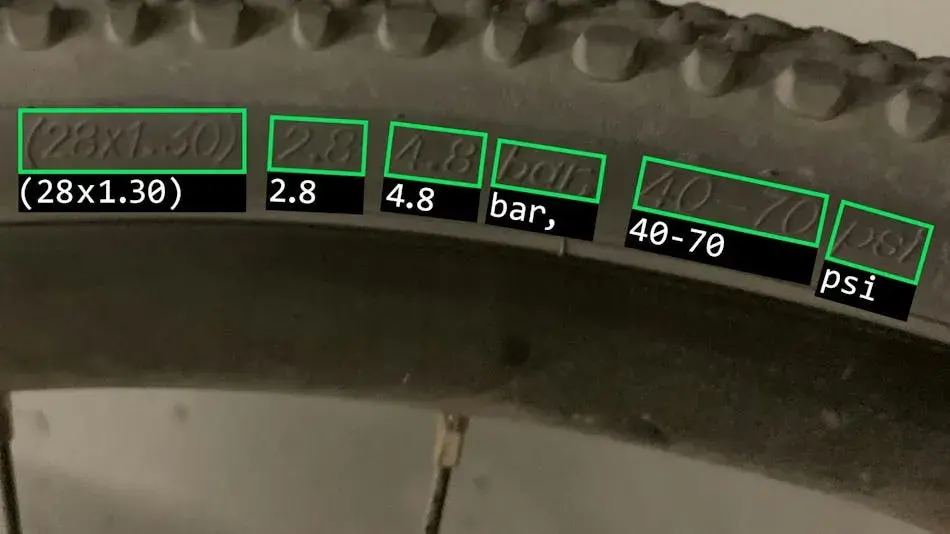

圖 3A:使用深度學(xué)習(xí)的光學(xué)字符識(shí)別(OCR)示例,即深度 OCR。

?

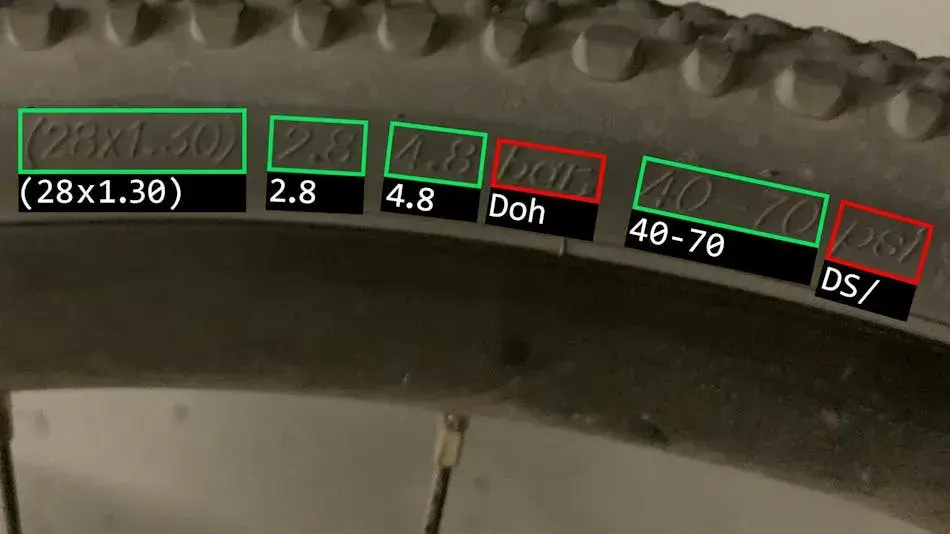

圖3B:未使用深度學(xué)習(xí)時(shí),光學(xué)字符識(shí)別(OCR)的結(jié)果精度低于深度 OCR。

(7)深度 OCR(光學(xué)字符識(shí)別)

基于深度學(xué)習(xí)算法的 OCR 被稱為深度 OCR,即使在挑戰(zhàn)性條件下(如識(shí)別傾斜文本、變形字符、印在或蝕刻在反光表面上的字符,或高紋理彩色背景上的字符)也能輸出可靠結(jié)果。深度 OCR 可以自動(dòng)對(duì)字符分組以識(shí)別單詞,避免相似字符的誤判,從而提升識(shí)別性能。

(8)深度計(jì)數(shù)

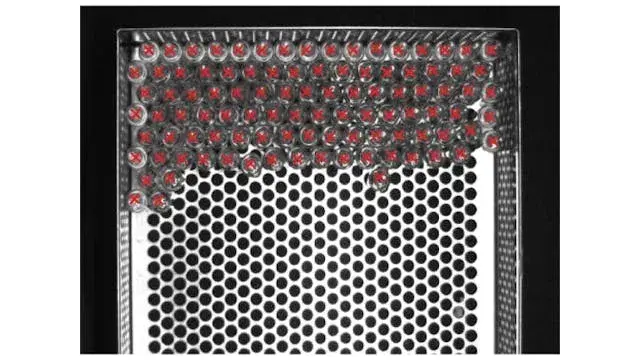

深度計(jì)數(shù)可快速定位和計(jì)數(shù)大量目標(biāo),不僅基于部件形狀,還通過(guò)深度學(xué)習(xí)整合顏色、圖案或紋理等其他特征。其顯著優(yōu)勢(shì)在于,即使目標(biāo)由高反光或無(wú)定形材料制成,也能實(shí)現(xiàn)可靠計(jì)數(shù),還能可靠記錄大量相互接觸或部分重疊的目標(biāo)。因此,該技術(shù)非常適合食品飲料行業(yè)中各類(lèi)產(chǎn)品的計(jì)數(shù),以及螺母、螺栓等小物件的精準(zhǔn)包裝核驗(yàn)。

深度學(xué)習(xí)的最佳應(yīng)用場(chǎng)景在哪里?

深度學(xué)習(xí)開(kāi)辟了全新的應(yīng)用領(lǐng)域,讓更多不熟悉機(jī)器視覺(jué)或不愿自己編寫(xiě)算法的人,也能使用機(jī)器視覺(jué)。AI系統(tǒng)通常可通過(guò)自有圖像文件進(jìn)行設(shè)置,其優(yōu)勢(shì)在于:通過(guò)訓(xùn)練神經(jīng)網(wǎng)絡(luò),AI系統(tǒng)往往能比傳統(tǒng)算法輸出更可靠的檢測(cè)結(jié)果。例如,當(dāng)所有目標(biāo)外觀完全相同時(shí),傳統(tǒng)的匹配算法才表現(xiàn)良好;但當(dāng)數(shù)據(jù)存在大量變化時(shí)(如果蔬的自然差異,此時(shí)很難提前明確定義傳統(tǒng)特征,如怎樣的表面算合格?),AI系統(tǒng)則更具優(yōu)勢(shì)。AI系統(tǒng)的另一個(gè)應(yīng)用場(chǎng)景是對(duì)質(zhì)量標(biāo)準(zhǔn)要求極高的生產(chǎn)制造領(lǐng)域。

圖 4:深度計(jì)數(shù)可用于快速且可靠地對(duì)大量目標(biāo)(如玻璃瓶)進(jìn)行計(jì)數(shù)。

某些企業(yè)的生產(chǎn)線幾乎零缺陷,因此無(wú)法為基于規(guī)則的系統(tǒng)提供缺陷樣本圖像——畢竟瑕疵可能萬(wàn)中無(wú)一,且缺陷形態(tài)事前無(wú)法預(yù)知。基于AI的異常檢測(cè)技術(shù)此時(shí)便能大顯身手:該技術(shù)無(wú)需預(yù)知缺陷特征,僅需學(xué)習(xí)良品特征即可建立檢測(cè)模型。這類(lèi)應(yīng)用在傳統(tǒng)規(guī)則編程框架下是無(wú)法實(shí)現(xiàn)的。

然而,實(shí)現(xiàn)完美機(jī)器視覺(jué)應(yīng)用的最佳途徑,在于將深度學(xué)習(xí)算法與基于規(guī)則的機(jī)器視覺(jué)技術(shù)雙劍合璧。典型應(yīng)用場(chǎng)景如下:企業(yè)利用AI進(jìn)行預(yù)分類(lèi),以精準(zhǔn)定位待測(cè)興趣區(qū)域(ROI),再通過(guò)傳統(tǒng)方法在該區(qū)域內(nèi)執(zhí)行高精度測(cè)量。這種協(xié)同策略不僅能提升整體檢測(cè)效率,也能獲得更準(zhǔn)確的檢測(cè)結(jié)果。

如何在機(jī)器視覺(jué)中啟用深度學(xué)習(xí)?

要在機(jī)器視覺(jué)應(yīng)用中部署深度學(xué)習(xí),首先要構(gòu)建經(jīng)典的機(jī)器視覺(jué)硬件:包含工業(yè)相機(jī)、適配的光源及高性能計(jì)算設(shè)備(如配備高性能 CPU 或 GPU的工控機(jī))。而整套系統(tǒng)的核心是強(qiáng)大的機(jī)器視覺(jué)軟件,這可以從 MVTec 等多家公司獲取。

(1)深度學(xué)習(xí)訓(xùn)練中的圖像數(shù)據(jù)優(yōu)化準(zhǔn)備

實(shí)施深度學(xué)習(xí)應(yīng)用需首先完成訓(xùn)練圖像的標(biāo)注——即在圖像中標(biāo)記出模型應(yīng)輸出的目標(biāo)信息,包括圖像類(lèi)別或物體位置坐標(biāo)。配備直觀用戶界面的標(biāo)注軟件,即使是不具備編程技能的初學(xué)者也能輕松操作。進(jìn)行數(shù)據(jù)準(zhǔn)備時(shí)需注意:圖像數(shù)據(jù)必須經(jīng)過(guò)優(yōu)化處理。

值得注意的是,某些深度學(xué)習(xí)技術(shù)(如異常檢測(cè)等無(wú)監(jiān)督方法)僅需“正常圖像”即可訓(xùn)練,通常獲取20至100幅良品圖像即可滿足需求(具體數(shù)量需視被檢物體狀態(tài)而定)。訓(xùn)練過(guò)程更可一鍵啟動(dòng)。

(2)窺探深度學(xué)習(xí)的“黑箱”

盡管深度學(xué)習(xí)常因決策過(guò)程不透明而受到詬病,但是一些最新的技術(shù)進(jìn)展正在逐步揭示神經(jīng)網(wǎng)絡(luò)的內(nèi)在運(yùn)作機(jī)制。例如,通過(guò)熱力圖工具高亮圖像中的決策關(guān)鍵區(qū)域(如圖5),這是追蹤或影響深度學(xué)習(xí)算法行為的一種方式。

圖5:熱力圖通過(guò)高亮圖像中的決策依據(jù)區(qū)域,有效提升深度學(xué)習(xí)推理的透明度。

借助“分布外檢測(cè)”(OOD)技術(shù),可以在運(yùn)行過(guò)程中識(shí)別由錯(cuò)誤分類(lèi)導(dǎo)致的意外行為,并采取相應(yīng)措施。使用深度學(xué)習(xí)分類(lèi)器時(shí),系統(tǒng)通常會(huì)將未知目標(biāo)分配到已學(xué)習(xí)的類(lèi)別中,這可能會(huì)存在問(wèn)題,尤其是在遇到之前從未見(jiàn)過(guò)的錯(cuò)誤類(lèi)型或異物時(shí)。這項(xiàng)新的深度學(xué)習(xí)功能,會(huì)在將未知目標(biāo)分類(lèi)到訓(xùn)練數(shù)據(jù)中未包含的范圍時(shí)提醒用戶。例如,若系統(tǒng)僅針對(duì)帶紅色標(biāo)簽或黃色標(biāo)簽的瓶子訓(xùn)練,當(dāng)出現(xiàn)帶綠色標(biāo)簽的瓶子時(shí),會(huì)顯示“分布外”消息,并附帶 OOD 分?jǐn)?shù),以顯示目標(biāo)與已訓(xùn)練類(lèi)別的偏離程度。

此外,還可以借助閾值來(lái)影響深度學(xué)習(xí)的結(jié)果。例如,為了進(jìn)行異常檢測(cè),可以將閾值設(shè)置得很高,在這種情況下,你只會(huì)得到“正常”的結(jié)果。如果將閾值設(shè)置得較低,系統(tǒng)相應(yīng)地會(huì)輸出越來(lái)越少的 “正常” 結(jié)果,從而避免漏檢。這使用戶能夠靈活且個(gè)性化地調(diào)整模型對(duì)異常情況的響應(yīng)靈敏度。

在機(jī)器視覺(jué)中開(kāi)啟深度學(xué)習(xí)之路

如果企業(yè)想利用深度學(xué)習(xí)的諸多優(yōu)勢(shì),就需要制定周全的策略,以目標(biāo)導(dǎo)向的方式落地并長(zhǎng)期應(yīng)用這項(xiàng)技術(shù)。然而,與所有人工智能方法一樣,深度學(xué)習(xí)也伴隨著一定的復(fù)雜性。事實(shí)證明,機(jī)器視覺(jué)是這一背景下的關(guān)鍵技術(shù)——在該領(lǐng)域中,被證實(shí)的深度學(xué)習(xí)方法能夠被高效且可獲利地應(yīng)用部署。

來(lái)源:半導(dǎo)體芯科技

審核編輯 黃宇

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4839瀏覽量

108048 -

機(jī)器視覺(jué)

+關(guān)注

關(guān)注

165文章

4814瀏覽量

126361 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5602瀏覽量

124565

發(fā)布評(píng)論請(qǐng)先 登錄

面向嵌入式部署的神經(jīng)網(wǎng)絡(luò)優(yōu)化:模型壓縮深度解析

穿孔機(jī)頂頭檢測(cè)儀 機(jī)器視覺(jué)深度學(xué)習(xí)

神經(jīng)網(wǎng)絡(luò)的初步認(rèn)識(shí)

自動(dòng)駕駛中常提的卷積神經(jīng)網(wǎng)絡(luò)是個(gè)啥?

NMSIS神經(jīng)網(wǎng)絡(luò)庫(kù)使用介紹

在Ubuntu20.04系統(tǒng)中訓(xùn)練神經(jīng)網(wǎng)絡(luò)模型的一些經(jīng)驗(yàn)

CICC2033神經(jīng)網(wǎng)絡(luò)部署相關(guān)操作

人工智能工程師高頻面試題匯總:循環(huán)神經(jīng)網(wǎng)絡(luò)篇(題目+答案)

液態(tài)神經(jīng)網(wǎng)絡(luò)(LNN):時(shí)間連續(xù)性與動(dòng)態(tài)適應(yīng)性的神經(jīng)網(wǎng)絡(luò)

神經(jīng)網(wǎng)絡(luò)的并行計(jì)算與加速技術(shù)

無(wú)刷電機(jī)小波神經(jīng)網(wǎng)絡(luò)轉(zhuǎn)子位置檢測(cè)方法的研究

神經(jīng)網(wǎng)絡(luò)專家系統(tǒng)在電機(jī)故障診斷中的應(yīng)用

基于FPGA搭建神經(jīng)網(wǎng)絡(luò)的步驟解析

如何在CentOS系統(tǒng)中部署ELK日志分析系統(tǒng)

如何在機(jī)器視覺(jué)中部署深度學(xué)習(xí)神經(jīng)網(wǎng)絡(luò)

如何在機(jī)器視覺(jué)中部署深度學(xué)習(xí)神經(jīng)網(wǎng)絡(luò)

評(píng)論