電子發(fā)燒友網(wǎng)報(bào)道(文/李彎彎)當(dāng)?shù)貢r間5月13日,OpenAI舉行春季發(fā)布會,宣布將推出桌面版ChatGPT,并發(fā)布全新旗艦AI模型GPT-4o。

根據(jù)OpenAI官方網(wǎng)站介紹,GPT-4o中的“o”代表Omni,也就是“全能”的意思。GPT-4o文本、推理、編碼能力達(dá)到GPT-4 Turbo水平,速度是上一代AI大模型GPT-4 Turbo的兩倍,但成本僅為GPT-4 Turbo的一半,視頻、音頻功能得到改善。

GPT-4o速度更快,且能感知用戶情緒

根據(jù)OpenAI介紹,GPT-4o與GPT-3.5、GPT-4的語音對談機(jī)制不同。GPT-3.5和GPT-4會先將音頻轉(zhuǎn)換為文本,再接收文本生成文本,最后將文本轉(zhuǎn)換為音頻,經(jīng)歷這三個過程,音頻中的情感表達(dá)等信息會被折損,而GPT-4o是跨文本、視覺和音頻的端到端模型,是OpenAI第一個綜合了這些維度的模型,可更好進(jìn)行對談。

OpenAI技術(shù)負(fù)責(zé)人Mira Murati表示:“這是我們第一次在易用性方面真正邁出的一大步。”O(jiān)penAI研究員Mark Chen表示,新模型具有“感知情緒”的能力,能輸出笑聲、歌唱或表達(dá)情感,還可以處理用戶打斷它的情況。

GPT-4o極大地改進(jìn)了OpenAI的AI聊天機(jī)器人ChatGPT的體驗(yàn)。在發(fā)布會上,OpenAI研究主管Mark Chen和OpenAI的后訓(xùn)練團(tuán)隊(duì)負(fù)責(zé)人Barret Zoph通過現(xiàn)場演示展示出了新模型GPT-4o的強(qiáng)大。

如在演示對話中,Mark Chen表現(xiàn)得有點(diǎn)緊張,然后開始急促地呼吸。當(dāng)GPT-4o聽到Chen過度呼氣時,它似乎從中察覺到了他的緊張,并說到:別緊張,你喘得像個吸塵器,深呼吸,再吐氣。接著GPT開始指導(dǎo)Chen怎么深吸慢呼平復(fù)心情。

在另一段對話演示中,Chen讓GPT給Zoph講個睡前故事哄他入睡,Chen反復(fù)打斷GPT的講述,問它能不能講得更刺激點(diǎn),最后GPT用非常迪士尼的方式唱出了一個故事。

GPT-4o還可以通過視覺識別檢測人的情緒。在一個演示中,Zoph將手機(jī)舉到自己面前正對著臉,要求ChatGPT告訴他自己長什么樣子。GPT-4o注意到了Zoph臉上的微笑,對他說:“看起來你感覺非常快樂,喜笑顏開。”

GPT-4o也能夠進(jìn)行實(shí)時快速翻譯,OpenAI技術(shù)負(fù)責(zé)人Mira Murati在現(xiàn)場對ChatGPT說起了意大利語,GPT則將她的話翻譯成英語。

OpenAI首席執(zhí)行官山姆·奧特曼(Sam Altman)表示,新的語音和視頻模式是他用過的最好的電腦界面,感覺就像電影里的AI。達(dá)到人類水平的反應(yīng)時間和表達(dá)能力是一個很大的變化。

Sam Altman談到:“對我來說,與電腦交談從來都不是一件很自然的事,現(xiàn)在它做到了。隨著我們增加(可選的)個性化、訪問你的信息、代表你采取行動的能力等等,我真的可以看到一個令人興奮的未來,我們能夠使用計(jì)算機(jī)做比以往任何時候都多的事情。”

GPT-4o功能未來將會進(jìn)一步發(fā)展

自發(fā)布之日,GPT-4o可在ChatGPT的免費(fèi)版本中使用,并提供給OpenAI的高級ChatGPT Plus和Team計(jì)劃訂戶,具有“5倍更高”的消息限制。OpenAI指出,當(dāng)用戶達(dá)到速率限制時,ChatGPT將自動切換到GPT-3.5。

OpenAI稱,基于GPT-4o的ChatGPT文本和圖像輸入功能將于本周一上線,語音和視頻選項(xiàng)將在未來幾周內(nèi)推出。另外,OpenAI將在未來1個月左右向Plus用戶推出基于GPT-4o改進(jìn)的語音體驗(yàn),目前GPT-4o的API并不包含語音功能。

OpenAI指出,在API使用方面,相比去年11月發(fā)布的GPT-4-turbo,GPT-4o價(jià)格降低一半。成本下降對于大模型的調(diào)用至關(guān)重要。OpenAI開始致力于將大模型推向市場。

另外據(jù)Murati介紹,GPT-4o的功能在未來將會進(jìn)一步發(fā)展。比如,盡管目前GPT-4o可以查看不同語言的菜單照片并進(jìn)行翻譯,但未來,該模型可能使ChatGPT能夠觀看直播的體育比賽并向您解釋規(guī)則。

Murati表示:“我們知道這些模型變得越來越復(fù)雜,但我們希望交互體驗(yàn)實(shí)際上變得更加自然、簡單,您不需要關(guān)注UI,而只需專注于與ChatGPT的合作。”

對于大家一直關(guān)注的安全性問題,OpenAI也重點(diǎn)提及。據(jù)稱,通過過濾訓(xùn)練數(shù)據(jù)和訓(xùn)練后改進(jìn)模型行為等技術(shù),GPT-4o在設(shè)計(jì)中內(nèi)置了跨模式的安全性,并創(chuàng)建了新的安全系統(tǒng),為語音輸出提供護(hù)欄。

GPT-4o還與來自社會心理學(xué)、偏見和公平、錯誤信息等領(lǐng)域的70多名外部專家開展廣泛的外部合作,以識別新增加的模式引入或放大的風(fēng)險(xiǎn),提高與GPT-4o互動的安全性。

OpenAI表示,將繼續(xù)減少新發(fā)現(xiàn)的風(fēng)險(xiǎn)。由于認(rèn)識到GPT-4o的音頻模式存在各種新的風(fēng)險(xiǎn),目前公開的是文本和圖像輸入以及文本輸出,在接下來的幾周和幾個月里將圍繞技術(shù)基礎(chǔ)設(shè)施、訓(xùn)練后的可用性、發(fā)布其他模式所需的安全性開展工作,例如音頻輸出將僅限于選定的預(yù)設(shè)聲音,并將遵守現(xiàn)有安全政策。

寫在最后

可以看到,大模型技術(shù)正在快速發(fā)展,而OpenAI新模型GPT-4o無疑又將大模型技術(shù)和應(yīng)用推向了一個新高度。目前全球科技廠商都在積極角逐,微軟、谷歌等頭部企業(yè)都紛紛召開發(fā)布會,密集推出大模型產(chǎn)品,蘋果傳言也已與OpenAI達(dá)成協(xié)議,在 iPhone使用其技術(shù)。不難看到,接下來大模型無論是在技術(shù)升級還是應(yīng)用落地上都將會呈現(xiàn)一番新景象。

-

GPT

+關(guān)注

關(guān)注

0文章

368瀏覽量

16871 -

OpenAI

+關(guān)注

關(guān)注

9文章

1245瀏覽量

10058 -

ChatGPT

+關(guān)注

關(guān)注

31文章

1598瀏覽量

10264 -

AI大模型

+關(guān)注

關(guān)注

0文章

398瀏覽量

998

發(fā)布評論請先 登錄

GPT-5震撼發(fā)布:AI領(lǐng)域的重大飛躍

GPT-5.1發(fā)布 OpenAI開始拼情商

飛睿智能遠(yuǎn)距離WiFi傳輸遠(yuǎn)、延遲低、組網(wǎng)快,適用各種遠(yuǎn)距離傳輸場景

飛睿智能遠(yuǎn)距離WiFi傳輸遠(yuǎn)、延遲低、組網(wǎng)快,適用各種遠(yuǎn)距離傳輸場景

NVIDIA從云到邊緣加速OpenAI gpt-oss模型部署,實(shí)現(xiàn)150萬TPS推理

訊飛星辰MaaS平臺率先上線OpenAI最新開源模型

OpenAI或在周五凌晨發(fā)布GPT-5 OpenAI以低價(jià)向美國政府提供ChatGPT

OpenAI發(fā)布2款開源模型

AI真會人格分裂!OpenAI最新發(fā)現(xiàn),ChatGPT善惡開關(guān)已開啟

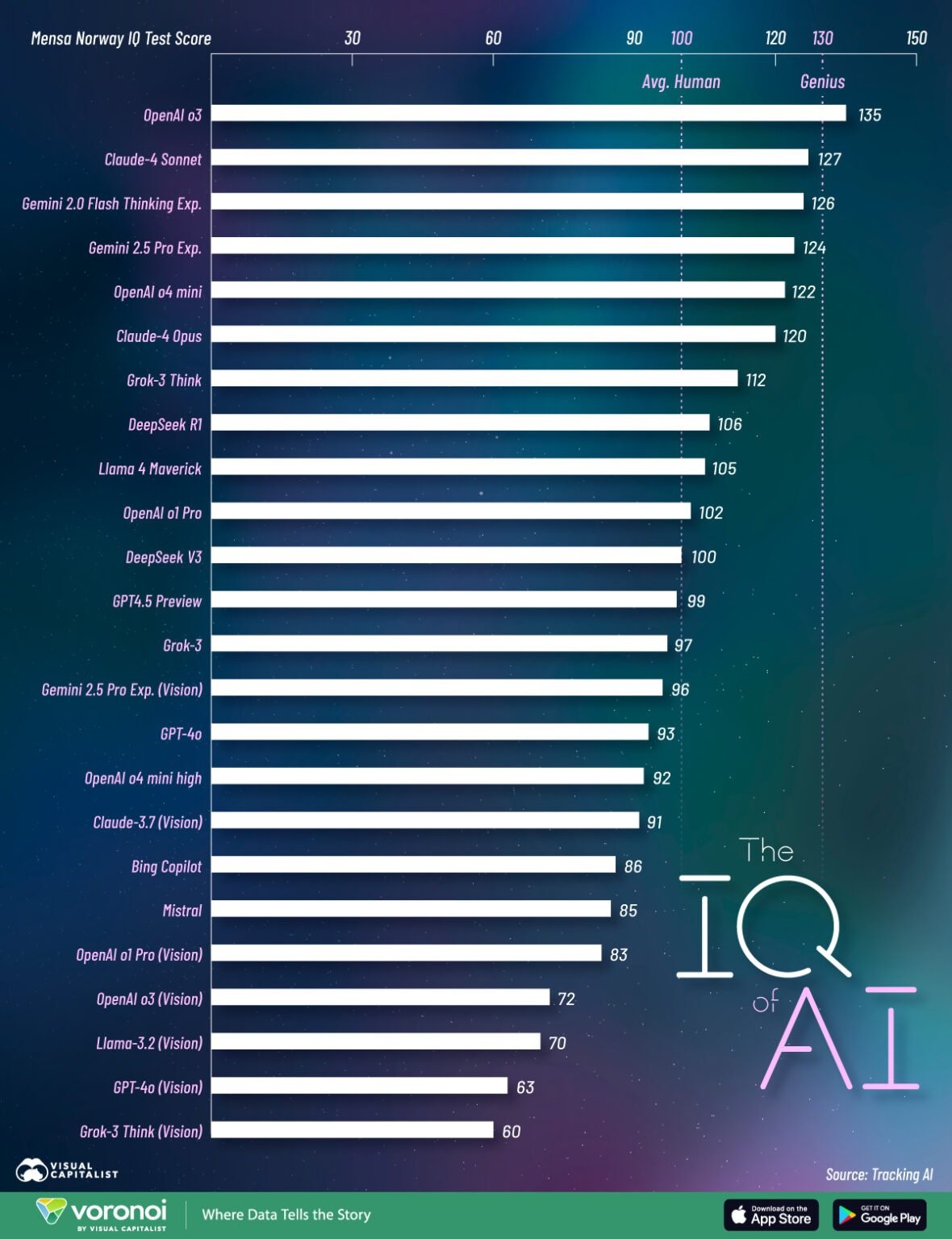

“天才”!OpenAI o3 成全球 IQ 最高的 AI 大模型

InfiSight 智睿視界,擁抱 AI 做更落地的 ToB 生意

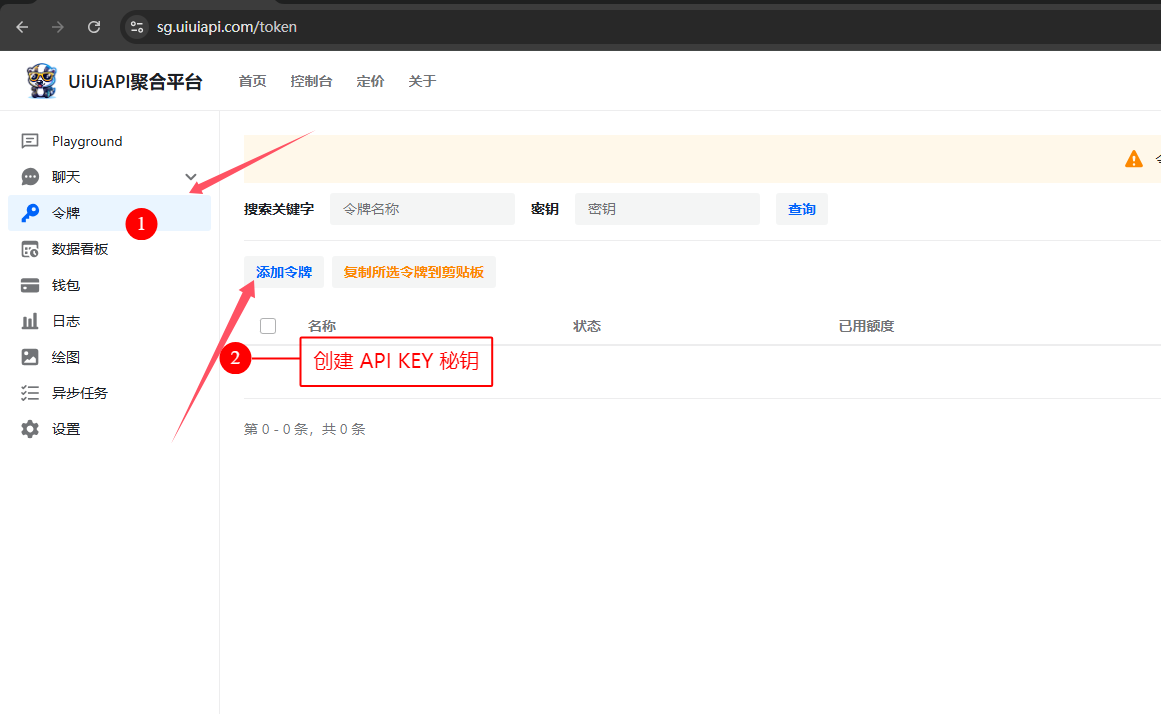

如何獲取 OpenAI API Key?API 獲取與代碼調(diào)用示例 (詳解教程)

華南理工最新AM:光電倍增驅(qū)動的雙模式有機(jī)光探測器,偏壓切換下的性能飛躍與應(yīng)用拓展

OpenAI全新GPT-4o能力炸場!速度快/成本低,能讀懂人類情緒

OpenAI全新GPT-4o能力炸場!速度快/成本低,能讀懂人類情緒

評論