你的測試集信息在訓練集中泄漏了嗎?

論文地址:https://arxiv.org/pdf/2311.04850.pdf

項目地址:https://github.com/lm-sys/llm-decontaminator#detect

原文標題:13B模型全方位碾壓GPT-4?這背后有什么貓膩

文章出處:【微信公眾號:智能感知與物聯網技術研究所】歡迎添加關注!文章轉載請注明出處。

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

物聯網

+關注

關注

2945文章

47820瀏覽量

415025

原文標題:13B模型全方位碾壓GPT-4?這背后有什么貓膩

文章出處:【微信號:tyutcsplab,微信公眾號:智能感知與物聯網技術研究所】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

熱點推薦

MAX4915A:高性能電流限制開關的全方位解析

MAX4914B/MAX4915A/B/MAX4917A/B:高性能電流限制開關的全方位解析 在電子設備的設計中,對電流的精確控制和有效保護至關重要。今天為大家帶來的MAX4914

GPT-5.1發布 OpenAI開始拼情商

OpenAI正式上線了 GPT-5.1 Instant 以及 GPT-5.1 Thinking 模型;有網友實測發現OpenAI新發布的GPT-5.1大

技術升級煥新體驗!RV1126B全方位突破

技術升級煥新體驗!RV1126B全方位突破,賦能多領域智能發展 當嵌入式AI硬件市場還在為RV1126的停產議論紛紛時,全新升級的RV1126B橫空出世,瞬間吸引了行業的目光。這款產品并非對前代產品

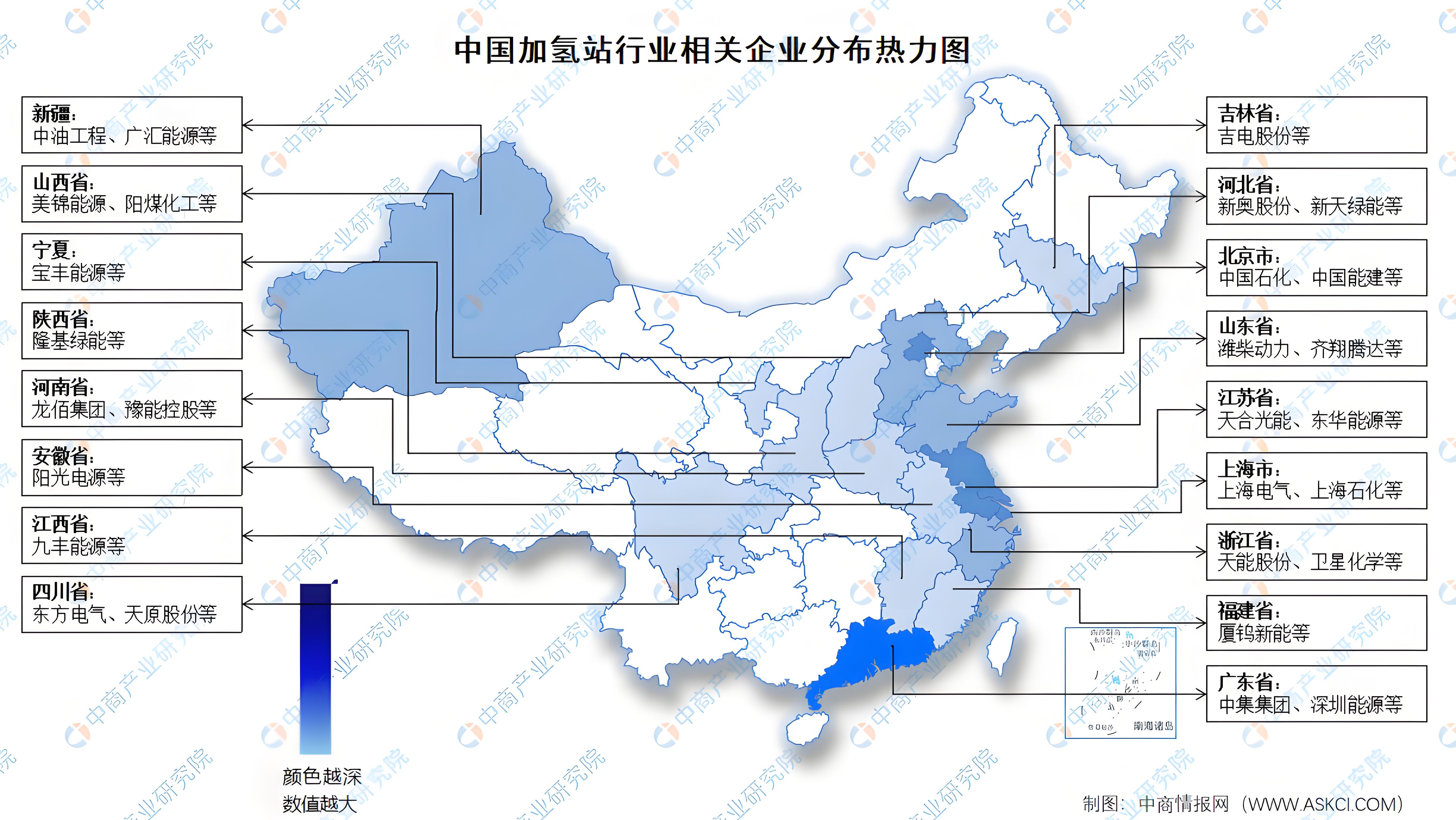

政策加碼加氫站,背后有哪些考量與機遇?

加氫站是兌現氫能源價值的出口,在整個氫能源供應體系中,加氫站是鏈接上游制備、運輸與終端應用的關鍵節點,2025 年上半年,從頂層設計到地方實踐,眾多支持氫能產業的政策紅利持續釋放,其中涉及加氫站建設、運營等方面的支持力度更勝以往,政策加碼加氫站背后有哪些考量呢?而圍繞加氫站又會有哪些產業機遇呢?

【RA4M2-SENSOR】3、使用GPT定時器-PWM輸出

GPT介紹

通用 PWM 定時器(GPT,General PWM Timer)是 RA MCU 的其中一種 32/16 位的定時器外設。 在 GPT 當中,可分為 GPT32 和

發表于 09-01 15:20

NVIDIA從云到邊緣加速OpenAI gpt-oss模型部署,實現150萬TPS推理

? 自 2016 年推出 NVIDIA DGX 以來,NVIDIA 與 OpenAI 便開始共同推動 AI 技術的邊界。此次 OpenAI gpt-oss-20b 和 gpt-oss-120b 模型

訊飛星辰MaaS平臺率先上線OpenAI最新開源模型

8月6日凌晨,OpenAI 時隔六年再次回歸開源,發布兩款全新的大語言模型:gpt-oss-120b和gpt-oss-20b,性能與o4-mini 水平相當,并且可以在消費級硬件上運行

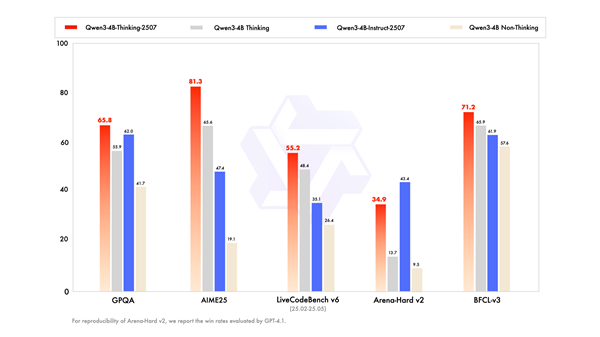

阿里通義千問發布小尺寸模型Qwen3-4B,手機也能跑

電子發燒友網綜合報道 8月7日,阿里通義千問宣布發布更小尺寸新模型——Qwen3-4B-Instruct-2507和Qwen3-4B-Thinking-2507。目前新模型已在魔搭社區

OpenAI或在周五凌晨發布GPT-5 OpenAI以低價向美國政府提供ChatGPT

外界一直在期待的OpenAI新一代大語言模型GPT-5或將發布。據外媒的報道,GPT-5很可能在周五凌晨發布。這是OpenAI在2023年的3月份推出自然語言處理模型

OpenAI發布2款開源模型

OpenAI開源了兩款高性能權重語言模型gpt-oss-120b和gpt-oss-20b,OpenAI CEO Sam Altman表示:「gpt-oss 發布了!我們做了一個開放

摩爾線程率先支持騰訊混元-A13B模型

近日,騰訊正式開源基于專家混合(MoE)架構的大語言模型混元-A13B。同日,摩爾線程團隊憑借技術前瞻性,率先完成該模型在全功能GPU的深度適配與高效支持。這一成果充分彰顯了MUSA架構在大模

具有載波聚合的 RX 分集 FEM(B26、B8、B12/13、B2/25、B4 和 B7) skyworksinc

電子發燒友網為你提供()具有載波聚合的 RX 分集 FEM(B26、B8、B12/13、B2/25、B4

發表于 06-19 18:35

13B模型全方位碾壓GPT-4?這背后有什么貓膩

13B模型全方位碾壓GPT-4?這背后有什么貓膩

評論