求解大型COMSOL模型需要多少內(nèi)存?

COMSOL是一種非常強(qiáng)大的跨學(xué)科有限元分析軟件,可以用于解決各種復(fù)雜的問題,包括流體力學(xué)、電磁學(xué)、熱傳遞、結(jié)構(gòu)力學(xué)等。但是,在處理大型模型時(shí),COMSOL需要非常大的內(nèi)存,否則模擬可能會卡死或者失敗。

需要多少內(nèi)存?

COMSOL模型的內(nèi)存需求取決于多個因素,如模型的大小、復(fù)雜程度、所選擇的求解器和網(wǎng)格大小等。一般來說,更大和更復(fù)雜的模型需要更多的內(nèi)存來運(yùn)行。

對于一個簡單的模型,使用典型的求解器和網(wǎng)格,例如2D的電磁場模擬,一般需要1-2GB的內(nèi)存就可以運(yùn)行。

但是,當(dāng)模型變得更加復(fù)雜時(shí),例如3D的熱傳遞模擬或者流體力學(xué)模擬等,內(nèi)存需求就會顯著地增加,可能需要10GB或以上的內(nèi)存。實(shí)際上,當(dāng)處理非常大的模型時(shí),內(nèi)存需求可能會達(dá)到數(shù)百GB。

如何節(jié)省內(nèi)存?

當(dāng)處理大型模型時(shí),節(jié)省內(nèi)存非常重要,否則模擬可能無法運(yùn)行。以下是一些可以幫助您節(jié)省內(nèi)存的技巧:

1. 精簡模型:如果可能的話,刪除模型中不必要的部分。這將減少求解器需要處理的區(qū)域,從而減少內(nèi)存需求。

2. 優(yōu)化網(wǎng)格:使用更優(yōu)化的網(wǎng)格可以減少內(nèi)存需求。例如,使用較少的單元或較大的網(wǎng)格單元可以顯著減少內(nèi)存需求。

3. 選擇合適的求解器:COMSOL提供了多種求解器,每種都有其優(yōu)缺點(diǎn)。選擇最適合您模型的求解器可以顯著減少內(nèi)存需求。

4. 升級硬件:當(dāng)您需要處理非常大的模型時(shí),可能需要將計(jì)算機(jī)的內(nèi)存升級到更大的容量。這將允許COMSOL更好地處理大型模型。

總結(jié)

在解決大型模型時(shí),COMSOL需要非常大的內(nèi)存。內(nèi)存需求取決于多個因素,包括模型的大小、復(fù)雜度、所選擇的求解器和網(wǎng)格大小等。為了最大限度地減少內(nèi)存需求,您可以精簡模型、優(yōu)化網(wǎng)格、選擇合適的求解器或升級計(jì)算機(jī)硬件等。這些技巧將有助于保障模型的有效運(yùn)行。

-

電磁場

+關(guān)注

關(guān)注

0文章

806瀏覽量

49420 -

COMSOL

+關(guān)注

關(guān)注

35文章

94瀏覽量

58410

發(fā)布評論請先 登錄

工作流大模型節(jié)點(diǎn)說明

RDMA設(shè)計(jì)37:RoCE v2 子系統(tǒng)模型設(shè)計(jì)

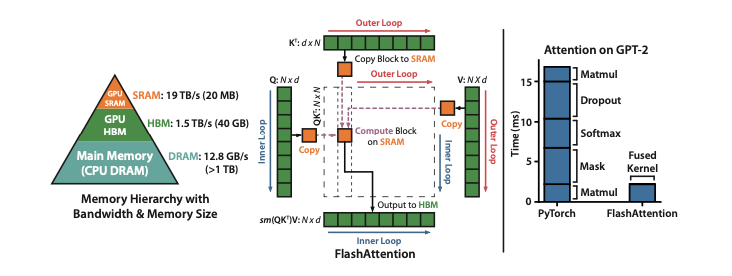

小白學(xué)大模型:大模型加速的秘密 FlashAttention 1/2/3

科普:什么AI 內(nèi)存技術(shù)

英特爾可變顯存技術(shù)讓32GB內(nèi)存筆記本流暢運(yùn)行Qwen 30B大模型

利用自壓縮實(shí)現(xiàn)大型語言模型高效縮減

CST求解器選擇指南:瞬態(tài)(T)、頻域(F)還是積分方程(I)

當(dāng)仿真計(jì)算總是不收斂,你的模型可能需要Abaqus非線性分析

FPGA使用Cordic算法求解角度正余弦值

DeepSeek 引領(lǐng)邊緣 AI 芯片向更高性能、更低功耗、更強(qiáng)泛化能力的方向演進(jìn)

小白學(xué)大模型:從零實(shí)現(xiàn) LLM語言模型

求解大型COMSOL模型需要多少內(nèi)存?

求解大型COMSOL模型需要多少內(nèi)存?

評論