【導讀】GPT-5仍在秘密訓練中!DeepMind聯合創始人在近日采訪中透露,未來3年,Inflection模型要比現在的GPT-4大1000倍。

近來,DeepMind聯合創始人Mustafa Suleyman,現Inflection AI的CEO,在采訪時投出了重磅炸彈:

OpenAI正在秘密訓練GPT-5。

我認為我們都直截了當地說會更好。這就是為什么我們披露了擁有的計算總量。

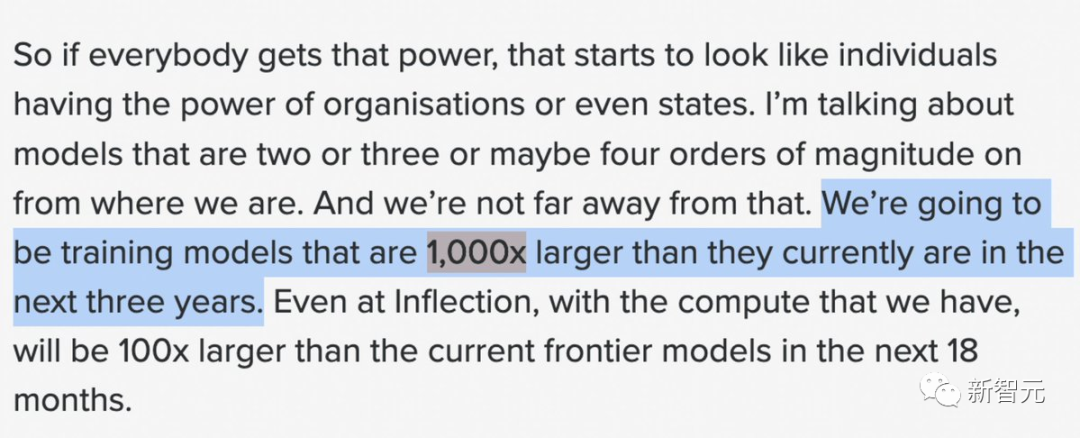

在未來18個月內,Inflection AI訓練的模型比當前的前沿模型大100倍。未來3年內,Inflection的模型比現在大1000倍。

其實,Sam Altman此前曾否認訓練GPT-5的這一說法。

對此,網友表示,OpenAI可能給它起了一個新名字,所以他們才說沒有訓練GPT-5。

這就像當時Code Interpreter推出一樣,許多人感覺其能力早已不是GPT-4模型,而應該是GPT-4.5。

另外,采訪中,Suleyman還爆出了很多自己在DeepMind和Inflection AI工作時的內部信息,包括了谷歌當時收購DeepMind和之后的抓馬,某種程度上解釋了為什么DeepMind相比于OpenAI「起了個大早,卻趕了個晚集」。

他還認為,開源模型可能會增加AI帶給人類的不穩定和危害。

而AI安全性最大的威脅來源并不是大語言模型,而是未來可能出現的自主智能體。

訪談全文

當被問到未來AI是否有可能會成為一個有自主進化能力的智能體時,Suleyman認為:

在短期之內,不太可能出現這種智能體——能夠自主運行,能夠制定自己的目標,能夠識別環境中的新信息、新的獎勵信號,并學會用它作為自我監督,并且隨著時間的推移更新自己權重的人工智能體。

但是這種自主進化能力的AI是所有人都不應該忽視的東西,因為如果某種AI技術真的展現出這種能力的,它可能會有非常大的潛在風險。

至少他知道的范圍之內,Inflection AI和DeepMind都沒有在往這個方向上走。

Inflection AI不是一家AGI公司,他們想做的事就是希望能夠做出一個非常好用的個人助理。這個助理在能夠充分訪問用戶個人信息的前提下,為用戶提供高度定制化的AI服務。

模型訓練軍備競賽會加劇AI的風險嗎?

他的公司,Inflection AI正在建造世界上最大的超級計算機之一,并且他認為在接下來的18個月內,他們可能會進行一次比制造GPT-4的語言模型訓練運行大10倍或100倍的訓練運行。

當被問到,這種軍備競賽式的訓練模型可能會增加AI的風險嗎,他回答到:

100倍的訓練仍然會產生一個聊天機器人,可以理解為一個更好的GPT-4,盡管這會成為一個更令人印象深刻的模型,但這并不危險——因為它缺乏自主性,不能改造物理世界等讓模型自身變得危險的基本要素。

僅僅生產一個非常好的、更好的 GPT-4 還不算危險;為了讓它變得危險,我們需要增加其他能力,比如前邊提到的,讓模型能夠自我迭代,自我制定目標等等。

那大約是五年、十年、十五年、二十年之后的事了。

Suleyman認為,Sam Altman最近說過他們沒有訓練 GPT-5,可能沒有說實話。(Come on. I don’t know. I think it’s better that we’re all just straight about it.)

他希望所有擁有大規模算力的公司都能盡可能的保持透明,這也是他們披露自己擁有的計算總量的原因。

他們正在訓練比GPT-4更大的模型。目前,他們有6000臺H100正在訓練模型。

到12月,22,000個H100全面投入運營。從現在開始,每個月都會增加1000到2000臺H100。

他認為谷歌DeepMind也應該做同樣的事情,應該披露Gemini接受了多少FLOPS訓練。

AI訓練成本將如何變化

從算力成本的角度來看,未來AI訓練的規模不可能達到訓練某個模型需要100億美元的成本,除非真的有人會花3年時間去訓練一個模型,因為堆疊越多算力去訓練一個越大的模型,需要的時間也會更長。

雖然花的成本越高,可能能帶來更強的能力,但是這不是一個沒有上限的數學問題,需要考慮很多實際情況的限制。

但是因為算力成本隨著芯片算力的迭代在不斷下降,所以未來可能會出現訓練某個模型的成本相當于在2022年花費了100億美元來訓練。

但是因為芯片算力會以2-3倍的效率增長,所以到時候訓練一個這樣規模的成本會遠遠小于現在看起來的成本。

比如說,現在開源社區中的Llama2或者Falcon等模型,只有15億參數或20億參數,就獲得了有1750億參數的GPT-3的參數的能力。

開源的看法

作為一直在閉源科技公司工作的Suleyman,對于開源模型的價值和可能的風險,有非常與眾不同的觀點。

首先,他認為,在未來5年這個時間維度之內,開源模型始終會落后最前沿的閉源模型3-5年的時間

而且,開源模型會增加AI帶來的社會風險。

如果所有人都能無限制地訪問最新的模型,將會出現一個現象——「力量的快速擴散」。

舉個栗子,就像新媒體平臺讓每個人都可以作為一份完整的報紙發揮作用,擁有數百萬粉絲,甚至能影響全世界。

對于最前沿模型的無限制訪問將會擴大這種力量,因為在未來3年內,人類能夠訓練出比現有模型規模大上1000倍的模型。

即便是Inflection AI,也能在未來18個月內獲得比現在最前沿的模型大100倍的計算能力。

而開源的大模型會將這種力量交到每個人的手中,相當于給了每個人一個潛在的大規模不穩定破壞性的工具。

而到時候,再想辦法避免這些工具可能產生的破壞性后果,有人做了一個很巧妙的比喻——圖試圖通過用手接住雨水來讓雨停下來。

他曾經向監管部門解釋過,AI技術未來會降低很多潛在危險化合物或者武器的開發門檻。

AI能在實際制作這些東西時提供大量的幫助——比如告知在實驗室中遇到技術挑戰時從哪里獲取工具等等。不過確實,從預訓練中刪除這些內容,對模型進行對齊等等辦法,可以有效地降低這樣的風險。

總之,對于用大模型能力來做壞事的人,需要盡量讓他們在做這些事的時候變得困難。

但是如果盡可能的開源一切模型,未來面對能力越來越強的模型,將會把更多的類似風險暴露出來。

所以雖然開源模型對于很多人來說確實是一件好事,能夠讓所有人都獲得模型并且進行各種各樣的嘗試,帶來技術上的創新和改進,但是也一定要看到開源的風險,因為并不是每個人都是善意和友好的。

雖然我說這樣的話可能會被很多人理解為我做的事和開源社區存在利益沖突,因此很多人可能會很生氣,但是我還是要表達我的觀點。

他還強調了,他不是為了攻擊開源社區才說出這番言論的:

「雖然我說這樣的話可能會被很多人理解為我做的事和開源社區存在利益沖突,因此很多人可能會很生氣,但是我還是要表達我的觀點,也希望獲得人們的支持。」

在谷歌和DeepMind期間的抓馬

在DeepMind度過的10年里,他花了大量時間試圖將更多的外部監督融入到構建AI技術的過程中。

這是一個相當痛苦的過程。雖然他認為谷歌的出發點是好地,但它運作的方式仍然像傳統的官僚機構一樣。

當我們設立了谷歌的倫理委員會時,計劃有九名獨立成員,是對于開發敏感技術過程中進行外部監督的重要措施。

但因為任命了一個保守派人士,而她過去曾發表過一些有爭議的言論,很多網友就在推特等場合抵制她,同時也抵制其他支持她的幾個成員,要求他們退出委員會。

這是一場徹底的悲劇,非常令人沮喪。我們花了兩年時間來建立這個委員會,這是朝著對我們正在開發的非常敏感的技術進行外部審查的第一步。

不幸的是,在一周內,九名成員中的三名辭職了,最終她也辭職了,然后我們失去了半數委員會成員。

然后公司轉身說:「我們為什么要招人來限制自己?這純粹是浪費時間。」

其實,當DeepMind被收購時,我們提出了收購的條件,即我們要有一個倫理和安全委員會。

我們計劃在倫理和安全委員會之后,我們要將DeepMind打造成一個全球利益公司:一個所有利益相關者在做決策時都能發聲的公司。

它是一個按擔保有限責任公司設立的公司。然后,我們計劃制定一個憲章,為AGI的開發制定相關的倫理安全的目標;這樣使得我們可以將收入的大部分用于科學和社會使命。

這是一個非常有創意和實驗性的結構。但是當Alphabet看到設立倫理委員會發生的事情時,他們變得膽怯了。他們說:「這完全瘋了。你們的全球利益公司也會發生同樣的事情。為什么要那樣做?」

最終,我們將DeepMind合并進入到了谷歌,從某種程度上說,DeepMind從未獨立過——現在當然也完全從屬于谷歌。

谷歌下一代大模型Gemini

The Information獨家報道稱,谷歌多模態人工智能模型Gemini即將面世,直接對標OpenAI的GPT-4。

其實,在今年谷歌I/O大會上,劈柴已經向大眾宣布,谷歌正在研發下一代模型Gemini。

有傳言說,該模型將至少有1萬億參數,訓練將使用數以萬計的谷歌TPU AI芯片。

與OpenAI類似,谷歌使用GPT-4的方法來構建模型,由多個具有特定能力的人工智能專家模型組成。

簡言之,Gemini同樣是一個混合專家模型(MoE)。

這也可能意味著,谷歌希望提供不同參數規模的Gemini,因為從成本效益上考慮是個不錯的選擇。

除了生成圖像和文本外,Gemini接受過YouTube視頻轉錄數據的訓練,也可以生成簡單的視頻,類似于RunwayML Gen-2。

另外,比起Bard,Gemini在編碼能力方面也得到了顯著提升。

Gemini推出之后,谷歌也計劃逐步將其整合到自家產品線中,包括升級Bard,谷歌辦公全家桶、谷歌云等等。

其實,在Gemini之前,DeepMind還有一個代號為「Goodall」的模型,基于未宣布的模型Chipmunk打造,可與ChatGPT匹敵。

不過GPT-4誕生后,谷歌最后決放棄這一模型研發。

據稱,至少有20多位高管參與了Gemini的研發,DeepMind的創始人Demis Hassabis領導,谷歌創始人Sergey Brin參與研發。

還有谷歌DeepMind組成的數百名員工,其中包括前谷歌大腦主管Jeff Dean等等。

Demis Hassabis在此前接受采訪表示,Gemini將結合AlphaGo類型系統的一些優勢和大型模型驚人的語言能力。

可以看到,谷歌已經在全力備戰,就等著Gemini開啟逆襲之路。

-

語言模型

+關注

關注

0文章

571瀏覽量

11314 -

GPT

+關注

關注

0文章

368瀏覽量

16873 -

DeepMind

+關注

關注

0文章

131瀏覽量

12290

原文標題:GPT-5正秘密訓練!DeepMind聯創爆料,這模型比GPT-4大100倍

文章出處:【微信號:CVer,微信公眾號:CVer】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

GPT-5震撼發布:AI領域的重大飛躍

正面對決GPT-5和Germini-3,DeepSeek-V3.2震撼發布

GPT-5.1發布 OpenAI開始拼情商

商湯日日新V6.5多模態大模型登頂全球權威榜單

【RA4E2開發板評測】PWM 驅動舵機

【RA4M2-SENSOR】3、使用GPT定時器-PWM輸出

【RA-Eco-RA6M4開發板評測】PWM 驅動舵機

NVIDIA從云到邊緣加速OpenAI gpt-oss模型部署,實現150萬TPS推理

微軟企業級應用AI能力全面升級

OpenAI或在周五凌晨發布GPT-5 OpenAI以低價向美國政府提供ChatGPT

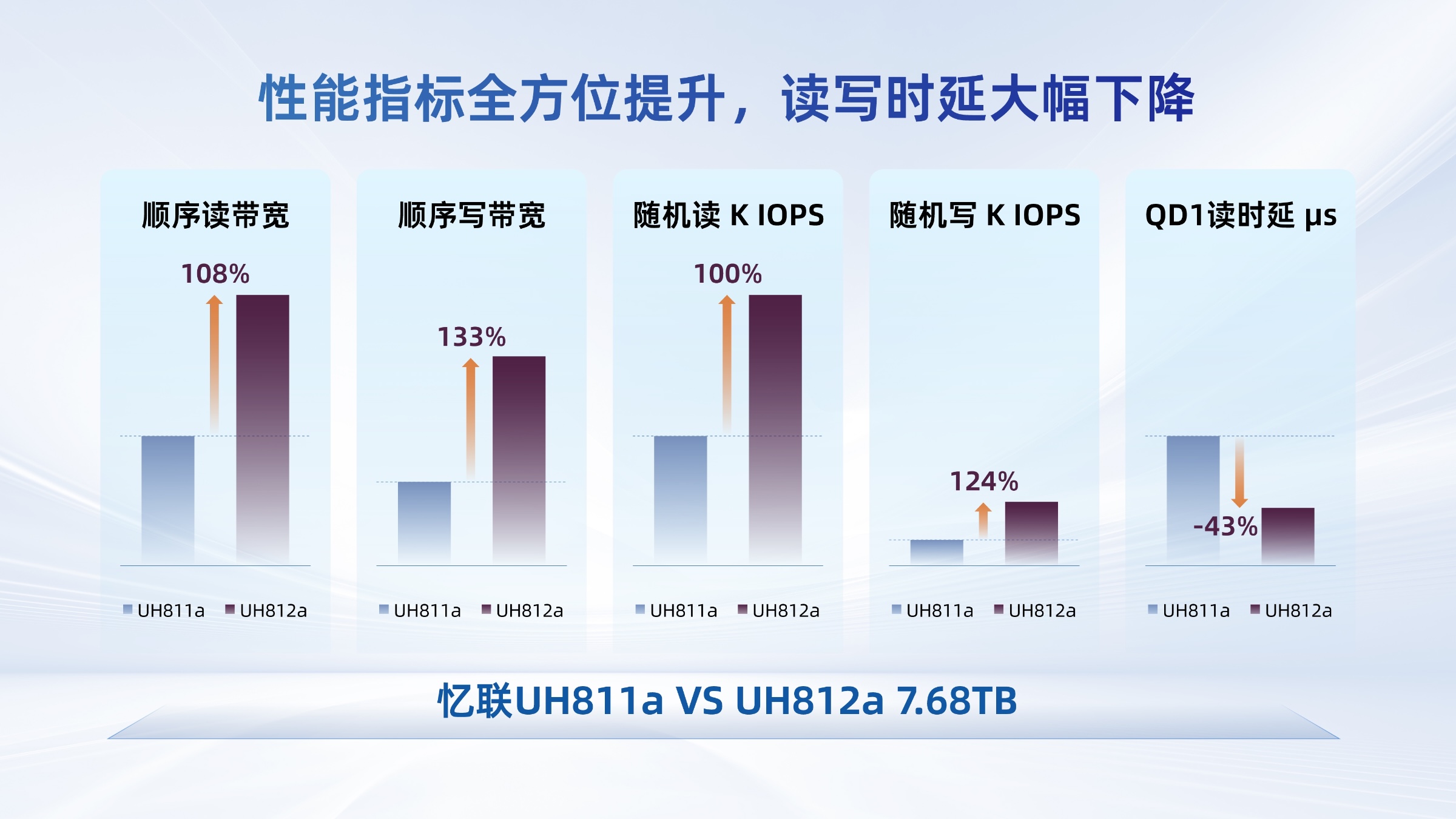

憶聯PCIe 5.0 SSD支撐大模型全流程訓練

GPT-5正秘密訓練!DeepMind聯創爆料,這模型比GPT-4大100倍

GPT-5正秘密訓練!DeepMind聯創爆料,這模型比GPT-4大100倍

評論