近日,在OpenAI發布GPT-5模型14天后,深度求索的新模型版本DeepSeek-V3.1正式發布。

深度求索正式發布DeepSeek-V3.1后,稱其為“邁向Agent時代的第一步”。 DeepSeek-V3.1具有更智能的工具調用能力,可以支持多種Code Agent框架,開發者可以自己搭建智能體。

2025年開啟了AI Agent新紀元。各大模型公司紛紛在AI Agent戰場發力: 今年7月,月之暗面發布的Kimi K2邁出了智能體化的一步,可幫助用戶直接制定旅行計劃并預訂機票和酒店;智譜AI在7月28日發布的GLM-4.5系列,也定位為 "Agent原生基礎模型",并于8月20日發布了全球首個手機Agent AutoGLM2.0,可幫助用戶Agent代理操作,具備推理、代碼與多模態的全能能力,例如可一鍵訂票、訂咖啡等。

從行業應用角度,AI Agent在電商、醫療和安全等多個領域已經有深度落地案例;在企業內部,AI Agent能夠促進研發、營銷、銷售和客戶服務等多部門和工種的效率提升。根據Grand View Reasearch數據,全球AI Agent市場于2023年規模已達38.6億美元,預計從2024~2030年將以CAGR 45.1%快速增長,2030年市場規模有望突破503億美元。

根據Open AI和Deepseek等廠商的大模型版本推出節奏,未來國產大模型的競爭或將圍繞AI Agent等場景落地而展開。

AI Agent:基于大模型的人工智能代理

在AI演進的道路上,目前正處于向Agents進化的階段。

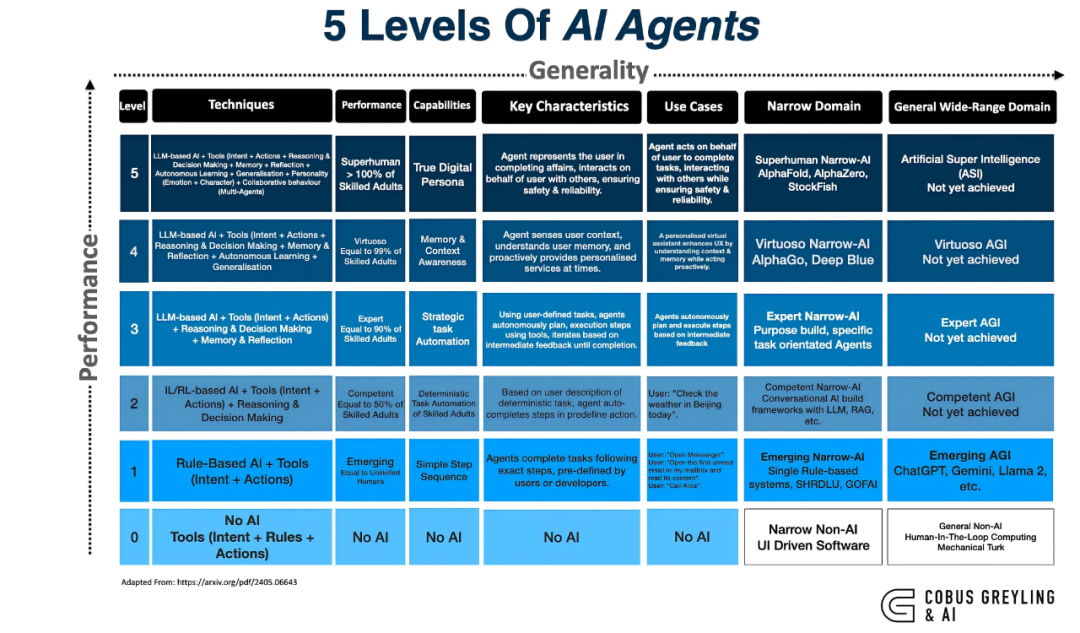

2024年OpenAI開發者日(Dev Day)上, Sam Altman提出了一個關于通用人工智能(AGI)的五層框架理論,將AGI的發展分為五個階段,逐一代表更高級的能力水平,分別為:

L1聊天機器人(Chatbots),具有對話能力的AI;

L2推理者(Reasoners),能夠在人類層面解決問題的AI;

L3智能體(Agents),能思考并可以采取行動的AI系統;

L4創新者 (Innovators),能夠協助發明創造的AI;

L5組織者(Organizations),可以完成組織工作的AI。

目前,AI正從L2(推理者)向L3(智能體) 發展,根據Open AI前研究員預測,五級AGI最快將在27年實現。

(圖源:Kore.ai, COBUS GREYLING)

AI Agent在當下有著非常廣闊的市場空間,并在全球范圍內高速增長,重塑了各行業的運營模式和客戶交互體驗。

與遵循基本“請求和響應”框架的傳統生成式AI不同,AI Agent是智能體,能感知環境、決策并行動,而非單純響應刺激。大模型依賴用戶prompt的清晰度,而AI Agent能獨立思考、調用工具完成任務,還能編排資源,與其他Agents協作,并使用各種工具,如LLM、RAG、向量數據庫、API以及Python等高級編程語言。

從傳統AI,進一步到AI Agent,再到系統化的Agentic AI,這是一場范式轉移,核心是自主性(Autonomy) 和通用性(Generality) 的階梯式提升,也佐證了我們在通往AGI的路上始終在不斷深挖探索。但這樣的演進路線絕非單一技術的線性發展,而需要架構、算法、硬件和應用場景的協同進化。

AI Agent的技術特性

驅動Scale Up需求升級

隨著AI的飛速發展,DeepSeek等開源模型不斷涌現,大大降低了技術應用門檻,也推動了“AI平權”進程。但與之同時,大模型參數量已突破萬億級別,這一規模的急劇擴張帶來了前所未有的算力挑戰。

大模型向更大規模和更長上下文演進的發展趨勢,導致推理時KV Cache需求急劇增長,已遠超當前單顆AI芯片乃至主流多卡服務器的承載極限。

同時,Agentic AI具備自主決策、連續任務執行、多模態交互等核心能力,多Agent系統的推理過程需要生成比傳統模型多100倍的Token。此外,AI Agent中的大模型輸出往往是下一步的輸入,要求推理速度越快越好,當前主流大模型API普遍擁有50-100 Tokens/s的推理速度,這對顯存帶寬提出了更高的要求。

面對單點算力、顯存的天花板,構建大規模Scale Up系統,通過并行計算技術(如專家并行EP、張量并行TP)將模型權重與KV Cache拆分到多個AI芯片上協同工作,已成為支持萬億參數模型推理挑戰的關鍵路徑。

此外,AI Agent的自主決策、多輪交互、環境感知等核心能力發展,也隨之對目前的算力架構提出新挑戰:

1實時決策鏈式依賴

Agent的“感知-規劃-執行”閉環需毫秒級響應,但長任務序列導致KV Cache指數級增長(如100輪對話的Cache達GB級),遠超單卡顯存容量。Scale Up通過超節點構建統一顯存池承載大規模狀態數據。

2記憶與狀態同步需求

Agent的長期記憶(LTM)需跨會話持久化,而工作記憶(WM)需在邊-云間同步。Scale Up架構的內存語義互聯(如華為UB總線延遲200ns)比傳統TCP/IP(ms級)更適合高頻狀態更新。

3多智能體協作瓶頸

多Agent協作(如游戲NPC集群)需實時交換策略參數。NVLink 5.0的超節點內1.8TB/s帶寬支持千級Agent參數同步,而傳統Scale Out易因網絡抖動導致策略失準。

可以說,AI Agent,尤其是多智能體系統Agentic AI的持續運行和復雜推理,對底層算力基礎設施(如集群的性能、網絡互聯、大容量低延遲存儲)提出了極高要求。算力成本和能源消耗依然是規模化部署需考慮的因素,推動著芯片架構、模型壓縮和推理優化等技術的創新。

AI Agent正在扛起云端協同大旗

云邊端協同重構互聯范式

AI Agent不僅將在云端基礎大模型中扮演重要角色,也是AI端側落地的重要一環。

2024年12月,智譜的GLM-4V模型和騰訊的混元大模型均與高通展開深度合作,基于芯片優化的角度將端側多模態交互能力和終端側部署能力進行提升。不難發現,一些硬件廠商紛紛集體加入大模型賽道,探索AI Agent能賦予用戶的更多可能。

預計端側應用在未來很長一段時間都將是端側+云端搭配使用,考慮到AI Agent需要規劃+多次調用大模型,端側AI還會帶來大量的云端推理算力增量從而推動云端推理集群的建設。

這一趨勢對數據通路提出了前所未有的苛刻要求:極高的吞吐以應對海量交互數據,極低的延時以確保Agent決策鏈路的實時性與流暢性。因此,現有高性能、低延時組網方案的選型與優化,不再僅是基礎設施的配套,而已成為決定AI Agent體驗成敗與規模化可行性的核心瓶頸。

對于AI發展和目前AI Agent應用的熱潮,國內外各家廠商也針對性地端出了不同的高性能低時延組網方案。

在超節點組網技術的演進中,無論是致力于單節點內超高密度集成的架構方案,還是依托光互連技術以實現能效優化與延遲收斂的組網策略;無論是采用專用硬件與私有協議構建閉環生態,還是積極融入開放標準并引入光互連等新興技術——盡管在具體實現路徑上存在差異,但其演進脈絡均清晰指向同一方向:超節點組網技術正朝著高性能、低延遲、可擴展的目標加速迭代與發展。

英偉達:DGX SuperPOD - GB200

NVL72(NVLink+ RDMA)

作為Nvidia DGX SuperPOD的代表案例,GB200 NVL72 SuperNode將36個 Grace CPU和72個Blackwell GPU集成到一個液冷機柜中,采用“GPU-GPU NVLink ScaleUp + Node-Node RDMA ScaleOut”的互聯方式。

其中Scale Up網絡方面,NVL72內部采用NVLink 5和NVSwitch構建,提供極高的帶寬(每個Compute Tray含2個GB200,通過NVLink/NVSwitch具備7.2TB/s的Scale Up連接帶寬,整機柜Compute Tray提供帶寬高達129.6TB/s)和超低時延(銅電纜連接節省了光模塊引入的時延)。NVL72整機柜具有超大內存空間,支持高達13.5TB的HBM和17TB的LPDDR5X內存容量。NVL72利用NVLink和NVLink C2C,所有GPU都可以訪問整個超節點其他GPU的HBM和Grace CPU的DDR,實現基于內存語義的統一內存空間。

未來,英偉達的Rubin架構將升級到NVLink 6.0和7.0,進一步提升帶寬密度、降低延遲,并優化互連拓撲的靈活性。

Google:基于私有ICI協議 3D Torus拓撲

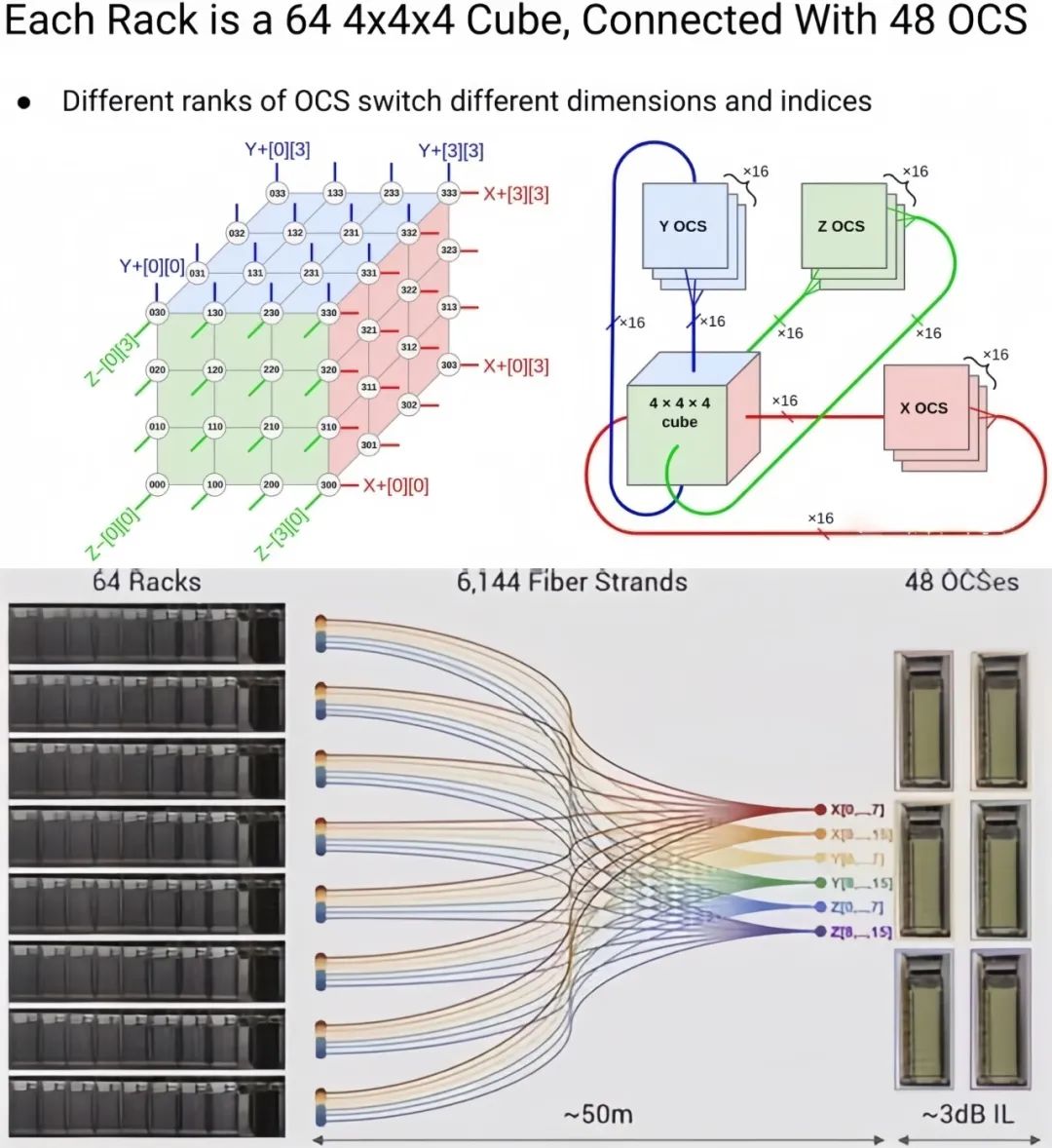

Google的Scale UP組網采用私有ICI協議,機柜內部采用DAC,機柜之間運用OCS光交換技術。ICI協議被設計為可編程的,以便軟件能夠應對具有可重構性和彈性的運行復雜性。

以Google TPU v4 pod為例,一個TPU v4 pod就是一個ICI域,在該域中,任意一對TPU都能相互進行RDMA。TPU v4的拓撲結構為一個3D Torus環面,由4×4×4的TPU v4芯片互連而成,形成類似立方體的結構。一個機架中容納64顆TPU v4芯片及16臺CPU主機,機柜內的兩個TPU v4托盤通過DAC連接。隨后,用OCS光交換機將64個這樣的立方體結構連接起來,組成一個包含4096個TPU的V4超級計算機。

(圖源:Google)

谷歌已將超100,000個TPU v6 Trillium連接到一個網絡結構中,構建了世界上最強大的AI超級計算機之一。該系統將超過100,000個TPU v6 Trillium與每秒13 PB帶寬的Jupiter網絡結構相結合,使單個分布式訓練作業能夠擴展到數十萬個加速器上。這種大規模芯片集群可以提供強大的計算能力,實現高效的并行計算,從而加速大模型的訓練過程,提高AI系統的性能和效率。目前Google最新的第七代TPU Ironwood已于今年4月正式推出,這是為支持新一代人工智能模型的需求,Google專門為推理(inference)任務設計的TPU。(更多閱讀:Kiwi Talks | 軟硬協同,全棧制勝——谷歌如何成為AI領先綜合玩家)

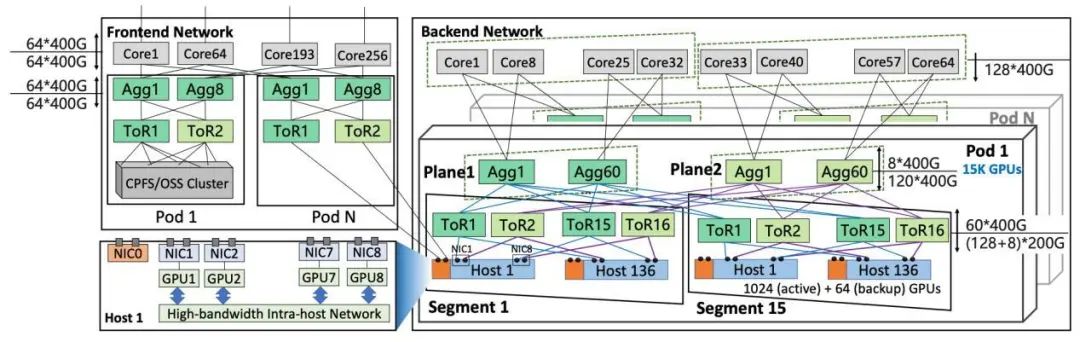

阿里云:HPN7.0 新型智算網絡

阿里云HPN7.0面向AI大模型訓練場景設計,通過創新的拓撲設計、多路徑冗余和自研通信技術,解決萬卡級GPU集群的高性能、高穩定性及可擴展性挑戰。

架構方面,HPN7.0采用“雙上聯+多軌+雙平面”設計,以確保網絡在超高負載下仍保持高效、穩定運行,滿足AI大模型對計算資源的高需求。技術方面,HPN7.0采用基于RDMA的Solar-RDMA協議,能夠實現數據的快速傳輸和高效處理,提供高精度擁塞控制算法,結合網絡負載的動態感知,能夠實現對數據流級別的精細控制;使用專門面向AI計算場景設計的ACCL通信庫,能顯著提升計算的效率和穩定性,為大模型提供穩定可靠的網絡通信支持。

(圖源:阿里云)

阿里云HPN7.0高性能網絡集群于2023年9月大規模部署,通義千問2.5版本基于該集群訓練而成。目前阿里云已推出了采用全自研軟硬件系統的下一代訓推一體網絡融合架構HPN8.0。

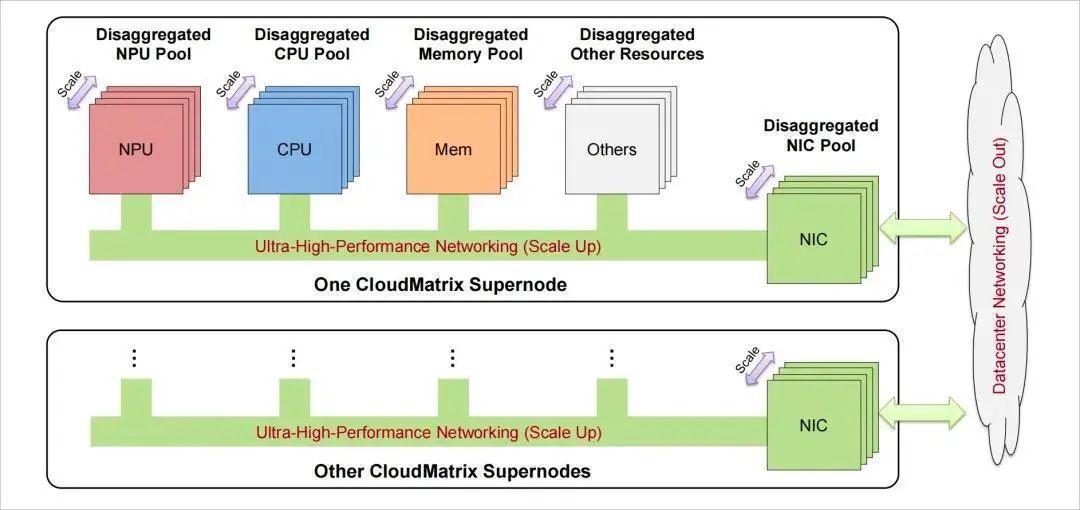

華為:Cloud Matrix 384系統

華為Cloud Matrix 384系統創新性地提出了對等計算架構,將總線從服務器內部擴展到整機柜甚至跨機柜。該系統將總計384顆昇騰910C芯片分布在16個機架上,其中12個計算機架各部署32顆昇騰910C,通過全連接拓撲結構互聯,另外4個機架用于安裝Scale up交換機。Cloud Matrix 384通過超高速低延遲的統一總線(UB)網絡實現互連,能夠對計算、內存和網絡資源進行動態池化與統一訪問。

為了構建超大規模算力集群,華為采用跨多機架的Scale Up方案,因而選擇光互連方式來實現橫向擴展。每個Cloud Matrix 384 Pod共配置6912個400G光模塊/收發器,其中5,376個用于Scale Up網絡,1,536個用于Scale Out網絡。Cloud Matrix 384的Scale Up帶寬高達269TB/s,因物理距離限制,采用400G低功耗光模塊(LPO),省略了傳統DSP芯片以降低功耗和時延。

(圖源:華為)

從以上國內外廠家不同的組網方式可以看到,AI Agent是“大腦”,決定了任務的復雜度;端云算力是“肌肉”,負責執行任務;而高性能網絡則是“神經系統”,負責在“大腦”和“肌肉”之間進行高速、精準的信號傳導。不同廠家針對自身的產品組合以及技術優勢,對自身的Scale Up超節點系統做出了高性能定制化的設計。

奇異摩爾構筑了基于高性能RDMA、網絡控制和芯粒的全棧互聯產品解決方案。Scale Out側的高性能AI原生超級網卡Kiwi SNIC,實現超高RDMA性能、復雜網絡控制;Scale Up側的Kiwi G2G IOD互聯芯粒方案,是國內少有的開源&通用化超節點互聯方案,支持內存語義/消息語義,實現G2G芯粒和xPU間互聯互通。

展望未來,AI Agent的演進正在倒逼網絡技術朝“確定性地高性能”方向演進,基于高速通信、超大帶寬、RDMA無損網絡等強勁性能指標不再是針對超大規模企業的可選奢侈方案,而是蛻變為通用AI的基座級剛需。

云側模型憑借其高算力密度持續保持領先,而端側AI則憑借獨立性與即時性形成了差異化的競爭優勢。展望下一階段,云端協同模型將通過高質量數據訓練飛輪與隱私計算框架的深度融合,推動用戶體驗邁向新的高峰。然而在當下,AI Agent的落地應用仍高度依賴于國內外AI網絡產業全棧——包括云廠商、運營商、AI芯片、交換機及服務器等企業——在Scale Up方向上持續突破極限、不斷加壓發力。

關于我們

AI網絡全棧式互聯架構產品及解決方案提供商

奇異摩爾,成立于2021年初,是一家行業領先的AI網絡全棧式互聯產品及解決方案提供商。公司依托于先進的高性能RDMA 和Chiplet技術,創新性地構建了統一互聯架構——Kiwi Fabric,專為超大規模AI計算平臺量身打造,以滿足其對高性能互聯的嚴苛需求。我們的產品線豐富而全面,涵蓋了面向不同層次互聯需求的關鍵產品,如面向北向Scale-out網絡的AI原生超級網卡、面向南向Scale-up網絡的GPU片間互聯芯粒、以及面向芯片內算力擴展的2.5D/3D IO Die和UCIe Die2Die IP等。這些產品共同構成了全鏈路互聯解決方案,為AI計算提供了堅實的支撐。

-

AI

+關注

關注

91文章

40702瀏覽量

302350 -

Agent

+關注

關注

0文章

213瀏覽量

29111 -

大模型

+關注

關注

2文章

3724瀏覽量

5256 -

DeepSeek

+關注

關注

2文章

837瀏覽量

3372

原文標題:KiwiTalks | AI Agent驅動云邊端協同重構互聯范式

文章出處:【微信號:奇異摩爾,微信公眾號:奇異摩爾】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

AI Agent如何重構互聯范式

AI Agent如何重構互聯范式

評論