Microsoft 的目標是,通過結(jié)合使用 Azure 與 NVIDIA GPU 和 Triton 推理軟件,率先將一系列強大的 AI Transformer 模型投入生產(chǎn)用途。

如果您的軟件能喚起人們喜悅的淚水,您就是在傳播歡樂。

Translator 是一項 Microsoft Azure 認知服務(wù),通過應(yīng)用一些規(guī)模龐大的 AI 模型來幫助更多人進行交流。

“有太多精彩的故事可以講了!” Translator 開發(fā)經(jīng)理 Vishal Chowdhary 表示。

比如,在 2010 年海地遭受 7.0 級地震后,在短短 5 天的沖刺期里為相關(guān)應(yīng)用緊急添加海地克里奧爾語支持,進而為救援人員提供幫助。再比如,祖父母在使用這款軟件,與講著他們不懂的語言的遠方孫輩進行第一次實時交流時,感動到哽咽。

雄心勃勃的目標

“我們的愿景是,讓成千上萬的開發(fā)者都已經(jīng)在使用的這個 API,能打破不同語言、不同模式之間的阻礙。” Chowdhary 說。

考量全球現(xiàn)行的語言大約有 7000 種,這真的是個雄心勃勃的目標。

因此,團隊采用了一種強大而復(fù)雜的工具,即是混合專家系統(tǒng)(MoE)AI 方法。

在推動自然語言處理快速發(fā)展進步的 Transformer 模型中,這是非常先進的一種。它具有 50 億個參數(shù),其規(guī)模比團隊在生產(chǎn)過程中用于自然語言處理的最大模型大了 80 倍。

MoE 模型涉及到龐大的計算量,很難找到能將其投入生產(chǎn)環(huán)境中使用的用戶。在初始測試中,基于 CPU 的服務(wù)器無法滿足團隊要在一秒鐘內(nèi)完成翻譯一個文檔的要求。

27 倍的提速

隨后,該團隊使用 NVIDIA Triton 推理服務(wù)器(本周 GTC 大會上宣布的 NVIDIA AI Enterprise 2.0 平臺的其中一部分)在加速系統(tǒng)上進行了測試。

Chowdhary 說:“借助 NVIDIA GPU 和 Triton,我們得以實現(xiàn)這一目標,且非常高效。”

事實上,相較于未經(jīng)優(yōu)化的 GPU 運行時,該團隊實現(xiàn)了高達 27 倍的提速。

“這讓我們可以構(gòu)建一個模型來執(zhí)行不同的語言理解任務(wù),例如匯總、生成文本和翻譯等,而不必為每個任務(wù)開發(fā)單獨的模型。” 負責(zé)監(jiān)督測試的 Microsoft 首席研究員 Hanny Hassan Awadalla 表示。

Triton 如何提供幫助

Microsoft 的模型能將大型任務(wù)(如翻譯多個文檔)拆分為許多個小任務(wù),在每個小任務(wù)中翻譯幾百個句子。Triton 的動態(tài)批處理功能將諸多此類請求整合起來,從而充分利用 GPU 的強大功能。

對于 Triton 使用 CPU、GPU 或其他加速器在各種模式下運行各種模型的能力,讓該團隊贊不絕口。

Chowdhary 的團隊十多年來一直在開發(fā)大規(guī)模分布式系統(tǒng)。Chowdhary 表示:“這種解決方案周到地考慮了我的工作場景,提供了我想要的各種功能,就像是我給自己親手定制的解決方案一樣。

在幕后,有兩個軟件組件是 Triton 取得成功的關(guān)鍵。一個是 NVIDIA 擴展型 FasterTransformer,這是一個處理推理計算的軟件層,可支持 MoE 模型。另一個是 CUTLASS,這是一個 NVIDIA 數(shù)學(xué)庫,有助于高效實現(xiàn)模型。

在四周內(nèi)提供已驗證的原型

盡管測試十分復(fù)雜,但該團隊通過與 NVIDIA 工程師合作并運用 Triton 的強大力量,在不到一個月的時間內(nèi)就獲得了可投入正常運轉(zhuǎn)的端到端原型。

“在如此之短的時間內(nèi)制作出一款達到可發(fā)布程度的產(chǎn)品,這樣的效率實在令人印象深刻,對此我真的非常感激。” Awadalla 這樣說道。

雖然這是該團隊第一次使用 Triton,但 “我們使用它來發(fā)布 MoE 模型,不用花費太多力氣就重新構(gòu)建了運行時環(huán)境,現(xiàn)在我衷心希望在我們的長期托管系統(tǒng)中納入這款解決方案。” Chowdhary 補充表示。

采取后續(xù)措施

加速后的服務(wù)將采用審慎的步驟實施,初期會用于少數(shù)幾種主要語言的文檔翻譯。

Chowdhary 表示:“我們的最終目標是,讓客戶能在所有場景中通過透明的方式獲享這些新模型的優(yōu)點。”

這項工作是 Microsoft 的一項涉獵更廣泛的計劃的一部分。其目的是推動 Office 和 Teams 等眾多產(chǎn)品的進步,幫助各類開發(fā)者與客戶(從專注于打造一款應(yīng)用的小型公司到財富 500 強企業(yè))取得發(fā)展。

為了給這一計劃鋪平道路,Awadalla 的團隊于去年 9 月發(fā)表了一項研究成果,介紹如何在 NVIDIA A100 Tensor Core GPU 上訓(xùn)練具有多達 2 千億個參數(shù)的 MoE 模型。自那之后,該團隊還在具有超過 3 千億個參數(shù)的模型上使用 80G 版本的 A100 GPU,將性能提升了 8 倍。

Adawalla 表示:“為了更好地表示更多的語言,尤其是我們手頭沒有太多數(shù)據(jù)的語言,模型必定會越來越大。”

原文標題:GTC22 | 促進人際交流:微軟使用 NVIDIA Triton 改善 Translator 翻譯工具的 AI 質(zhì)量和效率

文章出處:【微信公眾號:NVIDIA英偉達】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

審核編輯:湯梓紅

-

NVIDIA

+關(guān)注

關(guān)注

14文章

5592瀏覽量

109721 -

gpu

+關(guān)注

關(guān)注

28文章

5194瀏覽量

135432 -

AI

+關(guān)注

關(guān)注

91文章

39756瀏覽量

301366 -

Microsoft

+關(guān)注

關(guān)注

0文章

237瀏覽量

7961

原文標題:GTC22 | 促進人際交流:微軟使用 NVIDIA Triton 改善 Translator 翻譯工具的 AI 質(zhì)量和效率

文章出處:【微信號:NVIDIA_China,微信公眾號:NVIDIA英偉達】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

Transformer 入門:從零理解 AI 大模型的核心原理

NVIDIA推動面向數(shù)字與物理AI的開源模型發(fā)展

NVIDIA擴大與微軟合作推動AI超級工廠建設(shè)

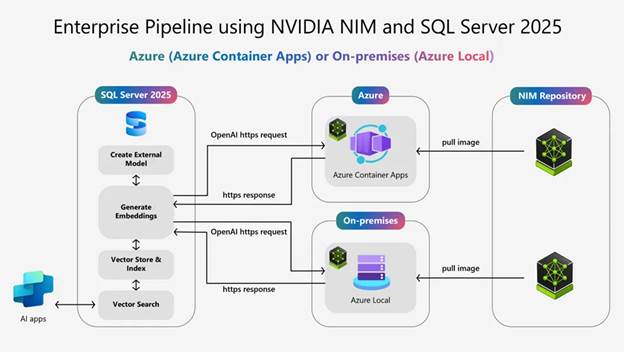

使用NVIDIA Nemotron RAG和Microsoft SQL Server 2025構(gòu)建高性能AI應(yīng)用

利用NVIDIA Cosmos開放世界基礎(chǔ)模型加速物理AI開發(fā)

NVIDIA 利用全新開源模型與仿真庫加速機器人研發(fā)進程

Cadence 借助 NVIDIA DGX SuperPOD 模型擴展數(shù)字孿生平臺庫,加速 AI 數(shù)據(jù)中心部署與運營

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+第二章 實現(xiàn)深度學(xué)習(xí)AI芯片的創(chuàng)新方法與架構(gòu)

NVIDIA Nemotron Nano 2推理模型發(fā)布

NVIDIA RTX AI加速FLUX.1 Kontext現(xiàn)已開放下載

NVIDIA攜手諾和諾德借助AI加速藥物研發(fā)

使用NVIDIA Triton和TensorRT-LLM部署TTS應(yīng)用的最佳實踐

英偉達GTC25亮點:NVIDIA Dynamo開源庫加速并擴展AI推理模型

Oracle 與 NVIDIA 合作助力企業(yè)加速代理式 AI 推理

Microsoft使用NVIDIA Triton加速AI Transformer模型應(yīng)用

Microsoft使用NVIDIA Triton加速AI Transformer模型應(yīng)用

評論