上海電力大學的兩位研究人員最近開發并評估了野生人臉表情識別(FER)的新神經網絡模型。他們的研究發表在Elsevier的Neurocomputing期刊上,提出了三種卷積神經網絡(CNN)模型:Light-CNN,雙分支CNN和預先訓練的CNN。

“由于缺乏關于非正面的信息,野外的FER是計算機視覺中的一個難點,”進行這項研究的研究人員之一錢永生告訴TechXplore。“基于深度卷積神經網絡(CNN)的現有自然面部表情識別方法存在一些問題,包括過擬合,高計算復雜度,單一特征和有限樣本。”

盡管許多研究人員已經開發了用于FER的CNN方法,但到目前為止,他們中很少有人試圖確定哪種類型的網絡最適合這一特定任務。意識到文獻中的這種差距,永勝和他的同事邵杰為FER開發了三種不同的CNN,并進行了一系列的評估,以確定他們的優勢和劣勢。

“我們的第一個模型是淺光CNN,它引入了一個深度可分離的模塊和剩余的網絡模塊,通過改變卷積方法來減少網絡參數,”永勝說。“第二個是雙分支CNN,它結合了全局特征和局部紋理特征,試圖獲得更豐富的特征并補償卷積旋轉不變性的缺乏。第三個預訓練的CNN使用在同一個分布式大型數據庫中訓練的權重重新培訓自己的小型數據庫,縮短培訓時間,提高識別率。“

研究人員對三種常用于FER的數據集進行了CNN模型的廣泛評估:公共CK +,多視圖BU-3DEF和FER2013數據集。盡管三種CNN模型在性能上存在差異,但它們都取得了可喜的成果,優于幾種最先進的FER方法。

“目前,這三種CNN型號是分開使用的,”永勝解釋說。“淺網絡更適合嵌入式硬件。預訓練的CNN可以獲得更好的效果,但需要預先訓練的權重。雙分支網絡不是很有效。當然,也可以嘗試使用這三種模式一起。”

在他們的評估中,研究人員觀察到,通過組合剩余網絡模塊和深度可分離模塊,就像他們為第一個CNN模型所做的那樣,可以減少網絡參數。這最終可以解決計算硬件的一些缺點。此外,他們發現預先訓練的CNN 模型將大型數據庫轉移到自己的數據庫,因此可以用有限的樣本進行訓練。

永勝和杰提出的三個針對FER的CNN可以有許多應用,例如,幫助開發能夠識別他們正在與之交互的人的面部表情的機器人。研究人員現在計劃對他們的模型進行額外調整,以進一步提高他們的表現。

“在我們未來的工作中,我們將嘗試添加不同的傳統手動功能,加入雙分支CNN并改變融合模式,”永勝說。“我們還將使用跨數據庫培訓網絡參數來獲得更好的泛化能力,并采用更有效的深度傳輸學習方法。”

-

神經網絡

+關注

關注

42文章

4838瀏覽量

107756 -

網絡模塊

+關注

關注

0文章

28瀏覽量

10012

發布評論請先 登錄

Transformer如何讓自動駕駛變得更聰明?

一些神經網絡加速器的設計優化方案

CNN卷積神經網絡設計原理及在MCU200T上仿真測試

NMSISI庫的使用

NMSIS神經網絡庫使用介紹

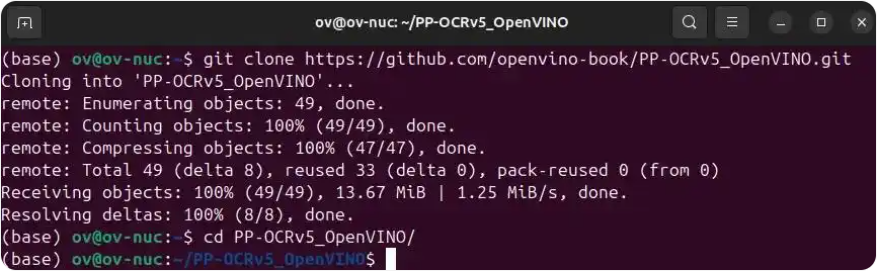

使用OpenVINO將PP-OCRv5模型部署在Intel顯卡上

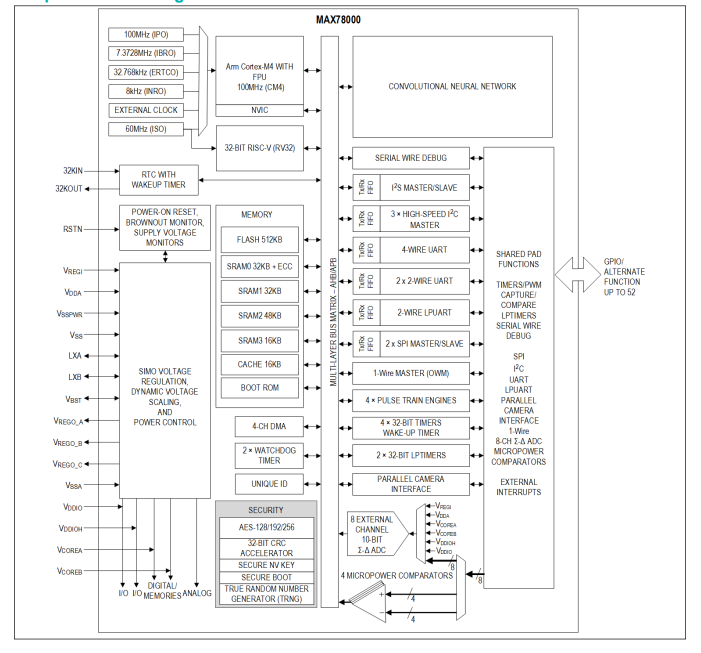

MAX78000采用超低功耗卷積神經網絡加速度計的人工智能微控制器技術手冊

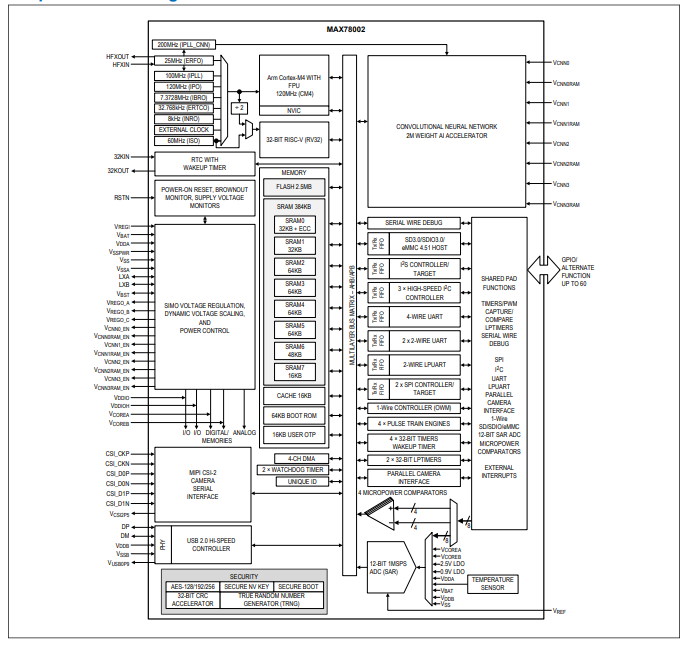

MAX78002帶有低功耗卷積神經網絡加速器的人工智能微控制器技術手冊

在友晶LabCloud平臺上使用PipeCNN實現ImageNet圖像分類

自動駕駛感知系統中卷積神經網絡原理的疑點分析

三種卷積神經網絡模型:Light-CNN,雙分支CNN和預先訓練的CNN

三種卷積神經網絡模型:Light-CNN,雙分支CNN和預先訓練的CNN

評論