作者:英特爾創(chuàng)新大使劉力

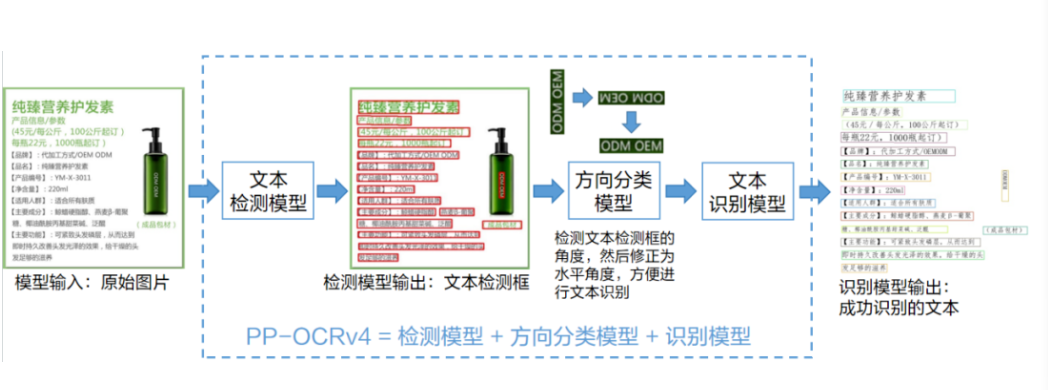

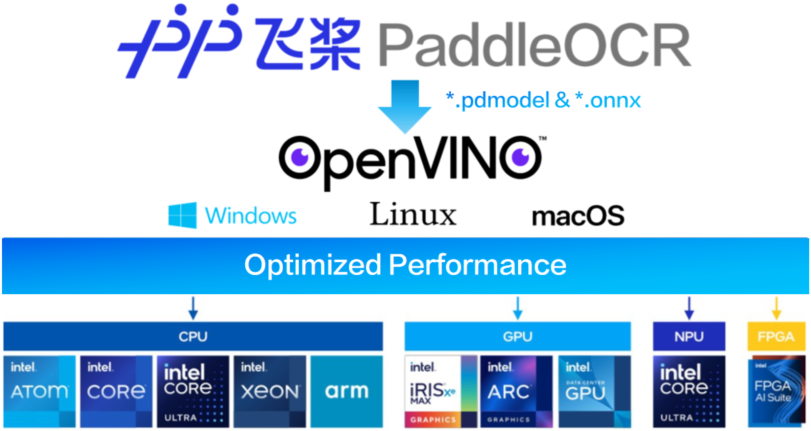

上文介紹了《一鍵搞定!PP-OCRv5模型轉(zhuǎn)ONNX格式全攻略》,本文將使用OpenVINO?工具套件在Intel? CPU、獨(dú)立顯卡、集成顯卡上優(yōu)化并部署飛槳PP-OCRv5模型。

一,OpenVINO?工具套件簡(jiǎn)介

OpenVINO?工具套件

是一個(gè)用于優(yōu)化和部署人工智能(AI)模型,提升AI推理性能的開(kāi)源工具集合,不僅支持以卷積神經(jīng)網(wǎng)絡(luò)(CNN)為核心組件的預(yù)測(cè)式AI模型(Predictive AI),還支持以Transformer為核心組件的生成式AI模型(Generative AI)。

OpenVINO?工具套件支持直接讀取并優(yōu)化PaddlePaddle訓(xùn)練好的模型(*.pdmodel)或者ONNX格式模型(*.onnx),

提升其在英特爾? CPU、獨(dú)立顯卡、集成顯卡、NPU等硬件上的AI推理計(jì)算性能。

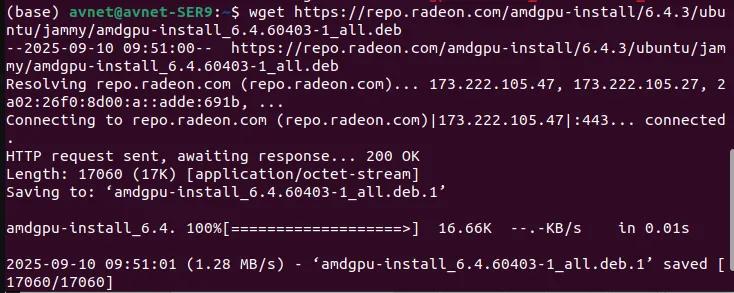

二,安裝英特爾顯卡驅(qū)動(dòng)

參考鏈接:https://dgpu-docs.intel.com/driver/client/overview.html,在Ubuntu下完成英特爾顯卡驅(qū)動(dòng)安裝。

三,搭建開(kāi)發(fā)環(huán)境

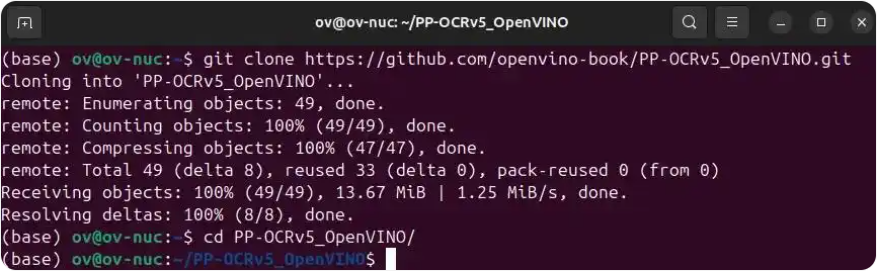

首先,請(qǐng)克隆PP-OCRv5_OpenVINO到本地:

git clone https://github.com/openvino-book/PP-OCRv5_OpenVINO.git cd PP-OCRv5_OpenVINO

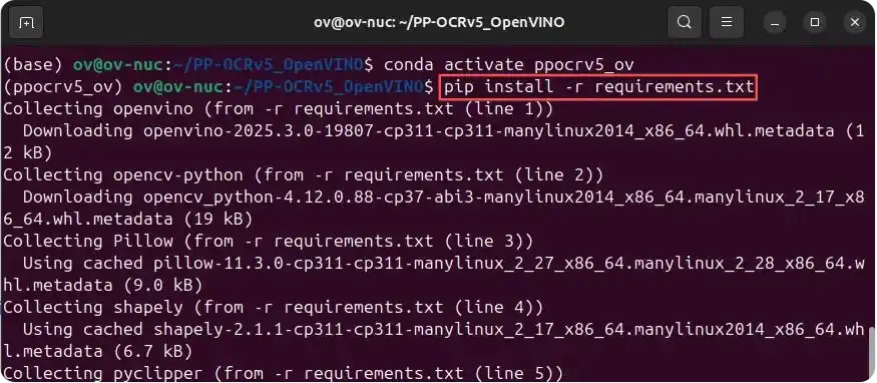

接著,創(chuàng)建并激活虛擬環(huán)境ppocrv5_ov,并安裝所有依賴項(xiàng)。

conda create -n ppocrv5_ov python=3.11 conda activate ppocrv5_ov pip install -r requirements.txt

四,下載并導(dǎo)出PP-OCRv5 ONNX格式模型

請(qǐng)按《一鍵搞定!PP-OCRv5模型轉(zhuǎn)ONNX格式全攻略》所示,下載并導(dǎo)出PP-OCRv5 ONNX格式模型到PP-OCRv5_OpenVINO文件夾。

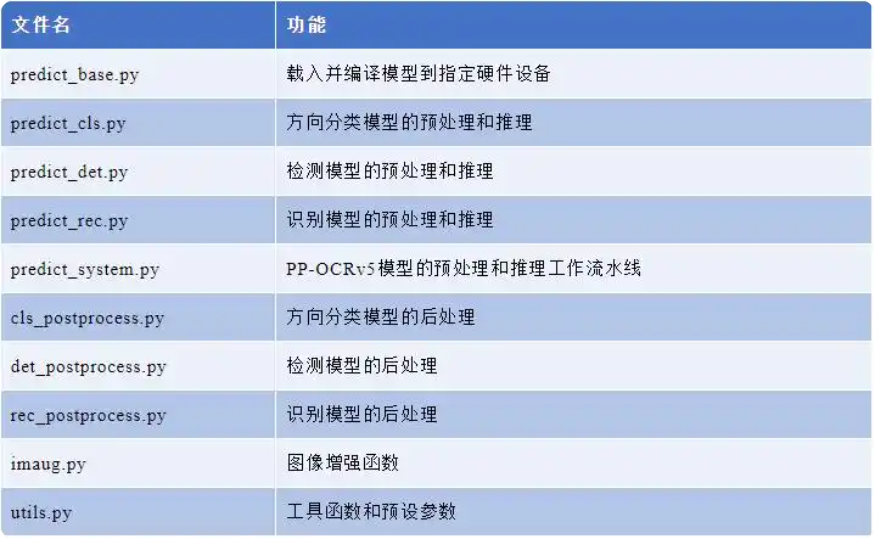

五,編寫(xiě)PP-OCRv5推理程序

PP-OCRv5_OpenVINO項(xiàng)目已將推理程序編寫(xiě)完成,各文件功能如下:

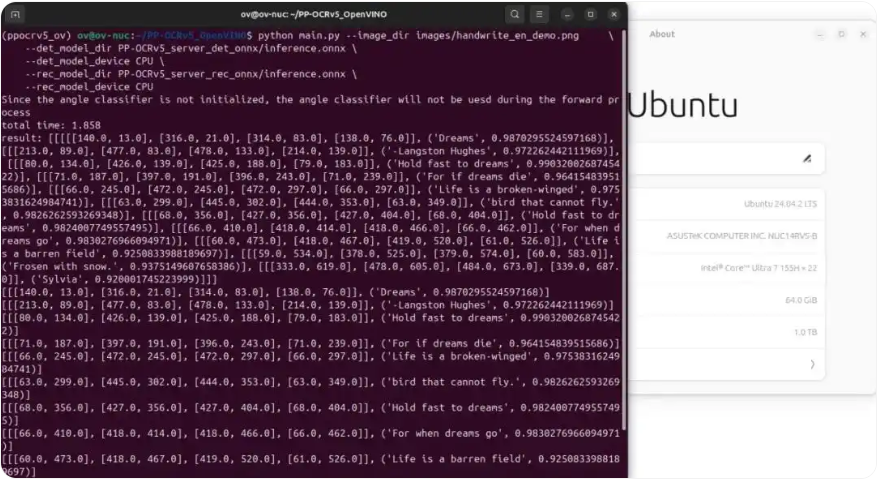

執(zhí)行演示程序main.py,并指定模型路徑和推理硬件設(shè)備:

python main.py --image_dir images/handwrite_en_demo.png --det_model_dir PP-OCRv5_server_det_onnx/inference.onnx --det_model_device CPU --rec_model_dir PP-OCRv5_server_rec_onnx/inference.onnx --rec_model_device CPU

運(yùn)行結(jié)果,如下圖所示:

六,總結(jié)

開(kāi)發(fā)者可以通過(guò)OpenVINO?工具套件將PP-OCRv5模型部署到Intel的CPU、獨(dú)立顯卡或集成顯卡上。

如果你有更好的文章,歡迎投稿!

稿件接收郵箱:nami.liu@pasuntech.com

更多精彩內(nèi)容請(qǐng)關(guān)注“算力魔方?”!

-

英特爾

+關(guān)注

關(guān)注

61文章

10310瀏覽量

180777 -

顯卡

+關(guān)注

關(guān)注

16文章

2523瀏覽量

71628 -

OpenVINO

+關(guān)注

關(guān)注

0文章

118瀏覽量

794

發(fā)布評(píng)論請(qǐng)先 登錄

PP-OCRv3優(yōu)化策略詳細(xì)解讀

基于C#和OpenVINO?在英特爾獨(dú)立顯卡上部署PP-TinyPose模型

如何使用OpenVINO C++ API部署FastSAM模型

使用OpenVINO C# API輕松部署飛槳PP-OCRv4模型

如何在C#中部署飛槳PP-OCRv4模型

使用OpenVINO優(yōu)化并部署飛槳PP-OCRv4模型

用ROCm部署PP-StructureV3到AMD GPU上

【EASY EAI Orin Nano開(kāi)發(fā)板試用體驗(yàn)】PP-OCRV5文字識(shí)別實(shí)例搭建與移植

在Arm虛擬硬件上部署PP-PicoDet模型

使用OpenVINO? 部署PaddleSeg模型庫(kù)中的DeepLabV3+模型

在英特爾獨(dú)立顯卡上部署YOLOv5 v7.0版實(shí)時(shí)實(shí)例分割模型

在C++中使用OpenVINO工具包部署YOLOv5模型

在AI愛(ài)克斯開(kāi)發(fā)板上用OpenVINO?加速YOLOv8目標(biāo)檢測(cè)模型

基于算力魔方與PP-OCRv5的OpenVINO智能文檔識(shí)別方案

一鍵搞定!PP-OCRv5模型轉(zhuǎn)ONNX格式全攻略,解鎖多平臺(tái)無(wú)縫部署

使用OpenVINO將PP-OCRv5模型部署在Intel顯卡上

使用OpenVINO將PP-OCRv5模型部署在Intel顯卡上

評(píng)論