前言

做深度學習加速器已經兩年了,從RTL設計到仿真驗證,以及相應的去了解了Linux驅動,深度學習壓縮方法等等。今天來捋一捋AI加速器都涉及到哪些領域,需要哪些方面的知識。可以用于AI加速器的主要有三種不同架構的器件種類:CPU,GPU,AI芯片/FPGA。CPU是一個通用架構芯片,其計算能力和數據帶寬相對受到限制,面對大計算量的深度學習就顯露出其缺點了。GPU含有大量的計算陣列,可以適用于大規模運算,而且其生態較為成熟和完整,所以現在包攬了所有的深度學習訓練和絕大部分深度學習推理。要說有沒有缺陷,經常被拿來比較的就是其功耗較大,而且并不是完全針對于深度學習網絡的結構,所以還并不能完全利用其計算和存儲資源。為了更有針對性的加速深度學習網絡,AI芯片(FPGA)近兩年也出現了。Intel、阿里平頭哥、騰訊、百度等都開始設計自己的AI加速芯片,使用FPGA的有賽靈思、曠視科技等。FPGA用于深度學習加速和AI芯片的架構具有通用性,兩者可以看做相同架構,只是用于不同硬件器件。而且通常AI芯片的前期驗證也是用FPGA完成的。這篇文章就捋一捋FPGA在做深度學習加速時需要的技能。

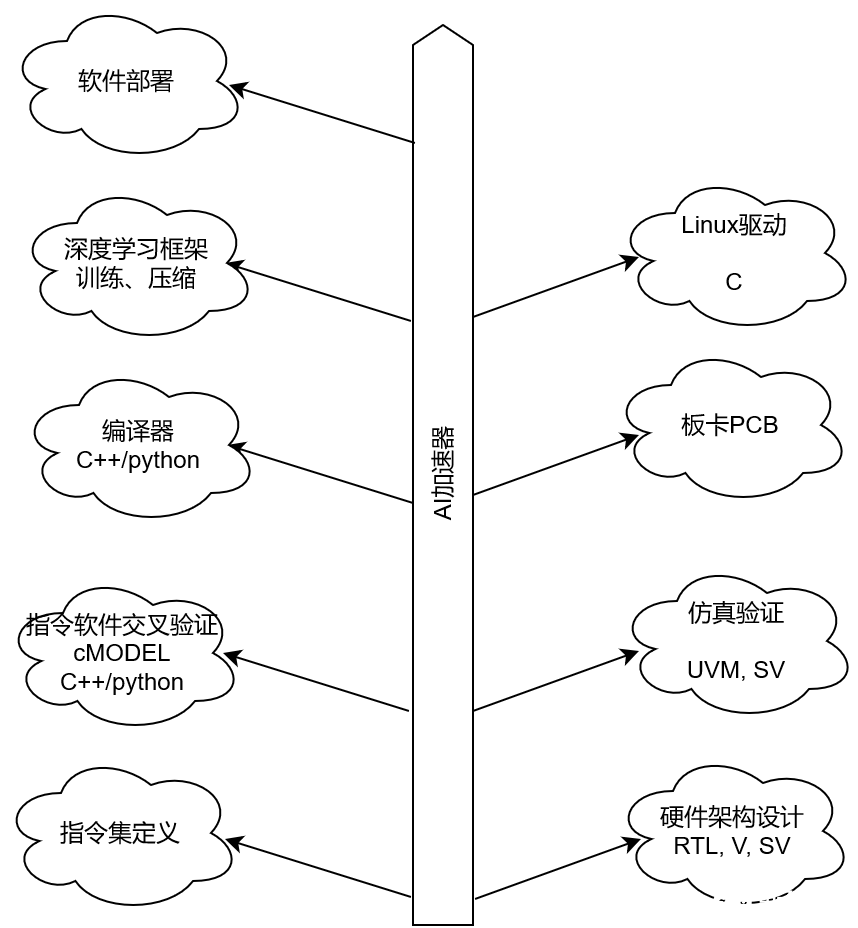

1. 一張圖

AI加速是一個同時涉及到軟件和硬件的領域,下面一張簡單的圖羅列了AI加速器所有知識。

2. RTL

RTL部分設計主要考慮到以下幾個方面:

1) 考察神經網絡每個部分的計算量和參數數據,選擇適合在FPGA上進行加速的部分。比如對于CNN網絡,卷積運算占據整個網絡的絕大部分計算,因此會占據FPGA中的絕大部分DSP資源。但是在卷積運算之間還存在激活函數、歸一化等操作,這些雖然計算量不大,但是會對整個加速形成瓶頸,因此如何能夠與卷積運算形成流水對性能影響也很大;

2) 設計加速算法。只要考慮好這兩點就解決了主要問題:一個是計算資源利用率,另外一個是miss ratio。計算資源利用率包括FPGA上空間資源利用率,還包括計算資源的時間利用率。空間利用率越高,說明算力越高,時間利用率越高表明有效計算越高,加速效果越好。Miss ratio反映了片上cache存儲的參數是否能夠及時供給計算使用。如果能及時供給使用,那么從片外加載數據的時間就可以被壓縮。

3) 架構的通用性。基本上架構都是基于指令集的,指令集主要依據加速器的計算核來定義的,算是復雜指令集。一個指令包含了參數的存儲位置,需要數量,計算方式等等。由于深度網絡操作數量比較單一,比如LSTM基本上就包括矩陣乘法、加法、向量乘法、激活等。大概也就有不超過10個指令就能涵蓋一個LSTM網絡了。為了適配這樣的指令,架構大概包含以下結構:

外部總線:主要用于和外部ddr進行數據交互。

內部存儲:儲存要用到的參數和數據,及時供給計算核。Cache緩存是為了解決讀取DDR帶寬瓶頸問題。

指令解析:獲取指令進行解析,發送給相應模塊進行處理。

內部總線:為每個計算核提供數據讀寫通路。

計算核:張量計算核,用于加速神經網絡計算。

計算核互聯線:實現不同計算核之間的直接互聯,可以實現不同計算核的pipeline。

Batch:包含了計算核、指令解析、計算核互聯線等。當然如果內部cache并不是用的很多,一個batch也可以包含有內部cache。這些batch實際上可以看做神經網絡運行的線程,多個batch就支持多線程神經網絡計算。比如一個LSTM網絡可以在有batch=2的硬件上同時進行兩個句子的運算。

線程控制:用于控制多batch操作。

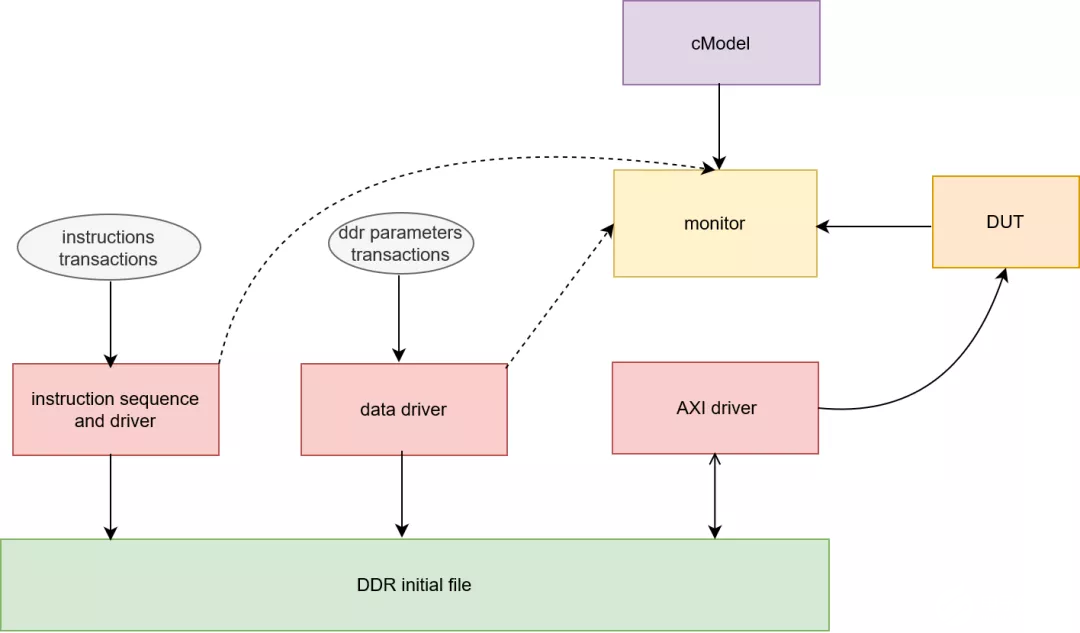

3. 驗證

驗證主要包括兩個方面,一個是對指令集正確性進行驗證,另外一個是對RTL代碼進行仿真。指令集的驗證需要有一個CMODEL來對編譯器生成指令的正確性進行校驗,校驗準確才能夠給硬件使用。因為仿真環境也需要隨機化指令來對RTL代碼進行校驗,所以cmodel也會用于仿真環境中。我以UVM為例來說明,其基本結構如下:

指令隨機化:對指令進行約束,生成隨機指令;

指令驅動:將指令轉換成文件,提供給cmodel,以及初始化到ddr文件中;

參數隨機化:隨機化權重等參數;

參數驅動:將參數初始化為ddr文件;

AXI驅動:這個包含AXI讀寫ddr文件的驅動,用于和DUT進行交互;

Monitor:監測DUT行為,和cmodel的數據進行對比;

4. 驅動

驅動主要是完成ddr的初始化,線程控制的配置以及中斷響應等。首先將權重等參數初始化到ddr中,然后通過axi總線配置FPGA的寄存器,同時對FPGA產生的中斷進行響應。獲取ddr中結果數據等。一般如zynq等SoC器件,因為集成了arm核,所以驅動相對簡單。如果軟件端在服務器,那么還需要PCIE等驅動來支持和服務器的交互。以SoC器件為例,linux驅動正常工作需要以下步驟:

1. 制作RTL硬件工程,生成bit文件和hardware配置文件;

2. 利用SDK生成fsbl文件,這個主要完成對zynq器件的一些基本硬件配置;

3. 制作linux的uboot、kernel、devicetree等文件;

4. 用fsbl、bit、uboot、kernel、devicetree制作boot.bin;

5. 選擇linux文件系統,如linaro等。制作SD卡鏡像,燒寫到SD卡中,啟動SoC器件;

5. 編譯器

編譯器主要能夠根據深度學習模型來生成指令,并優化指令。以TVM為例,它基于計算圖,對接市場上主流的深度學習框架:tensorflow、pytorch等,將這些模型進行計算圖的轉化,然后基于這些計算圖來進行圖的優化和指令優化。TVM目標是通用性,所以其兼容CPU、GPU、TPU,同時還要對接更多的深度學習框架。所以其很龐大。針對FPGA自身的AI加速器,可以以這個為借鑒,開發自己的compiler。同時依據自身硬件特點進行指令的優化。

計算圖是基本很多編譯器采用的圖結構,其貫穿了指令優化和生成始終。計算圖中的節點包含了數據信息和相應操作。這些節點相互連接形成了一個網絡計算的依賴關系。計算圖是一個基于tensor操作的圖,它并不像通用CPU編譯器的細化的標量操作。因為FPGA加速器中計算核一般都是張量操作。這是和CPU不同的。而且這樣的計算圖也相對簡潔。

一個張量操作的實現有很多可能,因為依據數據之間的依賴關系和維度大小,可以對張量運算進行分解為多步操作。這些分解有很多。因此優化一個計算圖就會面臨很多這樣可能的步驟。這被稱為schedule,優化就是在這些schedule空間中找出最優的那個順序。TVM中提出了一個基于機器學習模型的優化方法,去搜尋schedule空間,找到最適于硬件的圖。然后生成指令。

6. 模型壓縮

模型壓縮有很多方法,根據壓縮目標主要包括量化和剪枝。量化就是將浮點定點化,剪枝就是去除一些冗余的連接或者數據。從一些文獻調研的結果有以下一些方式:

1) 二值化網絡;

2) 向量壓縮方法;

3) 知識蒸餾;

4) CP分解;

5) 降維分解;

6) 深度壓縮;

7) 自動化搜索空間;

7. 軟件部署

因為FPGA并不適合加速神經網絡的所有部分或者還沒有相應IP來加速一些模塊,那么這些操作就會放在CPU上進行,比如對于LSTM網絡,前邊的embedding層還有后端的softmax或者類別生成。這些都更適合在CPU上做。因此軟件部署來調用FPGA硬核IP,和FPGA進行交互。同時還有一些數據準備、打印等操作,客戶展示。這些都是軟件部署要做的。

總結

一個AI加速涉及到了算法、軟件、驅動、硬件方面,因此通常做AI加速的團隊都比較龐大,包含了算法到硬件的各種人才。

-

FPGA

+關注

關注

1660文章

22408瀏覽量

636247 -

AI

+關注

關注

91文章

39755瀏覽量

301365 -

深度學習

+關注

關注

73文章

5598瀏覽量

124396

發布評論請先 登錄

算法工程師需要具備哪些技能?

Microsemi IGLOO2 FPGA與SmartFusion2 SoC FPGA深度剖析

機器學習和深度學習中需避免的 7 個常見錯誤與局限性

【團購】獨家全套珍藏!龍哥LabVIEW視覺深度學習實戰課(11大系列課程,共5000+分鐘)

【團購】獨家全套珍藏!龍哥LabVIEW視覺深度學習實戰課程(11大系列課程,共5000+分鐘)

從0到1,10+年資深LabVIEW專家,手把手教你攻克機器視覺+深度學習(5000分鐘實戰課)

如何深度學習機器視覺的應用場景

如何在機器視覺中部署深度學習神經網絡

Andes晶心科技推出新一代深度學習加速器

深度學習對工業物聯網有哪些幫助

自動駕駛中Transformer大模型會取代深度學習嗎?

FPGA做深度學習加速的技能總結

FPGA做深度學習加速的技能總結

評論