人們對(duì)AI for Science的關(guān)注推向了高潮。

2. 跨學(xué)科融合與科學(xué)研究新范式

AI與生命科學(xué)的結(jié)合,不僅推動(dòng)了生命科學(xué)本身的進(jìn)步,還促進(jìn)了多個(gè)學(xué)科之間的交叉融合。這種跨學(xué)科的合作模式,打破

2024-10-14 09:21:45

1 個(gè) AI 模型 = 5 輛汽車終身碳排量,AI 為何如此耗能?

2021-01-22 06:35:03

AI概念籠統(tǒng),范圍廣大,到底什么才是AI的核心?手把手教你設(shè)計(jì)人工智能芯片及系統(tǒng)(全階設(shè)計(jì)教程+AI芯片F(xiàn)PGA實(shí)現(xiàn)+開發(fā)板)詳情鏈接:http://url.elecfans.com/u/c422a4bd15

2019-10-18 06:39:12

`自從AI概念被提出來,似乎很多東西都能跟它扯上點(diǎn)兒關(guān)系。比如——AI智能音箱。 當(dāng)你為它接通電源,讓它為你放歌、報(bào)天氣和開燈時(shí),你以為它真貼心。 不,真正貼心的是它—— 電源小板與主板相連 這個(gè)

2019-04-19 10:36:29

\"}\"

更換了x-cube-ai三個(gè)版本的庫(7.3.0/8.0.0/8.0.1),報(bào)錯(cuò)都一樣。

求教ST官方是如何解決這個(gè)問題的?

2024-03-14 06:23:17

在設(shè)計(jì)時(shí)對(duì)產(chǎn)品進(jìn)行靜電干擾測(cè)試時(shí),出現(xiàn)I2C的CLK被異常拉低,接上位機(jī)讀取I2C狀態(tài)寄存器,發(fā)現(xiàn)寄存器值有變化,這種問題如何解?

2020-02-07 15:23:49

Labview 似乎沒有繁體版? 這是在歧視彎彎嗎?最近發(fā)現(xiàn) Labview 似乎沒有繁體版? 這是在歧視彎彎嗎?如果這樣的話 打開繁體的Labview程序 ,似乎不可避免的要出現(xiàn)亂碼了。你們是用 南極星 這樣的軟件 解決問題的嗎?

2016-04-16 14:51:25

本帖最后由 jinglixixi 于 2020-10-14 20:27 編輯

SLSTK3301A開發(fā)板被鎖定不能下載,該如何解鎖?

2020-10-13 15:46:11

STM32 不小心被鎖住,如何解開?具體實(shí)施辦法:1、按住單片機(jī)復(fù)位鍵不松開;2、同時(shí)下載程序3、彈出一個(gè)窗口,選擇NO4、再重新下載程序,即可。問題:STM32JTAG/SWD禁用導(dǎo)致無法燒寫由于

2022-01-10 08:02:03

STM8使用STLINK進(jìn)行在線調(diào)試時(shí)很容易被電源影響,這是什么原因呢,該如何解決?除了加電容對(duì)電源濾波還有其他原因么?

2024-05-07 07:42:13

TC387芯片通過MCD軟件連接芯片時(shí)提示Device被鎖定,設(shè)備被鎖,這是什么原因引起的,如何解鎖呢?

2024-05-31 07:48:21

大家好。 我在使用 X-CUBE-AI 7.1.0 版時(shí)遇到了問題。當(dāng)我加載神經(jīng)網(wǎng)絡(luò)的 TFlite 模型并生成代碼時(shí),我在初始化輸入和輸出緩沖區(qū)時(shí)遇到了問題。特別是我對(duì)這個(gè)分配

2022-12-26 10:15:51

我想知道 X-CUBE-AI 和 NanoEdge AI Studio 在 ML 和 AI 開發(fā)環(huán)境中的區(qū)別。我可以在任何一個(gè)開發(fā)環(huán)境中做同樣的事情嗎?使用的設(shè)備有什么限制嗎?

2022-12-05 06:03:15

在使用cube-ai時(shí),會(huì)彈出對(duì)話框,并一致卡死在0%,嘗試手動(dòng)安裝GNU工具也無效。請(qǐng)問該如何解決?

2024-03-21 07:42:41

學(xué)科之間的交叉融合,形成了一種全新的科學(xué)研究范式。AI技術(shù)打破了學(xué)科壁壘,使得物理學(xué)、化學(xué)、生物學(xué)、天文學(xué)等領(lǐng)域的研究者能夠共享數(shù)據(jù)和算法,共同解決復(fù)雜問題。這種跨學(xué)科的合作不僅拓寬了科學(xué)研究的視野

2024-10-14 09:12:36

。

4. 物理與AI的融合

在閱讀過程中,我對(duì)于物理與AI的融合有了更加深入的認(rèn)識(shí)。AI for Science不僅依賴于數(shù)據(jù),還需要結(jié)合物理定律和原理來確保模型的準(zhǔn)確性和可解釋性。這種融合不僅提高了模型

2024-10-14 09:16:37

:cifar10_uint8.tflite問題描述:使用RT-AK部署成功后(CUBE-AI版本為7.0.0):在Studio更新軟件包,刷新后報(bào)錯(cuò):使用RT-AK部署成功后(CUBE-AI版本為5.2.0):在Studio更新軟件包,刷新后編譯成功:問題:為什么使用cube-ai 7.0.0 會(huì)報(bào)錯(cuò),如何解決這個(gè)問題

2022-04-24 09:52:26

使用ENV生成工程時(shí)自己添加的文件被清如何解決呢

2022-12-01 15:11:36

我用一個(gè)不超過聲卡允許輸入的正弦信號(hào)通過聲卡的line in輸入電腦,然后通過LV采集,采用的是范例里面那個(gè),幅值為1,但是信號(hào)無論調(diào)多大,電腦接收的就只有0.5。請(qǐng)問聲卡采集信號(hào)和聲卡作為信號(hào)發(fā)生器輸入輸出被限幅如何解決??

2017-12-18 16:58:37

如何解決藍(lán)牙協(xié)議棧被鎖問題

2024-03-21 08:21:01

在人工智能技術(shù)飛速發(fā)展的今天,它不僅帶來了前所未有的便利和效率,也暴露出了一系列倫理和隱私問題。從數(shù)據(jù)隱私侵犯到“信息繭房”的形成,再到“大數(shù)據(jù)殺熟”、AI歧視和深度偽造技術(shù)的威脅,AI的應(yīng)用似乎

2024-07-16 15:07:34

許多情況下也導(dǎo)致了錯(cuò)誤看法的出現(xiàn)。AI是由偉大的思想家和學(xué)術(shù)研究者建立的,接著被世界各地的學(xué)術(shù)界和工業(yè)界進(jìn)一步發(fā)展,它的發(fā)展速度比任何人所預(yù)料的都要快。事到如今,人類自身的生物局限性正日益成為創(chuàng)建智能

2019-05-06 16:46:05

。AI的演進(jìn)速度要比它要處理的數(shù)據(jù)的演進(jìn)快得多,所以這注定了它不僅折射和反映出過去的偏見,而且還延長并加強(qiáng)了它們。因此,當(dāng)判斷被移交給機(jī)器之后,那些曾經(jīng)是包括警察、法院在內(nèi)的機(jī)構(gòu)系統(tǒng)性歧視目標(biāo)的群體

2018-06-02 12:51:50

我在燒錄ESP RainMaker中的例程時(shí),遇到這種版本問題,應(yīng)該如何解決呀。

ESP-IDF是5.2.1 ,下載esp-rainmaker時(shí)使用的是$ git clone --recursive https://github.com/espressif/esp-rainmaker.git命令

2024-06-05 06:44:22

,他應(yīng)當(dāng)尊重人類文化的多樣性。 隱私性原則。納德拉呼吁以精密的技術(shù)來保護(hù)個(gè)人和群體信息。 算法可靠準(zhǔn)則。這樣一來,人類就可以解除AI帶來的意料之外的傷害。 防偏見準(zhǔn)則。應(yīng)該通過研究確保AI不會(huì)

2016-07-11 10:34:16

到的。硬件部分:daq卡外接了一個(gè)接線盒被擴(kuò)展為64路ai,2路ao,8個(gè)io),據(jù)說是以前的某位前輩自己做的,沒有留下任何的說明;軟件部分:直接采用了daq自帶的vi,以ai_scan為例,ai

2015-08-12 11:47:53

請(qǐng)問大神,這種數(shù)據(jù)結(jié)構(gòu)一般如何解析額。。 不太懂。。

2020-06-10 09:27:38

自動(dòng)駕駛車輛中的AI分析車輛中的AI應(yīng)用

2021-03-09 07:53:23

不足,并不是因?yàn)樗齻冊(cè)诠ぷ鲌?chǎng)所面臨偏見和歧視,而是由于男女之間固有的生物學(xué)上的差距,如果強(qiáng)行多元化,則對(duì)部分雇員不公道。在這封信被泄漏后,這名工程師立刻被Google CEO,印度裔的劈柴(Sundar

2017-08-15 10:36:25

iphone密碼多次輸入錯(cuò)誤被鎖如何解?

iPhone允許您設(shè)置一個(gè)密碼,在開機(jī)或按下喚醒按鈕時(shí)可以輸入此密碼。這在 iPhone用戶指南和功能

2010-02-02 09:45:42 33991

33991 被證明已產(chǎn)生影響,如對(duì)求職者進(jìn)行分類的基本計(jì)算機(jī)程序,可能會(huì)基于關(guān)鍵詞而對(duì)某些求職者產(chǎn)生歧視。但美國有一個(gè)研究小組在正試圖打破這種偏見。 微軟研究院(Microsoft Research)的程序員亞當(dāng)卡萊(Adam Kalai)正與波士頓大學(xué)

2017-09-20 09:32:48 0

0 偏見是人工智能面臨一個(gè)挑戰(zhàn),主要是來自算法偏見,當(dāng)然偏見并不止這些。與人類不同,算法不能撒謊,那么產(chǎn)生結(jié)果的不同必將是數(shù)據(jù)帶來的問題。人工智能算法及系統(tǒng)的測(cè)試與驗(yàn)證,如何避免人工智能的偏見呢?

2018-02-06 14:04:36 13424

13424 人們都曾看過機(jī)器控制了世界而人類被毀滅的電影。好在這些電影是娛樂性的,而且人們都認(rèn)為這些場(chǎng)景是不會(huì)發(fā)生的。然而,一個(gè)更應(yīng)該關(guān)注的現(xiàn)實(shí)問題是:算法偏見。

2018-02-08 10:10:38 4951

4951 人工智能本來并不存在偏見,它不會(huì)因?yàn)闊o法通過邏輯來解釋的理由而“想”某些東西是真的或假的。不幸的是,從創(chuàng)建算法到解釋數(shù)據(jù),機(jī)器學(xué)習(xí)中存在著人類的偏見,并且直到現(xiàn)在,幾乎沒有人試圖解決這個(gè)嚴(yán)重的問題。

2018-04-23 15:56:00 1154

1154 機(jī)器學(xué)習(xí)還能產(chǎn)生“偏見”?機(jī)器學(xué)習(xí)也會(huì)對(duì)數(shù)據(jù)產(chǎn)生偏見,從而導(dǎo)致錯(cuò)誤的預(yù)測(cè)。我們?cè)撊?b class="flag-6" style="color: red">何解決這一問題? Google的新論文或許會(huì)揭曉答案。機(jī)器學(xué)習(xí)中的機(jī)會(huì)均等 隨著機(jī)器學(xué)習(xí)計(jì)算穩(wěn)步發(fā)展,越來越多人開始關(guān)注其對(duì)于社會(huì)的影響。機(jī)器學(xué)習(xí)的成功分支之一是監(jiān)督學(xué)習(xí)。

2018-05-14 18:20:00 3708

3708

在我們的生活中,許多重要決策都是由某種系統(tǒng)做出的,很多系統(tǒng)都存在明顯的偏見,無論這系統(tǒng)是人、機(jī)器還是二者的組合。機(jī)器學(xué)習(xí)在決策制度中的作用越來越大,這為我們提供了一個(gè)建立更少偏見的系統(tǒng)的機(jī)會(huì),當(dāng)然也面臨著加劇這一問題的風(fēng)險(xiǎn)。

2018-06-23 12:34:00 855

855 當(dāng)使用谷歌翻譯將西班牙語的新聞翻譯為英語時(shí),涉及到女性的短語通常都會(huì)翻譯為“他說”或“他寫道”。

2018-08-15 15:53:24 3964

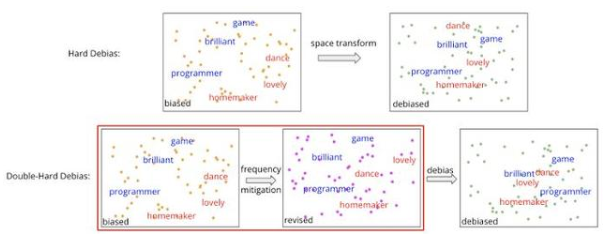

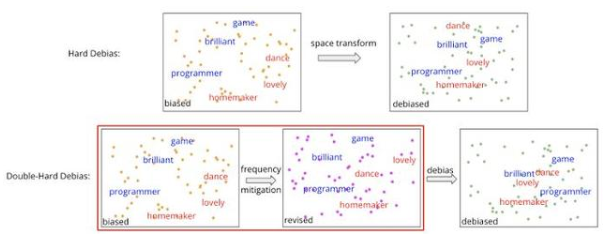

3964 帶有這樣的偏見的詞嵌入模型,會(huì)給下游的NLP應(yīng)用帶來嚴(yán)重問題。例如,基于詞嵌入技術(shù)的簡歷自動(dòng)篩選系統(tǒng)或工作自動(dòng)推薦系統(tǒng),會(huì)歧視某種性別的候選人(候選人的姓名反映了性別)。除了造成這種明顯的歧視現(xiàn)象,有偏見的嵌入還可能暗中影響我們?nèi)粘J褂玫腘LP應(yīng)用。

2018-09-23 09:25:00 4383

4383 IBM推出了一項(xiàng)軟件服務(wù),可以掃描人工智能系統(tǒng)的工作情況,以便檢測(cè)偏見并為正在做出的自動(dòng)決策提供解釋,一定程度的透明度可能是合規(guī)目的所必需的,而不僅僅是公司自己的盡職調(diào)查。 新的信任和透明度系統(tǒng)運(yùn)行

2018-09-22 06:33:00 3596

3596 10月4日,麻省理工學(xué)院計(jì)算機(jī)科學(xué)與人工智能實(shí)驗(yàn)室(CSAIL)宣布與卡塔爾計(jì)算研究所(Qatar Computing Research Institute)合作,研究出一種可以鑒別信息來源準(zhǔn)確性和個(gè)人政治偏見的AI系統(tǒng)。

2018-10-10 15:37:47 4464

4464 對(duì)于一直尋求智能化的亞馬遜而言,僅在倉儲(chǔ)和物流管理上使用AI技術(shù)是遠(yuǎn)遠(yuǎn)不能滿足的,因此這項(xiàng)2014年啟動(dòng)的AI招聘原本是亞馬遜探尋進(jìn)一步智能化的實(shí)驗(yàn),卻偏偏出了簍子。

2018-10-12 09:28:55 2064

2064 科學(xué)家正面臨一個(gè)復(fù)雜的問題,就是算法公平到底意味著什么?像Vaithianathan這樣正在與公共組織協(xié)作去建立負(fù)責(zé)、高效的軟件的研究人員,必須解決的難題就是自動(dòng)化的工具如何引入偏見或擴(kuò)展當(dāng)前的不平等性,尤其是當(dāng)這種工具被應(yīng)用到本來就有歧視的社會(huì)系統(tǒng)時(shí)。

2018-10-29 14:59:53 5513

5513 這種關(guān)于人AI技術(shù)的新立場(chǎng)是受到谷歌出現(xiàn)問題的影響而提出的。除了“大猩猩”事件之外,哈佛大學(xué)研究人員Latanya Sweeney發(fā)現(xiàn)谷歌搜索中的存在種族歧視。當(dāng)搜索類似黑人名字時(shí),會(huì)比搜索類似白人名字更有可能出現(xiàn)與“被逮捕”相關(guān)的廣告。

2018-11-12 10:22:44 3187

3187 人們都曾看過電影里機(jī)器控制了世界而人類被毀滅的場(chǎng)景。好在這些電影只是娛樂性的,現(xiàn)實(shí)世界是不會(huì)發(fā)生的。然而,一個(gè)更應(yīng)該關(guān)注的問題是:算法偏見。

2018-11-15 14:57:37 4833

4833 場(chǎng)景中時(shí),更多關(guān)乎生命、公平、道德等的問題將會(huì)出現(xiàn)。此前,亞馬遜用AI招聘出現(xiàn)了性別歧視問題就是有力的證明。

2018-11-19 10:52:29 1686

1686 AI與女性之間的關(guān)系,似乎一直不太好。

提到AI,我們看到的往往是“AI篩選簡歷帶有性別歧視,更偏向于男性員工”“AI取代秘書、翻譯和速記正在讓女性失業(yè)”“一切AI助理都是女性配音加重男權(quán)主義

2018-12-23 10:08:51 3287

3287 ;盲目相信算法的一個(gè)主要問題是,我們可以在不承認(rèn)具備任何意圖的情況下傳播這種帶有歧視性的模型。”

在這樣一個(gè)充滿挑戰(zhàn)性的人工智能時(shí)代,AI 算法和殺手機(jī)器人的偏見普遍存在,所有這些

2018-12-27 10:00:09 3873

3873 IBM、谷歌、微軟、亞馬遜以及機(jī)器學(xué)習(xí)API提供商將發(fā)布更具包容性的數(shù)據(jù)集,以應(yīng)對(duì)人工智能內(nèi)嵌的歧視和偏見問題

2019-01-05 09:39:49 755

755 根據(jù)英國《自然·醫(yī)學(xué)》雜志8日在線發(fā)表的一篇論文,一款人工智能在接受上萬張真實(shí)患者面部圖像訓(xùn)練后,能夠以高準(zhǔn)確率識(shí)別罕見的遺傳綜合征。科學(xué)家同時(shí)強(qiáng)調(diào),由于個(gè)人面部圖像是敏感但易得的數(shù)據(jù),因此必須小心處理,以防該技術(shù)的歧視性濫用。

2019-03-10 10:52:26 422

422 科技中立,但人制造出來的 AI 卻可能帶有偏見或歧視。AI 偏見情況像是性別歧視、種族歧視,例如面部偵測(cè)算法在識(shí)別白人時(shí)的準(zhǔn)確率比識(shí)別黑人高許多,男性跟女性類別也存在類似問題,讓軟件識(shí)別犯罪嫌犯人選、企業(yè)挑選求職者時(shí),也曾引發(fā)歧視問題。

2019-02-13 08:47:33 612

612 人工智能在社會(huì)中一直發(fā)揮著其獨(dú)特的作用,在人類發(fā)展進(jìn)程中,知識(shí)的增長和社會(huì)協(xié)作體系的擴(kuò)展起到了重要作用,而這一切都離不開人類大腦提供的智能基礎(chǔ)。例如微軟推出的“seeing AI”,就是為了幫助失明和弱視人群應(yīng)對(duì)日常生活中的問題。而“seeing AI”的產(chǎn)品開發(fā)團(tuán)隊(duì)中有一名7歲就失明的工程師。

2019-03-28 17:52:59 5356

5356 AI Now研究院最近發(fā)布的一份報(bào)告發(fā)現(xiàn),80%的AI教授、85%的Facebook公司AI研究人員以及90%的谷歌研究人員都是男性。另外,有色人種在大型科技企業(yè)員工當(dāng)中的占比也非常有限。

2019-05-26 11:01:39 1280

1280 在大多數(shù)科幻電影里,冷漠又殘酷是 AI 的典型形象,它們從來不會(huì)考慮什么是人情世故,既沒有人性光輝的閃耀,也沒有人性墮落的七宗罪。

2019-06-13 16:25:10 827

827 人工智能發(fā)展帶來的安全隱患與道德爭(zhēng)議,包括數(shù)據(jù)泄露、算法偏見、AI技術(shù)被濫用、安全隱患、法規(guī)不完善等問題。例如AI技術(shù)被濫用引發(fā)安全威脅。

2019-08-07 15:59:58 2154

2154 在這個(gè)數(shù)據(jù)即生產(chǎn)力的時(shí)代,與互聯(lián)網(wǎng)時(shí)刻鏈接的我們正在數(shù)據(jù)AI的時(shí)代中不停地“裸奔”。

2019-09-09 14:45:32 669

669 這種按需網(wǎng)絡(luò)研討會(huì)演示了如何解決模擬混合信號(hào)設(shè)計(jì)挑戰(zhàn)增加可靠性和速度與AMS墊專業(yè)產(chǎn)品開發(fā)。

2019-10-18 07:08:00 4161

4161 啥是AI?很多人可能不知道如何回答。但其實(shí),隨著自動(dòng)駕駛、生物識(shí)別、智能機(jī)器人等的快速發(fā)展和應(yīng)用,AI的概念早已變得日漸清晰。當(dāng)你放下對(duì)AI的狹隘偏見,你會(huì)發(fā)現(xiàn)它不僅僅是震驚棋壇的阿法狗或者才藝雙絕

2019-10-27 12:31:00 676

676 AI算法和它們的決策程序是由它們的研發(fā)者塑造的,他們寫入的代碼,使用的“訓(xùn)練”數(shù)據(jù)還有他們對(duì)算法進(jìn)行應(yīng)力測(cè)試 的過程,都會(huì)影響這些算法今后的選擇。

2019-11-08 16:32:16 833

833 你對(duì)AI有什么印象,沒有感情、不會(huì)犯錯(cuò),還是公正客觀?但總之,AI是不食人間煙火的,既不會(huì)閃耀人性的光輝,也不存在“七宗罪”。實(shí)際上,AI并非那么沒有人性,不過這并非一件好事。AI獲得智能的同時(shí),也學(xué)會(huì)了人類的“歧視”與“偏見”。

2019-11-14 14:37:35 753

753 人們最初確實(shí)天真地以為,算法能比人類更能避免偏見。人工智能學(xué)習(xí)人類知識(shí),同時(shí)也吸收人類偏見。這種擔(dān)憂由來已久。但谷歌的一項(xiàng)新發(fā)明極大推進(jìn)了人工智能從文本材料中學(xué)習(xí)的速度,也使解決機(jī)器偏見問題迫在眉睫。

2019-11-26 17:19:12 1087

1087 AI正以相當(dāng)顯眼得方式重塑著我們的世界,數(shù)據(jù)驅(qū)動(dòng)著全球數(shù)字生態(tài)系統(tǒng),AI技術(shù)則揭示了數(shù)據(jù)中的模式。智能手機(jī),智能家居以及智慧城市在影響著我們生活和交互方式,AI系統(tǒng)越來越多用于公司招聘、醫(yī)療診斷和司法裁決。這是一個(gè)烏托邦時(shí)代還是反烏托邦時(shí)代,全看你怎么看。

2019-12-04 09:03:27 588

588 你對(duì)AI有什么印象,沒有感情、不會(huì)犯錯(cuò),還是公正客觀?但總之,AI是不食人間煙火的,既不會(huì)閃耀人性的光輝,也不存在“七宗罪”。實(shí)際上,AI并非那么沒有人性,不過這并非一件好事。AI獲得智能的同時(shí),也學(xué)會(huì)了人類的“歧視”與“偏見”。

2019-12-25 15:25:41 657

657 人工智能在各個(gè)領(lǐng)域似乎被吹捧為在各種應(yīng)用領(lǐng)域?qū)崿F(xiàn)自動(dòng)化決策的“圣杯”,被認(rèn)為可以做得比人類更好或更快,但事實(shí)上人工智能面臨了一個(gè)大挑戰(zhàn)就是算法偏見。

2019-12-31 08:45:07 3033

3033 隨著人工智能繼續(xù)進(jìn)軍企業(yè),許多IT專業(yè)人士開始對(duì)其使用的系統(tǒng)中可能存在的AI偏見表示擔(dān)憂。一份來自DataRobot的最新報(bào)告發(fā)現(xiàn),美國和英國近一半的人工智能專業(yè)人士“非常”擔(dān)心人工智能的偏見。

2020-01-20 17:35:00 1655

1655 谷歌剛剛宣布,其使用AI工具的“谷歌云服務(wù)”將不再根據(jù)性別來標(biāo)記人們。AI工具通過將人的圖像標(biāo)記為“男人”或“女人”來識(shí)別個(gè)人的性別。盡管這是一種針對(duì)機(jī)器學(xué)習(xí)模型的訓(xùn)練方法,但Google仍在使用它以避免性別偏見。

2020-03-20 09:56:04 989

989 不公正的數(shù)據(jù)集是偏見的土壤如果用于訓(xùn)練機(jī)器學(xué)習(xí)算法的數(shù)據(jù)集無法代表客觀現(xiàn)實(shí)情況,那么這一算法的應(yīng)用結(jié)果往往也帶有對(duì)特定群體的歧視和偏見。

2020-03-30 11:45:27 1907

1907 根據(jù)伯恩霍爾茨的說法,所有數(shù)據(jù)都是有偏見的,因?yàn)槭侨藗冊(cè)谑占瘮?shù)據(jù)。她強(qiáng)調(diào)說:“而且我們正在將偏見建立到數(shù)據(jù)科學(xué)中,然后將這些工具導(dǎo)出到偏見系統(tǒng)中。” “你猜怎么著?問題變得越來越嚴(yán)重。因此,讓我們停止這樣做。”

2020-04-09 14:44:16 2107

2107 對(duì)于人類和機(jī)器而言,至關(guān)重要的原則是避免偏見并因此防止歧視。AI系統(tǒng)中的偏差主要發(fā)生在數(shù)據(jù)或算法模型中。在開發(fā)我們可以信賴的AI系統(tǒng)的過程中,至關(guān)重要的是使用無偏數(shù)據(jù)開發(fā)和訓(xùn)練這些系統(tǒng),并開發(fā)易于解釋的算法。

2020-04-11 09:57:20 2538

2538 現(xiàn)在,我擔(dān)心我們會(huì)在人工智能方面走類似的道路。市場(chǎng)上的AI技術(shù)開始顯示有意和無意的偏見-從按人口統(tǒng)計(jì)或背景將候選人簡歷分組的人才搜索技術(shù)到不敏感的自動(dòng)填充搜索算法。

2020-04-14 09:59:46 2131

2131 如何解決AI應(yīng)用中出現(xiàn)的“數(shù)據(jù)孤島”和用戶隱私難題?國際人工智能聯(lián)合會(huì)議2019理事會(huì)主席、微眾銀行首席人工智能官楊強(qiáng)給出了解決方案:“聯(lián)邦學(xué)習(xí)或是解決這兩個(gè)核心問題的同一個(gè)解決思路。”

2020-04-15 17:33:20 5071

5071 人工智能在招聘中的應(yīng)用有望將偏見最小化。

2020-04-17 15:53:06 1141

1141 通過與弗吉尼亞大學(xué)的研究人員合作,Salesforce 提出了有助于減輕 AI 性別偏見的新方法。 通常情況下,研究人員需要為 AI 模型投喂許多單次來展開訓(xùn)練,但其中不可避免地會(huì)摻雜一些或隱性、或顯性的性別偏見。 然后在執(zhí)行語言翻譯或其它預(yù)測(cè)任務(wù)的時(shí)候,這些 AI 也會(huì)沾染上一些不良習(xí)性。

2020-07-05 09:31:48 2923

2923

以Allegheny家庭篩選工具為例。它旨在預(yù)測(cè)哪些福利兒童可能會(huì)受到養(yǎng)父母虐待的威脅。但是,此解決方案的最初推出面臨一些挑戰(zhàn)。當(dāng)?shù)氐娜祟惙?wù)部承認(rèn)該工具可能存在種族和收入偏見。

2020-07-07 14:26:10 2347

2347 親自處理AI偏見的人表示自己的偏見已減少。例如,愛立信使用情景規(guī)劃方法來挑戰(zhàn)整個(gè)組織的戰(zhàn)略思維,并在戰(zhàn)略制定過程的多個(gè)階段測(cè)試和篩選偏見(Gartner 在“研發(fā)決策的常見認(rèn)知偏見”中對(duì)此進(jìn)行了描述)。

2020-08-12 16:28:19 1454

1454 其中一份報(bào)告?zhèn)戎赜谌绾未_保安全,透明和問責(zé)制,防止偏見和歧視,促進(jìn)社會(huì)和環(huán)境責(zé)任以及確保尊重基本權(quán)利。報(bào)告的作者伊班·加西亞·布蘭科(IbánGarcíadel Blanco)說:“公民是這項(xiàng)建議的核心。”

2020-10-24 10:06:03 3454

3454 !然而,這完全是萬無一失的還是不偏不倚的?這種現(xiàn)代科技能像人類一樣容易產(chǎn)生偏見嗎? 偏差風(fēng)險(xiǎn)因業(yè)務(wù)、行業(yè)和組織而異。他們可以通過多種方式進(jìn)入人工智能系統(tǒng)。例如,它可以被有意地通過隱形攻擊引入人工智能系統(tǒng),也可以

2021-02-26 12:08:40 3683

3683 距離全球被喬治·弗洛伊德(George Floyd)被跪害慘案震驚僅僅過了三個(gè)月。在美國的集體記憶中,白人警官跪在黑人公民身上8分鐘46秒的畫面仍然歷歷在目。

2020-11-05 14:59:35 1728

1728 12月4日消息:美國司法部周四指控社交媒體巨頭Facebook歧視美國員工,稱該公司在一項(xiàng)新的訴訟中優(yōu)先雇用臨時(shí)工,包括那些持有H-1B簽證的人。

2020-12-04 10:35:46 1617

1617 法國私營部門的AI用戶告訴FRA,識(shí)別AI中的歧視非常復(fù)雜,“因?yàn)槟承┓N族中某些疾病的發(fā)病率更高。預(yù)測(cè)要考慮到性別,種族,遺傳特征。但這不是歧視或侵犯人權(quán)。”

2020-12-16 09:22:50 1608

1608 在我們的世界里,算法無處不在,偏見也是一樣。從社會(huì)媒體新聞的提供到流式媒體服務(wù)的推薦到線上購物,計(jì)算機(jī)算法,尤其是機(jī)器學(xué)習(xí)算法,已經(jīng)滲透到我們?nèi)粘I畹拿恳粋€(gè)角落。至于偏見,我們只需要參考 2016 年美國大選就可以知道,偏見是怎樣在明處與暗處影響著我們的社會(huì)。

2020-12-25 19:12:28 1358

1358 隨著人工智能技術(shù)研究不斷推薦,由算法生成的藝術(shù)作品的受歡迎程度也在持續(xù)增長。從創(chuàng)作繪畫到發(fā)明新的藝術(shù)風(fēng)格,基于人工智能的生成藝術(shù)已經(jīng)在一系列的應(yīng)用中展示。

2020-12-29 14:30:01 2543

2543 本篇連載文章中,我們將討論哪些AI應(yīng)用能真正從這種方法中受益。

2022-02-11 11:11:24 1004

1004 ? 據(jù)本周四披露的法庭文件顯示,美國司法部正在調(diào)查 SpaceX 公司是否在雇傭中歧視非美國公民。文件還表示,SpaceX 正在阻撓法院傳喚,拒絕提供信息。 此前,美國司法部的移民和雇員權(quán)利部門收到

2021-02-01 09:03:00 1339

1339 最近我接受了一個(gè)采訪,分析了在AI時(shí)代,科技人才的涵養(yǎng)如何被二次定義,AI與人的關(guān)系如何被二次校準(zhǔn)。AI正推動(dòng)文藝二次復(fù)興,讓人可以再一次找到生命意義,展開哲學(xué)的思索——你為什么而存在? “2020

2021-02-04 14:08:14 2360

2360 人臉辨識(shí)也會(huì)引起種族歧視?美國國家標(biāo)準(zhǔn)暨技術(shù)研究院(NIST)研究近兩百種臉部算法后,發(fā)現(xiàn)人臉辨識(shí)系統(tǒng)在辨別非白人時(shí)會(huì)產(chǎn)生較大的誤差,因應(yīng)人臉辨識(shí)被普及用在執(zhí)法與身分辨識(shí)驗(yàn)證,這項(xiàng)發(fā)現(xiàn)很有可能會(huì)引發(fā)應(yīng)用上的疑慮。

2021-02-18 09:31:38 1937

1937 日本富士通的一支研究團(tuán)隊(duì)利用有向無環(huán)圖模型(DAG)研究AI生成藝術(shù)中的偏見現(xiàn)象。該研究發(fā)現(xiàn),目前的AI模型在藝術(shù)創(chuàng)作時(shí)展現(xiàn)出對(duì)特定流派、創(chuàng)作風(fēng)格、種族、思想運(yùn)動(dòng)等因素的明顯傾向性。 據(jù)分析,這種

2021-04-19 14:33:16 2390

2390

本文介紹了EPON在無線通信體系中的網(wǎng)絡(luò)結(jié)構(gòu)及工作原理,分析了這種接入方式如何解決小區(qū)切換及微移動(dòng)問題,最后探討了這種應(yīng)用的特點(diǎn)及優(yōu)勢(shì)。

2021-06-14 11:49:00 3539

3539

得益于神經(jīng)機(jī)器翻譯 (NMT) 的進(jìn)步,譯文更加自然流暢,但與此同時(shí),這些譯文也反映出訓(xùn)練數(shù)據(jù)存在社會(huì)偏見和刻板印象。因此,Google 持續(xù)致力于遵循 AI 原則,開發(fā)創(chuàng)新技術(shù),減少機(jī)器翻譯中

2021-08-24 10:14:42 3569

3569 人工智能風(fēng)險(xiǎn)管理旨在最大限度地減少人工智能的負(fù)面影響,包括對(duì)公民自由和權(quán)利的威脅等。而在談?wù)撊斯ぶ悄茱L(fēng)險(xiǎn)時(shí),“偏見”是一個(gè)重要話題。

2022-04-17 10:21:12 1963

1963 了解如何在訓(xùn)練您的 AI 驅(qū)動(dòng)系統(tǒng)時(shí)避免數(shù)據(jù)集、關(guān)聯(lián)、自動(dòng)化和其他類型的偏見。 科技行業(yè)對(duì)人工智能的使用越來越興奮,因?yàn)樗_辟了新的引人入勝的體驗(yàn),并為企業(yè)家和最終用戶帶來了前所未有的效率。但是

2022-07-30 11:19:58 8187

8187 大規(guī)模語言模型(LMs)已經(jīng)成為了現(xiàn)在自然語言處理的關(guān)鍵技術(shù),但由于訓(xùn)練語料中常帶有主觀的性別偏見、歧視等,在大模型的使用過程中,它們時(shí)常會(huì)被放大,因此探測(cè)和緩解數(shù)據(jù)中的性別偏見變得越來越重要。

2023-02-10 13:49:39 1407

1407 當(dāng)你老了,科技AI你。

2023-03-12 18:21:55 931

931 TechCrunch獲取的文件要求,科技企業(yè)需保證其服務(wù)或產(chǎn)品“杜絕所有形式的偏見與歧視”。雖然此文件無法律約束力,但印度信息技術(shù)部副部長錢德拉塞卡爾坦言,這個(gè)通知預(yù)示著未來監(jiān)管趨向。

2024-03-04 17:05:17 1041

1041 這些偏見特征可能導(dǎo)致模型在沒有明確提及這些偏見的情況下,系統(tǒng)性地歪曲其推理過程,從而產(chǎn)生不忠實(shí)(unfaithful)的推理。

2024-03-22 10:37:35 877

877

如何解決ChatGPT Plus信用卡支付被拒絕的問題 在嘗試使用信用卡支付ChatGPT Plus服務(wù)時(shí),如果支付被拒絕,可能是由于以下幾個(gè)核心原因:賬戶余額不足、網(wǎng)絡(luò)環(huán)境問題、賬戶被列入高風(fēng)險(xiǎn)

2024-08-07 16:22:44 3850

3850

個(gè)人隱私得到保護(hù),防止數(shù)據(jù)泄露和濫用。 對(duì)于敏感數(shù)據(jù)的處理,如生物識(shí)別信息或健康記錄,需要遵循更嚴(yán)格的隱私和安全標(biāo)準(zhǔn)。 偏見與歧視 AI大模型可能會(huì)從訓(xùn)練數(shù)據(jù)中繼承偏見,導(dǎo)致對(duì)某些群體或個(gè)體產(chǎn)生不公平的決策。 這需要在模型訓(xùn)

2024-10-23 15:13:00 3092

3092 ,大語言模型(LLM)正悄無聲息地傳播全球各地的刻板印象。從性別歧視、文化偏見,到語言不平等,AI正在把人類的“偏見行李”打包、升級(jí),并以看似權(quán)威的方式輸出到世界

2025-08-04 13:43:19 1251

1251

電子發(fā)燒友App

電子發(fā)燒友App

評(píng)論