在幾十年研究之后,人類仍然無法復(fù)制出人腦的超快

計算速度。目前,

計算機科學(xué)家可以利用的最強大工具是

神經(jīng)網(wǎng)絡(luò)。這樣的大型

計算機網(wǎng)絡(luò)能通過

訓(xùn)練去解決復(fù)雜問題,而機制類似于人類的中樞

神經(jīng)系統(tǒng),即利用不同層次的

神經(jīng)元解決問題的不同部分,最終合并為適當(dāng)?shù)拇鸢浮?/div>

2016-12-08 21:48:19 1279

1279 是該Facebook上一代產(chǎn)品的2倍,使得訓(xùn)練規(guī)模相當(dāng)于原來2倍的神經(jīng)網(wǎng)絡(luò)的速度提高1倍。BigSur是第一款針對機器學(xué)習(xí)、人工智能研究開發(fā)的開放源代碼計算系統(tǒng),F(xiàn)acebook將把設(shè)計材料提交給開放

2018-06-11 08:20:23

神經(jīng)網(wǎng)絡(luò)的發(fā)展可以追溯到二戰(zhàn)時期,那時候先輩們正想著如何用人類的方式去存儲和處理信息,于是他們開始構(gòu)建計算系統(tǒng)。由于當(dāng)時計算機機器和技術(shù)的發(fā)展限制,這一技術(shù)并沒有得到廣泛的關(guān)注和應(yīng)用。幾十年來

2018-06-05 10:11:50

第1章 概述 1.1 人工神經(jīng)網(wǎng)絡(luò)研究與發(fā)展 1.2 生物神經(jīng)元 1.3 人工神經(jīng)網(wǎng)絡(luò)的構(gòu)成 第2章人工神經(jīng)網(wǎng)絡(luò)基本模型 2.1 MP模型 2.2 感知器模型 2.3 自適應(yīng)線性

2012-03-20 11:32:43

將神經(jīng)網(wǎng)絡(luò)移植到STM32最近在做的一個項目需要用到網(wǎng)絡(luò)進行擬合,并且將擬合得到的結(jié)果用作控制,就在想能不能直接在單片機上做神經(jīng)網(wǎng)絡(luò)計算,這樣就可以實時計算,不依賴于上位機。所以要解決的主要是兩個

2022-01-11 06:20:53

學(xué)習(xí)技術(shù)無疑為其指明了道路。以知名品牌為首的汽車制造業(yè)正在深度學(xué)習(xí)神經(jīng)網(wǎng)絡(luò)技術(shù)上進行投資,并向先進的計算企業(yè)、硅谷等技術(shù)引擎及學(xué)術(shù)界看齊。在中國,百度一直在此技術(shù)上保持領(lǐng)先。百度計劃在 2019 年將

2017-12-21 17:11:34

CV之YOLOv3:深度學(xué)習(xí)之計算機視覺神經(jīng)網(wǎng)絡(luò)Yolov3-5clessses訓(xùn)練自己的數(shù)據(jù)集全程記錄(第二次)——Jason niu

2018-12-24 11:52:25

CV之YOLOv3:深度學(xué)習(xí)之計算機視覺神經(jīng)網(wǎng)絡(luò)Yolov3-5clessses訓(xùn)練自己的數(shù)據(jù)集全程記錄

2018-12-24 11:51:47

CV之YOLO:深度學(xué)習(xí)之計算機視覺神經(jīng)網(wǎng)絡(luò)tiny-yolo-5clessses訓(xùn)練自己的數(shù)據(jù)集全程記錄

2018-12-24 11:50:57

)EEP-TPU算法編譯神經(jīng)網(wǎng)絡(luò)算法的開發(fā)工作通常在X86架構(gòu)的服務(wù)器上完成,而EEP-TPU則是一種與X86完全不同的計算架構(gòu)。因此,上述訓(xùn)練所得的神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)和權(quán)重參數(shù)文件,需要按照交叉編譯的方式,在X86架構(gòu)

2020-05-18 17:13:24

,也正積極的為其開發(fā)專用的 AI 硬件,用于自己的云產(chǎn)品和邊緣計算產(chǎn)品環(huán)境中。

神經(jīng)形態(tài)芯片 方面也有著一些發(fā)展,這是一種專門為神經(jīng)網(wǎng)絡(luò)設(shè)計的計算機架構(gòu)。英特爾在神經(jīng)形態(tài)計算領(lǐng)域處于領(lǐng)先地位,已經(jīng)開發(fā)

2024-03-21 15:19:45

我在MATLAB中進行了神經(jīng)網(wǎng)絡(luò)模型訓(xùn)練,然后將訓(xùn)練好的模型的閾值和權(quán)值導(dǎo)出來,移植到STM32F407單片機上進行計算,但是在單片機上的計算結(jié)果和在MATLAB上的不一樣,一直找不到原因。代碼在

2020-06-16 11:14:28

習(xí)神經(jīng)神經(jīng)網(wǎng)絡(luò),對于神經(jīng)網(wǎng)絡(luò)的實現(xiàn)是如何一直沒有具體實現(xiàn)一下:現(xiàn)看到一個簡單的神經(jīng)網(wǎng)絡(luò)模型用于訓(xùn)練的輸入數(shù)據(jù):對應(yīng)的輸出數(shù)據(jù):我們這里設(shè)置:1:節(jié)點個數(shù)設(shè)置:輸入層、隱層、輸出層的節(jié)點

2021-08-18 07:25:21

模型、更多神經(jīng)網(wǎng)絡(luò)模型、機器學(xué)習(xí)的步驟:訓(xùn)練與預(yù)測、訓(xùn)練的兩階段:正向推演與反向傳播、以TensoRFlow + Excel表達(dá)訓(xùn)練流程以及AI普及化教育之路。 7.【AI學(xué)習(xí)】第4篇--Python

2020-11-05 17:55:48

模型、更多神經(jīng)網(wǎng)絡(luò)模型、機器學(xué)習(xí)的步驟:訓(xùn)練與預(yù)測、訓(xùn)練的兩階段:正向推演與反向傳播、以TensoRFlow + Excel表達(dá)訓(xùn)練流程以及AI普及化教育之路。 7.【AI學(xué)習(xí)】第4篇--Python

2020-11-26 11:57:36

`本篇主要介紹:人工神經(jīng)網(wǎng)絡(luò)的起源、簡單神經(jīng)網(wǎng)絡(luò)模型、更多神經(jīng)網(wǎng)絡(luò)模型、機器學(xué)習(xí)的步驟:訓(xùn)練與預(yù)測、訓(xùn)練的兩階段:正向推演與反向傳播、以TensorFlow + Excel表達(dá)訓(xùn)練流程以及AI普及化教育之路。`

2020-11-05 17:48:39

的神經(jīng)網(wǎng)絡(luò)編程,想基于此開發(fā)板,進行神經(jīng)網(wǎng)絡(luò)的學(xué)習(xí),訓(xùn)練和測試神經(jīng)網(wǎng)絡(luò)。項目計劃:1.基于官方的文檔及資料,熟悉此開發(fā)板。2.測試官方demo,學(xué)習(xí)ARM內(nèi)核和FPGA如何協(xié)調(diào)工作。3.基于自己最近

2019-01-09 14:48:59

,得到訓(xùn)練參數(shù)2、利用開發(fā)板arm與FPGA聯(lián)合的特性,在arm端實現(xiàn)圖像預(yù)處理已經(jīng)卷積核神經(jīng)網(wǎng)絡(luò)的池化、激活函數(shù)和全連接,在FPGA端實現(xiàn)卷積運算3、對整個系統(tǒng)進行調(diào)試。4、在基本實現(xiàn)系統(tǒng)的基礎(chǔ)上

2018-12-19 11:37:22

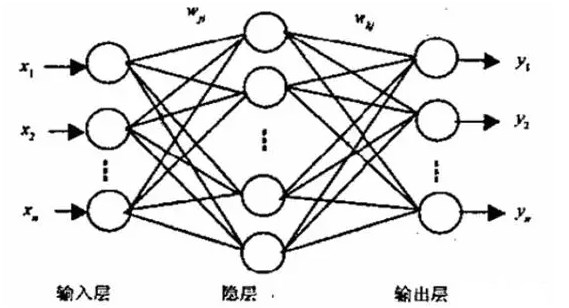

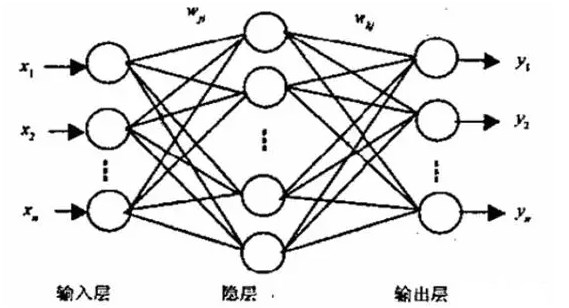

神經(jīng)網(wǎng)絡(luò)的計算。對于多層多節(jié)點的神經(jīng)網(wǎng)絡(luò),我們可以使用矩陣乘法來表示。在上面的神經(jīng)網(wǎng)絡(luò)中,我們將權(quán)重作為一個矩陣,將第一層的輸入作為另一個矩陣,兩個矩陣相乘,得到的矩陣恰好為第二層的輸入。對于python

2019-03-03 22:10:19

采集處理和快速神經(jīng)網(wǎng)絡(luò)計算的算力要求,板載HDMI與USB接口、外置512M的DDR3內(nèi)存也滿足作品進行圖像處理并輸入輸出的硬件平臺要求。作品將充分發(fā)掘PYNQ開發(fā)板的板載資源的應(yīng)用潛力,并以一輛小車

2019-03-02 23:10:52

AI芯片不僅包括深度學(xué)細(xì)AI加速器,還有另外一個主要列別:類腦芯片。類腦芯片是模擬人腦神經(jīng)網(wǎng)絡(luò)架構(gòu)的芯片。它結(jié)合微電子技術(shù)和新型神經(jīng)形態(tài)器件,模仿人腦神經(jīng)系統(tǒng)機選原理進行設(shè)計,實現(xiàn)類似人腦的超低

2025-09-17 16:43:19

的RK1808S——AI加速棒,將兩者放入進行對比,豈不美哉?NCS2(Neural Compute Stick 2)顧名思義,是用來計算神經(jīng)網(wǎng)絡(luò)的一個加速棒,而且是第二代。它其實外形像一個U盤一樣。通體

2020-07-27 17:28:00

(Smart Vision Platform)特性及卷積神經(jīng)網(wǎng)絡(luò)模型,實現(xiàn)AI計算機視覺基礎(chǔ)功能,如人臉檢測識別、車牌識別等應(yīng)用場景。Taurus套件Pegasus套件是WiFi-IoT控制和執(zhí)行

2021-03-31 11:52:28

元,它決定了該輸入向量在地位空間中的位置。SOM神經(jīng)網(wǎng)絡(luò)訓(xùn)練的目的就是為每個輸出層神經(jīng)元找到合適的權(quán)向量,以達(dá)到保持拓?fù)浣Y(jié)構(gòu)的目的。SOM的訓(xùn)練過程其實很簡單,就是接收到一個訓(xùn)練樣本后,每個輸出層神經(jīng)

2019-07-21 04:30:00

這個網(wǎng)絡(luò)輸入和相應(yīng)的輸出來“訓(xùn)練”這個網(wǎng)絡(luò),網(wǎng)絡(luò)根據(jù)輸入和輸出不斷地調(diào)節(jié)自己的各節(jié)點之間的權(quán)值來滿足輸入和輸出。這樣,當(dāng)訓(xùn)練結(jié)束后,我們給定一個輸入,網(wǎng)絡(luò)便會根據(jù)自己已調(diào)節(jié)好的權(quán)值計算出一個輸出。這就是神經(jīng)網(wǎng)絡(luò)的簡單原理。 神經(jīng)網(wǎng)絡(luò)原理下載-免費

2008-06-19 14:40:42

人工神經(jīng)網(wǎng)絡(luò)(Artificial Neural Network,ANN)是一種類似生物神經(jīng)網(wǎng)絡(luò)的信息處理結(jié)構(gòu),它的提出是為了解決一些非線性,非平穩(wěn),復(fù)雜的實際問題。那有哪些辦法能實現(xiàn)人工神經(jīng)網(wǎng)絡(luò)呢?

2019-08-01 08:06:21

簡單理解LSTM神經(jīng)網(wǎng)絡(luò)

2021-01-28 07:16:57

AlexNet到MobileNetAlexnetAlexNet是首次把卷積神經(jīng)網(wǎng)絡(luò)引入計算機視覺領(lǐng)域并取得突破性成績的模型。AlexNet有Alex Krizhevsky、llya Sutskever

2018-05-08 15:57:47

優(yōu)化神經(jīng)網(wǎng)絡(luò)訓(xùn)練方法有哪些?

2022-09-06 09:52:36

速度增長,需要新的硬件和軟件創(chuàng)新來繼續(xù)平衡內(nèi)存,計算效率和帶寬。神經(jīng)網(wǎng)絡(luò) (NN) 的訓(xùn)練對于 AI 能力的持續(xù)提升至關(guān)重要,今天標(biāo)志著這一演變的激動人心的一步,Arm、英特爾和 NVIDIA 聯(lián)合

2022-09-15 15:15:46

數(shù)據(jù)與干凈的EEG數(shù)據(jù)構(gòu)成訓(xùn)練數(shù)據(jù),并且分成訓(xùn)練、驗證和測試數(shù)據(jù)集。

繪制有噪聲EEG數(shù)據(jù)與干凈的EEG數(shù)據(jù)

顯然,傳統(tǒng)的任何算法很難將EEG數(shù)據(jù)從噪聲中濾出來。

定義神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu),之所以選擇長短期記憶

2024-04-30 20:40:32

卷積神經(jīng)網(wǎng)絡(luò)(CNN)究竟是什么,鑒于神經(jīng)網(wǎng)絡(luò)在工程上經(jīng)歷了曲折的歷史,您為什么還會在意它呢? 對于這些非常中肯的問題,我們似乎可以給出相對簡明的答案。

2019-07-17 07:21:50

。神經(jīng)網(wǎng)絡(luò)的思想起源于1943年McCulloch 和 Pitts 提出的神經(jīng)元模型[19],簡稱 MCP 神經(jīng)元模 型。它是利用計算機來模擬人的神經(jīng)元反應(yīng)的過 程,具有開創(chuàng)性意義。此模型將神經(jīng)元反應(yīng)簡化

2022-08-02 10:39:39

復(fù)雜數(shù)據(jù)中提取特征的強大工具。例如,這包括音頻信號或圖像中的復(fù)雜模式識別。本文討論了 CNN 相對于經(jīng)典線性規(guī)劃的優(yōu)勢。后續(xù)文章“訓(xùn)練卷積神經(jīng)網(wǎng)絡(luò):什么是機器學(xué)習(xí)?——第2部分”將討論如何訓(xùn)練CNN

2023-02-23 20:11:10

為提升識別準(zhǔn)確率,采用改進神經(jīng)網(wǎng)絡(luò),通過Mnist數(shù)據(jù)集進行訓(xùn)練。整體處理過程分為兩步:圖像預(yù)處理和改進神經(jīng)網(wǎng)絡(luò)推理。圖像預(yù)處理主要根據(jù)圖像的特征,將數(shù)據(jù)處理成規(guī)范的格式,而改進神經(jīng)網(wǎng)絡(luò)推理主要用于輸出結(jié)果。 整個過程分為兩個步驟:圖像預(yù)處理和神經(jīng)網(wǎng)絡(luò)推理。需要提前安裝Tengine框架,

2021-12-23 08:07:33

本帖欲分享在Ubuntu20.04系統(tǒng)中訓(xùn)練神經(jīng)網(wǎng)絡(luò)模型的一些經(jīng)驗。我們采用jupyter notebook作為開發(fā)IDE,以TensorFlow2為訓(xùn)練框架,目標(biāo)是訓(xùn)練一個手寫數(shù)字識別的神經(jīng)網(wǎng)絡(luò)

2025-10-22 07:03:26

η ∈(0,1)代表學(xué)習(xí)速率。 由于BP 神經(jīng)網(wǎng)絡(luò)算法的收斂速度慢,優(yōu)化的目標(biāo)函數(shù)非常復(fù)雜,所以需要優(yōu)化學(xué)習(xí)速率。三層感知器的BP 學(xué)習(xí)算法權(quán)值調(diào)整計算公式為: 將每個加速度傳感器中每個軸的數(shù)據(jù)

2018-11-13 16:04:45

基于光學(xué)芯片的神經(jīng)網(wǎng)絡(luò)訓(xùn)練解析,不看肯定后悔

2021-06-21 06:33:55

如何用stm32cube.ai簡化人工神經(jīng)網(wǎng)絡(luò)映射?如何使用stm32cube.ai部署神經(jīng)網(wǎng)絡(luò)?

2021-10-11 08:05:42

已經(jīng)有很多關(guān)于將人工智能用于日益智能的車輛的文章。但是,您如何將在服務(wù)器群上開發(fā)的神經(jīng)網(wǎng)絡(luò) (NN) 壓縮到量產(chǎn)汽車中資源受限的嵌入式硬件中呢?本文探討了我們應(yīng)該如何授權(quán)汽車生產(chǎn) AI 研發(fā)工程師在

2021-12-23 06:30:50

原文鏈接:http://tecdat.cn/?p=5725 神經(jīng)網(wǎng)絡(luò)是一種基于現(xiàn)有數(shù)據(jù)創(chuàng)建預(yù)測的計算系統(tǒng)。如何構(gòu)建神經(jīng)網(wǎng)絡(luò)?神經(jīng)網(wǎng)絡(luò)包括:輸入層:根據(jù)現(xiàn)有數(shù)據(jù)獲取輸入的層隱藏層:使用反向傳播優(yōu)化輸入變量權(quán)重的層,以提高模型的預(yù)測能力輸出層:基于輸入和隱藏層的數(shù)據(jù)輸出預(yù)測

2021-07-12 08:02:11

訓(xùn)練一個神經(jīng)網(wǎng)絡(luò)并移植到Lattice FPGA上,通常需要開發(fā)人員既要懂軟件又要懂?dāng)?shù)字電路設(shè)計,是個不容易的事。好在FPGA廠商為我們提供了許多工具和IP,我們可以在這些工具和IP的基礎(chǔ)上做

2020-11-26 07:46:03

現(xiàn)有的圖數(shù)據(jù)規(guī)模極大,導(dǎo)致時序圖神經(jīng)網(wǎng)絡(luò)的訓(xùn)練需要格外長的時間,因此使用多GPU進行訓(xùn)練變得成為尤為重要,如何有效地將多GPU用于時序圖神經(jīng)網(wǎng)絡(luò)訓(xùn)練成為一個非常重要的研究議題。本文提供了兩種方式來

2022-09-28 10:37:20

人工神經(jīng)網(wǎng)絡(luò)在AI中具有舉足輕重的地位,除了找到最好的神經(jīng)網(wǎng)絡(luò)模型和訓(xùn)練數(shù)據(jù)集之外,人工神經(jīng)網(wǎng)絡(luò)的另一個挑戰(zhàn)是如何在嵌入式設(shè)備上實現(xiàn)它,同時優(yōu)化性能和功率效率。 使用云計算并不總是一個選項,尤其是當(dāng)

2021-11-09 08:06:27

當(dāng)訓(xùn)練好的神經(jīng)網(wǎng)絡(luò)用于應(yīng)用的時候,權(quán)值是不是不能變了????就是已經(jīng)訓(xùn)練好的神經(jīng)網(wǎng)絡(luò)是不是相當(dāng)于得到一個公式了,權(quán)值不能變了

2016-10-24 21:55:22

行特征選擇工程。例如,假設(shè)你只有 20 個訓(xùn)練樣本,那么使用對數(shù)幾率回歸還是神經(jīng)網(wǎng)絡(luò)可能無關(guān)緊要;此時人為的特征選擇工程比起選擇哪種算法將產(chǎn)生更大的影響。但如果你有 100 萬個樣本數(shù)據(jù),我會贊成你

2018-11-30 16:45:03

用于計算機視覺訓(xùn)練的圖像數(shù)據(jù)集

2021-02-26 07:35:08

的收斂速度和識別率【關(guān)鍵詞】:粒子群優(yōu)化;;模糊神經(jīng)網(wǎng)絡(luò);;語音識別【DOI】:CNKI:SUN:SSJS.0.2010-06-018【正文快照】:1引言語音識別是新一代智能計算機的重要組成部分,對它

2010-05-06 09:05:35

我在matlab中訓(xùn)練好了一個神經(jīng)網(wǎng)絡(luò)模型,想在labview中調(diào)用,請問應(yīng)該怎么做呢?或者labview有自己的神經(jīng)網(wǎng)絡(luò)工具包嗎?

2018-07-05 17:32:32

視覺任務(wù)中,并取得了巨大成功。然而,由于存儲空間和功耗的限制,神經(jīng)網(wǎng)絡(luò)模型在嵌入式設(shè)備上的存儲與計算仍然是一個巨大的挑戰(zhàn)。前面幾篇介紹了如何在嵌入式AI芯片上部署神經(jīng)網(wǎng)絡(luò):【嵌入式AI開發(fā)】篇五|實戰(zhàn)篇一:STM32cubeIDE上部署神經(jīng)網(wǎng)絡(luò)之pytorch搭建指紋識別模型.onnx...

2021-12-14 07:35:25

隱藏技術(shù): 一種基于前沿神經(jīng)網(wǎng)絡(luò)理論的新型人工智能處理器 Copy東京理工大學(xué)的研究人員開發(fā)了一種名為“ Hiddenite”的新型加速器芯片,該芯片可以在計算稀疏“隱藏神經(jīng)網(wǎng)絡(luò)”時達(dá)到最高的精度

2022-03-17 19:15:13

,非局部運算將某一處位置的響應(yīng)作為輸入特征映射中所有位置的特征的加權(quán)和來進行計算。我們將非局部運算作為一個高效、簡單和通用的模塊,用于獲取深度神經(jīng)網(wǎng)絡(luò)的長時記憶。我們提出的非局部運算是計算機視覺中經(jīng)

2018-11-12 14:52:50

人工神經(jīng)網(wǎng)絡(luò)——第六代計算機的實現(xiàn)-1992-7-科學(xué)普及出版社-周繼成。

2016-04-12 11:08:59 0

0 神經(jīng)網(wǎng)絡(luò)技術(shù)在計算機網(wǎng)絡(luò)通信中的應(yīng)用,下來看看

2016-07-20 16:51:51 13

13 關(guān)鍵字:感知計算機 編程模型 傳感器網(wǎng)絡(luò) 神經(jīng)網(wǎng)絡(luò) IBM Research 在國際神經(jīng)網(wǎng)絡(luò)聯(lián)席會議(IJCNN)上披露了一種新的感知計算機架構(gòu)和編程模型,其靈感來自人類大腦。新的Corelet架構(gòu)

2017-09-14 16:58:59 2

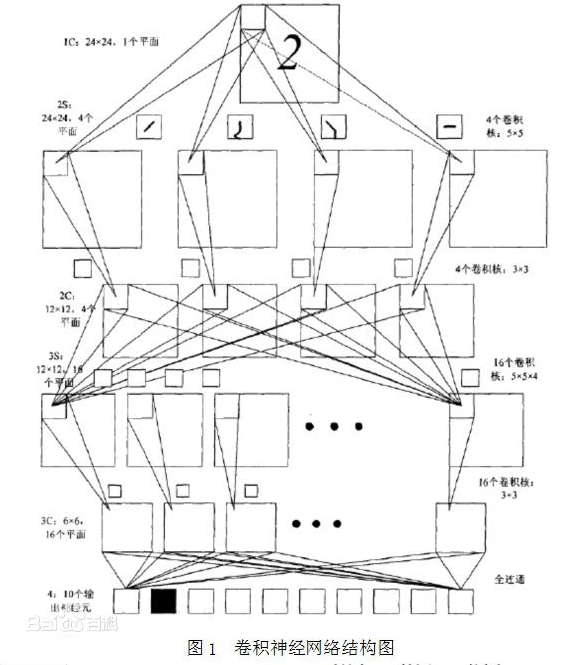

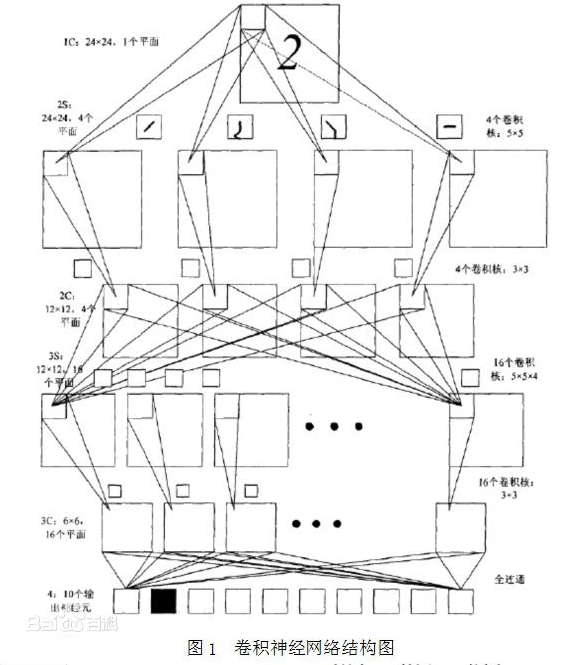

2 上一次我們用了單隱層的神經(jīng)網(wǎng)絡(luò),效果還可以改善,這一次就使用CNN。 卷積神經(jīng)網(wǎng)絡(luò) 上圖演示了卷積操作 LeNet-5式的卷積神經(jīng)網(wǎng)絡(luò),是計算機視覺領(lǐng)域近期取得的巨大突破的核心。卷積層和之前的全連接

2017-11-16 11:45:07 3988

3988 神經(jīng)網(wǎng)絡(luò)模型的每一類學(xué)習(xí)過程通常被歸納為一種訓(xùn)練算法。訓(xùn)練的算法有很多,它們的特點和性能各不相同。問題的抽象人們把神經(jīng)網(wǎng)絡(luò)的學(xué)習(xí)過程轉(zhuǎn)化為求損失函數(shù)f的最小值問題。一般來說,損失函數(shù)包括誤差項和正則

2017-11-16 15:30:54 13897

13897 今日,Imagination Technologies宣布推出首套 PowerVR CLDNN開發(fā)工具 (SDK),可用來在PowerVR GPU 上開發(fā)神經(jīng)網(wǎng)絡(luò)應(yīng)用程序。這一神經(jīng)網(wǎng)絡(luò) SDK 可使

2018-01-26 17:05:42 3580

3580

在上個月的Train AI會議上,特斯拉AI 及計算機視覺部門總監(jiān)談了自己對當(dāng)前Autopilot 發(fā)展的見解,他表示自己目前正利用特斯拉無人車隊的大量數(shù)據(jù),試圖通過訓(xùn)練特斯拉的神經(jīng)網(wǎng)絡(luò)模型,來改善Autopilot的自動駕駛能力。

2018-06-13 09:34:59 3782

3782 該團隊在麻省理工學(xué)院的計算機科學(xué)和人工智能實驗室 (Computer Science and Artificial Intelligence Lab) 開展了這項研究,共開發(fā)出了三個卷積神經(jīng)網(wǎng)絡(luò)

2018-09-12 14:19:35 4659

4659 Habana已經(jīng)開發(fā)了兩款自己的AI芯片,即Habana Gaudi和Habana Goya(如圖)。前者是高度專門化的神經(jīng)網(wǎng)絡(luò)訓(xùn)練芯片,而后者是用于推理的處理器,在主動部署中使用神經(jīng)網(wǎng)絡(luò)。

2020-02-06 15:06:10 2653

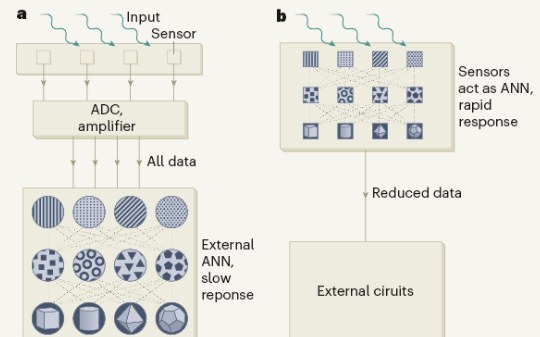

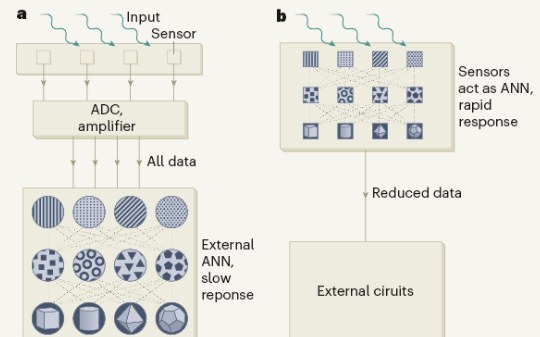

2653 維也納大學(xué)的工程師團隊帶來了AI芯片的新玩法。他們利用傳感器人工神經(jīng)網(wǎng)絡(luò)大大提高了處理圖片的效率,可在納秒內(nèi)完成圖像識別任務(wù)。他們的設(shè)計思路是將一些計算任務(wù)轉(zhuǎn)移到計算機系統(tǒng)外部邊緣的感知設(shè)備上,這樣可以減少不必要的數(shù)據(jù)移動,進而產(chǎn)生了這種機器視覺的傳感器內(nèi)計算研究成果。

2020-03-20 15:50:17 3613

3613

深度神經(jīng)網(wǎng)絡(luò)與其他很多機器學(xué)習(xí)模型一樣,可分為訓(xùn)練和推理兩個階段。訓(xùn)練階段根據(jù)數(shù)據(jù)學(xué)習(xí)模型中的參數(shù)(對神經(jīng)網(wǎng)絡(luò)來說主要是網(wǎng)絡(luò)中的權(quán)重);推理階段將新數(shù)據(jù)輸入模型,經(jīng)過計算得出結(jié)果。

2020-03-27 15:50:17 3572

3572 需要注意的是,Dojo 計算機將配合無監(jiān)督學(xué)習(xí)算法(unsupervised learning),來減少特斯拉對于數(shù)據(jù)人工標(biāo)注的工作量,這樣來幫助其數(shù)據(jù)訓(xùn)練效率實現(xiàn)指數(shù)級提升。 馬斯克還在推特上發(fā)布英雄帖,為自家的 AI 和芯片團隊招人。

2020-09-06 12:00:43 3082

3082 來源:公眾號AI公園 作者:OrhanG. Yal?n 編譯:ronghuaiyang 導(dǎo)讀 使用SOTA的預(yù)訓(xùn)練模型來通過遷移學(xué)習(xí)解決現(xiàn)實的計算機視覺問題。 如果你試過構(gòu)建高精度的機器學(xué)習(xí)模型,但

2020-10-31 10:54:45 2828

2828

從中國計算機學(xué)會獲悉,來自中國科學(xué)院計算技術(shù)研究所的研究團隊提出圖神經(jīng)網(wǎng)絡(luò)加速芯片設(shè)計“HyGCN”。 《中國計算機學(xué)會通訊》(CCCF)近日刊發(fā)了中科院計算所特別研究助理嚴(yán)明玉、研究員范東睿以及

2020-12-18 16:09:34 3214

3214 近日,《中國計算機學(xué)會通訊》刊發(fā)了中科院計算所特別研究助理嚴(yán)明玉博士、研究員范東睿以及研究員葉笑春共同撰寫的綜述文章《圖神經(jīng)網(wǎng)絡(luò)加速芯片:人工智能“認(rèn)知智能”階段起飛的推進劑》。文章披露,該團隊提出

2020-12-28 09:34:29 2149

2149 想要適應(yīng)自動駕駛、控制機器人、醫(yī)療診斷等場景,就必須讓神經(jīng)網(wǎng)絡(luò)適應(yīng)快速變化的各種狀況。好消息是,麻省理工(MIT)計算機科學(xué)與人工智能實驗室(CSAIL)的 Ramin Hasani 團隊,已經(jīng)

2021-01-29 10:46:33 2034

2034 想要適應(yīng)自動駕駛、控制機器人、醫(yī)療診斷等場景,就必須讓神經(jīng)網(wǎng)絡(luò)適應(yīng)快速變化的各種狀況。好消息是,麻省理工(MIT)計算機科學(xué)與人工智能實驗室(CSAIL)的 Ramin Hasani 團隊,已經(jīng)

2021-01-29 11:32:32 2931

2931 )上,汽車制造商特斯拉的AI高級總監(jiān)Andrej Karpathy公布了公司內(nèi)部用于訓(xùn)練Autopilot與自動駕駛深度神經(jīng)網(wǎng)絡(luò)的超級計算機。這個集群使用了720個節(jié)點的8個NVIDIA A100

2021-06-25 15:41:40 5025

5025 及儲能公司,特斯拉昨天正式宣布要與Intel、AMD以及NVIDIA廝殺:正式推出了自研的超級計算機群。 這套超算平臺將要用于特斯拉自動駕駛神經(jīng)網(wǎng)絡(luò)的訓(xùn)練。 顯然,網(wǎng)友們對特斯拉用這個超算來訓(xùn)練自動駕駛這件事充滿了「疑惑」。 「哇,雖然根本不想問這個殘

2021-07-02 14:32:57 2620

2620 機器學(xué)習(xí)計算機視覺是一種基于人工智能的計算機視覺。基于人工智能的基于機器學(xué)習(xí)的計算機視覺具有人工神經(jīng)網(wǎng)絡(luò)或?qū)樱愃朴谌四X中的神經(jīng)網(wǎng)絡(luò)或?qū)樱糜谶B接和傳輸有關(guān)攝取的視覺數(shù)據(jù)的信號。在機器學(xué)習(xí)中,計算機視覺神經(jīng)網(wǎng)絡(luò)具有獨立且不同的層,明確定義層之間的連接,以及視覺數(shù)據(jù)傳輸?shù)念A(yù)定義方向。

2022-04-06 16:49:42 4612

4612 韓國政府將與人工智能芯片和云計算企業(yè)聯(lián)合,組成一個團隊,開發(fā)高運算能力和低能耗的神經(jīng)網(wǎng)絡(luò)處理器(npu)推理芯片。這是為了避開nvidia的長期gpu進行競爭。該項目為延長韓國在半導(dǎo)體領(lǐng)域的地位而努力,并為到2030年取得顯著的成果而努力。

2023-06-27 10:11:03 1550

1550 一。其主要應(yīng)用領(lǐng)域在計算機視覺和自然語言處理中,最初是由Yann LeCun等人在20世紀(jì)80年代末和90年代初提出的。隨著近年來計算機硬件性能的提升和深度學(xué)習(xí)技術(shù)的發(fā)展,CNN在很多領(lǐng)域取得了重大的進展和應(yīng)用。 一、卷積神經(jīng)網(wǎng)絡(luò)模型 (一)卷積層(Convolutional Layer) 卷積神經(jīng)網(wǎng)絡(luò)最

2023-08-17 16:30:30 2217

2217 模型訓(xùn)練是將模型結(jié)構(gòu)和模型參數(shù)相結(jié)合,通過樣本數(shù)據(jù)的學(xué)習(xí)訓(xùn)練模型,使得模型可以對新的樣本數(shù)據(jù)進行準(zhǔn)確的預(yù)測和分類。本文將詳細(xì)介紹 CNN 模型訓(xùn)練的步驟。 CNN 模型結(jié)構(gòu) 卷積神經(jīng)網(wǎng)絡(luò)的輸入是一個

2023-08-21 16:42:00 2660

2660 卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Network,CNN)是一種深度學(xué)習(xí)神經(jīng)網(wǎng)絡(luò),主要用于圖像和視頻的識別、分類和預(yù)測,是計算機視覺領(lǐng)域中應(yīng)用最廣泛的深度學(xué)習(xí)算法之一。該網(wǎng)絡(luò)模型可以自動從原始數(shù)據(jù)中學(xué)習(xí)有用的特征,并將其映射到相應(yīng)的類別。

2023-08-21 17:03:46 3199

3199 cnn卷積神經(jīng)網(wǎng)絡(luò)模型 卷積神經(jīng)網(wǎng)絡(luò)預(yù)測模型 生成卷積神經(jīng)網(wǎng)絡(luò)模型? 卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Network,CNN)是一種深度學(xué)習(xí)神經(jīng)網(wǎng)絡(luò),最初被廣泛應(yīng)用于計算機

2023-08-21 17:11:47 1939

1939 卷積神經(jīng)網(wǎng)絡(luò)模型搭建 卷積神經(jīng)網(wǎng)絡(luò)模型是一種深度學(xué)習(xí)算法。它已經(jīng)成為了計算機視覺和自然語言處理等各種領(lǐng)域的主流算法,具有很大的應(yīng)用前景。本篇文章將詳細(xì)介紹卷積神經(jīng)網(wǎng)絡(luò)模型的搭建過程,為讀者提供一份

2023-08-21 17:11:49 1593

1593 卷積神經(jīng)網(wǎng)絡(luò)主要包括哪些 卷積神經(jīng)網(wǎng)絡(luò)組成部分 卷積神經(jīng)網(wǎng)絡(luò)(CNN)是一類廣泛應(yīng)用于計算機視覺、自然語言處理等領(lǐng)域的人工神經(jīng)網(wǎng)絡(luò)。它具有良好的空間特征學(xué)習(xí)能力,能夠處理具有二維或三維形狀的輸入數(shù)據(jù)

2023-08-21 17:15:22 2705

2705 神經(jīng)網(wǎng)絡(luò)模型是一種通過模擬生物神經(jīng)元間相互作用的方式實現(xiàn)信息處理和學(xué)習(xí)的計算機模型。它能夠?qū)斎霐?shù)據(jù)進行分類、回歸、預(yù)測和聚類等任務(wù),已經(jīng)廣泛應(yīng)用于計算機視覺、自然語言處理、語音處理等領(lǐng)域。下面將就神經(jīng)網(wǎng)絡(luò)模型的概念和工作原理,構(gòu)建神經(jīng)網(wǎng)絡(luò)模型的常用方法以及神經(jīng)網(wǎng)絡(luò)模型算法介紹進行詳細(xì)探討。

2023-08-28 18:25:27 1525

1525 科學(xué)神經(jīng)網(wǎng)絡(luò)模型使用隨機梯度下降進行訓(xùn)練,模型權(quán)重使用反向傳播算法進行更新。通過訓(xùn)練神經(jīng)網(wǎng)絡(luò)模型解決的優(yōu)化問題非常具有挑戰(zhàn)性,盡管這些算法在實踐中表現(xiàn)出色,但不能保證它們會及時收斂到一個良好的模型

2023-12-30 08:27:54 1071

1071

神經(jīng)網(wǎng)絡(luò)是人工智能領(lǐng)域的重要分支,廣泛應(yīng)用于圖像識別、自然語言處理、語音識別等多個領(lǐng)域。然而,要使神經(jīng)網(wǎng)絡(luò)在實際應(yīng)用中取得良好效果,必須進行有效的訓(xùn)練和優(yōu)化。本文將從神經(jīng)網(wǎng)絡(luò)的訓(xùn)練過程、常用優(yōu)化算法、超參數(shù)調(diào)整以及防止過擬合等方面,詳細(xì)闡述如何訓(xùn)練和優(yōu)化神經(jīng)網(wǎng)絡(luò)。

2024-07-01 14:14:06 1459

1459 卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Networks,簡稱CNN)是一種深度學(xué)習(xí)模型,廣泛應(yīng)用于圖像識別、視頻分析、自然語言處理等領(lǐng)域。本文將詳細(xì)介紹卷積神經(jīng)網(wǎng)絡(luò)的基本概念、結(jié)構(gòu)

2024-07-03 09:15:28 1337

1337 神經(jīng)網(wǎng)絡(luò)芯片和普通芯片的區(qū)別是一個復(fù)雜而深入的話題,涉及到計算機科學(xué)、電子工程、人工智能等多個領(lǐng)域。 定義 神經(jīng)網(wǎng)絡(luò)芯片(Neural Network Processor,簡稱NNP)是一種專門用于

2024-07-04 09:30:03 3060

3060 在探討深度神經(jīng)網(wǎng)絡(luò)(Deep Neural Networks, DNNs)與基本神經(jīng)網(wǎng)絡(luò)(通常指傳統(tǒng)神經(jīng)網(wǎng)絡(luò)或前向神經(jīng)網(wǎng)絡(luò))的區(qū)別時,我們需要從多個維度進行深入分析。這些維度包括網(wǎng)絡(luò)結(jié)構(gòu)、訓(xùn)練機制、特征學(xué)習(xí)能力、應(yīng)用領(lǐng)域以及計算資源需求等方面。以下是對兩者區(qū)別的詳細(xì)闡述。

2024-07-04 13:20:36 2554

2554 Matlab作為一款強大的數(shù)學(xué)計算軟件,廣泛應(yīng)用于科學(xué)計算、數(shù)據(jù)分析、算法開發(fā)等領(lǐng)域。其中,Matlab的神經(jīng)網(wǎng)絡(luò)工具箱(Neural Network Toolbox)為用戶提供了豐富的函數(shù)和工具

2024-07-08 18:26:20 4699

4699 網(wǎng)絡(luò)結(jié)構(gòu),通過誤差反向傳播算法(Error Backpropagation Algorithm)來訓(xùn)練網(wǎng)絡(luò),實現(xiàn)對復(fù)雜問題的學(xué)習(xí)和解決。以下將詳細(xì)闡述BP神經(jīng)網(wǎng)絡(luò)的工作方式,涵蓋其基本原理、訓(xùn)練過程、應(yīng)用實例以及優(yōu)缺點等多個方面。

2024-07-10 15:07:11 9467

9467

處理、語音識別等領(lǐng)域取得了顯著的成果。PyTorch是一個開源的深度學(xué)習(xí)框架,由Facebook的AI研究團隊開發(fā)。它以其易用性、靈活性和高效性而受到廣泛歡迎。在PyTorch中,有許多預(yù)訓(xùn)練的神經(jīng)網(wǎng)絡(luò)模型可供選擇,這些模型可以用于各種任務(wù),如圖像分類、目標(biāo)檢測

2024-07-11 09:59:53 2577

2577 發(fā)生變化,導(dǎo)致神經(jīng)網(wǎng)絡(luò)的泛化能力下降。為了保持神經(jīng)網(wǎng)絡(luò)的性能,需要對其進行重新訓(xùn)練。本文將詳細(xì)介紹重新訓(xùn)練神經(jīng)網(wǎng)絡(luò)的步驟和方法。 數(shù)據(jù)預(yù)處理 數(shù)據(jù)預(yù)處理是重新訓(xùn)練神經(jīng)網(wǎng)絡(luò)的第一步。在這個階段,需要對原始數(shù)據(jù)進行清洗、標(biāo)準(zhǔn)

2024-07-11 10:25:02 1273

1273 全卷積神經(jīng)網(wǎng)絡(luò)(FCN)是深度學(xué)習(xí)領(lǐng)域中的一種特殊類型的神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu),尤其在計算機視覺領(lǐng)域表現(xiàn)出色。它通過全局平均池化或轉(zhuǎn)置卷積處理任意尺寸的輸入,特別適用于像素級別的任務(wù),如圖像分割。本文將詳細(xì)探討全卷積神經(jīng)網(wǎng)絡(luò)的定義、原理、結(jié)構(gòu)、應(yīng)用以及其在計算機視覺領(lǐng)域的重要性。

2024-07-11 11:50:30 2548

2548 脈沖神經(jīng)網(wǎng)絡(luò)(SNN, Spiking Neural Network)的訓(xùn)練是一個復(fù)雜但充滿挑戰(zhàn)的過程,它模擬了生物神經(jīng)元通過脈沖(或稱為尖峰)進行信息傳遞的方式。以下是對脈沖神經(jīng)網(wǎng)絡(luò)訓(xùn)練過程的詳細(xì)闡述。

2024-07-12 10:13:51 1731

1731 計算機視覺技術(shù)作為人工智能領(lǐng)域的一個重要分支,旨在使計算機能夠像人類一樣理解和解釋圖像及視頻中的信息。為了實現(xiàn)這一目標(biāo),計算機視覺技術(shù)依賴于多種先進的AI算法模型。以下將詳細(xì)介紹幾種常見的計算機視覺

2024-07-24 12:46:09 2783

2783  電子發(fā)燒友App

電子發(fā)燒友App

評論