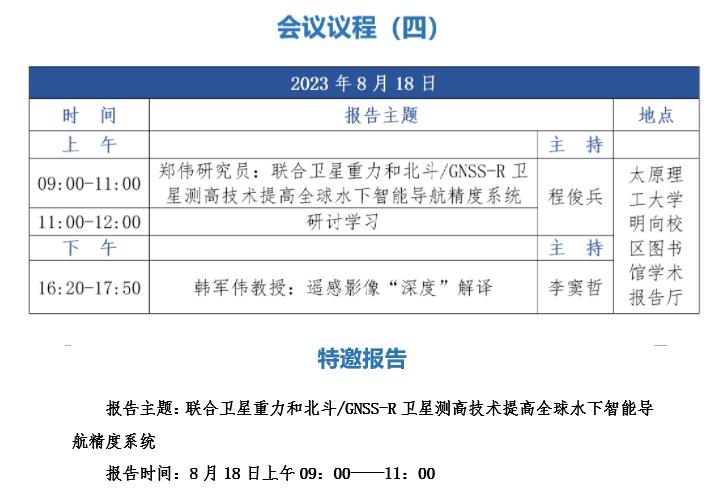

2023年人社部“數(shù)智化關(guān)鍵技術(shù)的發(fā)展與應(yīng)用”高級(jí)研修班暨大數(shù)據(jù)融合分析與應(yīng)用山西省重點(diǎn)實(shí)驗(yàn)室2023年第

2023年人社部“數(shù)智化關(guān)鍵技術(shù)的發(fā)展與應(yīng)用”高級(jí)研修班暨大數(shù)據(jù)融合分析與應(yīng)用山西省重點(diǎn)實(shí)驗(yàn)室202....

2023年人社部“數(shù)智化關(guān)鍵技術(shù)的發(fā)展與應(yīng)用”高級(jí)研修班暨大數(shù)據(jù)融合分析與應(yīng)用山西省重點(diǎn)實(shí)驗(yàn)室2023年第二次學(xué)術(shù)會(huì)議(三)

指導(dǎo)單位:山西省人力資源和社會(huì)保障廳 主辦單位:太原理工大學(xué) 承辦單位:大數(shù)據(jù)融合分析與應(yīng)用山西省重....

2023年人社部“數(shù)智化關(guān)鍵技術(shù)的發(fā)展與應(yīng)用”高級(jí)研修班暨大數(shù)據(jù)融合分析與應(yīng)用山西省重點(diǎn)實(shí)驗(yàn)室2023年第二次學(xué)術(shù)會(huì)議(二)

指導(dǎo)單位:山西省人力資源和社會(huì)保障廳 主辦單位:太原理工大學(xué) 承辦單位:大數(shù)據(jù)融合分析與應(yīng)用山西省重....

2023年人社部“數(shù)智化關(guān)鍵技術(shù)的發(fā)展與應(yīng)用”高級(jí)研修班暨大數(shù)據(jù)融合分析與應(yīng)用山西省重點(diǎn)實(shí)驗(yàn)室2023年第二次學(xué)術(shù)會(huì)議(一)

指導(dǎo)單位:山西省人力資源和社會(huì)保障廳 主辦單位:太原理工大學(xué) 承辦單位:大數(shù)據(jù)融合分析與應(yīng)用山西省重....

用語言建模世界:UC伯克利多模態(tài)世界模型利用語言預(yù)測(cè)未來

當(dāng)前,人與智能體(比如機(jī)器人)的交互是非常直接的,你告訴它「拿一塊藍(lán)色的積木」,它就會(huì)幫你拿過來。但....

檢測(cè)并消除瑕疵,DeSRA讓真實(shí)場(chǎng)景超分中的GAN更加完美

使用生成對(duì)抗網(wǎng)絡(luò)(GAN)進(jìn)行圖像超分辨率(SR)已經(jīng)在恢復(fù)逼真細(xì)節(jié)方面取得了巨大成功。然而,眾所周....

AI提高自動(dòng)駕駛夜視能力,檢測(cè)黑夜、霧天場(chǎng)景和白天一樣

未來,HADAR 可能會(huì)徹底改變自動(dòng)駕駛汽車和機(jī)器人感知周圍世界的方式。 環(huán)境感知是自動(dòng)駕駛領(lǐng)域非常....

動(dòng)態(tài)蛇形卷積(Dynamic Snake Convolution)用于管狀結(jié)構(gòu)分割

論文題目: Dyn amic Snake Convolution based on Topologi....

PVT++:通用的端對(duì)端預(yù)測(cè)性跟蹤框架

本文提出通用的端對(duì)端預(yù)測(cè)性跟蹤框架 PVT++,旨在解決目標(biāo)跟蹤的部署時(shí)的延遲問題。多種預(yù)訓(xùn)練跟蹤器....

讓Attention提速9倍!FlashAttention燃爆顯存,Transformer上下文長度史詩級(jí)提升

FlashAttention新升級(jí)!斯坦福博士一人重寫算法,第二代實(shí)現(xiàn)了最高9倍速提升。 繼超快且省....

基礎(chǔ)模型自監(jiān)督預(yù)訓(xùn)練的數(shù)據(jù)之謎:大量數(shù)據(jù)究竟是福還是禍?

大型語言模型如 ChatGPT 的成功彰顯了海量數(shù)據(jù)在捕捉語言模式和知識(shí)方面的巨大潛力,這也推動(dòng)了基....

語言模型做先驗(yàn),統(tǒng)一強(qiáng)化學(xué)習(xí)智能體,DeepMind選擇走這條通用AI之路

在智能體的開發(fā)中,強(qiáng)化學(xué)習(xí)與大語言模型、視覺語言模型等基礎(chǔ)模型的進(jìn)一步融合究竟能擦出怎樣的火花?谷歌....

智能感知與物聯(lián)網(wǎng)技術(shù)研究所2021級(jí)碩士研究生中期報(bào)告(五)

原文標(biāo)題:智能感知與物聯(lián)網(wǎng)技術(shù)研究所2021級(jí)碩士研究生中期報(bào)告(五) 文章出處:【微信公眾號(hào):智能....

智能感知與物聯(lián)網(wǎng)技術(shù)研究所2021級(jí)碩士研究生中期報(bào)告(四)

原文標(biāo)題:智能感知與物聯(lián)網(wǎng)技術(shù)研究所2021級(jí)碩士研究生中期報(bào)告(四) 文章出處:【微信公眾號(hào):智能....

智能感知與物聯(lián)網(wǎng)技術(shù)研究所2021級(jí)碩士研究生中期報(bào)告(三)

原文標(biāo)題:智能感知與物聯(lián)網(wǎng)技術(shù)研究所2021級(jí)碩士研究生中期報(bào)告(三) 文章出處:【微信公眾號(hào):智能....

智能感知與物聯(lián)網(wǎng)技術(shù)研究所2021級(jí)碩士研究生中期報(bào)告(二)

原文標(biāo)題:智能感知與物聯(lián)網(wǎng)技術(shù)研究所2021級(jí)碩士研究生中期報(bào)告(二) 文章出處:【微信公眾號(hào):智能....

智能感知與物聯(lián)網(wǎng)技術(shù)研究所2021級(jí)碩士研究生中期報(bào)告(一)

原文標(biāo)題:智能感知與物聯(lián)網(wǎng)技術(shù)研究所2021級(jí)碩士研究生中期報(bào)告(一) 文章出處:【微信公眾號(hào):智能....

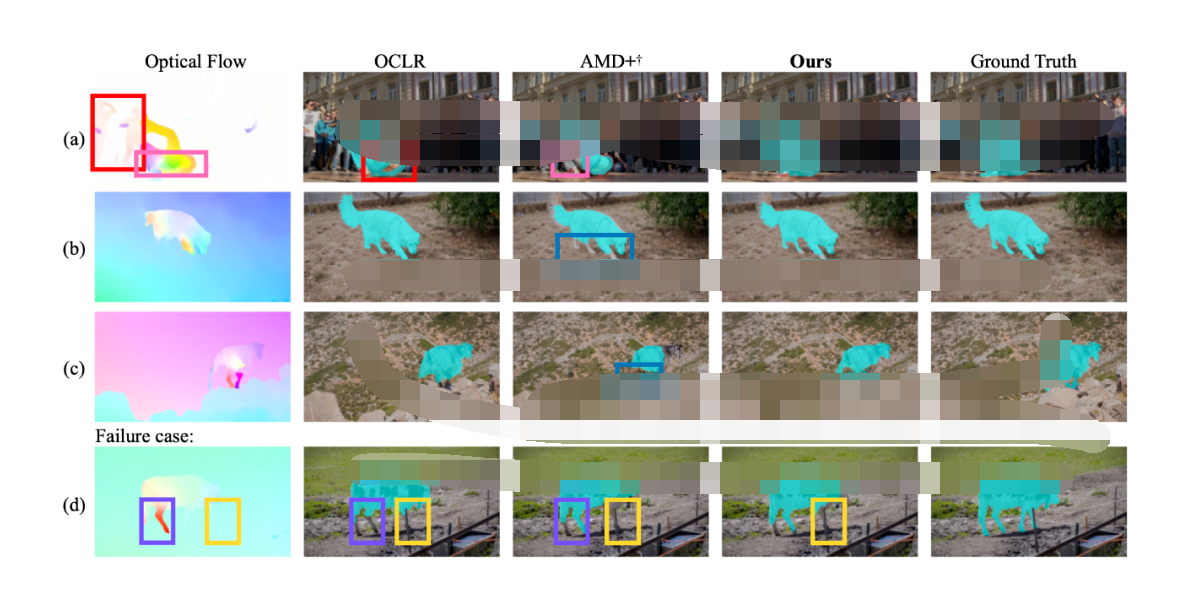

CVPR 2023 | 完全無監(jiān)督的視頻物體分割 RCF

TLDR: 視頻分割一直是重標(biāo)注的一個(gè) task,這篇 CVPR 2023 文章研究了完全不需要標(biāo)注....

更強(qiáng)更通用:智源「悟道3.0」Emu多模態(tài)大模型開源,在多模態(tài)序列中「補(bǔ)全一切」

當(dāng)前學(xué)界和工業(yè)界都對(duì)多模態(tài)大模型研究熱情高漲。去年,谷歌的 Deepmind 發(fā)布了多模態(tài)視覺語言模....

CVPR 2023 | 華科&MSRA新作:基于CLIP的輕量級(jí)開放詞匯語義分割架構(gòu)

本文提出了 SAN 框架,用于開放詞匯語義分割。該框架成功地利用了凍結(jié)的 CLIP 模型的特征以及端....

VisCPM:邁向多語言多模態(tài)大模型時(shí)代

隨著 GPT-4 和 Stable Diffusion 等模型多模態(tài)能力的突飛猛進(jìn),多模態(tài)大模型已經(jīng)....

“數(shù)字山西 校企共創(chuàng)”專題研討會(huì)

? 為促進(jìn)我省數(shù)字化產(chǎn)業(yè)轉(zhuǎn)型升級(jí),探索校企共創(chuàng)數(shù)字化新模式,太原理工大學(xué) 大數(shù)據(jù)融合分析與應(yīng)用山西省....

理解指向,說出坐標(biāo),Shikra開啟多模態(tài)大模型參考對(duì)話新維度

在人類的日常交流中,經(jīng)常會(huì)關(guān)注場(chǎng)景中不同的區(qū)域或物體,人們可以通過說話并 指向這些區(qū)域 來進(jìn)行高效的....

大模型幫陶哲軒解題、證明數(shù)學(xué)定理:數(shù)學(xué)真要成為首個(gè)借助AI實(shí)現(xiàn)突破的學(xué)科了?

數(shù)學(xué)將成為第一門借助AI實(shí)現(xiàn)重大突破的學(xué)科? 去年 2 月份,DeepMind 發(fā)布了編程輔助利器 ....

類GPT模型訓(xùn)練提速26.5%,清華朱軍等人用INT4算法加速神經(jīng)網(wǎng)絡(luò)訓(xùn)練

我們知道,將激活、權(quán)重和梯度量化為 4-bit 對(duì)于加速神經(jīng)網(wǎng)絡(luò)訓(xùn)練非常有價(jià)值。但現(xiàn)有的 4-bit....

語音領(lǐng)域的GPT時(shí)刻:Meta 發(fā)布「突破性」生成式語音系統(tǒng),一個(gè)通用模型解決多項(xiàng)任務(wù)

繼開源 LLaMA 之后,Meta 在生成式 AI 方向又公布一項(xiàng)重大研究。 我們知道,GPT、DA....

CVPR 2023 | 清華大學(xué)提出LiVT,用視覺Transformer學(xué)習(xí)長尾數(shù)據(jù)

背景 在機(jī)器學(xué)習(xí)領(lǐng)域中,學(xué)習(xí)不平衡的標(biāo)注數(shù)據(jù)一直是一個(gè)常見而具有挑戰(zhàn)性的任務(wù)。近年來,視覺 Tran....

隨時(shí)隨地,追蹤每個(gè)像素,連遮擋都不怕的「追蹤一切」視頻算法來了

Tracking Everything Everywhere All at Once. 前段時(shí)間,M....

ICLR 2023 Spotlight|節(jié)省95%訓(xùn)練開銷,清華黃隆波團(tuán)隊(duì)提出強(qiáng)化學(xué)習(xí)專用稀疏訓(xùn)練框架RLx2

大模型時(shí)代,模型壓縮和加速顯得尤為重要。傳統(tǒng)監(jiān)督學(xué)習(xí)可通過稀疏神經(jīng)網(wǎng)絡(luò)實(shí)現(xiàn)模型壓縮和加速,那么同樣需....