作為個(gè)人開(kāi)發(fā)者,應(yīng)不應(yīng)該將自己的項(xiàng)目或模型、數(shù)據(jù)等進(jìn)行開(kāi)源?公開(kāi)這些數(shù)據(jù)有哪些風(fēng)險(xiǎn)?本文作者是斯坦福大學(xué)博士,長(zhǎng)期從事開(kāi)源機(jī)器學(xué)習(xí)研究,經(jīng)常接觸和處理敏感數(shù)據(jù),他結(jié)合自己的經(jīng)驗(yàn),為這個(gè)問(wèn)題提供了一些建議。

公開(kāi)機(jī)器學(xué)習(xí)模型代碼可能會(huì)有哪些風(fēng)險(xiǎn)?

OpenAI 最近因?yàn)閯?chuàng)造了多項(xiàng)機(jī)器學(xué)習(xí)新任務(wù)的最優(yōu)性能記錄,但卻不開(kāi)放源代碼而遭到越來(lái)越多的指摘。OpenAI發(fā)推表示,“由于擔(dān)心這些技術(shù)可能被用做惡意目的,不會(huì)放出訓(xùn)練后的模型代碼。“

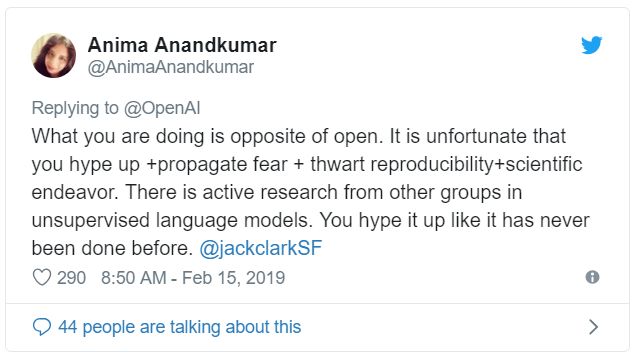

對(duì)OpenAI這個(gè)決定的批評(píng)之聲不少,比如這樣會(huì)對(duì)其他團(tuán)隊(duì)重現(xiàn)研究這些研究結(jié)果造成阻礙,而研究結(jié)果的可重現(xiàn)性是確保研究真實(shí)的基礎(chǔ)。而且,這樣做也可能導(dǎo)致媒體對(duì)人工智能技術(shù)產(chǎn)生一種由于未知而生的恐懼。

上面這段Twitter引起了我的注意。Anima Anandkumar在彌合機(jī)器學(xué)習(xí)的研究和實(shí)際應(yīng)用之間的差距方面擁有豐富的經(jīng)驗(yàn)。我們是亞馬遜AWS的同事,最近還在一起討論了如何將機(jī)器學(xué)習(xí)技術(shù)從博士實(shí)驗(yàn)室推向市場(chǎng)的問(wèn)題。

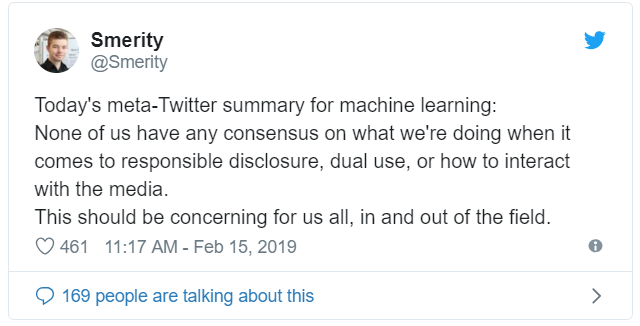

Stephen Merity對(duì)社交媒體的回應(yīng)進(jìn)行了總結(jié),他表示,機(jī)器學(xué)習(xí)社區(qū)在這方面的經(jīng)驗(yàn)其實(shí)不多:

OpenAI不公開(kāi)模型源代碼是對(duì)是錯(cuò)?這事各位可以自行判斷。不過(guò)在我看來(lái),OpenAI在兩個(gè)方面做得不夠好,應(yīng)該就是否可以檢測(cè)到虛假內(nèi)容進(jìn)行調(diào)查,并以多種語(yǔ)言發(fā)布模型,以對(duì)抗對(duì)英語(yǔ)產(chǎn)生的單語(yǔ)種偏見(jiàn)。

對(duì)于個(gè)人機(jī)器學(xué)習(xí)項(xiàng)目而言,下面給出一些關(guān)于是否應(yīng)該公開(kāi)發(fā)布模型或數(shù)據(jù)集的決策時(shí)的一些常見(jiàn)問(wèn)題:

在開(kāi)源我的模型之前是否應(yīng)該三思?

是的。如果你的模型是基于私有數(shù)據(jù)構(gòu)建的,則可以對(duì)其進(jìn)行逆向工程以提取出這些數(shù)據(jù)。

如果我的模型100%來(lái)自公共數(shù)據(jù),那我是否還要考慮將模型開(kāi)源?

是的。如果要在新的語(yǔ)言環(huán)境重新發(fā)布數(shù)據(jù),已發(fā)布的數(shù)據(jù)可能會(huì)變成敏感數(shù)據(jù),而且,聚合后的數(shù)據(jù)(包括機(jī)器學(xué)習(xí)模型)可能比分散的各個(gè)數(shù)據(jù)點(diǎn)更加敏感。你需要考慮:重新構(gòu)建數(shù)據(jù)或數(shù)據(jù)模型會(huì)產(chǎn)生哪些影響,要不要由我自己或我所在的組織公開(kāi)發(fā)布?

即使單個(gè)數(shù)據(jù)點(diǎn)并非敏感數(shù)據(jù),聚合數(shù)據(jù)被視為敏感也是很常見(jiàn)的情況。這是許多軍事組織的標(biāo)準(zhǔn)做法:當(dāng)他們匯總來(lái)自一組來(lái)源的數(shù)據(jù)時(shí),他們會(huì)根據(jù)其敏感程度重新評(píng)估該匯總信息。聚合通常是統(tǒng)計(jì)學(xué)或無(wú)監(jiān)督機(jī)器學(xué)習(xí)的結(jié)果,但是基于該數(shù)據(jù)構(gòu)建的監(jiān)督模型同樣適用。

所以,你應(yīng)該經(jīng)常自問(wèn):我的模型中的聚合數(shù)據(jù)是否比單個(gè)數(shù)據(jù)點(diǎn)更為敏感?

我應(yīng)該如何評(píng)估開(kāi)源風(fēng)險(xiǎn)?

在安全性方面考慮,可以將每個(gè)策略視為“可被攻破的”。風(fēng)險(xiǎn)防范的基本目標(biāo)是使攻破某些安全措施的成本高于被保護(hù)數(shù)據(jù)的價(jià)值。

所以要考慮的問(wèn)題是,從你的研究論文中復(fù)制模型的成本,是否值得為那些想要出于負(fù)面目的使用這些技術(shù)的人付出這樣的努力?應(yīng)該要明確這一點(diǎn)。這是決定是否將模型開(kāi)源的一個(gè)重要因素。

我最近與Facebook進(jìn)行了長(zhǎng)時(shí)間的會(huì)談,討論的是出任一個(gè)職位,專(zhuān)門(mén)負(fù)責(zé)發(fā)現(xiàn)假新聞。從一個(gè)行內(nèi)人的角度來(lái)看,我最想知道的是這樣一件事:我能否以編程的方式成功檢測(cè)這種模型輸出,以便對(duì)抗假新聞?

我認(rèn)為在Facebook上打擊假新聞是任何人都可以做的最重要的事情之一,來(lái)自O(shè)penAI的這項(xiàng)研究將會(huì)對(duì)此有所幫助。而且,如果能夠創(chuàng)建一個(gè)可以識(shí)別生成內(nèi)容的模型池,那么假新聞可能會(huì)更難以蒙混通過(guò)自動(dòng)檢測(cè)系統(tǒng)。

如果你能夠定量地證明,對(duì)項(xiàng)目數(shù)據(jù)的惡意使用可以進(jìn)行更容易/更難的打擊,這也將是你做出是否開(kāi)源的決策過(guò)程中的另一個(gè)重要因素。

這算是機(jī)器學(xué)習(xí)中的新問(wèn)題嗎?

其實(shí)不算是,你可以從過(guò)去的經(jīng)驗(yàn)中學(xué)到很多東西。

如果你面臨類(lèi)似的困境,請(qǐng)尋找具有深度知識(shí)的人來(lái)討論受影響最大的社區(qū)(最好是來(lái)自該社區(qū)內(nèi)部的人士),以及過(guò)去遇到類(lèi)似的機(jī)器學(xué)習(xí)問(wèn)題相關(guān)問(wèn)題的人。

我是否應(yīng)該平衡機(jī)器學(xué)習(xí)的負(fù)面應(yīng)用和正面應(yīng)用?

是的。發(fā)布具有積極應(yīng)用意義的模型,很容易對(duì)世界產(chǎn)生積極影響。而限制具有許多負(fù)面應(yīng)用領(lǐng)域的模型的發(fā)布,很難對(duì)世界產(chǎn)生積極影響。

這其實(shí)是OpenAI的另一個(gè)失敗之處:缺乏多樣性。OpenAI比任何其他研究團(tuán)隊(duì)都更多地發(fā)布了僅適用于英語(yǔ)模型和研究成果。從全球來(lái)看,英語(yǔ)每天僅占全世界對(duì)話的5%。在句子中的單詞順序、標(biāo)準(zhǔn)化拼寫(xiě)和“單詞”作為機(jī)器學(xué)習(xí)功能單元上,英語(yǔ)是一個(gè)異類(lèi)。

OpenAI的研究依賴于以下三個(gè)方面:?jiǎn)卧~順序,單詞特征,拼寫(xiě)一致性。這些研究能夠適用于世界上大多數(shù)語(yǔ)言嗎?我們不知道,因?yàn)闆](méi)有測(cè)試。OpenAI的研究確實(shí)表明,我們需要擔(dān)心這種類(lèi)型的英語(yǔ)生成內(nèi)容,但并沒(méi)有表明,今天的假新聞的流傳,更有可能通過(guò)除英語(yǔ)之外的其他100多種語(yǔ)言進(jìn)行。

如果你不想進(jìn)入假新聞等應(yīng)用程序的灰色區(qū)域,那么可以選擇一個(gè)本質(zhì)上更具影響力的研究領(lǐng)域,例如低資源語(yǔ)言中與健康相關(guān)的文本的語(yǔ)言模型。

我需要在多大程度上考慮項(xiàng)目應(yīng)用實(shí)例的敏感性?

當(dāng)我為AWS的命名實(shí)體解析服務(wù)開(kāi)發(fā)產(chǎn)品時(shí),必須考慮是否要將街道級(jí)地址識(shí)別為顯式字段,并可能將坐標(biāo)映射到相應(yīng)地址。我們認(rèn)為這本身就是敏感信息,不應(yīng)該在一般解決方案中進(jìn)行產(chǎn)品化。

在任何研究項(xiàng)目中都要考慮這一點(diǎn):是否能夠隱含或明確地識(shí)別出模型中的敏感信息?

只是因?yàn)槠渌硕奸_(kāi)源了自己的模型,因此我也應(yīng)該開(kāi)源嗎?

當(dāng)然不是,你應(yīng)該對(duì)自己項(xiàng)目的影響力保持一份懷疑。無(wú)論你是否贊同OpenAI的決定,都應(yīng)該做出明智的決定,而不是盲目跟隨他人。

-

人工智能

+關(guān)注

關(guān)注

1817文章

50098瀏覽量

265367 -

開(kāi)源

+關(guān)注

關(guān)注

3文章

4207瀏覽量

46139 -

機(jī)器學(xué)習(xí)

+關(guān)注

關(guān)注

66文章

8553瀏覽量

136948

原文標(biāo)題:斯坦福博士:個(gè)人開(kāi)發(fā)者要不要開(kāi)源項(xiàng)目模型和代碼?

文章出處:【微信號(hào):AI_era,微信公眾號(hào):新智元】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

大模型 ai coding 比較

強(qiáng)化學(xué)習(xí)會(huì)讓自動(dòng)駕駛模型學(xué)習(xí)更快嗎?

機(jī)器學(xué)習(xí)和深度學(xué)習(xí)中需避免的 7 個(gè)常見(jiàn)錯(cuò)誤與局限性

基于ETAS嵌入式AI工具鏈將機(jī)器學(xué)習(xí)模型部署到量產(chǎn)ECU

配置文件損壞可能會(huì)帶來(lái)哪些安全風(fēng)險(xiǎn)?

超小型Neuton機(jī)器學(xué)習(xí)模型, 在任何系統(tǒng)級(jí)芯片(SoC)上解鎖邊緣人工智能應(yīng)用.

FPGA在機(jī)器學(xué)習(xí)中的具體應(yīng)用

通過(guò)NVIDIA Cosmos模型增強(qiáng)機(jī)器人學(xué)習(xí)

邊緣計(jì)算中的機(jī)器學(xué)習(xí):基于 Linux 系統(tǒng)的實(shí)時(shí)推理模型部署與工業(yè)集成!

代碼革命的先鋒:aiXcoder-7B模型介紹

【「# ROS 2智能機(jī)器人開(kāi)發(fā)實(shí)踐」閱讀體驗(yàn)】視覺(jué)實(shí)現(xiàn)的基礎(chǔ)算法的應(yīng)用

國(guó)產(chǎn)地物光譜儀在“高光譜-機(jī)器學(xué)習(xí)”模型構(gòu)建中的表現(xiàn)

如果主節(jié)點(diǎn)使用AD2433,從節(jié)點(diǎn)使用AD2428,會(huì)不會(huì)有什么風(fēng)險(xiǎn)點(diǎn)?

十大鮮為人知卻功能強(qiáng)大的機(jī)器學(xué)習(xí)模型

公開(kāi)機(jī)器學(xué)習(xí)模型代碼可能會(huì)有哪些風(fēng)險(xiǎn)?

公開(kāi)機(jī)器學(xué)習(xí)模型代碼可能會(huì)有哪些風(fēng)險(xiǎn)?

評(píng)論