NLP方向近日各種大神工具層出不窮。然而,實(shí)踐才是硬道理,如何將它們應(yīng)用到自己的模型是個(gè)關(guān)鍵問(wèn)題。本文就對(duì)此問(wèn)題進(jìn)行了介紹。

近期的NLP方向,ELMO、GPT、BERT、Transformer-XL、GPT-2,各種預(yù)訓(xùn)練語(yǔ)言模型層出不窮,這些模型在各種NLP任務(wù)上一次又一次刷新上線,令人心馳神往。但是當(dāng)小編翻開他們的paper,每一個(gè)上面都寫著四個(gè)大字:“弱者退散”,到底該怎么將這些頂尖工具用到我的模型里呢?答案是Hugging Face的大神們開源的pytorch-pretrained-BERT。

Github 地址:

https://github.com/huggingface/pytorch-pretrained-BERT

模型簡(jiǎn)介

近期的各種預(yù)訓(xùn)練語(yǔ)言模型,橫掃各種NLP任務(wù),這里我們介紹三個(gè)最火的預(yù)訓(xùn)練模型:

BERT,由Google AI團(tuán)隊(duì),發(fā)表于2018年10月11日。它的文章是:BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding。

Transformer-XL, 由Google AI和Carnegie Mellon大學(xué),發(fā)表于2019年1月9日。它的文章是:Transformer-XL: Attentive Language Models Beyond a Fixed-Length Context。

GPT-2,由OpenAI 團(tuán)隊(duì),發(fā)表于2019年2月14日,它的文章是:Language Models are Unsupervised Multitask Learners。

基本上,每一個(gè)文章,都在發(fā)表的時(shí)候,刷新當(dāng)時(shí)的幾乎所有NLP任務(wù)的State-of-the-Art,然后引發(fā)一波熱潮。 當(dāng)然,目前風(fēng)頭正盛的是GPT-2,它前幾天剛發(fā)表。

開源實(shí)現(xiàn)

然而,讓小編翻開他們的paper,發(fā)現(xiàn)每一個(gè)上面都寫著四個(gè)大字:“弱者退散”,到底該怎么將這些頂尖工具用到我的模型里呢,Hugging Face 的大神們,緊跟前沿,將所有的預(yù)訓(xùn)練語(yǔ)言模型都實(shí)現(xiàn)并開源了。更令人欽佩的是,它們還做了很多封裝,讓大家都可以才在這些巨人模型的肩膀上。

Hugging Face開源的庫(kù)叫pytorch-pretained-bert, 你可以在本文開頭找到鏈接。接下來(lái)的部分,我們介紹一下它的安裝和使用。

安裝使用

你可以直接使用 Pip install 來(lái)安裝它:

pip install pytorch-pretrained-bert

pytorch-pretrained-bert 內(nèi) BERT,GPT,Transformer-XL,GPT-2。

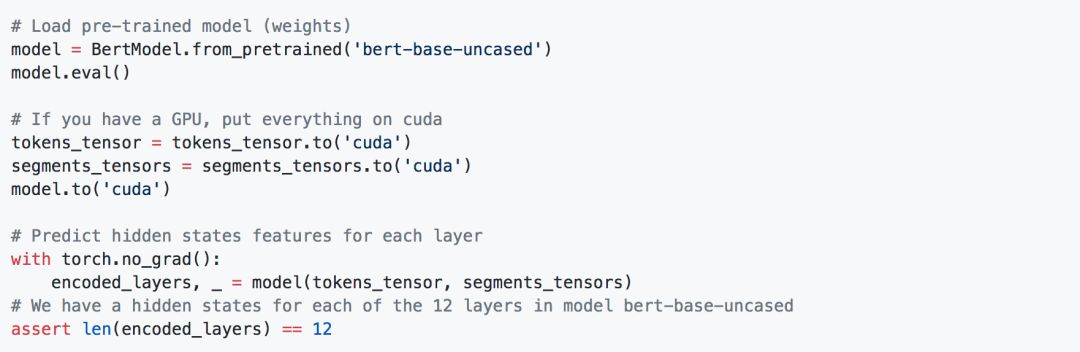

為了獲取一句話的BERT表示,我們可以:

拿到表示之后,我們可以在后面,接上自己的模型,比如NER。

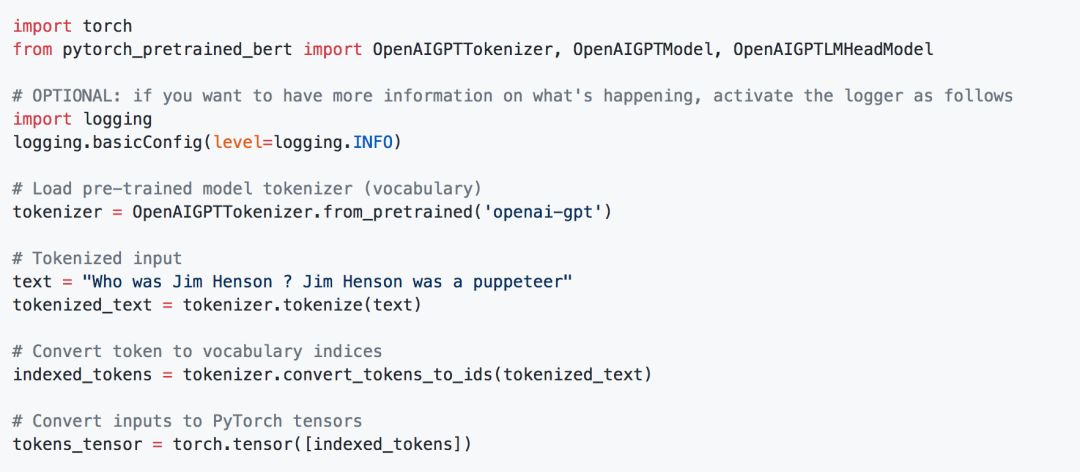

我們也可以獲取GPT的表示:

Transformer-XL表示:

以及,非常火的,GPT-2的表示:

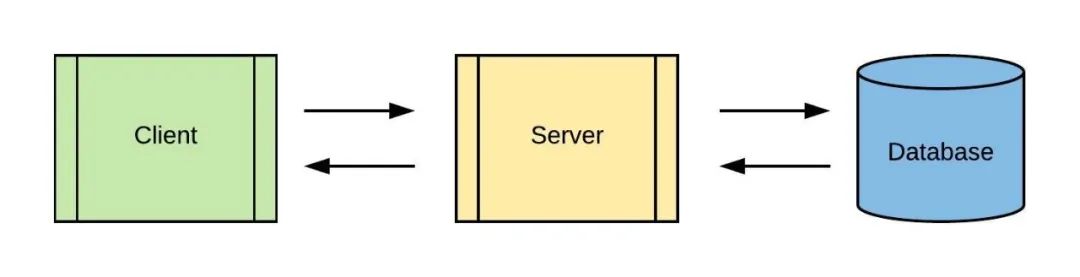

有了這些表示,我們可以在后面,接入自己的模型,比如:

文本分類

https://github.com/huggingface/pytorch-pretrained-BERT/blob/master/examples/run_classifier.py

閱讀理解

https://github.com/huggingface/pytorch-pretrained-BERT/blob/master/examples/run_squad.py

語(yǔ)言模型

https://github.com/huggingface/pytorch-pretrained-BERT/blob/master/examples/run_lm_finetuning.py

等等

-

開源

+關(guān)注

關(guān)注

3文章

4203瀏覽量

46125 -

語(yǔ)言模型

+關(guān)注

關(guān)注

0文章

571瀏覽量

11310 -

nlp

+關(guān)注

關(guān)注

1文章

491瀏覽量

23280

原文標(biāo)題:BERT、GPT-2這些頂尖工具到底該怎么用到我的模型里?

文章出處:【微信號(hào):AI_era,微信公眾號(hào):新智元】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

請(qǐng)問(wèn)AIC3206的一階濾波的頻率到底該怎么計(jì)算呢?

這些仿真工具帶有dsp模型

誰(shuí)能幫我完成這些程序到我的dsPic模型上

無(wú)法獲知TIVA里到底有什么函數(shù)以及這些函數(shù)的用法?

到底什么是密鑰呢?

如何使用Paddle2ONNX模型轉(zhuǎn)換工具將飛槳模型轉(zhuǎn)換為ONNX模型?

Env工具到底是什么?怎樣去使用Env工具呢

“加水就能跑1000公里的車”到底是黑科技還是騙局呢?

如何將大模型應(yīng)用到效能評(píng)估系統(tǒng)中去

開源LLEMMA發(fā)布:超越未公開的頂尖模型,可直接應(yīng)用于工具和定理證明

如何將Kafka使用到我們的后端設(shè)計(jì)中

到底該怎么將這些頂尖工具用到我的模型里呢?

到底該怎么將這些頂尖工具用到我的模型里呢?

評(píng)論