進入2026年,AI大模型已從“百模大戰”轉向“應用爆發”。無論是進行大語言模型的微調、文生視頻的渲染,還是復雜的自動駕駛仿真,GPU云服務器已成為企業的核心生產力工具。

然而,GPU服務器動輒每小時數十元甚至數百元的租金,讓算力成本成為了項目成敗的關鍵。2026年的GPU市場不再是A100一家獨大,H200、B200以及國產算力芯片的崛起,讓選型變得極其復雜。本文將為您帶來一份基于2026年主流芯片的實測對比指南。

一、為什么“顯存大小”不再是唯一指標?

在2023-2024年,大家買GPU只看顯存(如24G、80G)。但在2026年,AI任務的瓶頸已經轉移到了顯存帶寬和互聯帶寬上。

計算卡頓:如果顯存帶寬不夠,GPU核心會頻繁處于“空轉”狀態等待數據輸入,導致實際訓練效率不足理論值的30%。

多卡瓶頸:單卡性能再強,如果多卡之間的通信帶寬(P2P速度)太低,分布式訓練時增加顯卡數量可能反而會導致性能下降。

顯存溢出:隨著模型參數突破萬億級,顯存管理能力直接決定了你是否能跑通代碼。

二、2026年主流GPU云服務器性能實測表

我們選取了目前云端最主流的四款型號,針對“Llama370B模型微調”和“StableDiffusion圖像生成”進行了實測。

| GPU型號 | 架構/顯存 | 2026主流應用 | 相對A100訓練速度 | 算力性價比 |

| NVIDIAA100 | Ampere/80G | 中小型模型微調、推理 | 1.0x(基準) | 中(經典長青款) |

| NVIDIAH200 | Hopper/141G | 大規模LLM訓練、高性能推理 | 2.8x-3.5x | 高(生產力之王) |

| NVIDIAL40S | Ada/48G | 生成式AI、多模態推理 | 1.2x(推理更強) | 極高(高并發首選) |

| 國產算力芯片 | 各種自研架構 | 國產模型適配、信創項目 | 0.8x-1.1x | 優秀(政策扶持) |

三、核心觀點:如何定義2026年的“算力性價比”?

觀點一:H200是2026年大模型訓練的絕對首選。

H200引入了HBM3e高帶寬顯存,顯存帶寬達到4.8TB/s。在2026年的實測中,由于帶寬優勢,其處理長文本的速度比A100快了近3倍。

恒訊科技提供的H200集群通過RoCEv2網絡優化,實現了多機多卡間接近零損耗的通信,大幅縮短了千億級模型的迭代周期。

觀點二:L40S是中小型初創企業“買得起”的算力方案。

L40S在單精度計算和視頻編碼上表現優異,雖然顯存不如H系列大,但其租金通常僅為H200的40%,是生成式AI應用的最佳性價比選擇。

對于圖像生成類業務,L40S的并發處理能力甚至能超過A100。

觀點三:顯存池化技術(vGPU)正在改變算力消費模式。

2026年的云平臺普遍支持算力切片。如果你只是做簡單的推理或調試,無需租用整張卡。

恒訊科技的GPU共享技術支持最小1/10張卡的彈性調度,這種“按克買金”的模式極大降低了個人開發者的實驗成本。

四、2026GPU選購避坑指南

1.警惕“老舊架構”的功耗與速度

雖然一些服務商仍提供V100等老舊卡,且價格極低。但因其不支持最新的Transformer引擎加速,運行2026年的新算法時,不僅速度慢,且由于顯存受限,很多庫已不再支持,維護成本極高。

2.關注網絡互聯帶寬

購買多卡服務器時,務必詢問是否支持NVLink4.0。如果只是通過普通的PCIe互聯,多卡性能會大打折扣。測試云服務器穩定性時提到的壓測工具,同樣適用于GPU通信測試。

3.地域選擇與合規性

GPU資源在2026年依然屬于緊俏物資。恒訊科技建議優先選擇資源儲備充足的海外節點(如香港、新加坡)或國內算力中心。對于特定的政企項目,應優先考慮搭載國產自研算力芯片的機房。

總結

GPU云服務器哪家強?答案取決于你的算法需求。

玩轉萬億級大模型:非H200/B200莫屬,時間成本遠比租金貴。

圖像與視頻應用:L40S是當前的“甜點級”選擇。

日常微調與教學:經典的A100依然穩健。

在算力即權力的2026年,選擇如恒訊科技這樣能夠提供穩定算力供應、具備深厚網絡底座支撐的服務商,是AI項目成功的關鍵。正如云服務器怎么選中所述,只有讓算力與需求匹配,才能實現真正的業務加速。

審核編輯 黃宇

-

gpu

+關注

關注

28文章

5222瀏覽量

135759 -

服務器

+關注

關注

14文章

10303瀏覽量

91593 -

AI

+關注

關注

91文章

40269瀏覽量

301874 -

深度學習

+關注

關注

73文章

5600瀏覽量

124482

發布評論請先 登錄

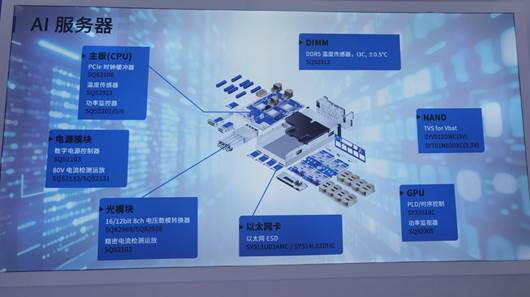

AI服務器大電流電感選型指南

SuperX發布最新XN9160-B300 AI服務器,Blackwell Ultra 比 Blackwell計算能力增加了 50%

GPU云服務器哪家強?深度學習與AI訓練性能實測

GPU云服務器哪家強?深度學習與AI訓練性能實測

評論