近日,大曉機器人重磅開源開悟世界模型3.0(Kairos 3.0)-4B 系列具身原生世界模型。作為業內首個實現 “多模態理解 — 生成 — 預測” 一體化的開源具身原生世界模型,該模型以 “物理因果一致、跨本體泛化、超長時交互、云側實時生成、輕量化高效能、端側本體控制” 為核心優勢,性能全面領跑國內外主流具身世界模型。

Kairos 3.0-4B 是全球首個可端側驅動具身智能本體控制的世界模型,也是行業內首個在 THOR 端側平臺達成 1:1.5(視頻生成時間:視頻時長)實時生成的具身世界模型。該模型部署于Jetson Thor T5000 端側平臺,算力可達517 TFlops,不僅能在 3D 仿真環境中精準生成機械臂運動形態、完成運動軌跡的預測與規劃,更可依托 THOR 端側平臺實現機器人本體的真實驅動與作業執行,讓機器人真正從“會表演”走向“能干活”。

在全球權威具身智能 Benchmark 評測中,Kairos 3.0-4B 各項指標全面領先。在 A800 GPU Benchmark 中,基于模型能力和推理工具,Kairos 3.0-4B 的推理速度較 Cosmos 2.5 提升 72 倍,刷新全球具身世界模型性能紀錄,充分驗證了其硬核技術實力。

Kairos 3.0-4B 兼具通用世界模型能力與具身場景深度賦能優勢。在通用場景下,該模型可生成高度還原的真實物理世界,以黃果樹瀑布為例,其能精準呈現自然光影效果,支持流暢運鏡且無畫面跳幀,云、水、葉片等元素均可實現動態演化;同時,模型深度適配具身智能需求,憑借雙重能力打通數字仿真與物理執行,以中國自研核心技術破解行業核心痛點,為具身智能規模化落地提供核心引擎,成為具備全球競爭力的具身世界模型標桿。

以原生世界模型架構,筑牢具身智能對物理世界的底層認知

當前,具身智能行業深陷數據稀缺且割裂的困境,傳統生成式模型僅側重視頻生成,缺乏對物理世界的深度認知,因此面臨長時序交互不足、部署算力成本高昂、狀態預測物理一致性差等行業瓶頸。

作為業內首個實現 “多模態理解 — 生成 — 預測” 一體化的開源具身原生世界模型,Kairos 3.0-4B 與市面上 “大模型改款” 的生成式模型有著本質區別。該模型并非在大語言或視覺模型后簡單附加運動接口,而是從架構底層為機器人在真實世界的運行進行設計,以自然界基本物理規律與因果規律為認知根基,構建起跨本體的統一世界理解框架,徹底打破傳統具身智能 “行為模仿” 的技術局限,將模型能力升級至 “物理級深度理解” 的全新維度。

圍繞 “理解世界、生成世界、預測世界” 三大核心能力,Kairos 3.0-4B 將物理規律與因果思維鏈深度嵌入模型決策過程,讓模型做到 “知其然更知其所以然”。其核心突破在于深度融合機器人真機交互、人類行為結構化與思維鏈文本三類關鍵數據,有效打破多元數據壁壘,大幅提升真實世界數據的復用效率,顯著優化具身智能的尺度定律效率。

得益于原生架構的優勢,該模型不再依賴昂貴且稀缺的真機數據,而是通過內化物理規律、推演因果邏輯,在更優的模型與數據規模下,實現強泛化、長時序推理與可靠的端側部署。它能精準解析物體受力、重心、摩擦等物理約束,完成復雜任務的推理、規劃與可行性分析,兼容多模態傳感器指令,高效理解機器人動作與人類行為邏輯,實現從 “執行指令” 到 “理解任務” 的本質跨越。

在復雜交互場景的實測中,機器人可平穩端起盛有水的托盤,運動過程中水面呈現自然真實的水波動態;將托盤放置桌面后,模型憑借任務思維鏈自主規劃,精準判斷牛奶蘋果的擺放位置,有序將物品規整放置于托盤之上。

物理因果一致性全面領先全球主流模型

在倒水、疊平衡石等具有一定難度的物理交互場景中,Kairos 3.0-4B 憑借原生世界模型的物理因果一致性優勢,通過內化物理規律與因果思維鏈,實現了物理因果一致性全面領先主流具身世界模型,展現出對真實世界規則的深度理解與精準復現。

在倒水場景中,Kairos 3.0-4B 控制機器人將水從水杯倒入水槽時,水流速度平穩且液體總量嚴格匹配水杯容量,完全符合質量守恒與流體動力學規律;而 Cosmos 2.5 與 Lingbot 在該場景中則出現水流速度過快的問題,甚至出現液體總量遠超水杯實際容量的異常情況,物理邏輯嚴重失真。

在疊平衡石場景中,Kairos 3.0-4B 精準復現了石頭的剛性與力學平衡特性,每一塊石頭的堆疊都嚴格遵循重力與支撐結構的物理規律;Cosmos 2.5 生成的石頭出現懸浮現象,Lingbot 的石頭則喪失剛性屬性,最底層的石頭甚至憑空消失,物理一致性徹底崩塌。

7分鐘長時連貫場景動態交互

在具身智能領域,長時序視頻生成始終是制約技術落地的核心瓶頸。

憑借 “多模態理解 — 生成 — 預測” 一體化架構,大曉機器人推出的 Kairos 3.0-4B,可結合Agent智能體技術,在長時序視頻生成能力上實現顛覆性突破。Kairos智能體可將用戶復雜交互指令進行層級化解析與結構化拆解,依托模型對序列間的時空演化、物理規則、場景動態及交互邏輯精細化預測,補全連續世界信息,并通過自我反思機制實現閉環迭代優化。最終生成長達 7 分鐘的具身動態交互視頻,且全程保持場景連貫與物理真實,為具身智能的訓練與落地開辟了全新路徑。

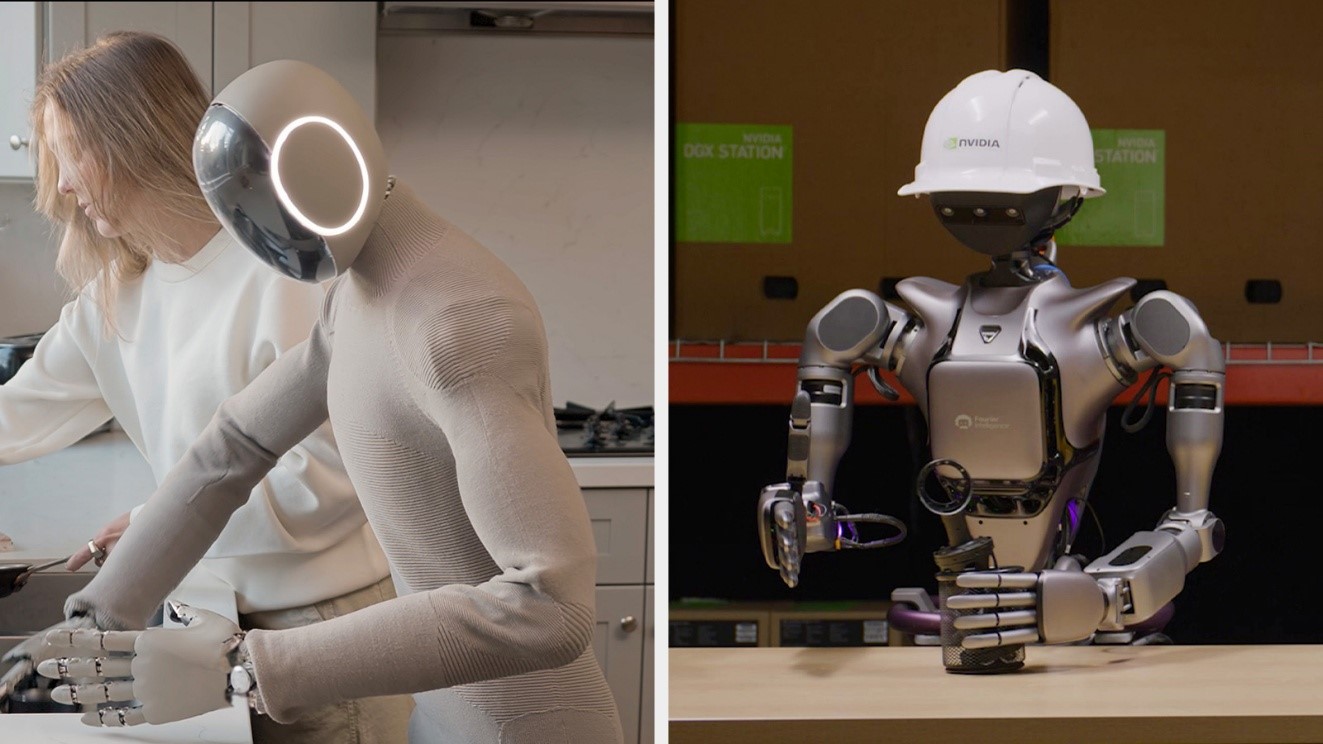

在家庭場景 Demo 中,機器人實現全流程一鏡到底的自主作業:先有序整理桌面上的杯子與紙巾盒,規劃合適位置擺放物品,隨后自主進入洗衣機,撿拾衣服,打開洗衣機、完成衣物投放與清洗操作;接著穿過客廳進入廚房,開啟冰箱取出牛奶,打開壁櫥取出麥片,并打開抽屜取出碗與勺子,將麥片和牛奶倒入碗中,自主完成早餐制備。整個過程無斷點,真實展現了模型的流暢動態交互、物體屬性識別、符合物理規則的受力操控、柔性衣物物理表征能力,并依托完整任務思維鏈實現多場景自主規劃與連貫執行,驗證了模型在復雜家居環境下的物理認知、長時序推理與動態交互能力,后續將持續提升超精細操作能力。

這一能力讓具身智能能夠從容應對多場景下的復雜動態任務。無論是工業制造中的長流程裝配,還是家庭服務中的持續交互,Kairos 3.0-4B 都能生成連貫、真實的場景模擬,顯著提升模型的泛化能力與部署可靠性,推動具身智能從實驗室走向產業一線。

以輕量化實現高效能推理速度

Kairos 3.0-4B 模型憑借架構創新與技術突破,在推理效率、算力消耗、部署適配三大維度均實現業界領先,同時徹底突破具身智能端側實時部署的核心瓶頸。

Kairos 3.0-4B 在行業內率先實現云側 1:1 實時推理,推理速度較 Cosmos 2.5 提升 72 倍。同時,它也是行業首個在 THOR 平臺端側部署的具身世界模型,可在端側實現高效實時推理。依托端側部署,模型可直接輸出機器人從上肢到手指再到下肢的全方位控制指令,省去中間轉譯環節,讓機器人 “想到即可做到”。

在 A800 GPU 性能 Benchmark 中,Kairos 3.0-4B 憑借自研的混合時間線性注意力算子,實現了算力效率與推理速度的數量級突破,性能全面碾壓主流具身世界模型。

推理速度上,Kairos 3.0-4B 完成10秒生成任務耗時僅 9.5 秒,比 Cosmos 2.5(687.2 秒)快約 72 倍,比 Wan 2.2(85 秒)快約 9 倍,比 Lingbot(1436 秒)快約 151 倍。

Kairos 3.0-4B 以 4B 輕量化參數實現 23.5GB 顯存占用,與 5B 的 Wan 2.2 相當,遠低于 14B 的 Cosmos(70.2GB)和 28B 的 Lingbot(46.1GB),在保持極致性能的同時,大幅降低部署門檻,完美適配具身智能端側實時推理需求,打破 “大參數 = 高性能” 的行業固有認知。

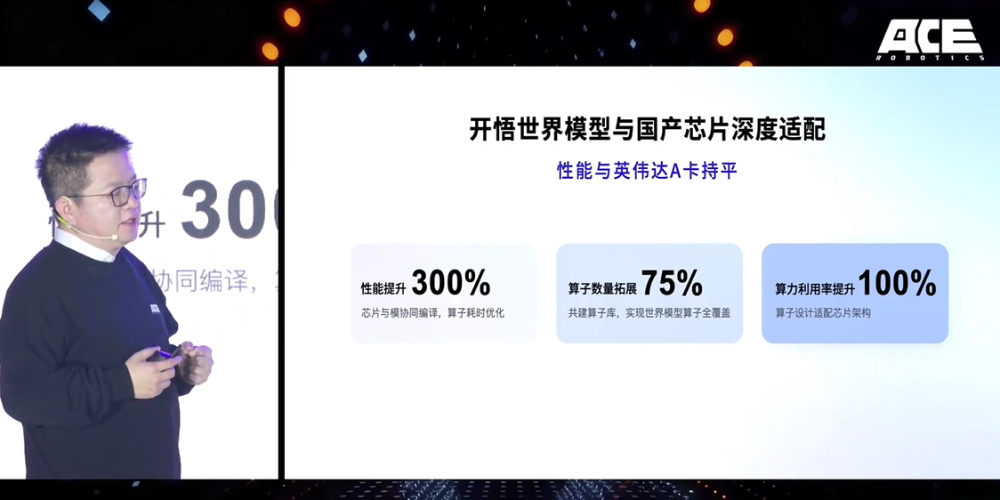

Kairos 3.0-4B 憑借極低的算力消耗與顯存占用,在單卡、多卡環境下均實現業界領先的實時推理速度,完美適配英偉達、沐曦、海光、壁仞等多款 GPU。其高效能特性可直接滿足具身智能系統低延遲、高可靠、端側實時部署的需求,無需依賴昂貴的真機數據,即可實現強泛化與可靠部署。

一腦多形,實現多本體泛化新高度

Kairos 3.0-4B 模型另一大核心優勢是強大的多本體泛化能力,徹底破解了傳統具身模型 “一本體一訓練” 的行業痛點,實現 “同一大腦適配多本體、多任務” 的高效落地。

Kairos 3.0-4B 支持跨本體任務一鍵生成,可無縫適配單臂、雙臂、靈巧手等不同形態的機器人本體,針對同一任務無需額外訓練,即可快速生成適配各本體的執行策略,實現世界知識的高效共享與遷移,適配性拉滿。在硬件兼容上,模型深度支持智元 - 精靈 G1、松靈 - PIPER、宇樹 G1 等主流機器人硬件,打破不同廠商、不同形態設備的本體壁壘。

權威Benchmark性能全面領跑

Kairos 3.0-4B 模型在全球權威具身智能與世界模型評測基準中展現出壓倒性的綜合性能,在具身場景實現全面領跑,精準驗證了其 “物理級深度理解 + 高效能架構” 的核心優勢。

在具身場景中,Kairos 3.0-4B 在三項權威 Benchmark 中均實現性能領跑:

PAI-Bench-robot(物理 AI 具身綜合基準):由佐治亞理工學院與卡內基梅隆大學聯合開發,是物理 AI 領域首個針對具身場景的綜合評測框架,覆蓋 2808 個真實世界案例,被全球頂尖團隊廣泛采用。

Kairos 3.0-4B以80.03分領跑,全面超越 Cosmos 2.5-2B(78.3 分)、阿里Wan 2.2-5B(78.6 分)、Cosmos 2.5-14B(79.4分)及螞蟻 Lingbot(79.96分),驗證了其在具身任務執行、物理交互穩定性上的行業第一地位。

WorldModelBench-robot TI2V(文本到具身視覺生成基準):在CVPR 2025 Workshop提出,是首個專門評估世界模型文本到具身視覺生成能力的基準,通過 67K 人類標注數據精準檢測物理一致性與指令遵循能力。

Kairos 3.0-4B以9.08分超越所有競品,顯著領先阿里Wan 2.2-5B(8.52分)、Cosmos 2.5-14B(8.94分),以及Cosmos 2.5-2B、螞蟻Lingbot(均為9.04分),證明其在長時序物理場景理解與生成精度上的領先性。

DreamGen Bench (PA/IF)(機器人視頻生成基準):由 NVIDIA GEAR Lab 開發,通過物理對齊(PA)與交互保真(IF)兩項核心指標,直接評估模型生成數據的物理合理性與交互質量,是機器人領域的權威評測工具。

Kairos3.0-4B的PA得分為0.529,大幅領先阿里Wan 2.2-5B(0.314),提升近70%;同時領先Cosmos 2.5-2B(0.418)、Cosmos 2.5-14B(0.495)、螞蟻Lingbot(0.466),分別提升27%、7% 和14%。IF得分為0.609,同樣全面超越競品,相較于Cosmos 2.5-2B、阿里Wan2.2-5B、Cosmos 2.5-14B、螞蟻Lingbot,分別提升7%、12%、27%和7%,直接驗證了其物理因果一致性的核心優勢。

*(上述精度測試基于開源模型復現,其中robot為對應具身子集的結果)

作為中國自研的原生具身世界模型,Kairos 3.0-4B 直擊行業數據、算力、物理推理與落地部署等核心瓶頸。該模型既可作為高效數據仿真器,低成本、規模化放大訓練數據體量,有效破解真機交互數據稀缺的行業痛點;更能跳出純仿真應用范疇,直接驅動機器人本體完成各類實體任務,真正打通從虛擬仿真到物理執行的全鏈路,讓機器人擁有聰明的“大腦”,加速具身智能智慧躍遷,為具身智能的規模化落地提供核心技術支撐,為全球具身智能行業發展貢獻了領先的中國方案。

該技術成果已上傳:

Code:

https://github.com/kairos-agi/kairos-sensenova

Hugging Face:

https://huggingface.co/kairos-agi/kairos-sensenova-common

-

機器人

+關注

關注

213文章

31147瀏覽量

222641 -

模型

+關注

關注

1文章

3769瀏覽量

52141 -

商湯科技

+關注

關注

8文章

613瀏覽量

37581

原文標題:72倍推理提速、7分鐘長視頻生成!大曉機器人開源實時生成世界模型 Kairos 3.0-4B

文章出處:【微信號:SenseTime2017,微信公眾號:商湯科技SenseTime】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

大曉機器人開源空間智能通用模型ACE-Brain-0

借助NVIDIA Isaac Sim與World Labs Marble加速機器人仿真環境構建

中科曙光與商湯科技、大曉機器人達成戰略合作

商湯科技聯合創始人王曉剛擔任大曉機器人董事長

NVIDIA 利用全新開源模型與仿真庫加速機器人研發進程

利用NVIDIA Cosmos模型訓練通用機器人

開源鴻蒙驅動機器人與AI產業生態發展,M-Robots OS正式開源

明遠智睿SSD2351開發板:語音機器人領域的變革力量

【「# ROS 2智能機器人開發實踐」閱讀體驗】視覺實現的基礎算法的應用

大象機器人攜手進迭時空推出 RISC-V 全棧開源六軸機械臂產品

NVIDIA Isaac GR00T N1開源人形機器人基礎模型+開源物理引擎Newton加速機器人開發

NVIDIA 發布全球首個開源人形機器人基礎模型 Isaac GR00T N1——并推出加速機器人開發的仿真框架

大曉機器人開源實時生成世界模型Kairos 3.0-4B

大曉機器人開源實時生成世界模型Kairos 3.0-4B

評論