NVIDIA 正式推出NVIDIA Jetson T4000,將高性能 AI 與實時推理能力帶入更廣泛的機器人和邊緣 AI應用。T4000 針對更嚴格的功耗和散熱限制進行了優化,最高可提供 1200 FP4 TFLOPs 的 AI 算力和 64 GB 內存,在性能、能效和可擴展性之間實現了理想平衡。憑借高能效設計和量產就緒的形態規格,T4000 讓先進 AI 技術更容易被新一代智能機器采用,包括自主機器人、智慧基礎設施和工業自動化等應用場景。

該模組集成 1 路 NVENC 和 1 路 NVDEC 硬件視頻編解碼引擎,支持實時 4K 視頻編碼與解碼。這種均衡設計非常適合需要將先進視覺處理與 I/O 能力相結合、同時又必須滿足功耗和散熱要求的平臺。

| 參數 | NVIDIA Jetson T4000 | NVIDIA Jetson T5000 |

| AI 性能 | 1,200 FP4 稀疏 TFLOPs | 2,070 FP4 稀疏 TFLOPs |

| GPU | 1,536 核 NVIDIA Blackwell 架構 GPU,配備第五代 Tensor Core; 支持多實例 GPU(6 個 TPC) | 2,650 核 NVIDIA Blackwell 架構 GPU,配備第五代 Tensor Core; 支持多實例 GPU(10 個 TPC) |

| 內存 | 64 GB,256-bit LPDDR5x|273 GB/s | 128 GB,256-bit LPDDR5x|273 GB/s |

| CPU | 12 核 Arm Neoverse-V3AE 64 位 CPU | 14 核 Arm Neoverse-V3AE 64 位 CPU |

| 視頻編碼 | 1x NVENC | 2x NVENC |

| 視頻解碼 | 1x NVDEC | 2x NVDEC |

| 網絡 | 3x 25GbE | 4x 25GbE |

| I/Os | 最多 8 條 PCIe Gen5 通道;5× I2S;1× 音頻集線器(AHUB);2× DMI;4× UART;3× SPI;13× I2C;6× PWM 輸出 | 最多 8 條 PCIe Gen5 通道;5× I2S;2× 音頻集線器(AHUB);2× DMI;4× UART;4× CAN;3× SPI;13× I2C;6× PWM 輸出 |

| 功耗 | 40W-70W | 40W-130W |

表 1. Jetson T4000 模組與 Jetson T5000 模組的核心規格

Jetson T4000 模組在外形尺寸和引腳定義上與 NVIDIA Jetson T5000 模組完全兼容。開發者可以為 T4000 和 T5000 設計通用載板,只需在散熱和模組固有特性方面考慮差異即可。

NVIDIA Jetson T4000與T5000性能基準測試

Jetson T4000 和 T5000 模組在多種大語言模型(LLM)、文本轉語音(TTS)以及視覺-語言-動作(VLA)模型上都表現出色。相比上一代 NVIDIA Jetson AGX Orin 平臺,Jetson T4000 的性能最高可提升至 2 倍。下表展示了 T4000 與 T5000 在主流 LLM、TTS 和 VLA 模型上的性能數據。

| 模型家族 | 模型 |

Jetson T4000 (tokens/sec) |

Jetson T5000 (tokens/sec) |

T4000 vs T5000 |

| QWEN | Qwen3-30B-A3B | 218 | 258 | 0.84 |

| QWEN | Qwen 3 32B | 68 | 83 | 0.82 |

| Nemotron | Nemotron 12B | 40 | 61 | 0.66 |

| DeepSeek | DeepSeek R1 Distill Qween 32B | 64 | 82 | 0.78 |

| Mistral | Mistral 3 14B | 100 | 109 | 0.92 |

| Kokoro TTS | Kokoro 82M | 1,100 | 900 | 0.82 |

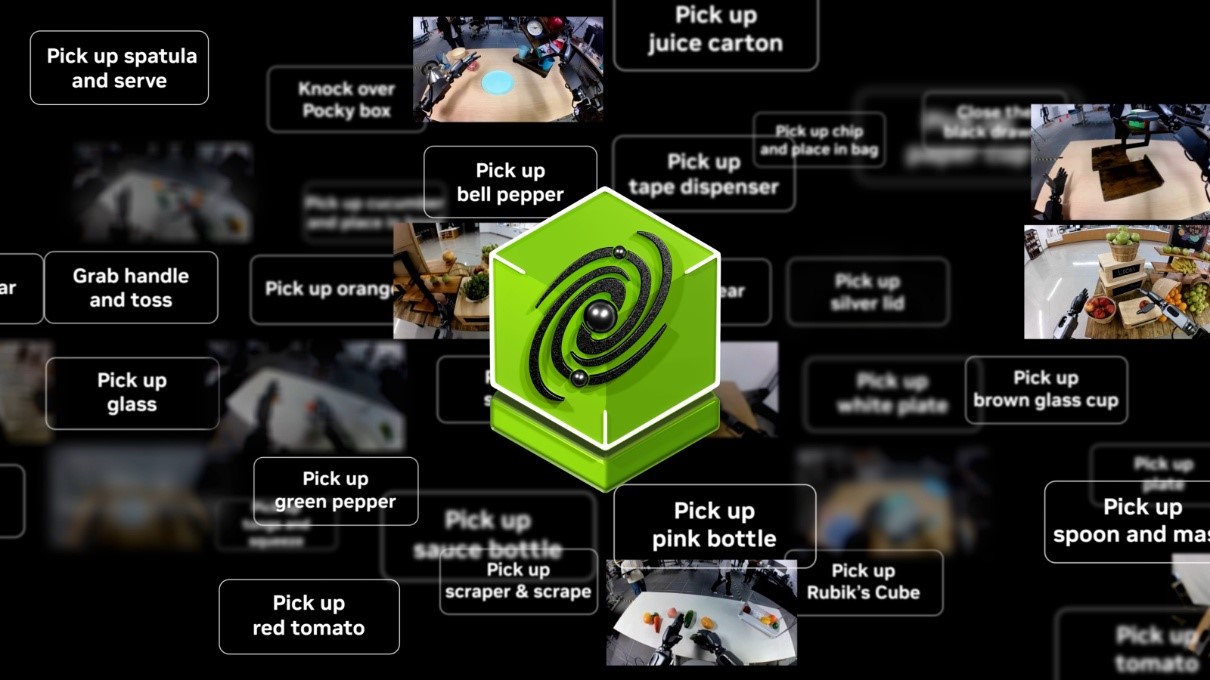

| GR00T | GR00T N1.5 | 376 | 410 | 0.92 |

表2. Jetson T4000與Jetson T5000模組的性能基準測試

NVIDIA JetPack 7.1:面向下一代邊緣AI的先進軟件棧

NVIDIAJetPack 7是目前 Jetson 平臺最先進的軟件套件,能夠為在邊緣端部署生成式 AI和人形機器人提供支持。全新的 Jetson T4000 模組由 JetPack 7.1 驅動,并引入了多項增強 AI 與視頻編解碼能力的軟件新特性。

NVIDIA TensorRT Edge-LLM:提升機器人和邊緣系統的推理能力

在 JetPack 7.1 中,NVIDIA 正式為 Jetson Thor 平臺引入對TensorRTEdge-LLM 的支持。

TensorRT Edge-LLMSDK 是一個開源的 C++ SDK,用于在 Jetson 等邊緣平臺上高效運行 LLM 和視覺語言模型(VLM)。它面向機器人及其他實時系統,這些系統需要現代 LLM 的智能能力,但無法承受數據中心級別的計算、內存和功耗需求。

大多數主流 LLM 技術棧都是圍繞云端 GPU 設計的:擁有充足的內存、寬松的時延要求、大量 Python 服務以及彈性擴展作為保障。而機器人和其他邊緣設備所面臨的約束完全不同——每一毫秒、每一瓦功耗以及運行時行為都會直接影響物理世界中的實際動作。TensorRT Edge-LLM SDK 正是為填補這一差距而設計,它為 Jetson Thor 級別的嵌入式 GPU 提供了面向量產的 LLM 運行時。

在機器人工作負載中,目標不僅僅是“能夠運行一個 LLM”,而是要讓 LLM 與感知、控制和規劃等已經高度占用 GPU 和 CPU 資源的系統協同運行。以邊緣為先的設計理念意味著 LLM 運行時需要與現有 C++ 代碼庫無縫集成,遵循嚴格的內存預算,并在高負載下提供可預測的時延。

TensorRT Edge-LLM SDK 專注于在邊緣端實現 LLM 和 VLM 的快速、高效推理,并與 PyTorch 等主流訓練生態保持兼容。典型工作流非常直接:將訓練好的模型導出為 ONNX,通過 TensorRT 進行優化,然后在設備端由 SDK 端到端驅動推理引擎運行。

其中一個顯著特征在于,該方案以輕量級 C++ 工具包的形式實現,最初針對NVIDIA DriveOS LLM SDK中的車載系統進行了優化。相比由大量 Python 包、Web 服務器和后臺服務堆疊而成的復雜依賴體系,開發者只需鏈接一個精簡的 C++ 運行時,該運行時可直接與 TensorRT 和NVIDIA CUDA進行交互。

與以 Python 為中心的 LLM 框架相比,這種方式為機器人應用帶來了多項實際優勢,包括:

更低的系統開銷:C++ 可執行文件避免了 Python 解釋器啟動開銷、垃圾回收暫停以及 GIL 競爭,更容易滿足嚴格的時延要求。

更易于實時系統集成:C++ 能更直接地控制線程、內存池和調度機制,非常契合實時或準實時的機器人軟件架構。

更小的軟件體量:更少的依賴使 Jetson 上的部署更簡單,容器鏡像更小,也讓 OTA 更新更加穩健。

量化是提升效率的關鍵手段之一。該 SDK 支持 FP8、NVFP4 和 INT4 等多種低精度格式,在合理調優的情況下,可在較小精度損失下顯著壓縮模型權重和 KV-cache 的占用。

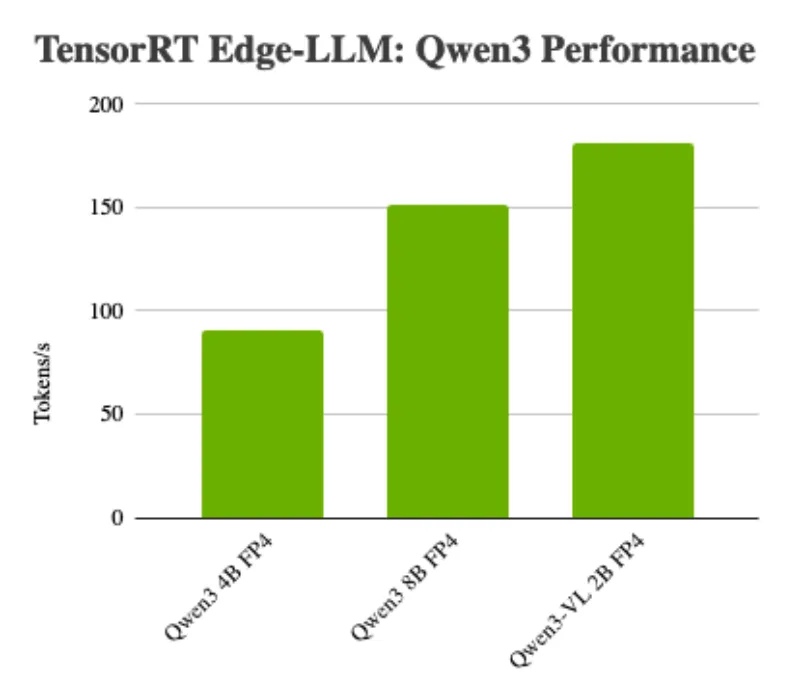

圖 1. TensorRT Edge-LLM 在多種 Qwen3 模型上的性能表現

Video Codec SDK:為Jetson Thor提供實時感知與媒體處理能力

隨著 JetPack 7.1 的發布,NVIDIA Video Codec SDK現已支持 Jetson Thor。

Video Codec SDK 是一套完整的 API、 高性能工具、示例應用、可復用代碼和文檔集合,用于在 Jetson Thor 平臺上實現硬件加速的視頻編碼和解碼。其核心是 NVENCODE 和 NVDECODE API,提供 C 風格接口,可高效訪問 NVENC 和 NVDEC 硬件加速器,暴露絕大多數硬件能力以及常用和高級編解碼特性。

為簡化集成,SDK 還在這些 API 之上封裝了可復用的 C++ 類,使應用能夠輕松使用 NVENCODE 或 NVDECODE 接口所提供的完整功能集。

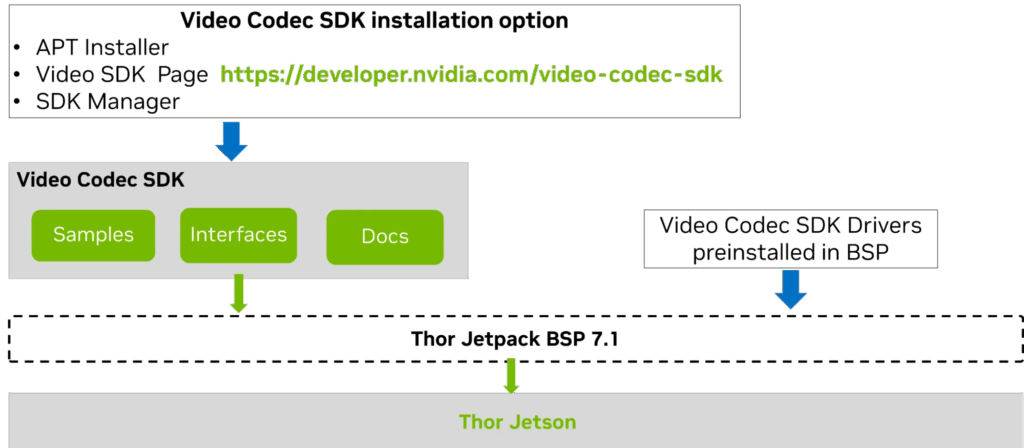

圖 2 展示了 JetPack 7.1 BSP 中 Video Codec SDK 及其驅動的整體架構,以及相關的示例應用和文檔。

圖 2. Video Codec SDK 架構

Video Codec SDK 為多媒體開發者帶來以下關鍵優勢。

跨NVIDIA GPU的統一開發體驗

借助 Video Codec SDK,開發者可以在整個 NVIDIA GPU 產品線上獲得一致、簡化的開發體驗,無需為不同 GPU 類別維護獨立的代碼庫或調優策略,從而降低工程成本。

基于 GPU 的應用可以通過 Video SDK API 無縫擴展或遷移到 Jetson Thor 的集成 GPU 上,而無需重新設計視頻處理流程。嵌入式平臺團隊也能使用與工作站和服務器一致的成熟 API 及工具,并獲得相同級別的性能優化。這種一致性不僅加速了開發與驗證,還能夠讓長期維護、系統擴展以及跨平臺功能一致性保障更加便利。

對下一代機器人感知與多媒體應用的精細化控制

Video Codec SDK 提供了將預設與調優模式相結合的 API,使開發者能夠精確控制視頻質量、時延和吞吐量,實現高度靈活的、面向具體應用的編碼策略。

通過對重建幀訪問和迭代編碼的 API 支持,SDK 可實現 CABR 工作流,自動在保證感知質量的前提下找到最低碼率,從而降低帶寬需求。同時,通過 SDK 暴露的空間/時間自適應量化(AQ)與前瞻控制機制,可以實現細粒度的感知質量優化,將碼率精準分配到最重要的區域,從而在不增加碼率的前提下獲得更清晰、更穩定的視頻效果。

Video Codec SDK 主要由兩大部分組成:

視頻用戶態驅動通過 NVENCODE 和 NVDECODE API 訪問片上硬件編碼器和解碼器

Video Codec SDK 13.0 包含示例代碼、頭文件和文檔,可通過NVIDIA Video Codec SDK網頁,使用 APT(參考操作說明)或 通過NVIDIA SDK Manager安裝

圖3. Video Codec SDK的組成

PyNvVideoCodec是 NVIDIA 提供的 Python 視頻編解碼庫,為 NVIDIA GPU 上的硬件加速視頻編碼和解碼提供了簡潔而強大的 Python API。

PyNvVideoCodec 庫在內部調用 Video Codec SDK 的核心 C/C++ 編解碼接口,同時對外提供易用的 Python API,其性能與直接使用Video Codec SDK非常接近。

開始開發

NVIDIA Jetson T4000擁有成熟的合作伙伴生態,提供量產就緒的系統方案,幫助用戶快速從原型階段過渡到實際部署。開發者可以直接選擇經過驗證的邊緣系統,這些系統已集成模組、電源、散熱設計以及機器人和物理 AI 工作負載所需的 I/O。眾多合作伙伴的系統充分利用了模組的先進攝像頭處理流程,支持 MIPI CSI 和 GMSL,能夠處理高要求的多攝像頭實時視覺任務。Jetson T4000 提供 16 條 MIPI CSI 通道,使合作伙伴能夠打造可同時接入多路攝像頭的視頻采集平臺,支持復雜的機器人、工業檢測和自主機器應用。

這些系統均針對 JetPack SDK、CUDA 以及完整的 NVIDIA AI 軟件棧進行了優化,現有應用和模型通常只需極少修改即可遷移。眾多合作伙伴還提供生命周期支持、區域認證和定制化服務,幫助團隊在從試點到規模化部署的過程中降低供應鏈和合規風險。想要了解可用系統并找到最適合您應用的方案,請訪問NVIDIA 生態系統頁面。

總結

借助由 JetPack 7.1 驅動的 Jetson T4000,NVIDIA 將 Blackwell 級 AI 能力、實時推理和先進多媒體功能擴展到更廣泛的邊緣與機器人應用領域。從在 LLM、語音和 VLA 工作負載上的顯著性能提升,到 TensorRT Edge-LLM 的引入以及統一的 Video Codec SDK,T4000 在性能、能效和軟件成熟度之間實現了出色平衡。Jetson T4000 使開發者能夠在不同性能層級之間靈活擴展,在邊緣端構建下一代自主機器、感知系統和物理 AI 解決方案。

關于作者

Shashank Maheshwari 是 NVIDIA Jetson 軟件產品經理。他擁有杜克大學 (Duke University)、Fuqua 商學院 (The Fuqua School of Business) 工商管理碩士 (MBA) 學位和工商管理學士 (B.E.) 學位來自 BITS Pilani 的電子產品。

Aayush Pathak 是 NVIDIA 的硬件產品經理,專注于嵌入式邊緣和自主機器領域。他在半導體行業擁有豐富的經驗,設計過超級計算機 SoC,并致力于開發低功耗、節能的硬件。他擁有南加州大學電氣工程碩士學位和芝加哥大學工商管理碩士學位。

Suhas Sheshadri 是 NVIDIA 的產品經理,專注于 Jetson 軟件。他以前在NVIDIA 的自主駕駛團隊工作,為 NVIDIA 驅動平臺優化系統軟件。在空閑時間,蘇哈斯喜歡閱讀量子物理和博弈論方面的書籍。

-

機器人

+關注

關注

213文章

31226瀏覽量

223040 -

NVIDIA

+關注

關注

14文章

5665瀏覽量

109975 -

AI

+關注

關注

91文章

40430瀏覽量

302019

原文標題:CES 2026 | 借助 NVIDIA Jetson T4000 與 NVIDIA JetPack 7.1,加速邊緣與機器人 AI 推理

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

NVIDIA 在首個AI推理基準測試中大放異彩

嵌入式模擬智能機器人

嵌入式模擬智能為機器人提供了新的自主水平

NVIDIA發布AI Enterprise軟件套件,助力各行業釋放AI潛力

NVIDIA AI機器人開發— NVIDIA Isaac Sim入門

GTC23 | NVIDIA 擴大 Isaac 軟件的接入范圍并提高 Jetson 平臺的可用性,加快機器人技術從云到邊緣的發展

開發者使用 NVIDIA Jetson 讓 AI 驅動維修機器人

NVIDIA Jetson還能讓AI驅動維修機器人?

使用機器學習和NVIDIA Jetson邊緣AI和機器人平臺打造機器人導盲犬

使用NVIDIA Jetson打造機器人導盲犬

NVIDIA 通過云端至機器人計算平臺驅動人形機器人技術,賦能物理 AI

基于 NVIDIA Blackwell 的 Jetson Thor 現已發售,加速通用機器人時代的到來

基于NVIDIA模組與軟件套件推動邊緣與機器人AI推理

基于NVIDIA模組與軟件套件推動邊緣與機器人AI推理

評論