作者:飛槳開發者技術專家 劉力

| 適合人群:剛接觸 PaddleOCR-VL + Docker部署的同學

| 學習目標:從一臺剛裝好的 Ubuntu 24.04 開始,完成 Docker 環境準備 → 拉起 PaddleOCR-VL 服務 → 本機用 HTTP 調用 /layout-parsing 接口跑通文檔解析。

一,PaddleOCR-VL是什么、為什么用 Docker?

PaddleOCR-VL 是基于輕量級視覺語言模型(VLM)的文檔解析解決方案,核心模型為 PaddleOCR-VL-0.9B,支持多語言文本、表格、公式、圖表等元素級識別,并能以較低資源消耗達到 行業SOTA水平。本文推薦讀者使用 Docker / Docker Compose 來部署PaddleOCR-VL——好處是依賴打包好、命令少、復現穩定,并且便于生產化擴展(端口、GPU 綁定、掛載配置等)。

1. 環境要求與硬件兼容性(必須確認)

1.1 NVIDIA GPU(推薦):

若用 vLLM 或 FastDeploy 加速后端,官方要求NVIDIA 驅動支持 CUDA 12.6(并推薦顯卡 CC ≥ 8.0,例如 RTX 30/40/50、A10/A100 等)

CUDA 12.6 通常對應 560+ 版驅動(NVIDIA 說明文檔示例)

1.2 操作系統:Ubuntu 24.04(LTS)。

1.3 Docker 版本:≥ 19.03

| 檢查 GPU 驅動與 CUDA 運行 nvidia-smi ,請確認NVIDIA 驅動版本 > 560+(推薦: 580 )

2. 安裝 Docker 與 NVIDIA Container Toolkit

目的:讓 Docker 能調用宿主機 GPU,并保證后續鏡像/Compose 運行順暢。

2.1 安裝 Docker Engine

參考Docker官方文檔 , 安裝Docker Engine。

https://docs.docker.com/engine/install/ubuntu/

2.2 安裝 NVIDIA Container Toolkit(讓容器獲得 GPU)

參考NVIDIA官方安裝指南:

安裝NVIDIA Container Toolkit,讓Docker容器能直接使用宿主機上的NVIDIA GPU。

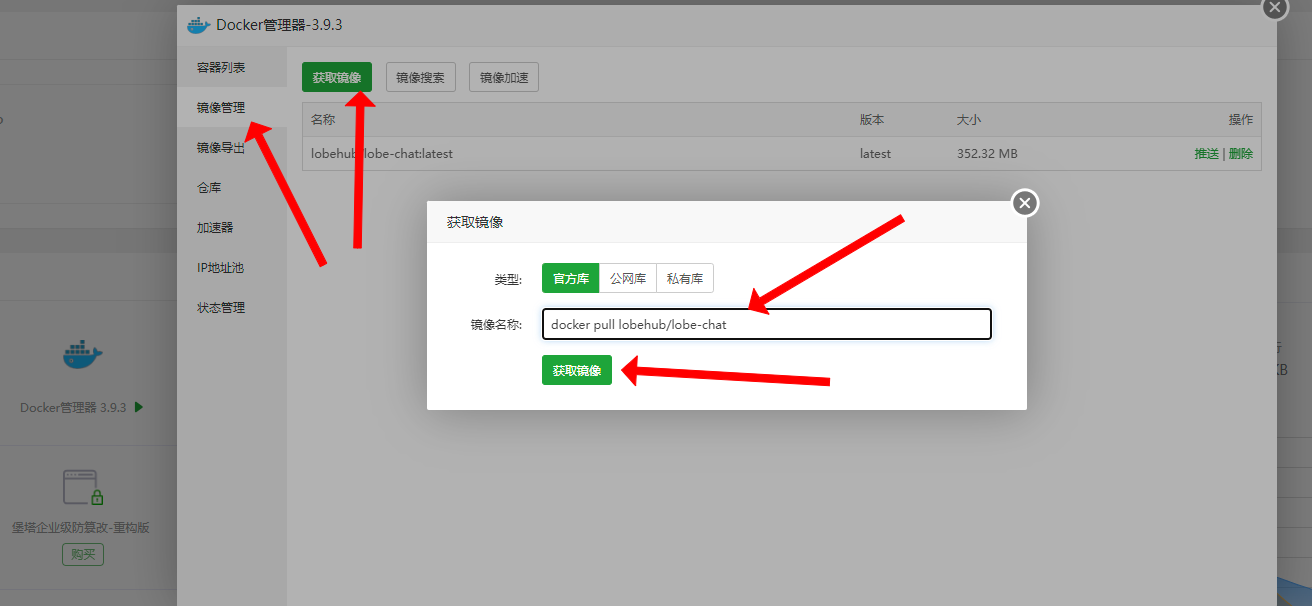

3. 用 Docker 拉取 PaddleOCR-VL官方鏡像

3.1:直接拉取官方鏡像

若機器能連外網,直接 docker pull 官方鏡像(推薦):

# 要求:Docker ≥ 19.03,主機有 GPU,NVIDIA 驅動支持 CUDA 12.6+ docker run -it --gpus all --network host --user root ccr-2vdh3abv-pub.cnc.bj.baidubce.com/paddlepaddle/paddleocr-vl:latest /bin/bash # 進入容器后,可用 PaddleOCR CLI 或 Python API

3.2 使用PaddleOCR CLI

鏡像啟動后,可以使用PaddleOCR CLI,一行命令即可快速體驗 PaddleOCR-VL 效果:

paddleocr doc_parser -i https://paddle-model-ecology.bj.bcebos.com/paddlex/imgs/demo_image/paddleocr_vl_demo.png

PaddleOCR CLI的詳細參數, 請參考:

3.3 使用PaddleOCR Python API

命令行方式是為了快速體驗查看效果,實際使用建議用Python API,將PaddleOCR-VL的能力集成到您的應用中。

首先,在容器中創建Python腳本:

cat > demo_vl.py

然后,在容器中執行:

python demo_vl.py

PaddleOCR-VL 提供了開箱即用的 Python 推理接口 PaddleOCRVL。在官方 Docker 鏡像中,相關依賴與模型已預先安裝,用戶只需初始化推理管線并調用 predict() 方法即可完成文檔理解任務。推理結果可直接導出為結構化 JSON 或 Markdown,方便下游系統集成。

二,總結

至此,我們已經從 一臺全新的 Ubuntu 24.04 環境 出發,完整走通了 PaddleOCR-VL 的 Docker 化部署與使用流程。你不需要手動安裝 CUDA 或下載模型,只需準備好合適版本的 NVIDIA 顯卡驅動、Docker 和 NVIDIA Container Toolkit,即可通過官方 Docker 鏡像快速獲得一個可直接用于生產驗證的文檔解析環境。

通過本文,你已經掌握了以下關鍵能力:

理解 PaddleOCR-VL 的定位與優勢,以及為什么 Docker 是最省心、最穩定的部署方式

明確 硬件與驅動要求,避免因 CUDA / 驅動版本不匹配導致的隱性問題

完成 Docker 與 GPU 環境準備,并成功在容器中識別和使用 NVIDIA GPU

使用 PaddleOCR CLI 快速體驗文檔解析效果

使用 Python API(PaddleOCRVL) 將文檔解析能力集成到自己的應用中,并導出 結構化 JSON / Markdown 結果

對于剛入門的用戶來說,這已經是一個“最小可用閉環”:

|從 0 到 1 跑通環境 → 看到效果 → 拿到結構化結果。

在此基礎上,你可以繼續深入探索更貼近實際業務的場景,例如:

使用 Docker Compose 將 PaddleOCR-VL 以服務形式部署,對外提供 HTTP API

批量解析 PDF、多頁文檔,或對接對象存儲

將解析結果接入 RAG / 向量數據庫 / 搜索系統,構建文檔理解與問答應用

根據實際文檔類型,靈活開啟或關閉版面分析、方向校正、圖像矯正等模塊

希望這篇“保姆級教程”能幫你 少踩坑、快上手、跑得穩。當你第一次成功跑出結構化結果時,PaddleOCR-VL 的真正價值,也就自然展現在你眼前了。

祝你使用順利,玩得開心

審核編輯 黃宇

-

Docker

+關注

關注

0文章

532瀏覽量

14242

發布評論請先 登錄

方便快捷:PADS的一鍵快捷功能:一鍵灌銅,一鍵檢查DRC

一鍵還原小工具

一鍵的TensorRT加速方式,極大的提升了部署的效率

Jenkins+docker+springboot一鍵自動部署項目

Jenkins+Docker一鍵自動化部署SpringBoot項目

Jenkins+Docker實現一鍵自動化部署項目!

PLC對一鍵啟停不同方式的程序編寫

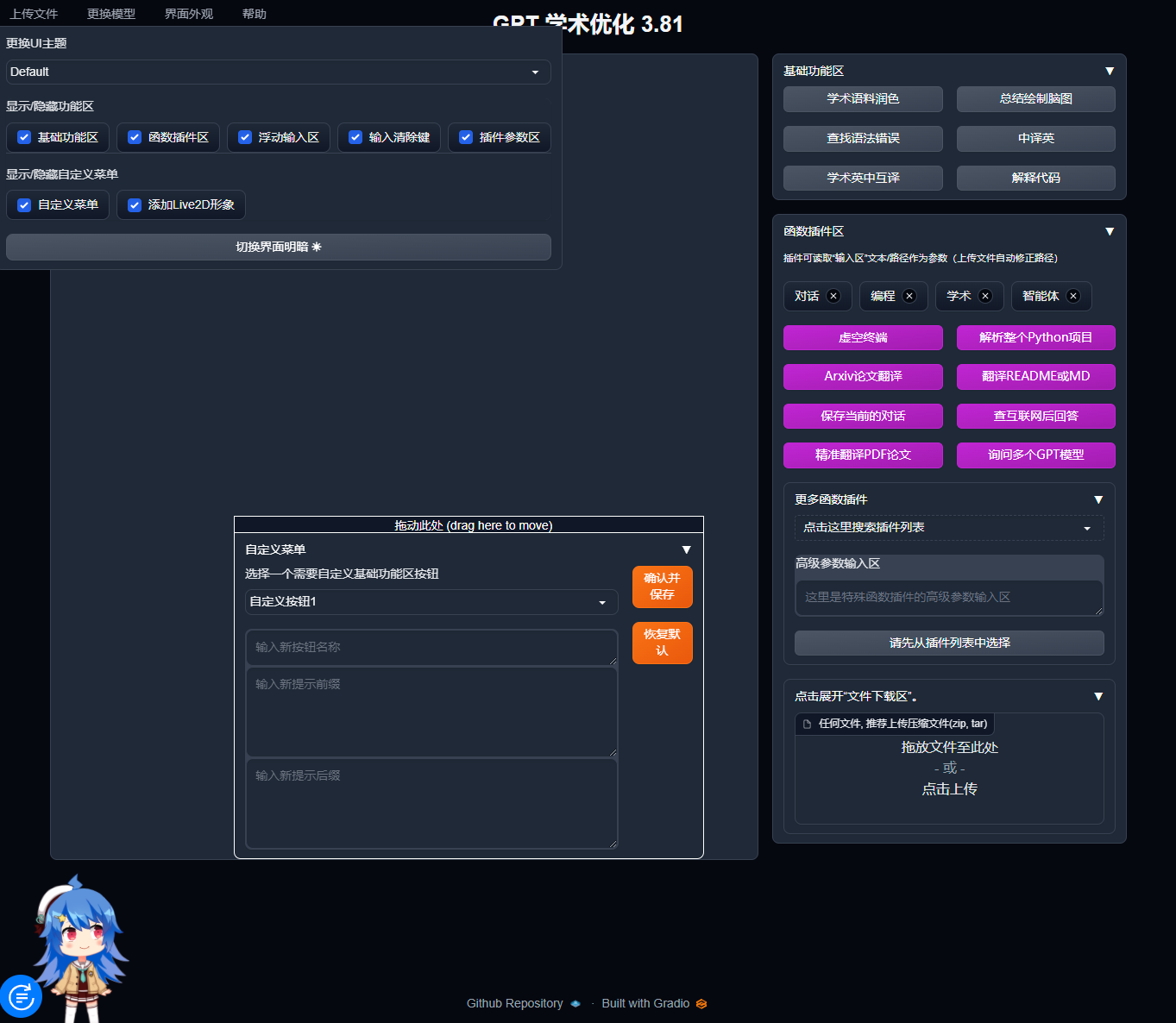

寶塔面板一鍵免費部署LobeChat聊天機器人開發自己私有的ChatGPT

寶塔面板Docker一鍵安裝:部署GPTAcademic,開發私有GPT學術優化工具

開關柜一鍵順控在一鍵停電、一鍵送電中的作用

百度正式發布并開源新一代文檔解析模型PaddleOCR-VL-1.5

沐曦曦云C500/C550 GPU產品適配PaddleOCR-VL-1.5模型

使用 Docker 一鍵部署 PaddleOCR-VL: 新手保姆級教程

使用 Docker 一鍵部署 PaddleOCR-VL: 新手保姆級教程

評論