在深度學(xué)習(xí)產(chǎn)業(yè)落地過程中,我們經(jīng)常能聽到一種說法——模型部署是打通AI應(yīng)用的最后一公里!想要走通這一公里,看似簡單,但是真正實(shí)踐起來卻困難重重:顯卡利用率低、內(nèi)存溢出、多線程調(diào)度奔潰、TensorRT加速算子不支持等等問題一直是深度學(xué)習(xí)模型最后部署的老大難問題。

在工業(yè)制造環(huán)境中,Windows系統(tǒng)有著廣泛的應(yīng)用。為了更好的幫助工業(yè)用戶解決落地最后的一公里問題,飛槳聯(lián)合產(chǎn)業(yè)用戶,基于Windows系統(tǒng),提供了工業(yè)級(jí)的部署Demo,支持圖像分類、目標(biāo)檢測、實(shí)例分割和語義分割模型的部署,并提供了一鍵的TensorRT加速方式,極大的提升了部署的效率,同時(shí)支持多線程推理的方式,滿足了用戶多視頻輸入預(yù)測的需求!

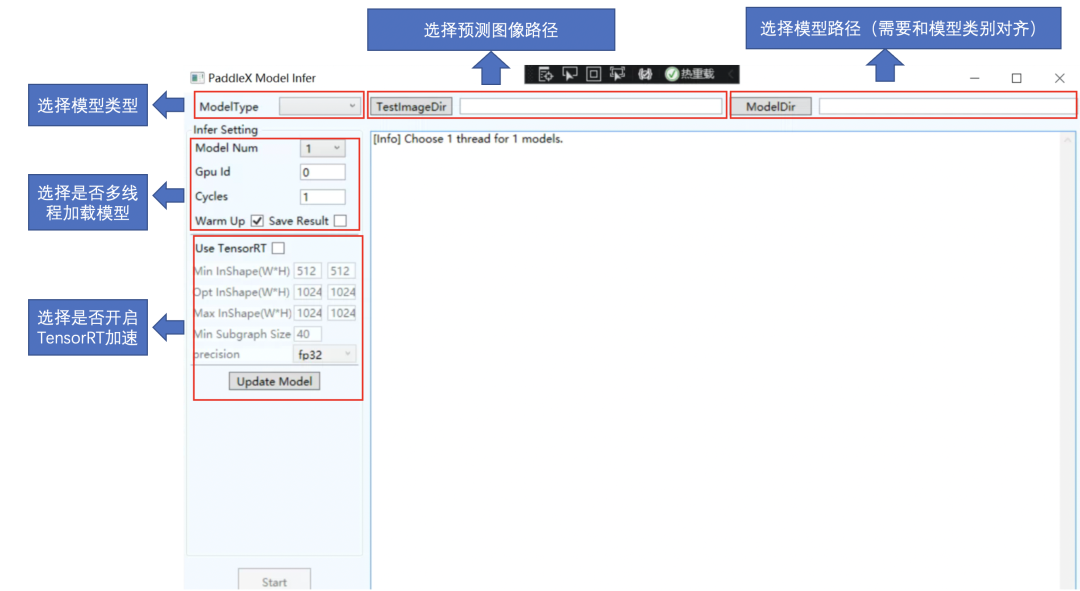

圖1部署開發(fā)示例說明

部署Demo地址,歡迎大家star收藏。

https://github.com/PaddlePaddle/PaddleX/tree/develop/deploy/cpp/docs/csharp_deploy

支持多種類別模型部署

滿足多種場景需求

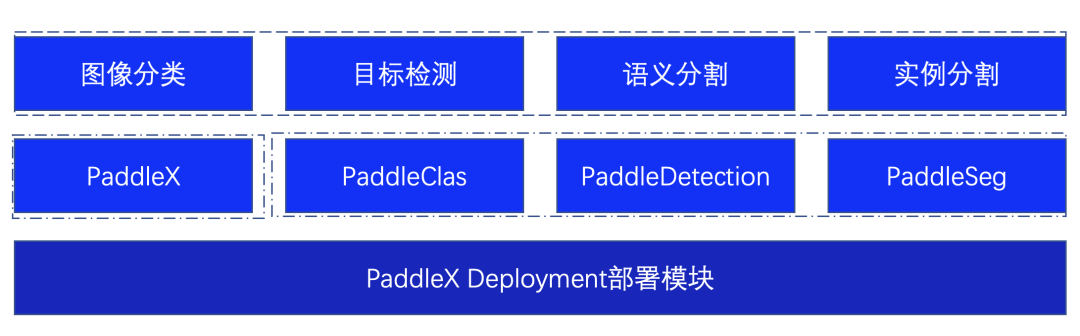

為了更好的滿足用戶多種視覺任務(wù)場景,部署Demo基于PaddleX的Deployment模塊進(jìn)行二次開發(fā),不僅僅支持對(duì)PaddleX自身訓(xùn)練的模型進(jìn)行推理,同時(shí)支持PaddleClas、PaddleDetection、PaddleSeg視覺開發(fā)套件的模型,滿足多種場景需求。

圖2 部署Demo支持模型說明

一鍵TensorRT加速

部署效率顯著提升

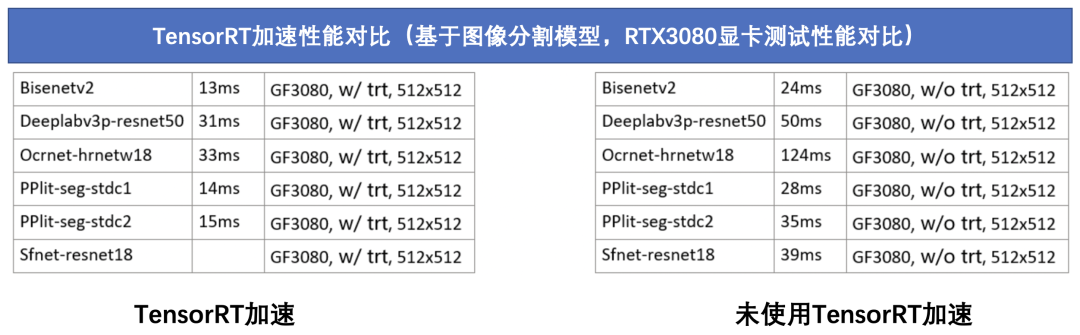

NVIDIA TensorRT 是一個(gè)高性能的深度學(xué)習(xí)預(yù)測庫,可為深度學(xué)習(xí)推理應(yīng)用程序提供低延遲和高吞吐量。在部署Demo中集成了TensorRT預(yù)測庫,用戶只需一鍵啟動(dòng),即可進(jìn)行高性能的部署。

圖3 部署Demo性能對(duì)比說明

為了更好的幫助用戶了解在工業(yè)制造場景部署的問題,飛槳邀請產(chǎn)業(yè)用戶現(xiàn)場coding,一步步帶著大家現(xiàn)場演示如何搭建部署開發(fā)示例,如何更高性能的應(yīng)用在自己的產(chǎn)業(yè)落地中。

審核編輯 :李倩

-

多線程

+關(guān)注

關(guān)注

0文章

279瀏覽量

21025 -

工業(yè)制造

+關(guān)注

關(guān)注

0文章

445瀏覽量

28788

原文標(biāo)題:TensorRT加速、多線程部署,打通工業(yè)高性能部署最后一公里

文章出處:【微信號(hào):mcugeek,微信公眾號(hào):MCU開發(fā)加油站】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評(píng)論請先 登錄

DP1323EL的電動(dòng)車解鎖方案:超高速讀寫,提升電動(dòng)車一鍵解鎖體驗(yàn)

基于DP1323EL的電動(dòng)車解鎖方案:超高速讀寫,提升電動(dòng)車一鍵解鎖體驗(yàn)

基于DP1323EL的電動(dòng)車解鎖方案:超高速讀寫,提升電動(dòng)車一鍵解鎖體驗(yàn)

NVIDIA TensorRT LLM 1.0推理框架正式上線

一鍵開關(guān)機(jī)芯片GEK100,替代 ADI 的 MAX16169和MAX16054

如何在魔搭社區(qū)使用TensorRT-LLM加速優(yōu)化Qwen3系列模型推理部署

HarmonyOS應(yīng)用一鍵置灰指南

開關(guān)柜一鍵順控在軌道交通領(lǐng)域的應(yīng)用和效果

閃測儀開機(jī)放件按一鍵,尺寸測量報(bào)告秒生成

“一鍵搞定”:PROFINET與CCLINK IE的工業(yè)以太網(wǎng)解決方案

開關(guān)柜一鍵順控在智能配電運(yùn)管系統(tǒng)扮演什么角色?

一鍵自動(dòng)升降,DZ-TGA201開啟熱重分析智能化

一鍵的TensorRT加速方式,極大的提升了部署的效率

一鍵的TensorRT加速方式,極大的提升了部署的效率

評(píng)論