本文轉自:Coggle數據科學

AI 智能體領域發(fā)展迅猛,但許多資源仍然過于抽象和理論化。創(chuàng)建此項目的目的是為開發(fā)者、研究人員和AI愛好者提供一條結構化、實用且深入的學習路徑,以掌握構建智能系統(tǒng)的藝術。

從理論到實際代碼:每種架構不僅有解釋,而且都在可運行的Jupyter Notebook中進行了端到端的實現。

結構化學習路徑:Notebooks 的順序經過精心編排,循序漸進地構建概念,從基礎模式到高度先進、多智能體和自我意識系統(tǒng)。

真實世界場景:示例都基于實際應用——金融分析、編程、社交媒體管理、醫(yī)療分診等,使概念立即可用。

第 1 部分:基礎模式 (Notebooks 1-4)

涵蓋增強單個智能體的基本構建塊:Reflection(反思)、Tool Use(工具使用)、ReAct(推理/行動循環(huán))和 Planning(規(guī)劃)。

第 2 部分:多智能體協作 (Notebooks 5, 7, 11, 13)

探索智能體如何協同工作:Multi-Agent Systems(多智能體團隊)、Meta-Controller(智能路由器)、Blackboard Systems(共享內存協作)和 Ensemble(并行多樣化分析)。

第 3 部分:高級記憶與推理 (Notebooks 8, 9, 12)

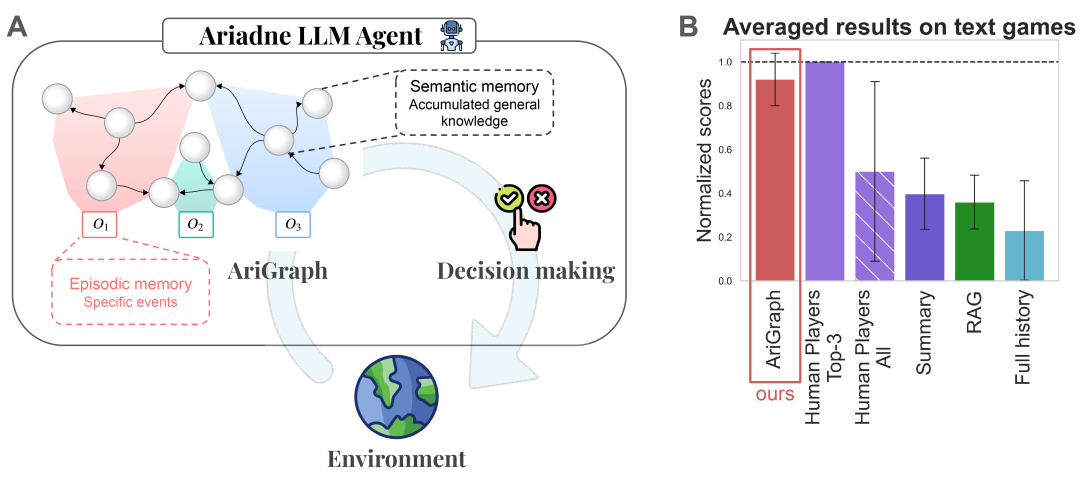

專注于智能體如何進行更深入的思考和記憶:Episodic + Semantic Memory(雙重記憶系統(tǒng))、Graph World-Model(圖結構化知識推理)和 Tree of Thoughts(系統(tǒng)化多路徑探索)。

第 4 部分:安全性、可靠性和真實世界交互 (Notebooks 6, 10, 14, 17)

構建可在生產環(huán)境中信任的智能體:Dry-Run Harness(安全模擬/人工審批)、Simulator(行動前模擬)、PEV(規(guī)劃、執(zhí)行、驗證的錯誤恢復)和 Metacognitive(理解自身局限性)。

第 5 部分:學習與適應 (Notebooks 15, 16)

探索智能體如何隨時間改進和以新穎方式解決問題:Self-Improvement Loop(自我改進/類RLHF學習)和 Cellular Automata(元胞自動機,簡單規(guī)則產生復雜全局行為)。

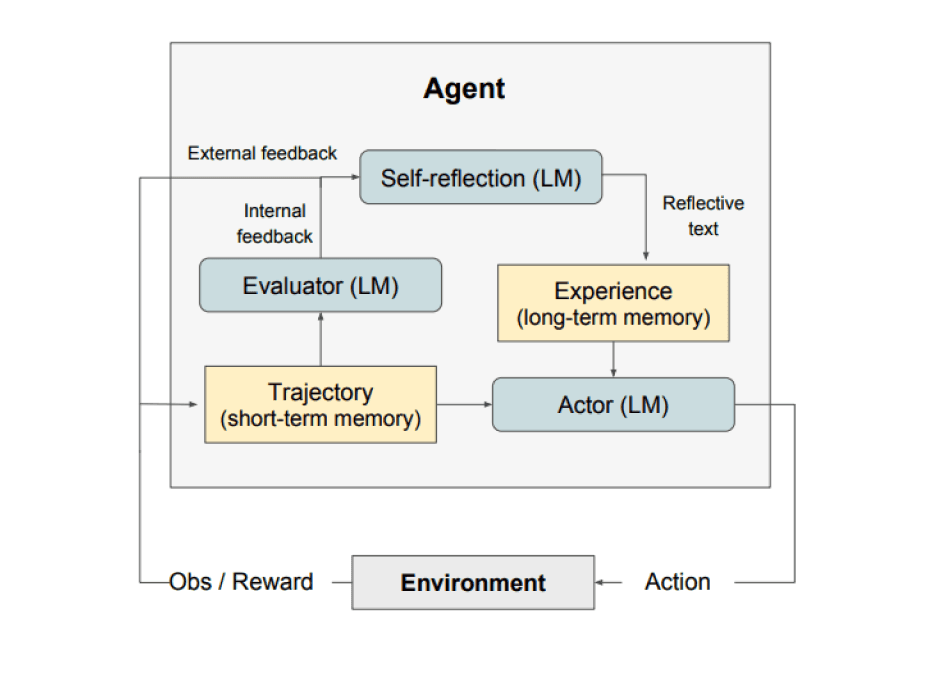

智能體架構 1:反思 (Reflection)

反思模式將大型語言模型(LLM)從一個簡單的、單次通過的生成器提升為一個更審慎、更可靠的推理器。它模仿了人類“起草、審閱、編輯”的過程,讓智能體在返回最終答案之前,先退一步批評、分析和完善自己的工作。

定義:反思架構涉及智能體在返回最終答案之前,批評和修訂自己的輸出。它從單次生成轉變?yōu)橐粋€多步驟的內部獨白:生產(Produce)、評估(Evaluate)和改進(Improve)。

高層工作流:

- 生成 (Generate):智能體根據用戶提示生成初始草稿或解決方案。

- 批評 (Critique):智能體切換角色為批評者,進行自我提問,例如:“這個答案有什么問題?”、“是否最優(yōu)?”、“有沒有邏輯錯誤或 Bug?”

- 完善 (Refine):利用自我批評的見解,智能體生成最終的、改進后的版本。

方面 | 描述 |

|---|---|

何時使用 | 代碼生成:充當代碼審閱者,修正 Bug 和提高效率。 |

優(yōu)勢 (Strengths) | 質量提升:直接解決和糾正錯誤,輸出更準確、可靠。 |

劣勢 (Weaknesses) | 自我局限:智能體仍受限于自身知識和偏見,無法憑空創(chuàng)造它所缺乏的知識。 |

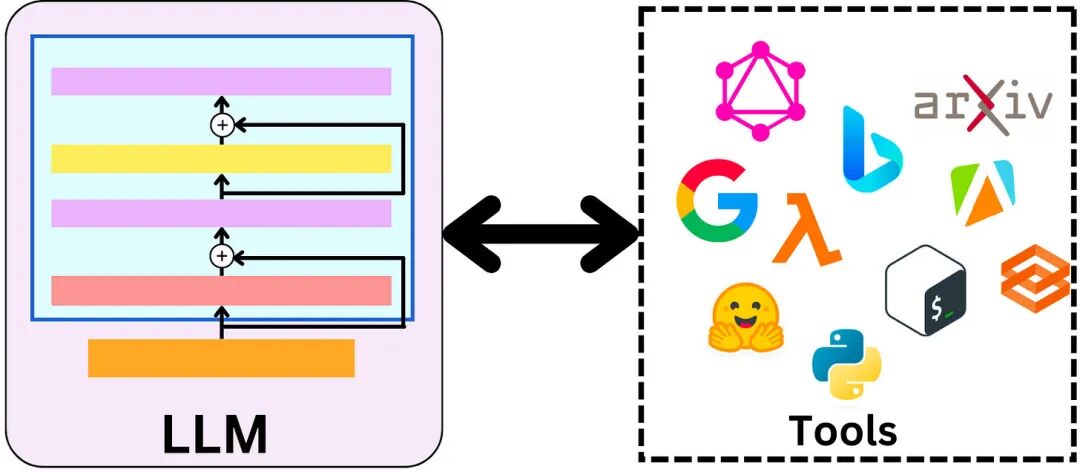

智能體架構 2:工具使用 (Tool Use)

工具使用架構是連接大型語言模型(LLM)推理能力與真實、動態(tài)世界的橋梁。它賦予智能體查詢 API、搜索數據庫和訪問實時信息的能力,從而克服了 LLM 知識的靜態(tài)局限性。

定義:工具使用架構為 LLM 驅動的智能體配備了調用外部函數或 API(即“工具”)的能力。智能體能夠自主判斷用戶查詢是否需要外部信息,并決定調用哪個工具來獲取所需數據。

高層工作流:

- 接收查詢 (Receive Query):智能體接收用戶的請求。

- 決策 (Decision):智能體分析查詢和可用工具,判斷是否需要工具。

- 行動 (Action):如果需要,智能體格式化對工具的調用(例如,帶正確參數的特定函數)。

- 觀察 (Observation):系統(tǒng)執(zhí)行工具調用,并將結果(“觀察結果”)返回給智能體。

- 合成 (Synthesis):智能體將工具的輸出整合到其推理過程中,生成一個最終的、有事實依據的答案。

方面 | 描述 |

|---|---|

何時使用 | 研究助理:使用網絡搜索 API 回答需要最新信息的查詢。 |

優(yōu)勢 (Strengths) | 事實依據 (Factual Grounding):通過獲取實時數據,顯著減少幻覺 (Hallucinations)。 |

劣勢 (Weaknesses) | 集成開銷 (Integration Overhead):需要仔細定義工具、管理 API 密鑰和處理潛在的工具調用失敗。 |

智能體架構 3:ReAct (Reason + Act)

ReAct (Reason + Act,即“推理 + 行動”)是一種關鍵的智能體架構,它彌合了簡單的工具使用和復雜的、多步驟問題解決之間的差距。它的核心創(chuàng)新在于允許智能體動態(tài)地交錯推理和行動,從而成為一個自適應的問題解決者。

定義:ReAct 架構是一種設計模式,智能體在其中交替進行推理步驟和行動。智能體不是預先規(guī)劃所有步驟,而是生成關于其下一步行動的內部思考,然后執(zhí)行一個行動(如調用工具),觀察結果,并利用新信息生成下一個思考和行動。這創(chuàng)建了一個動態(tài)和自適應的循環(huán)。

高層工作流:

- 接收目標 (Receive Goal):智能體接收一項復雜的任務。

- 思考 (Think / Reason):智能體生成一個內部思考,例如:“為了回答這個問題,我首先需要找到信息 X。”

- 行動 (Act):根據思考,智能體執(zhí)行一個行動,通常是調用工具(例如:search_api('X'))。

- 觀察 (Observe):智能體接收到工具返回的結果。

- 重復 (Repeat):智能體將觀察結果納入其上下文,返回第 2 步,生成一個新的思考(例如:“好的,既然我有了 X,我現在需要用它來找到 Y。”)。這個循環(huán)持續(xù)進行,直到總體目標達成。

方面 | 描述 |

|---|---|

何時使用 | 多跳問答 (Multi-hop Q&A):回答需要按順序查找多個信息的查詢(例如:“制造 iPhone 的公司現任 CEO 是誰?”)。 |

優(yōu)勢 (Strengths) | 自適應和動態(tài):可以根據新信息即時調整其計劃。 |

劣勢 (Weaknesses) | 更高的延遲與成本:涉及多個順序的 LLM 調用,比單次通過方法更慢、更昂貴。 |

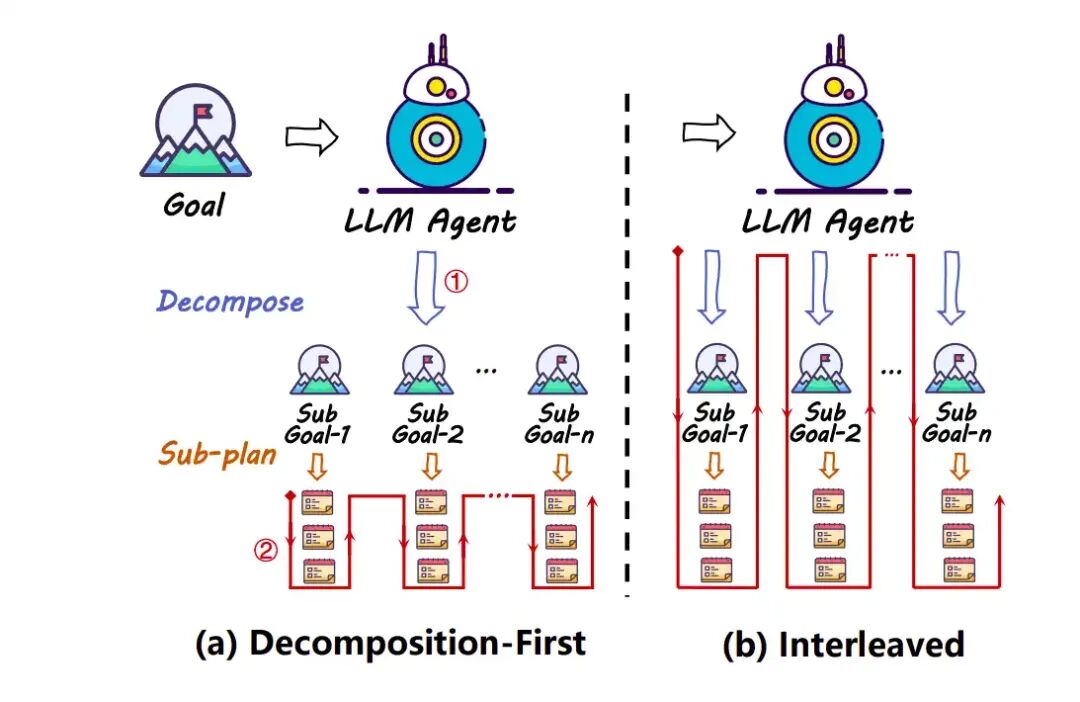

智能體架構 4:規(guī)劃 (Planning)

規(guī)劃 (Planning)架構在智能體的推理過程中引入了至關重要的 **預見性 (foresight)**。與 ReAct 模式(步步為營、即時反應)不同,規(guī)劃智能體在采取任何行動之前,會先將一個復雜的任務分解成一系列更小、可管理的子目標,制定一個完整的“作戰(zhàn)計劃”。

定義:規(guī)劃架構涉及智能體在開始執(zhí)行之前,將復雜的總目標明確分解為一個詳細的、按順序排列的子任務列表。初始規(guī)劃階段的輸出是一個具體的、循序漸進的計劃,智能體隨后將有條不紊地遵循該計劃來解決問題。

高層工作流:

- 接收目標 (Receive Goal):智能體接收一個復雜任務。

- 規(guī)劃 (Plan):專門的“規(guī)劃器 (Planner)”組件分析目標,并生成一個有序的子任務列表,例如:["查找事實 A", "查找事實 B", "使用 A 和 B 計算 C"]。

- 執(zhí)行 (Execute):一個“執(zhí)行器 (Executor)”組件按照計劃,順序執(zhí)行每個子任務,并根據需要使用工具。

- 合成 (Synthesize):一旦計劃中的所有步驟都完成,一個最終組件會整合執(zhí)行步驟的結果,生成一個連貫的最終答案。

方面 | 描述 |

|---|---|

何時使用 | 多步驟工作流:適用于操作順序已知且關鍵的任務,如生成報告(獲取數據處理總結)。 |

優(yōu)勢 (Strengths) | 結構化和可追溯:整個工作流程預先設定,過程透明,易于調試。 |

劣勢 (Weaknesses) | 對變化脆弱 (Brittle to Change):如果環(huán)境在執(zhí)行過程中發(fā)生意外變化,預先制定的計劃可能會失敗。它不如 ReAct 智能體那樣具有自適應性。 |

智能體架構 5:多智能體系統(tǒng) (Multi-Agent Systems)

多智能體系統(tǒng) (Multi-Agent System, MAS)是最強大和靈活的架構之一。它超越了單個智能體的概念,轉而模擬一個由專業(yè)化智能體組成的團隊,通過協作來解決問題。每個智能體都有獨特的角色、個性和技能集,模仿了人類專家團隊的工作方式。

定義:多智能體系統(tǒng)是一種架構,其中一組截然不同、高度專業(yè)的智能體通過協作(有時是競爭)來實現一個共同目標。系統(tǒng)使用一個中央控制器或定義的工作流協議來管理智能體之間的通信和任務路由。

高層工作流:

- 分解 (Decomposition):主控制器或用戶提供一個復雜的任務。

- 角色定義 (Role Definition):系統(tǒng)根據智能體的定義角色(例如:‘研究員’、‘編碼員’、‘評論家’、‘作家’)將子任務分配給專業(yè)的智能體。

- 協作 (Collaboration):智能體執(zhí)行各自的任務,通常是并行或順序進行。它們將輸出傳遞給彼此或一個中心“黑板”。

- 合成 (Synthesis):最后一個“管理員”或“合成器”智能體收集所有專業(yè)智能體的輸出,并組裝成最終的、整合后的響應。

方面 | 描述 |

|---|---|

何時使用 | 復雜報告生成:創(chuàng)建需要多個領域專業(yè)知識的詳細報告(例如:財務分析、市場研究)。 |

優(yōu)勢 (Strengths) | 專業(yè)化和深度:每個智能體都可以針對特定領域進行微調,從而在其領域內產出更高質量的工作。 |

劣勢 (Weaknesses) | 協調開銷:管理智能體之間的通信和工作流程,增加了系統(tǒng)設計的復雜性。 |

智能體架構 6:規(guī)劃器執(zhí)行器驗證器 (PEV)

規(guī)劃器執(zhí)行器驗證器 (PlannerExecutorVerifier, PEV)架構引入了智能體系統(tǒng)中至關重要的魯棒性 (robustness)和自我修正 (self-correction)層。它借鑒了嚴格的軟件工程和質量保證流程,即工作只有在經過驗證后才算“完成”。

定義:PlannerExecutorVerifier (PEV)架構是一種三階段工作流,它明確分離了規(guī)劃、執(zhí)行和驗證的行為。它確保在智能體繼續(xù)下一步之前,對每一步的輸出進行驗證,從而創(chuàng)建了一個魯棒的、自我修正的循環(huán)。

高層工作流:

- 規(guī)劃 (Plan):‘規(guī)劃器’智能體將高層目標分解成一系列具體的、可執(zhí)行的步驟。

- 執(zhí)行 (Execute):‘執(zhí)行器’智能體執(zhí)行計劃中的下一個步驟并調用相應的工具。

- 驗證 (Verify):‘驗證器’智能體檢查執(zhí)行器的輸出。它檢查正確性、相關性和潛在錯誤,然后給出判斷:該步驟是成功還是失敗?

- 路由與迭代 (Route & Iterate):根據驗證器的判斷,路由器決定下一步行動:

- 如果步驟成功且計劃未完成,返回執(zhí)行器執(zhí)行下一步。

- 如果步驟失敗,返回規(guī)劃器創(chuàng)建一個新的計劃,通常會提供失敗的上下文,使新計劃更智能。

- 如果步驟成功且計劃完成,進入最終合成步驟。

方面 | 描述 |

|---|---|

何時使用 | 安全關鍵應用:(金融、醫(yī)療)錯誤成本很高時,PEV 提供必要的保障措施,防止智能體基于錯誤數據行動。 |

優(yōu)勢 (Strengths) | 魯棒性與可靠性:核心優(yōu)勢是檢測和從錯誤中恢復的能力。 |

劣勢 (Weaknesses) | 更高的延遲與成本:在每次行動后增加驗證步驟,涉及更多的 LLM 調用,使其成為目前最慢、最昂貴的架構。 |

智能體架構 7:黑板系統(tǒng) (Blackboard Systems)

黑板系統(tǒng) (Blackboard System)是一種強大且高度靈活的多智能體協作模式。它借鑒了人類專家團隊圍繞一塊實體黑板共同解決復雜問題的理念。

與僵硬、預定義的智能體傳遞序列不同,黑板系統(tǒng)具有一個中央的、共享數據存儲庫(即“黑板”)。智能體可以在黑板上讀取問題的當前狀態(tài),并寫下它們的貢獻。一個動態(tài)控制器持續(xù)觀察黑板,并根據解決問題所需的內容,決定下一步激活哪個專業(yè)智能體。這實現了一種機會主義 (opportunistic)和自發(fā)涌現 (emergent)的工作流程。

定義:黑板系統(tǒng)是一種多智能體架構,其中多個專業(yè)智能體通過讀取和寫入一個名為“黑板”的共享中央數據存儲庫進行協作。一個控制器或調度器根據黑板上不斷演變的解決方案狀態(tài),動態(tài)地決定下一個應該采取行動的智能體。

高層工作流:

- 共享內存(黑板):中央數據結構保存問題的當前狀態(tài),包括用戶請求、中間發(fā)現和部分解決方案。

- 專業(yè)智能體:一組獨立的智能體(擁有特定專業(yè)知識)持續(xù)監(jiān)控黑板。

- 控制器 (Controller):一個中央“控制器”智能體監(jiān)控黑板,分析當前狀態(tài),并決定哪個專業(yè)智能體最適合做出下一個貢獻。

- 機會主義激活:控制器激活選定的智能體。該智能體從黑板上讀取相關數據,執(zhí)行任務,并將發(fā)現結果寫回黑板。

- 迭代:過程重復,控制器以動態(tài)序列激活不同的智能體,直到確定黑板上的解決方案已完成。

方面 | 描述 |

|---|---|

何時使用 | 復雜的、結構不良的問題:解決方案路徑事先未知,需要一種自發(fā)涌現、機會主義策略的問題(例如:復雜診斷、科學發(fā)現)。 |

優(yōu)勢 (Strengths) | 靈活性和適應性:工作流程不是硬編碼的,而是根據問題自發(fā)產生的,系統(tǒng)具有高度適應性。 |

劣勢 (Weaknesses) | 控制器復雜性:整個系統(tǒng)的智能程度嚴重依賴于控制器的復雜性。一個簡單的控制器可能導致低效或循環(huán)行為。 |

智能體架構 8:情景記憶 + 語義記憶堆棧

標準的聊天機器人記憶是短暫的,只持續(xù)一個會話。為了構建一個能夠隨著用戶學習和成長的個性化智能體,我們需要一種更強大的解決方案。該架構通過結合兩種不同的記憶類型,模擬了人類的認知,實現了結構化的記憶體系:

記憶類型 | 定義 | 存儲方式 | 作用 |

|---|---|---|---|

情景記憶 (Episodic Memory) | 記錄特定事件或過去交互的記憶。回答“發(fā)生了什么?”(例如:“上周,用戶問我關于英偉達股價的問題。”) | 向量數據庫 | 用于基于語義相似性檢索相關的歷史對話。 |

語義記憶 (Semantic Memory) | 從這些事件中提取的結構化事實、概念和關系。回答“我知道什么?”(例如:“用戶 Alex 是保守型投資者。”) | 圖數據庫 (Neo4j) | 擅長管理和查詢實體間的復雜關系。 |

通過結合這兩種記憶,智能體不僅能回憶起過去的對話,還能建立一個豐富、相互關聯的知識庫,從而實現深度個性化和上下文感知的交互。

該架構引入了一個完整的循環(huán),涵蓋了記憶的檢索(Recall)和創(chuàng)建(Encoding):

- 交互 (Interaction):用戶發(fā)起查詢。

- 記憶檢索(回憶):智能體查詢兩個記憶系統(tǒng):

- 情景記憶:搜索向量存儲,查找相似的過往對話。

- 語義記憶:查詢圖數據庫,查找與查詢相關的實體和事實。

- 增強生成 (Augmented Generation):檢索到的記憶被添加到 LLM 的提示上下文,使模型能夠生成一個了解過去交互和已習得事實的個性化響應。

- 記憶創(chuàng)建(編碼):交互完成后,后臺進程分析對話:

- 創(chuàng)建一個簡潔的輪次摘要(新的情景記憶)。

- 提取關鍵實體和關系(新的語義記憶)。

- 記憶存儲:新的情景摘要被嵌入并保存到向量存儲中。新的語義事實以節(jié)點和邊的形式寫入圖數據庫。

方面 | 描述 |

|---|---|

何時使用 | 長期個人助理:助理能記住用戶數周或數月內的偏好、項目和個人細節(jié)。 |

優(yōu)勢 (Strengths) | 真正的個性化:實現了超越單個會話上下文窗口的持久化學習和上下文。 |

劣勢 (Weaknesses) | 復雜性:這是一個比簡單無狀態(tài)智能體復雜得多的架構,難以構建和維護。 |

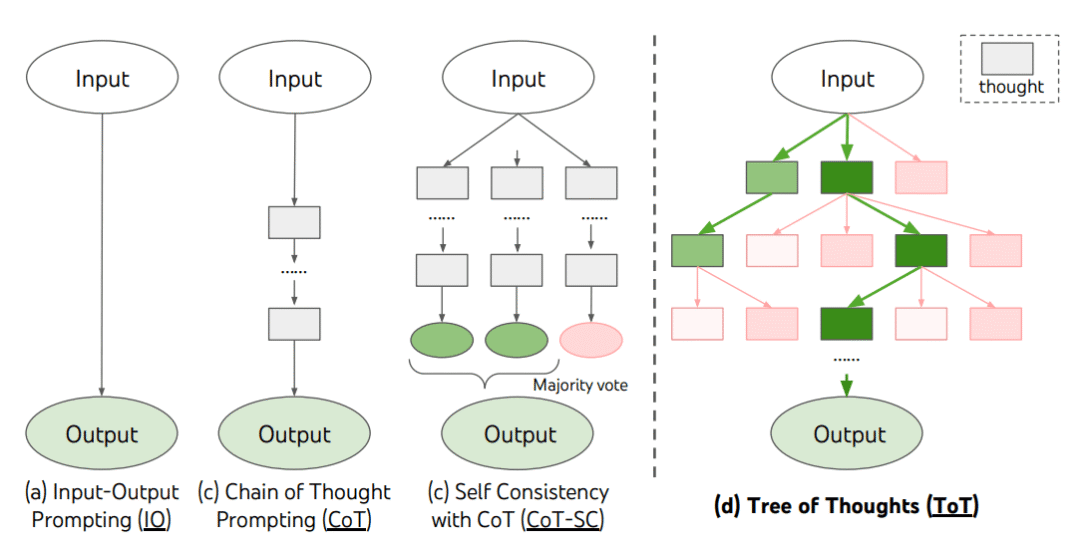

智能體架構 9:思維樹規(guī)劃 (Tree-of-Thoughts, ToT)

ToT 智能體不是生成單一的、順序的推理線,而是在問題的每個階段生成多個候選的“思維”或下一步。然后,它評估這些思維,修剪 (pruning)無效或前景不佳的分支,并擴展 (expanding)最有希望的分支。這創(chuàng)建了一個搜索樹,智能體可以在其中回溯、探索替代方案,并系統(tǒng)地導航復雜的問題空間。

定義:思維樹 (Tree-of-Thoughts, ToT)是一種智能體推理框架,其中問題解決被建模為在樹中進行的搜索。智能體同時探索多個推理路徑(分支)。在每一步,它生成潛在的下一步(“思維”),評估其可行性,并決定繼續(xù)探索哪些路徑,從而有效地修剪搜索空間。

高層工作流:

- 分解 (Decomposition):問題被分解成一系列步驟或思維。

- 思維生成 (Thought Generation):對于問題的當前狀態(tài),智能體生成多個潛在的下一步或思維。這在搜索樹中創(chuàng)建了分支。

- 狀態(tài)評估 (State Evaluation):每一個新思維(導致新狀態(tài))都會被一個“批評者”或驗證函數評估,評估其:

- 有效性 (Validity):該行動是否符合問題規(guī)則?

- 進度 (Progress):該行動是否讓我們更接近解決方案?

- 修剪與擴展 (Pruning & Expansion):無效或前景不佳的分支被修剪。智能體隨后從最有希望的活躍分支繼續(xù),重復思維生成過程。

- 解決方案 (Solution):過程持續(xù)到達到目標狀態(tài)。解決方案就是從根節(jié)點到目標狀態(tài)的思維路徑。

方面 | 描述 |

|---|---|

何時使用 | 邏輯謎題與數學問題:具有明確規(guī)則和目標狀態(tài),需要多步驟、非線性推理的問題(例如:數獨、過河謎題)。 |

優(yōu)勢 (Strengths) | 魯棒性 (Robustness):系統(tǒng)地探索問題空間,與單次推理方法相比,不太可能陷入困境或產生錯誤答案。 |

劣勢 (Weaknesses) | 計算成本高:需要比簡單的思維鏈提示多得多的 LLM 調用和狀態(tài)管理,使其更慢、更昂貴。 |

智能體被構建為一個LangGraph圖,其核心邏輯是一個循環(huán):

- 初始化:設置初始狀態(tài)。

- 擴展 (Expand):遍歷當前所有活躍路徑,使用get_possible_moves函數生成所有有效的下一步(思維),創(chuàng)建新的分支。

- 修剪 (Prune):檢查新路徑:

- 有效性檢查:盡管生成函數已保證有效,但在此處可進行額外檢查。

- 循環(huán)檢查:如果路徑的最后一個狀態(tài)在之前出現過(形成循環(huán)),則修剪該路徑。

- 檢查解決方案:如果任何活躍路徑達到目標狀態(tài),則停止。否則,回到擴展步驟。

智能體架構 10:模擬器 / 心智模型在環(huán) (Simulator-in-the-Loop)

核心思想是讓智能體以非常具體的方式“三思而后行”。智能體不會立即在現實世界中執(zhí)行提議的行動,而是首先在環(huán)境的內部模擬版本中測試該行動。通過觀察這個安全沙盒中可能產生的后果,智能體可以評估風險、完善策略,然后才在現實中執(zhí)行一個更經過深思熟慮的行動。

定義:模擬器或心智模型在環(huán)架構涉及一個智能體,它利用其環(huán)境的內部模型來模擬潛在行動的結果,然后再執(zhí)行這些行動。這使智能體能夠進行 **假設分析 (what-if analysis)**、預測后果,并優(yōu)化其計劃以確保安全性和有效性。

高層工作流:

- 觀察 (Observe):智能體觀察現實環(huán)境的當前狀態(tài)。

- 提議行動 (Propose Action):智能體的規(guī)劃模塊根據目標和當前狀態(tài),生成一個高層次的擬議行動或策略。

- 模擬 (Simulate):智能體將環(huán)境的當前狀態(tài)分叉 (forks)到一個沙盒模擬中。它應用擬議的行動,并向前運行模擬以觀察一系列可能的結果。

- 評估與完善 (Assess & Refine):智能體分析模擬結果。該行動是否導致了期望的結果?是否存在不可預見的負面后果?基于此評估,它將最初的提案完善為一個最終、具體的行動。

- 執(zhí)行 (Execute):智能體在真實環(huán)境中執(zhí)行最終、完善后的行動。

- 重復 (Repeat):循環(huán)從現實環(huán)境的新狀態(tài)開始。

方面 | 描述 |

|---|---|

何時使用 | 機器人技術:在移動物理手臂之前模擬抓取或路徑,以避免碰撞或損壞。 |

優(yōu)勢 (Strengths) | 安全與風險降低:通過首先在安全環(huán)境中審查行動,極大地減少了有害或代價高昂錯誤的發(fā)生幾率。 |

劣勢 (Weaknesses) | 模擬-現實差距 (Simulation-Reality Gap):有效性完全取決于模擬器的逼真度。如果世界模型不準確,智能體的計劃可能基于錯誤的假設。 |

智能體架構 12:圖 / 世界模型記憶 (Graph / World-Model Memory)

基于圖的智能體不將信息存儲為孤立的文本塊,而是將傳入數據解析為實體(節(jié)點)和關系(邊),從而創(chuàng)建一個豐富、可查詢的知識圖譜。智能體隨后可以通過遍歷該圖譜來回答復雜問題,發(fā)現隱藏在非結構化文本中的洞察。

定義:圖 / 世界模型記憶是一種智能體架構,其中知識存儲在結構化的圖數據庫中。信息被表示為節(jié)點(實體,如人、地點、概念)和邊(它們之間的關系)。這創(chuàng)建了一個動態(tài)的“世界模型”,智能體可以基于此進行推理。

高層工作流:

- 信息攝取 (Information Ingestion):智能體接收非結構化或半結構化數據(文本、文檔等)。

- 知識提取 (Knowledge Extraction):一個由 LLM 驅動的流程解析信息,識別關鍵實體及其相互連接的關系。

- 圖譜更新 (Graph Update):提取的節(jié)點和邊被添加或更新到持久化的圖數據庫中(如 Neo4j)。

- 問答 / 推理 (Question Answering / Reasoning):當被問及問題時,智能體執(zhí)行以下步驟:a. 將自然語言問題轉換為正式的圖查詢語言(例如:Neo4j 的 Cypher)。 b. 對圖譜執(zhí)行查詢以檢索相關的子圖或事實。c. 將查詢結果合成為自然語言答案。

方面 | 描述 |

|---|---|

何時使用 | 企業(yè)知識助手:從內部文檔中構建公司項目、員工和客戶的可查詢模型。 |

優(yōu)勢 (Strengths) | 結構化與可解釋:知識高度組織化。可以通過顯示圖譜中導致答案的確切路徑來解釋答案。 |

劣勢 (Weaknesses) | 前期復雜性:需要定義良好的模式和一個魯棒的提取過程。 |

使用具有結構化輸出(Pydantic)的 LLM 作為知識提取器。它讀取文本,并以Node和Relationship的形式提取實體和關系(關系類型被大寫,如ACQUIRED)。

智能體處理了三份相互關聯但獨立的文件,逐步構建知識圖譜:

- 文檔 1:AlphaCorpACQUIREDBetaSolutions。

- 文檔 2:Dr. Evelyn ReedWORKS_FORAlphaCorp,AlphaCorpPRODUCESQuantumLeap AI。

- 文檔 3:Innovate Inc. 的 NeuraGenCOMPETES_WITHQuantumLeap AI。 該智能體實現了文本到 Cypher的完整管道:

- 生成 Cypher 查詢:LLM 將自然語言問題轉換為 Cypher 語句。

- 執(zhí)行查詢:在 Neo4j 圖數據庫上運行 Cypher 語句以獲取上下文。

- 合成最終答案:LLM 基于查詢結果提供自然語言答案。

智能體架構 13:并行探索 + 集成決策 (Parallel Exploration + Ensemble Decision)

通過對 AI 智能體應用“群體的智慧”原則,解決了單個 LLM 固有的不確定性和潛在偏差問題。不依賴于單一的推理線,而是同時衍生出多個獨立的智能體,從不同的視角分析問題。每個智能體遵循自己的推理路徑,如同專家委員會中的不同專家。然后,一個最終的“聚合器”智能體收集并合成它們的個人結論,權衡不同的觀點,找出共識和沖突,從而產生一個更細致、更可靠的最終答案。

定義:并行探索 + 集成決策是一種智能體架構,其中一個問題由多個獨立的智能體或推理路徑同時處理。然后,通過一個單獨的智能體(通常是聚合器),采用投票、建立共識或合成等方法,將所有單獨的輸出進行集成,從而得出最終、更健壯的結論。

高層工作流:

- 扇出(并行探索):用戶查詢被分發(fā)給 N 個獨立的專業(yè)智能體。這些智能體通常被賦予不同的指令、角色或工具,以鼓勵分析方法的多樣性。

- 獨立處理:每個智能體單獨處理問題,生成自己的完整分析、結論或答案。

- 扇入(聚合):收集所有 N 個智能體的輸出。

- 合成(集成決策):最終的“聚合器”或“裁決者”智能體接收所有單個輸出。它的任務是分析這些觀點,找出共同點,權衡沖突的證據,并合成一個全面而平衡的最終答案。

方面 | 描述 |

|---|---|

何時使用 | 困難推理問答:對于單一推理線容易遺漏細節(jié)的復雜、模糊問題。 |

優(yōu)勢 (Strengths) | 提升可靠性和準確性:平均化單個智能體的隨機錯誤或偏見,使最終答案更有可能正確且全面。 |

劣勢 (Weaknesses) | 成本極高:這是計算成本最高的架構之一,因為它將 LLM 調用的數量乘以集成中的智能體數量(再加上最終的聚合調用)。 |

智能體架構 14:可觀測性 + 演習線束 (Dry-Run Harness)

在沒有確切知道智能體將要做什么之前,絕不在實時環(huán)境中運行其行動。此架構將“三思而后行 (look before you leap)”的過程正式化。智能體首先在演習模式(dry_run)下執(zhí)行其計劃,該模式不會改變真實世界,但會生成詳細的日志和清晰的行動計劃。然后,此計劃會被提交給人類(或自動檢查器)批準,之后才允許最終的實時執(zhí)行。

定義:可觀測性與演習線束是一種測試和部署架構,它會攔截智能體的行動。它首先在“演習”或“沙盒”模式下執(zhí)行這些行動,模擬行動而不會造成真實世界的影響。由此產生的計劃和日志會被呈現供審閱,只有在明確批準后,行動才會在實時環(huán)境中執(zhí)行。

高層工作流:

- 智能體提出行動 (Agent Proposes Action):智能體確定一個計劃或特定的工具調用。

- 演習執(zhí)行 (Dry Run Execution):線束使用dry_run=True標志調用智能體的計劃。底層工具被設計為識別此標志,并只輸出它們將要做什么,以及相應的日志和追蹤。

- 收集可觀測性數據 (Collect Observability Data):線束捕獲擬議的行動、演習日志和任何相關的追蹤數據。

- 人類/自動化審閱 (Human/Automated Review):這些可觀測性數據被呈現給審閱者。人類可以檢查正確性、安全性和目標一致性。自動化系統(tǒng)可以運行策略違規(guī)檢查。

- 批準/否決決策 (Go/No-Go Decision):審閱者做出“批準”或“拒絕”的決定。

- 實時執(zhí)行(在“批準”時):如果獲得批準,線束會重新執(zhí)行智能體的行動,但這次是dry_run=False,從而使其產生真實世界的影響。

方面 | 描述 |

|---|---|

何時使用 | 生產驗證與安全:任何可以修改狀態(tài)、花費金錢、發(fā)送通信或執(zhí)行任何其他不可逆行動的智能體的永久生產功能。 |

優(yōu)勢 (Strengths) | 最大透明度和安全性:提供智能體行動的清晰、可審計的預覽,防止代價高昂或令人尷尬的錯誤。 |

劣勢 (Weaknesses) | 延遲部署/執(zhí)行:強制性的審閱步驟(尤其是涉及人類時)會引入延遲,使其不適合實時應用程序。 |

智能體架構 15:自我改進循環(huán) (Self-Improvement Loop)

**自我改進循環(huán) (Self-Improvement Loop)迭代地完善其輸出,從而達到更高的質量標準。它是讓智能體隨著時間從良好的基線水平提升到專家級表現的機制。

這個過程模仿了人類“做獲得反饋改進”的學習周期。Notebook 通過一個自優(yōu)化 (Self-Refine)工作流來實現這一點:智能體的輸出立即由一個批評子智能體進行評估,如果發(fā)現不足,則要求原始智能體根據可操作的反饋修改其工作。

定義:自我改進循環(huán)是一種智能體架構,其中智能體的輸出由其自身或另一個智能體進行評估,并將此評估用作反饋,以生成一個經過修訂的、更高質量的輸出。當這種反饋被存儲并用于隨著時間推移改善智能體的基線性能時,它就成為一種持續(xù)學習的形式。

高層工作流(自優(yōu)化):

- 生成初始輸出 (Generate Initial Output):主要智能體生成解決方案的第一個版本(“草稿”)。

- 批評輸出 (Critique Output):批評智能體(或處于“批評模式”下的主要智能體)根據一組預定義的標準或一般準則評估草稿。

- 決策 (Decision):系統(tǒng)檢查批評是否足夠積極以接受輸出。

- 修訂(循環(huán))(Revise / Loop):如果輸出不被接受,原始草稿和批評者的反饋將傳遞回主要智能體,指示其生成一個解決反饋的修訂版本。

- 接受 (Accept):一旦輸出達到質量標準,循環(huán)終止,返回最終版本。

方面 | 描述 |

|---|---|

何時使用 | 高質量內容生成:對通用初稿不足以勝任的任務,例如撰寫法律文件、詳細技術報告或有說服力的營銷文案。 |

優(yōu)勢 (Strengths) | 顯著提高輸出質量:迭代優(yōu)化始終比單次生成產生更好的結果。 |

劣勢 (Weaknesses) | 強化偏差的風險:如果批評智能體具有有缺陷的邏輯或偏差,系統(tǒng)可能會陷入一個強化自身錯誤的循環(huán)。 |

智能體架構 16:元胞自動機 / 網格系統(tǒng)

在這個模型中,環(huán)境本身就變成了智能體。網格中的每個單元格都是一個微型智能體,擁有自己的狀態(tài)和一套簡單的規(guī)則,用于根據其緊鄰的鄰居來更新狀態(tài)。沒有中央控制器或復雜的尋路算法。相反,智能的、全局的行為是簡單局部規(guī)則重復、同步應用后涌現 (emerges)出來的。系統(tǒng)變成了一個“計算結構”,通過信息的波狀傳播來解決問題。

定義:基于網格的智能體系統(tǒng)是一種架構,其中大量簡單的智能體(或“單元格”)排列在一個空間網格中。每個智能體都有一個狀態(tài),并根據僅考慮其緊鄰鄰居狀態(tài)的規(guī)則集同步更新其狀態(tài)。復雜、高層次的模式和問題解決能力從這些局部交互中涌現出來。

高層工作流:

- 網格初始化 (Grid Initialization):創(chuàng)建單元格智能體網格,每個單元格初始化一個類型(如:障礙物、空白)和一個狀態(tài)(如:一個值)。

- 設置邊界條件 (Set Boundary Conditions):一個或多個單元格被賦予特殊狀態(tài)以啟動計算(例如,將“目標”單元格的值設置為 0)。

- 同步時鐘 (Synchronous Tick):系統(tǒng)“滴答”向前。在每個時鐘周期,每個單元格根據其鄰居的當前狀態(tài)同時計算其下一個狀態(tài)。

- 涌現 (Emergence):隨著系統(tǒng)的推進,信息像波浪一樣在網格中傳播。這會創(chuàng)建梯度、路徑和其他復雜結構。

- 狀態(tài)穩(wěn)定 (State Stabilization):系統(tǒng)運行直到網格狀態(tài)穩(wěn)定(不再發(fā)生變化),表明計算已完成。

- 讀取結果 (Readout):問題的解決方案直接從網格的最終狀態(tài)中讀取(例如,通過沿著計算出的梯度追蹤)。

方面 | 描述 |

|---|---|

何時使用 | 空間推理與物流:動態(tài)環(huán)境中(如倉庫示例)的最佳尋路。 |

優(yōu)勢 (Strengths) | 高并行性:邏輯本質上是并行的,在合適的硬件上速度極快。 |

劣勢 (Weaknesses) | 設計復雜性:設計局部規(guī)則以產生所需的全局行為可能具有挑戰(zhàn)性且不直觀。 |

智能體架構 17:反思性元認知智能體

元認知智能體超越了簡單的自我反思。它維護著一個明確的“自我模型 (Self-Model)”——對其自身知識、工具和邊界的結構化表示。當面對一項任務時,它的第一步不是解決問題,而是根據其自我模型來分析問題。它會問內部問題,例如:

- “我是否有足夠的知識自信地回答這個問題?”

- “這個主題是否在我指定的專業(yè)領域內?”

- “用戶查詢是否涉及錯誤可能帶來危險的高風險主題?”

根據這些答案,它會選擇一種策略:直接推理、使用專業(yè)工具,或者——最重要的是——當任務超出其已知限制時上報給人類。

定義:反思性元認知智能體是一種智能體,它維護并使用關于其自身能力、知識邊界和信心水平的明確模型,來為給定任務選擇最合適的策略。這種自我建模使其行為更安全、更可靠,尤其是在錯誤信息可能有害的領域。

高層工作流:

- 感知任務 (Perceive Task):智能體接收用戶請求。

- 元認知分析(自我反思)(Metacognitive Analysis):智能體的核心推理引擎根據其自我模型分析請求。它評估其信心、工具的相關性,以及查詢是否在其預定義的操作領域內。

- 策略選擇 (Strategy Selection):基于分析,智能體選擇以下策略之一:

- 直接推理 (Reason Directly):適用于高信心、低風險的知識庫內查詢。

- 使用工具 (Use Tool):當查詢需要智能體通過工具擁有的特定能力時。

- 上報/拒絕 (Escalate/Refuse):適用于低信心、高風險或超出范圍的查詢。

- 執(zhí)行策略 (Execute Strategy):執(zhí)行所選擇的路徑。

- 響應 (Respond):智能體提供結果,可能是直接答案、工具增強的答案,或帶有咨詢專家指示的安全拒絕。

方面 | 描述 |

|---|---|

何時使用 | 高風險咨詢系統(tǒng):任何在醫(yī)療保健、法律或金融等領域提供信息的系統(tǒng),智能體必須能夠說“我不知道”或“您應該咨詢專業(yè)人士”。 |

優(yōu)勢 (Strengths) | 增強安全性和可靠性:智能體被明確設計為避免在其非專業(yè)領域做出自信的斷言。 |

劣勢 (Weaknesses) | 自我模型的復雜性:定義和維護準確的自我模型可能很復雜。 |

-

AI

+關注

關注

91文章

40715瀏覽量

302366 -

語言模型

+關注

關注

0文章

572瀏覽量

11337 -

智能體

+關注

關注

1文章

533瀏覽量

11639

發(fā)布評論請先 登錄

富士康在美拿到285億補貼 美媒寫2萬字長文討伐

《零基礎開發(fā)AI Agent——手把手教你用扣子做智能體》

【2025夏季班正課】大模型Agent智能體開發(fā)實戰(zhàn) 課分享

萬字詳細圖文剖析電源PCB布板與EMC的關系資料下載

人工智能300年!LSTM之父萬字長文:詳解現代AI和深度學習發(fā)展史

萬字長文聊聊“車規(guī)級”芯片

萬字長文聊聊“車規(guī)級”芯片

人工智能300年!LSTM之父萬字長文:詳解現代AI和深度學習發(fā)展史

阿里通義千問重磅升級,免費開放1000萬字長文檔處理功能

【6千字長文】車載芯片的技術沿革與趨勢分析

萬字長文AI智能體:17種體架構詳細實現

萬字長文AI智能體:17種體架構詳細實現

評論